AI for Science(AI4S)正成为全球科研范式革新的关键驱动力,科学大模型也随之从辅助工具的1.0阶段,迈入驱动科学发现的2.0时代。

近日,开源模型社区模力方舟正式上线了来自上海人工智能实验室的 Intern-S1-Pro 模型权重,面向科研团队与开发者开放下载、部署与使用。这不仅是一个模型的发布,更是对国产 AI4S基础设施 能力体系的一次重要补充。

🔗 模力方舟下载地址:

https://moark.com/hf-models/internlm/Intern-S1-Pro

专为AI4S打造:万亿参数MoE架构的科学推理模型

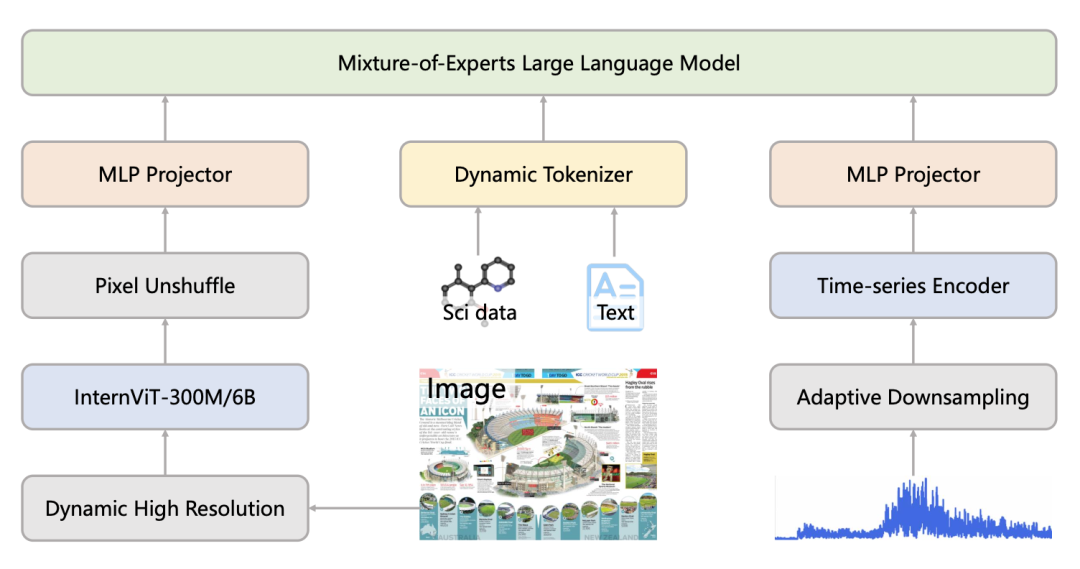

Intern-S1-Pro 是一款专为AI4S核心场景设计的混合专家(MoE)多模态大模型。它拥有惊人的1万亿(1T)总参数规模,每次推理时激活约220亿(22B)参数,旨在覆盖化学、材料科学、生命科学、地球科学等多个垂直科研领域。

其模型架构基于通义团队开源的Qwen3-235B,并配备了高精度的视觉编码器 InternViT-6B。该模型在总计5万亿Token的多模态数据上进行了持续训练,其中超过2.5万亿Token来自科学领域,这为其强大的科学理解能力奠定了基础。

与传统通用大模型相比,Intern-S1-Pro 在科学任务上的表现实现了显著跃升。在诸如分子结构解析、化学反应路径规划、蛋白质序列理解、地震信号建模等专业性极强的任务中,其表现已经能够对齐甚至超越多款闭源商用模型。

创新底层设计:FoPE频谱建模 × 高效专家路由

为了胜任复杂的科学计算,Intern-S1-Pro 在底层架构上进行了两项关键创新:

- 傅里叶位置编码(FoPE)+ 时序建模:这项创新让模型具备了敏锐感知物理信号频率结构的能力。它首次实现了对采样点从10⁰到10⁶级别的多通道信号统一建模,使其能够从容应对从遥感影像、地震波到脑电图(EEG)等多种类型的科学数据。

- STE + 分组路由机制:针对万亿参数MoE模型训练中常见的稳定性差、资源浪费高难题,该模型采用了稠密梯度训练与智能负载均衡路由策略。这大幅提升了训练效率与收敛速度,解决了大规模MoE模型训练的痛点。

值得一提的是,该模型的开发过程全面对齐国产算力生态,已成功适配XTuner、LMDeploy等全栈开源训练与推理工具链,并验证了在FP8精度下训练与部署的稳定性。

科学能力再进化:竞赛级推理水平 + 全学科能力矩阵

在多项权威评测中,Intern-S1-Pro 展现了卓越的科研推理与跨模态理解能力。

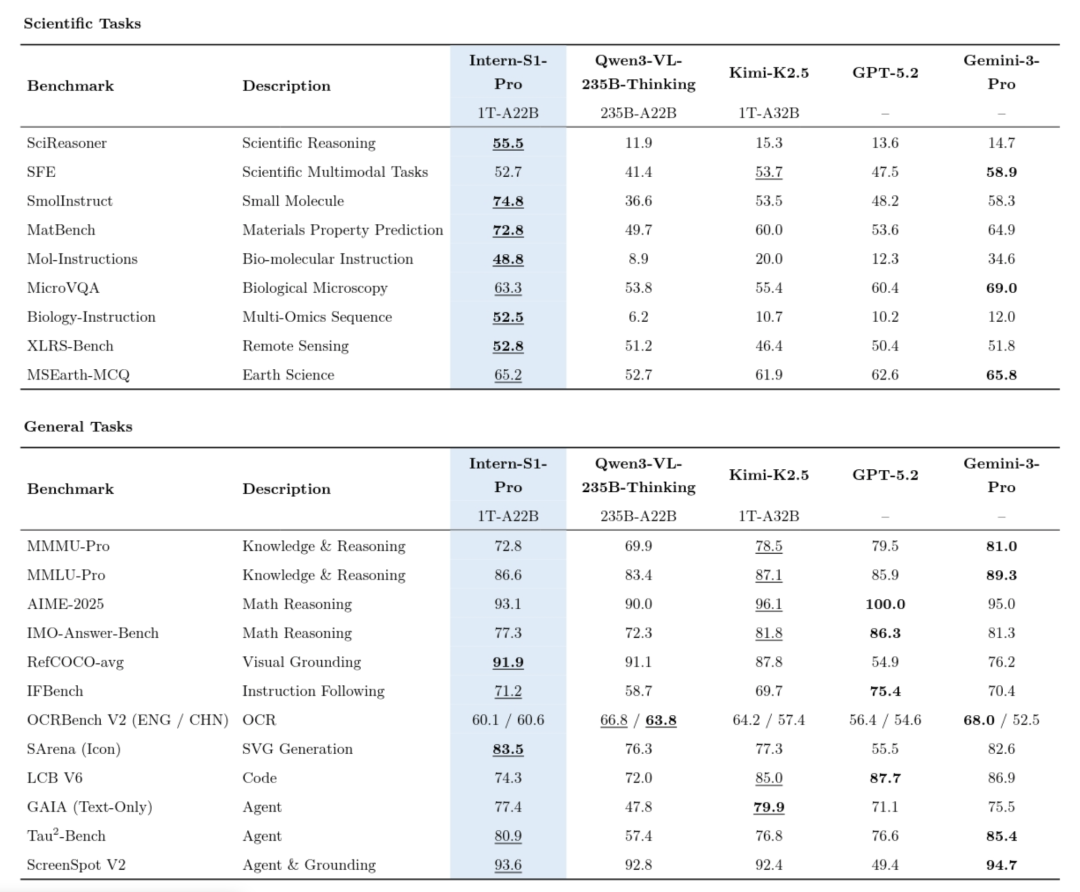

表格说明:下划线表示在开源模型中取得最优,加粗表示在所有模型中取得最优。

从评测结果可以看出,在科学推理(SciReasoner)、材料性质预测(MatBench)、生物分子指令(Mol-Instructions)等核心科学任务上,Intern-S1-Pro 的表现极具竞争力。同时,在MMLU-Pro、AIME-2025数学推理等通用能力基准上,它也展现出不俗的实力,证明了其“专精”与“广博”的平衡。

模力方舟持续构建国产AI4S平台能力

AI4S,即人工智能驱动科学研究,被认为是继实验、理论、计算、数据密集型之后的“第五科研范式”。它通过融合前沿AI算法与大规模计算能力,能够在药物发现、新材料设计、气候模拟等科研领域显著提升效率、降低试错成本。

模力方舟正致力于构建面向AI4S的国产模型基础设施。除了此次上线的 Intern-S1-Pro,平台此前已经汇集了如Lingshu-32B医疗大模型、DianJin金融大模型等一批具备强大垂直领域能力的 开源大模型。通过与沐曦、燧原、昇腾等国产算力厂商的深度适配,模力方舟旨在打造一个可自由扩展、开源开放、软硬协同的一站式科研AI平台。

随着像 Intern-S1-Pro 这样顶尖科学模型的加入,国内的开发者和科研团队将能获得更强大、更易用的工具,共同推动AI for Science这一前沿领域的快速发展。 |