今年的AI春节档,阿里巴巴通义千问没有缺席。他们正式开源了新一代大模型 Qwen3.5-Plus,发布即在多项基准测试中名列前茅,堪称实力最强的开源“源神”。

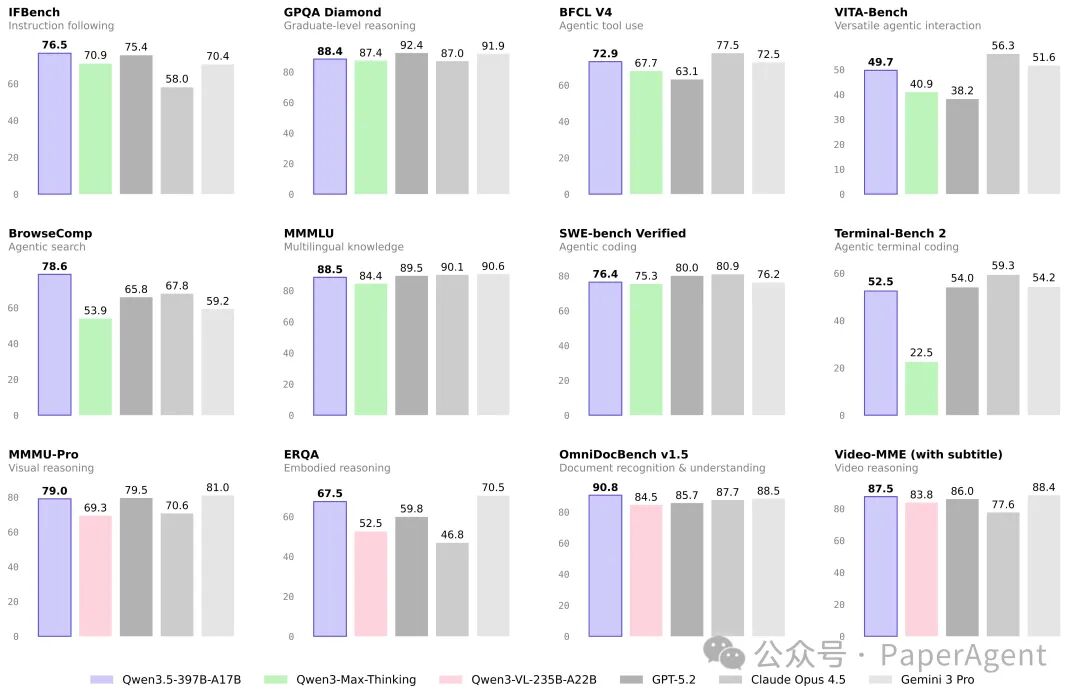

看到其性能数据时,确实让人感到惊讶——总参数量高达397B,但在推理时仅有17B参数被激活。在涵盖多模态、Agent等领域的多项关键评测中,其表现已可媲美甚至超越了 GPT-5.2 和 Gemini-3-Pro,硬核实力毋庸置疑。

更关键的是,这是一个真正意义上的原生多模态开源模型,并非简单拼接的产物。

01 原生多模态,而非简单拼接

要理解Qwen3.5-Plus的突破,需要先回顾多模态模型的发展历程。

过去很长一段时间里,所谓的多模态模型,大多采用“文本模型+视觉适配器(Adapter)”的缝合方案。模型先在数十万亿的纯文本语料上进行预训练,将语言能力打磨成熟,然后再引入大量图文对数据,训练一个专门的视觉模块,负责将图像转换为Token序列,强行“喂”给已经定型的文本模型去理解。

这种做法存在一个根本性缺陷:当模型“睁开”眼睛学习视觉时,其底层的语言“大脑”结构和思维方式已经固化。因此,这类模型在处理复杂图表、理解视频中动态的人物关系或空间位置转换等需要深度时序推理的任务时,往往表现不佳。

Qwen3.5-Plus则完全不同。它是从零开始,直接在海量混合模态Token上进行联合训练的。文本、图像、视频的原始数据被打散后混合输入,让模型在学习语法规则的同时,也在同步学习像素间的逻辑关联与时序关系。

这意味着什么?意味着当它看到一张厨房的照片时,无需先将场景元素转化为“灶台、水槽、冰箱”等文本标签再进行推理。它可以直接在视觉层面理解灶台与水槽的相对位置,并据此判断厨房的动线设计是否合理。这种深度的空间理解和融合推理能力,是外挂视觉模块所难以企及的。

02 门控注意力:获AI顶会认可的核心技术

支撑这一能力突破的,是团队扎实的研究工作。通义千问团队去年有一篇关于注意力机制的论文获得了NeurIPS 2025的最佳论文奖。

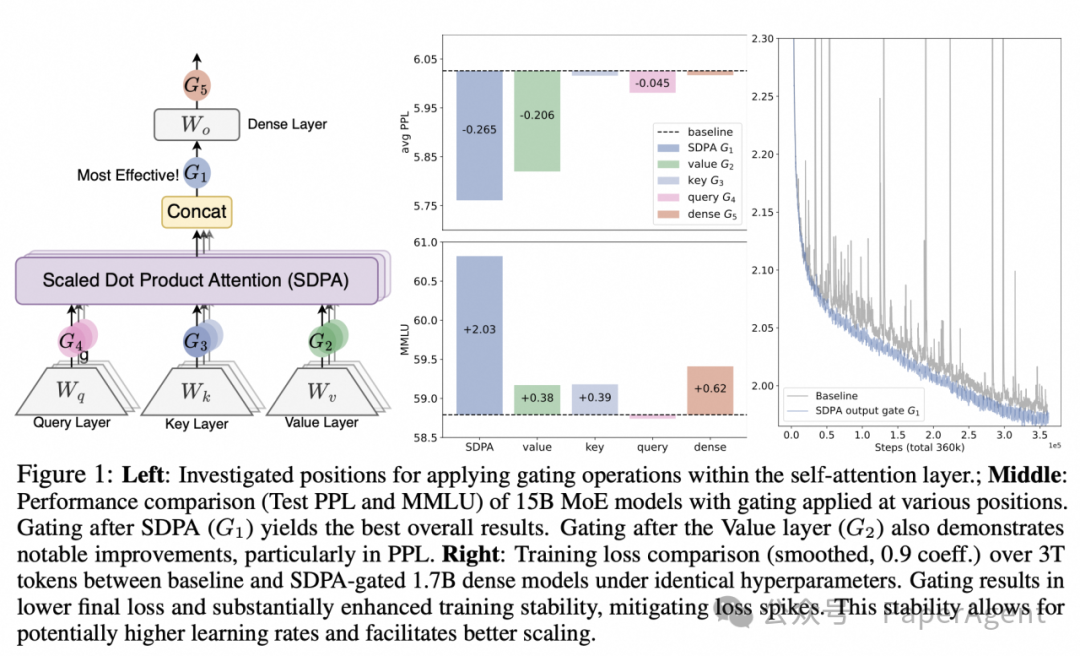

该研究探讨了一个精妙的细节:在标准的注意力机制中引入门控(Gating)操作,究竟能带来哪些收益? 这项研究成果的核心思想,现已集成到Qwen3.5-Plus模型中。

研究团队发现,在自注意力(Self-Attention)层的输出之后,为每个注意力头(Head)添加一个独立的Sigmoid门控函数,能带来显著的效果提升。

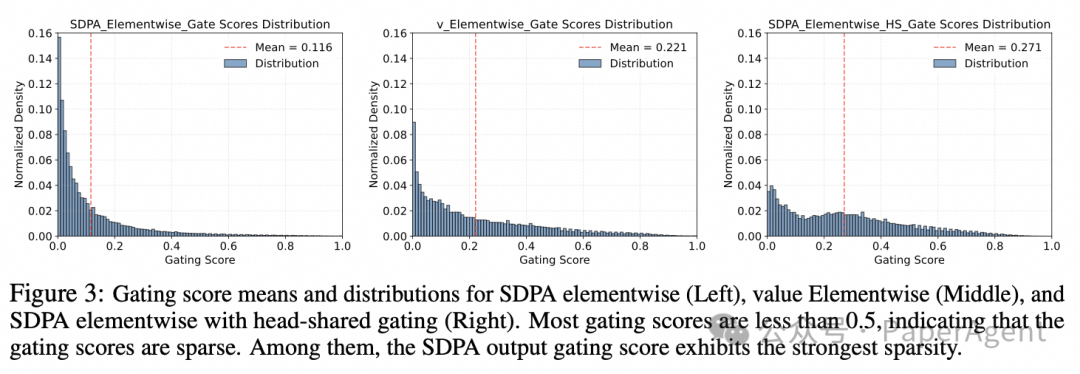

其优势主要体现在引入了稀疏性。实验数据显示,门控分数的平均值仅为0.116左右,这意味着大部分信息流被有选择性地过滤了。这看似会造成信息损失,实则恰恰相反——它过滤掉的是对于当前正在处理的Token而言无关紧要的上下文噪声。

简单来说,这相当于赋予了模型一种能力:在信息过载的上下文中,能够自动聚焦于与当前任务最相关的部分,而忽略无关的干扰,就像人类阅读时会自动屏蔽页面上的广告一样自然。这种机制对于提升模型输出的一致性和长上下文泛化能力至关重要,是当前人工智能领域的前沿探索方向。

03 稀疏激活的极致:3970亿参数,仅激活170亿

当前大模型的竞争格局已经表明:参数总量并非决定性因素,实际被激活参与计算的参数数量才直接关系到推理成本。

Qwen3.5-Plus模型拥有3970亿的总参数,但在处理每个输入时,仅有约170亿参数被激活。这意味着,仅用不到二十分之一的参数量进行工作,其整体性能却足以超越某些万亿参数级别的模型(如Qwen3-Max)。

这一卓越的效率背后,是混合专家(MoE)架构与前述门控机制协同作用的结果。线性注意力、稀疏MoE路由,再加上门控带来的激活稀疏性,将计算效率推向了新的极致。

尤为关键的是,这种效率优势是在原生多模态训练框架下实现的。团队通过解耦视觉组件与语言组件的并行计算策略,利用稀疏激活实现了跨模态计算的深度重叠。最终结果是:即使在混合了图像、视频、文本数据的复杂训练中,训练吞吐量与纯文本训练几乎持平。同时,通过精心设计的FP8/FP32混合精度策略,激活内存占用减少了约50%,训练速度提升了10%。

这些技术细节标志着原生多模态训练的技术路线已被Qwen3.5-Plus团队实质性打通,并且展现出比传统“拼接”模式更强大的潜力和更优的性价比。

04 视觉能力的代际跃迁

谈完底层架构,再看实际效果。Qwen3.5-Plus在MathVison、RealWorldQA、CC_OCR、RefCOCO、MLVU等一系列权威视觉与多模态评测中,均取得了第一名的成绩。

这种领先并非微弱的分数优势,而是在多个任务上建立了明显的性能代差。

例如在空间定位推理任务中,给定一张房间照片,询问沙发与茶几之间的距离。模型不仅需要识别出“沙发”和“茶几”这两个物体,还必须理解它们在二维乃至三维空间中的相对位置关系。这在以往的视觉-语言模型中是一项极具挑战性的任务。

再比如视觉引导的代码生成,给出一张手绘的UI界面草图,要求模型直接生成可用的前端代码。传统的流程需要经过“识别草图元素 -> 理解布局结构 -> 转换为代码”多个分立步骤,任何环节出错都会导致失败。而Qwen3.5-Plus得益于视觉与代码能力的原生融合,可以实现更端到端、更鲁棒的转换。

其长视频理解能力同样突出。直接将一部2小时的电影输入模型,要求其总结剧情主线、分析人物关系演变。这种长时序、高复杂度的视觉推理任务,对模型的上下文窗口容量和时序建模能力提出了极高要求。Qwen3.5-Plus支持高达1M Token的上下文长度,恰好为此类应用提供了可能。

05 Agent能力的规模化验证

任何先进技术,最终价值都需要在真实场景中检验。落地才是硬道理。

今年春节期间,通义千问APP上的AI Agent功能被调用超过41亿次,完成了1.2亿笔订单。用户通过AI Agent点奶茶、购置年货、预订电影票,将操作完全交由AI代理执行。

这堪称全球首次在真实、超大规模场景中对AI Agent可行性的成功验证。而Qwen3.5-Plus的Agent能力在此基础上更进一步,在BFCL-V4通用Agent评测、Browsecomp搜索Agent评测中,全面超越了Gemini-3-Pro。

强大的Agent能力背后,是一套可扩展的异步强化学习框架的支撑,该框架支持对400B到万亿参数级别的模型进行纯文本、多模态及多轮交互训练。同时,FP8精度推理带来了3到5倍的端到端加速,基于插件体系的Agent脚手架则能支持扩展到百万量级的复杂任务。

06 高性价比:性能与成本的双重优势

除了性能强劲,Qwen3.5-Plus在成本上也极具竞争力。其API服务的定价为每百万Token输入仅需0.8元,这个价格大约是Gemini-3-Pro的1/18。

如此有竞争力的价格,并非依靠巨额补贴或牺牲性能换取,而是源于其底层技术架构的创新所带来的极致效率。

最重要的是,通义千问团队选择将这套“既强大又实惠”的模型完全开源。据统计,从2023年至今,阿里已累计开源超过400个各类模型,全球下载量突破10亿次,基于其衍生的模型超过20万个。这些数字的背后,是一个日益繁荣的开源实战生态,让全球开发者能够基于顶尖技术进行二次创新,而不仅仅是仰望闭源API的高墙。

当一些厂商仍在通过闭源构筑壁垒、通过高昂费用获取利润时,通义千问选择了另一条路:拆掉高墙,将成本压至极致,然后将最前沿的成果交到每一位开发者和研究者手中。这并非简单的技术炫耀,而是在为整个人工智能行业铺设前进的道路。

07 总结

笔者认为,开源模型最大的价值,不仅在于让普通用户能够免费或低成本地使用AI,更在于让全球的开发者和研究人员有机会窥见顶尖模型的设计精髓与实现细节。

此次Qwen3.5-Plus的开源,包含了门控注意力机制、混合专家架构、原生多模态训练等一整套先进技术方案。这才是开源精神应有的样子——分享智慧,共同进步。

据悉,接下来的Qwen3.5-Max模型将会更加强大。不过,那是未来的故事。现在,功能强悍的Qwen3.5-Plus模型已经开放下载,等待全球技术社区在云栈社区这样的平台上探索、验证并创造新的价值。