在成为 OpenRouter 上 OpenClaw 调用量最高的模型之后,Kimi 选择亲自下场。2026年2月18日,Kimi 宣布推出 Kimi Claw——一个可以在云端一键部署的 OpenClaw。这意味着,我们或许正在见证模型厂商直接介入 Agent 产品化的开端。

Kimi Claw 主要解决了哪些问题?它默认配置了 Kimi K2.5 模型和联网搜索服务,用户可以无缝调用 ClawHub 上的数千个技能插件,并拥有 40GB 的云存储空间。更重要的是,用户无需再操心服务器、模型选择或复杂的 bot 配置,可以直接在浏览器或飞书机器人中调用其能力。

2026年的春节,整个 Agent 赛道几乎都在围绕 OpenClaw 做文章。有人重写代码以提升安全性,有人打包简化部署流程,有人提供云端托管服务。所有人都看到了同一个机会:OpenClaw 证明了主动式 AI 助手的可行性,但市场上仍缺乏一个面向大众、能显著降低使用门槛的产品。

那么,在众多尝试中,由模型厂商亲自推出的 Kimi Claw,究竟有何不同?

OpenClaw 的核心门槛与“千军万马”的解决方案

OpenClaw 留下的核心问题非常明确:门槛太高。对于非开发者来说,体验过程堪称复杂:准备服务器、安装依赖、配置环境、选择并配置模型 API、设置联网搜索,如果想集成到飞书等办公应用,还需处理 OAuth 和 Webhook。即便有详尽的教程,整个过程也极易在某个环节卡壳。

安全性则是另一个不容忽视的挑战。OpenClaw 默认在宿主机上运行工具,拥有完整的文件访问权限。研究显示,ClawHub 上约 11.3% 的第三方技能存在潜在风险,大量网关暴露在公网,甚至出现了专门窃取 OpenClaw 凭据的恶意软件。Gartner 曾直接将其评为“不可接受的网络安全风险”。

面对这个“可行但难用”的缺口,市场给出了热烈回应。仅2026年1月底到2月中旬,就涌现出至少十几个“OpenClaw-like”产品,从不同角度试图解决同一组问题。

- 安全派:如 ZeroClaw 用 Rust 重写,主打默认安全策略;NanoClaw 采用容器隔离技术;TrustClaw 提供 OAuth 托管和远程沙箱执行的云服务。

- 极简派:如香港大学团队的 nanobot,仅用 4000 行核心代码复刻主要能力;memU Bot 提供下载即用的桌面客户端。

- 大厂派:Anthropic 推出了 Claude Cowork,OpenAI 发布了 Codex App,各大云厂商也纷纷推出了一键安装的 OpenClaw 云主机镜像。

然而,这些方案似乎都未能完美解决问题。安全方案往往配置依旧复杂;极简方案在功能完整性和渠道覆盖上有所欠缺;桌面客户端降低了入口门槛,但底层的 API 和模型选择仍是障碍;大厂产品则价格不菲,且多聚焦于开发者场景。

此时,模型厂商的思路开始显现其独特性。事实上,很多用户已经用行动做出了选择——Kimi K2.5 在 OpenRouter 上长期是 OpenClaw 场景下 token 消耗量最高的模型。这意味着 Kimi 与 OpenClaw 的核心用户群体已建立起天然联系。

模型能力也得到了顶尖开发者的认可。编程界传奇人物 DHH(Ruby on Rails 之父)公开表示:

“Kimi 只花了 21 秒就修好了 bug,而 Claude 花了 2 分钟。Kimi 已经成为了我编程的核心驱动力。”

PyTorch 核心开发者 Soumith Chintala 也对 Kimi 推出 KimiClaw 的速度表示赞叹。

当模型能力已被核心用户验证,产品化就成了顺理成章的下一步。Kimi Claw 的逻辑正是将 OpenClaw 的能力完整迁移至云端,让使用 Agent 的门槛无限接近于零:无需服务器、无需安装、无需配置,打开网页即可使用。

Kimi Claw 的差异化体验:开箱即用与长期记忆

“开箱即用”究竟意味着什么?我们可以对比一个典型场景:部署一个“每日汇总行业新闻”的 AI 助手。

- 原版 OpenClaw:租服务器、安装依赖、配置模型 API、设置搜索服务、定义人设、手动安装 RSS 技能、配置定时任务、对接飞书 Webhook……耗时可能长达半天。

- Kimi Claw:打开网页,用一句话描述需求。整个过程可能只需 30 秒。

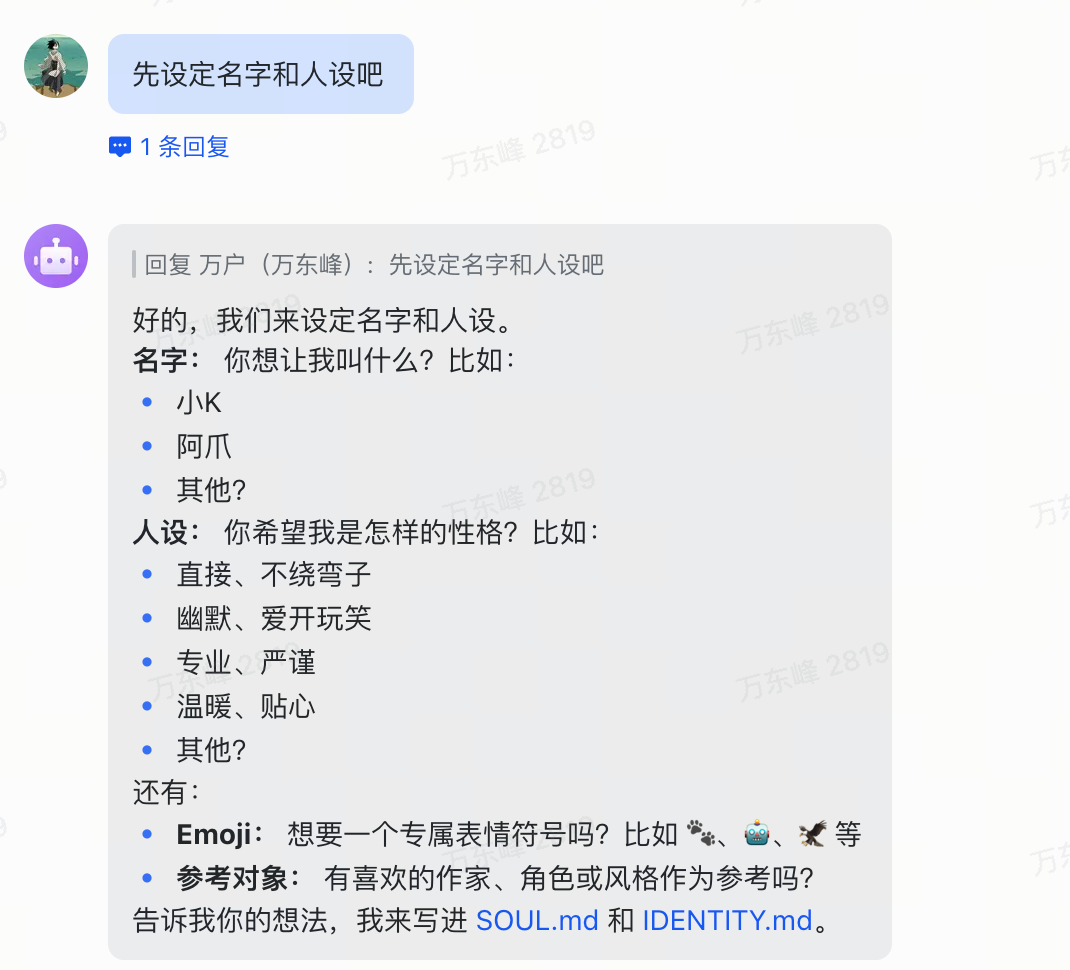

这种体验的差异是根本性的。Kimi Claw 并非另一个问答工具,而是一个性格、工作方式均可塑造的长期 AI 助手。其设计核心是“由你来定义它是谁”。

你可以从三个维度定制它的人设:名字与身份、说话风格、固定的输出格式。更重要的是,它会记住这些设定。例如,你可以训练它:“以后做市场信息汇总时,先筛选权威来源,再按‘机会/风险/数据’三个维度输出,最后给一个行动建议。” 一旦设定,它就会在后续任务中持续遵循这套标准。

这相当于将你的经验和方法论“固化”到助手的行为中。强烈推荐配置其飞书机器人,一个能随时在办公场景中调用、并能拉入群聊的助手,其体验往往比网页端对话更加无缝。

无感调用技能与主动任务执行

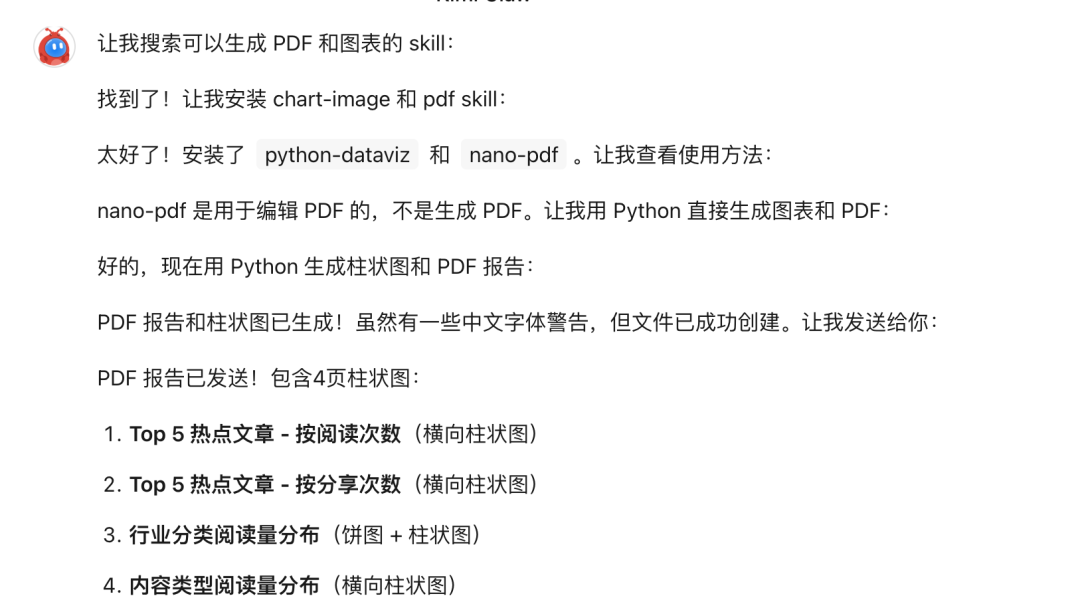

手动寻找、评估和安装 Skill 是使用 OpenClaw 的另一大痛点。Kimi Claw 通过接入 ClawHub 技能库(目前有5000+社区技能)来解决这个问题。当需要完成复杂任务时,你可以直接让它“寻找并调用高质量的相关 Skill”。

例如,一句话指令:“分析我刚上传的 CSV 文件,找出 Top 5 增长品类,生成柱状图和洞见,并输出 PDF 报告存到云端。” 系统会自动串联 CSV 解析、数据分析、图表生成、PDF 导出和云端存储等多个技能,一气呵成。

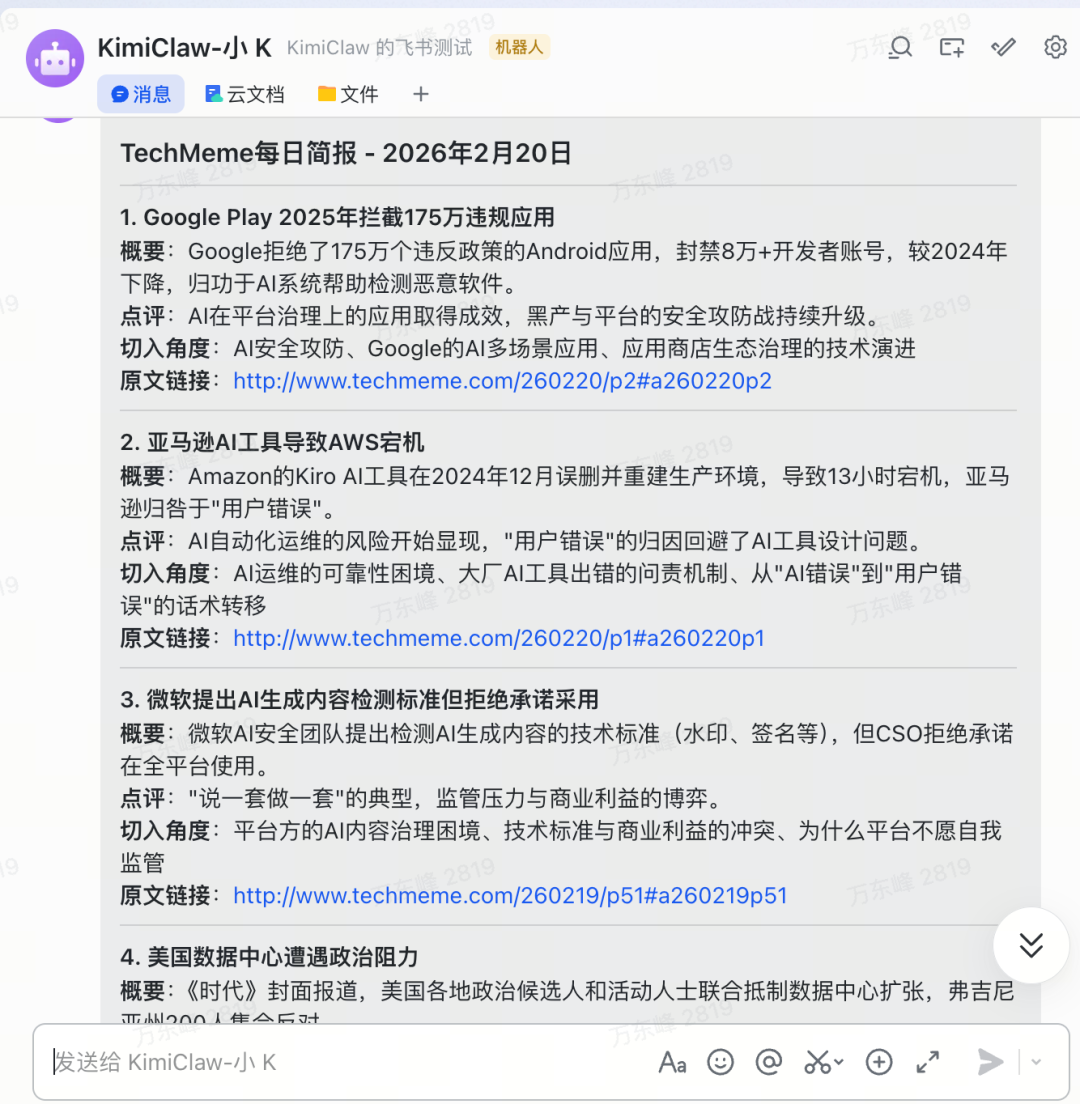

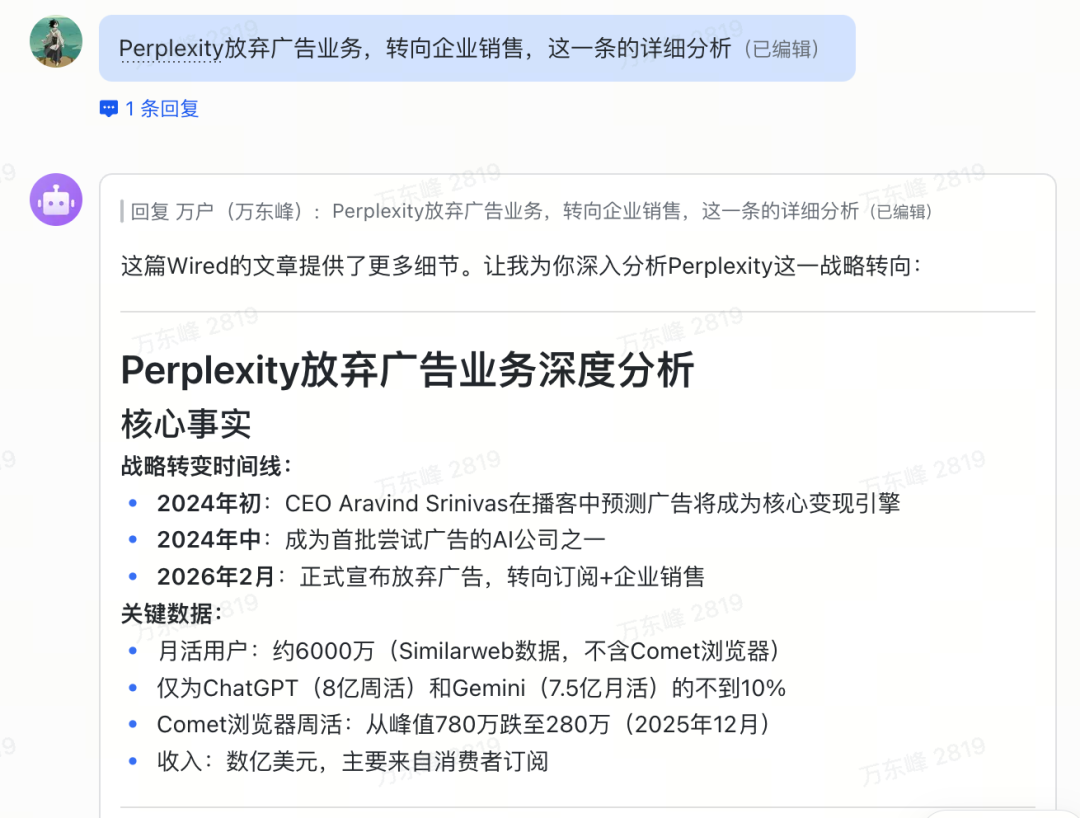

另一个场景:“基于 Techmeme 今日热点,结合我设定的‘媒体编辑’人设,生成文章大纲和切入角度。” 系统便会自动调用 RSS 订阅、网页信息提取、搜索及文本生成等技能。

此外,Kimi Claw 支持 7x24 小时的定时任务。你可以使用“在【时间】执行【任务】,输出【格式】,并遵守【约束】”的万能句式来创建计划。当人设、技能库和定时任务三者结合时,它就演变成一个能够“按照你的标准自动干活”的智能助手。

例如,设定它每天上午自动汇总行业热点,并依据你预设的“选题评估框架”进行筛选和推送。随着时间推移和你的持续反馈,这个助手会越来越懂你。

云端Agent的优势与被低估的潜力

当前 Agent 赛道已分化为两条路径:

- 本地派:如 OpenClaw 本地部署及各类开源替代方案。优势是能力上限高、数据隐私可控,适合技术能力强、有高定制化需求的用户。

- 云端派:如 Kimi Claw 这类由模型厂商直接提供的服务。

模型厂商做云端 Agent,拥有一些本地方案难以复制的结构性优势:

- 模型集成无缝:自动配置自家最新模型,用户无需关心选型、API 和版本切换。

- 基础设施一体:搜索、存储、技能生态可一站式打通,省去用户拼凑组件的复杂度。

- 用户规模飞轮:大量用户能快速丰富技能生态,使用数据可直接反哺模型与产品优化。

- 零门槛带来高频率:“打开即用”极大地提升了用户的使用意愿和频率,这对于 Agent 的实用价值至关重要。

目前,云端 Agent 的主要短板在于无法直接操作本地文件。但这本质上是一个工程问题,而非架构死结。一旦实现本地文件夹与云端存储(如 Kimi Claw 的 40GB 空间)的自动同步,云端 Agent 便能间接触达所有本地文件,从而大幅缩小与本地方案的能力差距。

可以预见,模型厂商亲自下场做 C 端 Agent 产品,可能是推动 Agent 走向大众的关键力量。当然,Kimi Claw 作为新产品仍有局限,例如文件同步功能尚未实现、部分 ClawHub 技能仍在适配、目前优先面向高阶会员开放等。

但它的核心差异化在于,这是目前少有的“模型层 + 产品层 + 基础设施层”一体化方案。这种整合意味着其迭代速度和体验优化的天花板可能更高。

OpenClaw 证明了“主动式 AI 助手”可行,而 Kimi Claw 正在尝试证明,这种能力可以属于每一个人。门已经打开,接下来的竞争,将集中在谁能把这条路铺得足够平整、足够宽阔。

本文由技术社区 云栈社区 进行内容优化,旨在分享前沿技术动态与深度分析。