就在前几天,阿里在除夕夜向技术圈投下了一颗重磅炸弹:千问 3.5 正式发布并开源,版本号为 Qwen3.5-397B-A17B。

当所有人的注意力都集中在春晚和抢红包时,这个毫无预热、直接上线的发布,却甩出了一套让整个行业震动的组合拳。

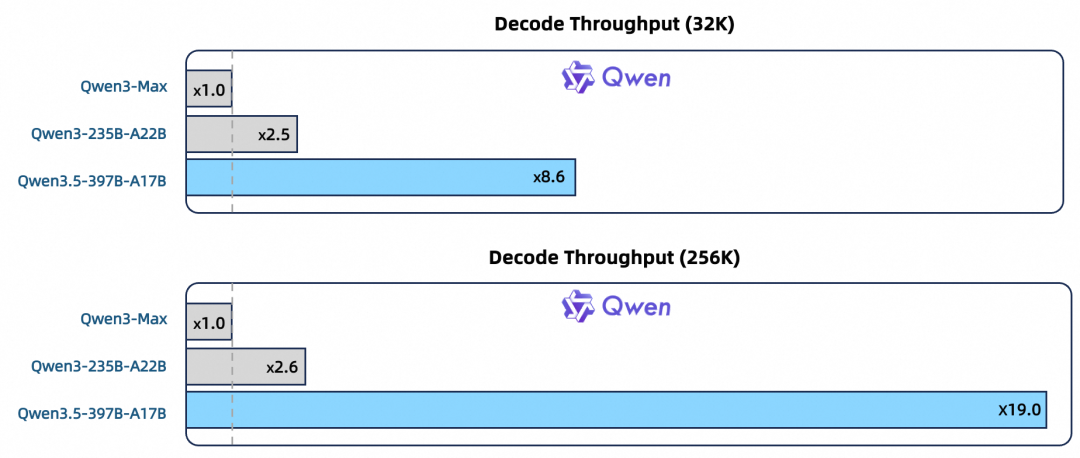

最直观的冲击来自其效率与成本的颠覆。千问 3.5 总参数量高达 3970 亿,但采用创新的激活策略,每次推理仅激活 170 亿参数。这种“四两拨千斤”的设计,使其性能超越了自家万亿参数的 Qwen3-Max,同时将部署时的显存占用降低了惊人的 60%。更夸张的是其推理效率,在特定场景下,最大吞吐量提升了 19 倍。这意味着,以前需要昂贵计算集群才能运行的大模型,现在在普通服务器上就能轻松部署,为中小企业和个人开发者大幅降低了技术门槛。

0.8元,一杯奶茶的顶级AI体验

如果说性能提升是技术实力的体现,那么定价策略就是面向市场的“价格屠夫”。千问 3.5 的 API 定价堪称“白菜价”:输入每百万 token 仅需 0.8 元,输出价格在 2 到 4.8 元之间。

我们可以做一个直观的对比:

- GPT-5.2:约 12.7 元/百万 token

- Gemini 3 Pro:约 14.4 元/百万 token

- Claude Opus 4.5:约 9.6 元/百万 token

- 千问 3.5:0.8 元/百万 token

千问 3.5 的输入价格仅为 GPT-5.2 的 1/15,Gemini 3 Pro 的 1/18。有网友形象地称之为“价格蜜雪冰城”——一杯奶茶的钱,就能调用百万 token 级别的顶级大模型能力。

对于普通用户,可以直接在千问 App 和 PC 端免费体验。对于开发者,模型以 Apache 2.0 协议完全开源,在魔搭社区和 HuggingFace 均可下载,商用无需申请,没有任何隐藏门槛。这种彻底的开源和极致的性价比,无疑将加速 人工智能 应用的普及和创新。

原生多模态:从“配眼镜”到“天生视力”

与前几代模型不同,千问 3.5 实现了从纯文本模型到原生多模态模型的本质跃迁。过去的视觉理解能力,通常是外挂一个视觉编码器,类似于给文本模型“配了一副眼镜”。而千问 3.5 在预训练阶段就将视觉、文本等多模态信息混合学习,相当于模型从“出生”就“睁着眼睛”认识世界。

这种原生设计带来了几个非常实用的能力:

- 能看能读:可以直接理解图文混排的 PDF 文档,无需经过传统复杂的多模态 RAG 流程。甚至能通过一张界面截图,定位并指导修复 UI 问题。

- 能看视频:支持高达 100 万 token 的上下文长度,能直接处理长达 2 小时的视频内容。看一部电影,它可以帮你梳理剧情、分析人物关系、总结视觉风格。

- 能画能写:已有博主实测,仅需提供一个粗糙的网页界面草图,千问 3.5 就能在数分钟内将其转化为可直接运行的网页代码,并自动匹配高质量的图片素材。这种“从草图到产品”的能力,不仅是识别图形元素,更能推断设计意图,理解模块功能。

基准测试表现如何?

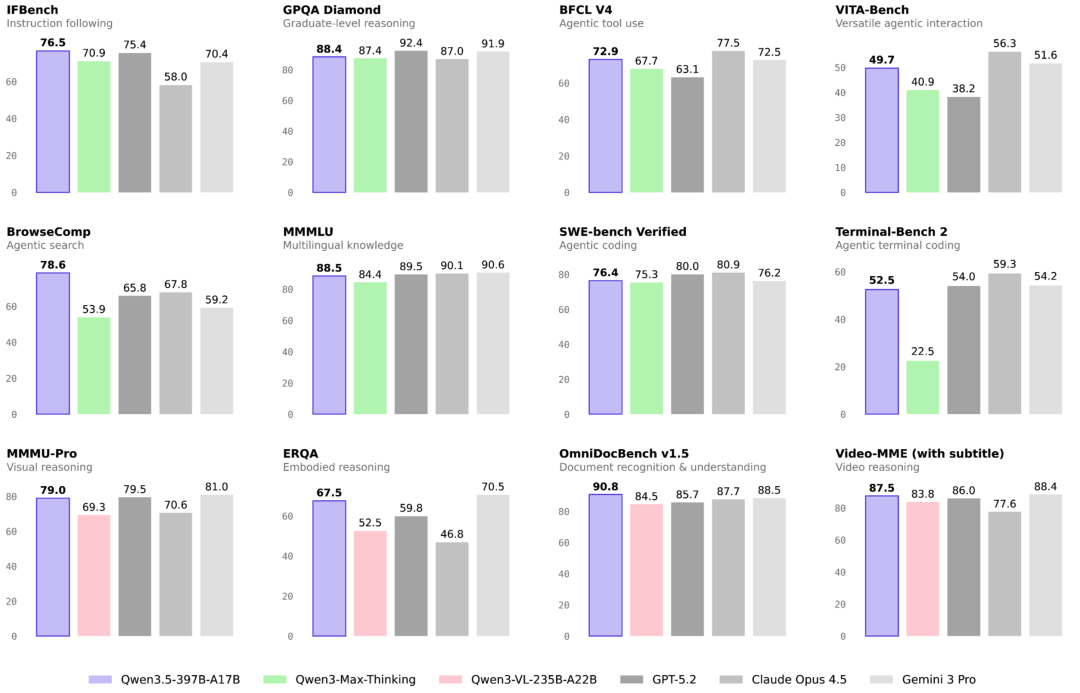

在各项权威基准测试中,千问 3.5 展现出了强大的综合实力:

- MMLU-Pro 知识推理:87.8 分,超越 GPT-5.2

- GPQA 博士级难题:88.4 分,高于 Claude 4.5

- IFBench 指令遵循:76.5 分,刷新所有模型纪录

- BFCL-V4 通用 Agent:超越 Gemini 3 Pro、GPT-5.2

- BrowseComp 搜索 Agent:同样处于领先地位

在视觉理解专项上,如 MathVison 多模态推理、RealWorldQA 通用视觉问答、CC_OCR 文本识别、MLVU 视频理解等评测中,千问 3.5 均取得了最佳性能。当然,它并非全能,在编程专项上与最新的 GPT-5.3-Codex、Claude Opus 4.6 相比,仍有约 10% 的差距。但综合来看,它无疑是当前国内综合能力最强的开源大模型之一。

性能跃升背后的技术突破

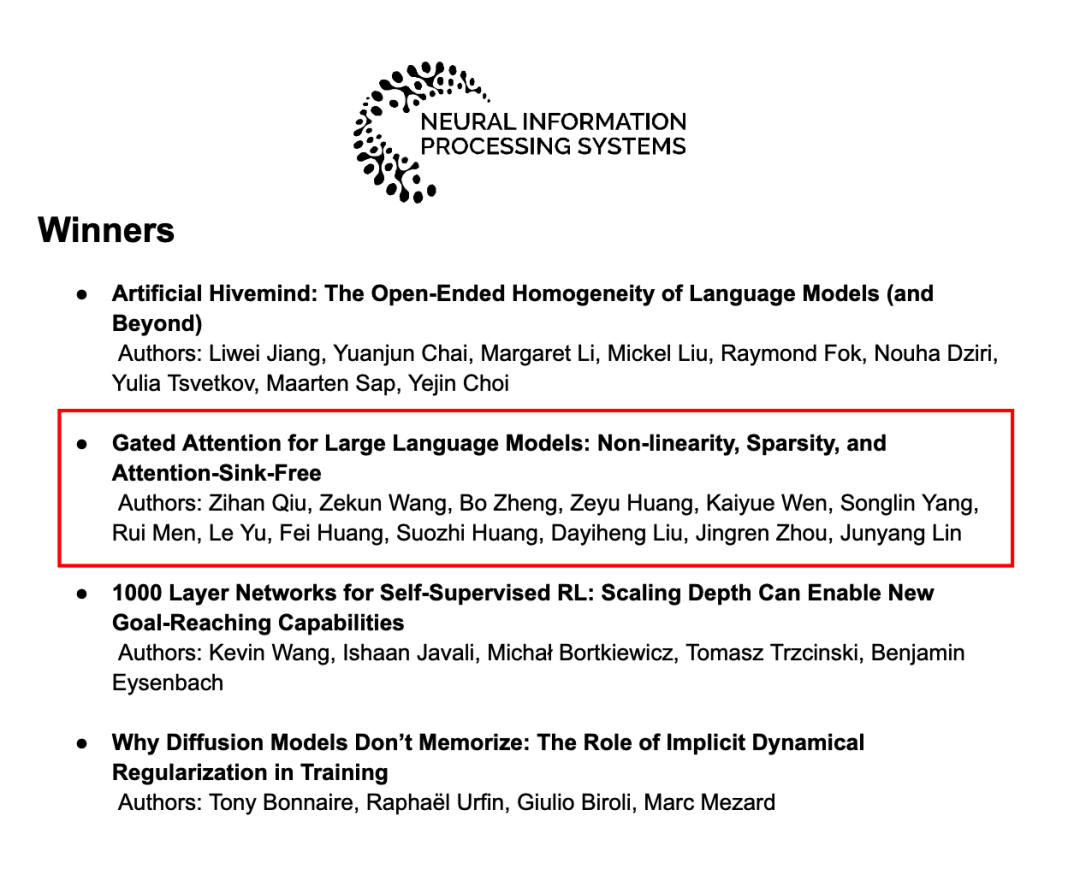

千问 3.5 的性能飞跃,根植于对经典 Transformer 架构的重大创新。其核心是千问团队自研的“门控注意力”技术,这项研究曾荣获 2025 年 NeurIPS 最佳论文奖。

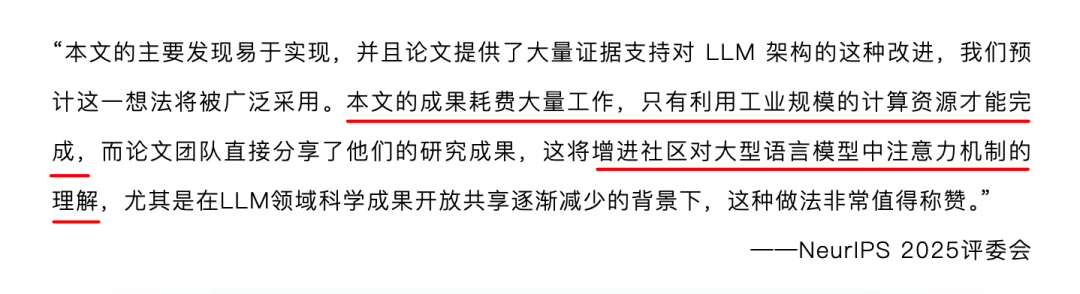

这项技术已深度融入千问 3.5 的混合架构中,结合了线性注意力机制与稀疏混合专家模型。NeurIPS 评委会对此给予了高度评价:

简而言之,这项创新是实现“3970亿总参数,仅激活170亿”这一极致效率的关键。在实际应用中,在常见的 32K 上下文场景下,推理吞吐量提升了 8.6 倍;而在 256K 超长上下文场景下,最大提升可达 19 倍。

此外,千问 3.5 的词表从 15 万扩展至 25 万,支持 201 种语言,对小语种的编码效率最高提升了 60%。这大大降低了全球更多地区开发者使用顶尖大模型的技术门槛。

如何获取与使用?

千问 3.5 在发布当天就已接入官方 App 和 PC 端,普通用户可立即免费体验。

对于开发者,可以通过以下途径获取:

- 开源模型:前往魔搭社区或 HuggingFace 下载。

- API服务:通过阿里云百炼平台获取便捷的API调用服务。

值得一提的是,千问团队此前发布的 AI 购物 Agent 已在真实场景中得到大规模验证。在今年春节期间,该 Agent 在 6 天内帮助用户完成了 1.2 亿笔订单。数据显示,其日活跃用户已逼近行业头部产品,且近一半订单来自县域市场,有近 400 万 60 岁以上用户体验了 AI 点单服务。这标志着 AI 正从科技圈走向全民,成为真正可用的生活助手。

总结与展望

千问 3.5 的发布,打破了“参数越大越好”的刻板印象。它用不到 40% 的激活参数量,实现了超越万亿参数模型的综合效果,这充分证明在 智能 & 数据 & 云 时代,架构创新与工程优化远比单纯堆砌参数更为重要。

对于广大开发者和企业而言,这意味着更低的部署成本和更高的使用效率。虽然豆包、DeepSeek、GLM、MiniMax 等竞争对手的新版本也即将登场,行业竞争将愈发激烈,但无论如何,0.8元/百万token的顶级模型体验,对开发者社区而言是实实在在的福利。用更少的成本,唤醒更强的智能,这或许将开启大模型应用的新篇章。

技术的发展日新月异,开源社区的活力是创新的源泉。你对这次千问 3.5 的发布怎么看?欢迎在技术社区参与讨论,例如在 云栈社区 的开发者板块分享你的见解或应用实践。