如果用一个词描述当前的AI浪潮,那可能是“大而全”。动辄千亿参数的大模型,如同知识渊博的“通才”,上可谈哲学,下可解数学题。

但当我们真的将它们引入具体业务时,问题就显现了。你可能经历过:用大模型写诗得心应手,但让它解读一份专业的技术文档,回答就变得“话多”却“不沾边”,要么漏掉关键细节,要么用通用知识搪塞专业问题。更棘手的是,这台“知识发动机”对计算资源的消耗巨大,响应慢、成本高,使得在实际业务中落地变得异常沉重。

这揭示了一个核心矛盾:通用大模型虽“大”,却未必“精”。它学习的是海量通用语料,但对特定领域(如医疗、法律、金融)的深度理解往往停留在表面。同时,其庞大的“体积”又像一台悍马,跑得快但油耗惊人。

因此,目标变得清晰:我们需要的不是一个什么都懂但什么都不精的“博学者”,而是一个既精通领域知识,又能轻装上阵、快速响应的“专家”。简言之,就是让大模型变得更“聪明”(领域专用化)和更“轻”(模型瘦身)。

第一部分:先让模型“懂”你的领域

想让模型懂你的领域,第一步就是“喂”给它正确的“食物”——领域数据。数据来源通常包括:内部文件(合同、产品手册)、行业法规、专业论文、高质量的问答对以及用户历史对话日志。

处理这些原始数据的流程至关重要:清洗(去除无关字符、格式化)、标准化(统一术语、格式)和分割(按语义段落或句子切分)是三个基础步骤,质量决定了下游任务的成败。

代码实现:数据清洗与格式化

import json

import re

from pathlib import Path

def clean_text(text):

"""清洗冗余字符、空格和格式。"""

text = re.sub(r'\r\n', '\n', text) # 统一换行符

text = re.sub(r'[\u200b-\u200f\u202a-\u202e]', '', text) # 删除零宽字符

text = re.sub(r'\s+', ' ', text).strip() # 合并多余空格

return text

def split_by_semantic(text, max_len=512):

"""按句子和语义边界分割长文本。"""

sentences = re.split(r'(?<=[.!?])\s+', text)

chunks = []

current_chunk = ""

for sent in sentences:

if len(current_chunk) + len(sent) <= max_len:

current_chunk += sent + " "

else:

if current_chunk:

chunks.append(current_chunk.strip())

current_chunk = sent + " "

if current_chunk:

chunks.append(current_chunk.strip())

return chunks

# 示例:处理JSONL格式的对话日志

input_file = Path("./raw_conversations.jsonl")

output_file = Path("./cleaned_data.jsonl")

with input_file.open('r', encoding='utf-8') as fin, output_file.open('w', encoding='utf-8') as fout:

for line in fin:

record = json.loads(line)

cleaned_q = clean_text(record["question"])

cleaned_a = clean_text(record["answer"])

# 分割长答案

answer_chunks = split_by_semantic(cleaned_a)

for chunk in answer_chunks:

new_record = {

"instruction": "请根据知识库回答问题:",

"input": cleaned_q,

"output": chunk

}

fout.write(json.dumps(new_record, ensure_ascii=False) + '\n')

print(f"数据清洗完成,输出至: {output_file}")

有了高质量的“原料”,下一步是如何高效“投喂”。目前主要有三种主流方法:

- 检索增强生成(RAG):这就像给模型配了一个实时更新的专业智库。模型本身的知识体系不变,但当回答问题时,它会先去专属数据库中检索最相关的资料片段,然后结合这些“现场资料”组织答案。优势是知识更新成本低,数据隔离性好;缺点是响应会增加检索延迟。

- 指令微调:像一个经验丰富的老师,手把手教模型如何“答题”。你准备大量(领域问题,标准答案)的配对数据,通过监督学习让模型学会在专业场景下的回答模式。它能直接提升模型在该领域任务上的指令遵循能力和格式准确性。

- 持续预训练:如同给模型“补课”,让它系统地学习领域内的专业文本(如医学教科书、法律条文),从根本上改变或增强其内在知识表征。这会显著提升模型对复杂专业概念的理解深度,但所需算力和高质量语料也最大。

如何选择?

一个实用的最佳实践是采用 “分层递进”策略:

- 对于知识更新频繁、要求冷启动快、且对成本敏感的场景(如客服知识库),RAG是首选。

- 当你需要模型严格遵循特定格式、风格或流程时(如生成标准化的数据分析报告),指令微调是必选项。

- 如果核心技术壁垒依赖于深度、复杂且信息密度极高的专业知识时(如生物分子性质预测、复杂法条解释),持续预训练就值得投入。

在实践中,这三者并非互斥。采用 “预训练+微调+RAG” 的组合拳,往往是打造顶级领域专家的终极方案。

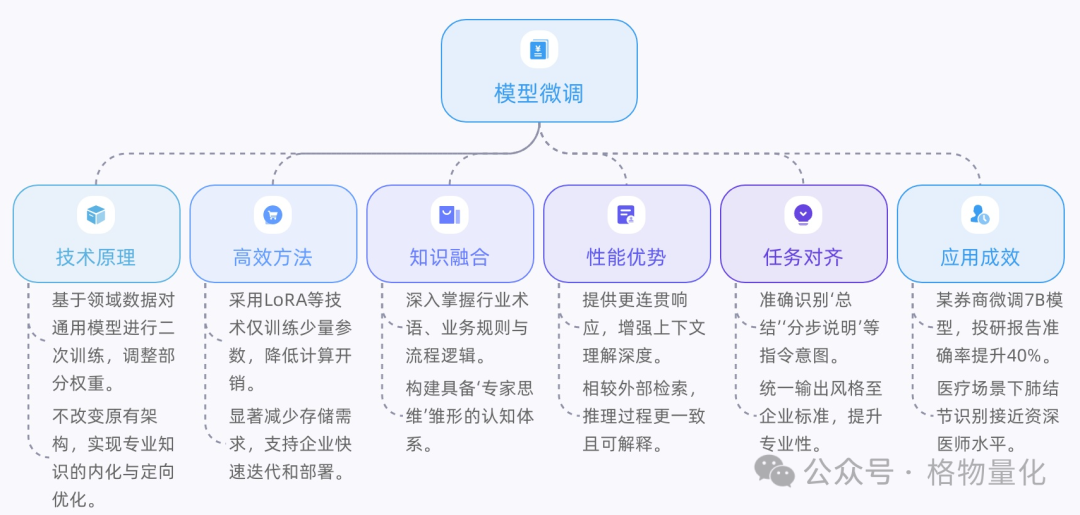

第二部分:高效的领域适配技术

一旦确定了“喂知识”的策略,下一步就是如何用最低的成本让模型高效吸收,也就是微调的落地技术。LoRA(Low-Rank Adaptation,低秩自适应)的出现,彻底改变了游戏规则。它不再要求微调模型的所有数万亿个参数,而是聪明地引入一组“小型适配器”。

原理很简单:在大型预训练模型原有的权重旁,插入一对低秩矩阵作为“补丁”。在微调时,原始庞大的权重参数被冻结锁定,只更新这两个新加入的小矩阵。训练结束后,只需保存这几个微小的“补丁”,就能实现媲美全参数微调的性能。这意味着训练成本降低成百上千倍,一个GPU几个小时就能完成,且存储和切换多个微调版本变得极其方便,就像一个模型库拥有了无数个可插拔的“专业技能卡”。

在LoRA实践中,有几个被广泛验证的“黄金法则”配置参数。其中,最重要的两个是秩r和缩放系数alpha。r决定了适配器矩阵的内在维度,越大学习能力越强但参数也越多;alpha用于控制适配器权重对原始权重的最终影响强度。一个经过千锤百炼的通用起始配置是 r=16, alpha=32。这个配置在绝大多数任务(从代码生成到文本分类)中都表现出极佳的平衡性,足以让模型学习到复杂的领域模式,又不会过度拟合导致丧失通用性,是你开启微调之旅的可靠基准线。

代码实现:LoRA微调核心Python代码

理论不如一行代码直观。假设我们要为一家医疗研究机构构建专业的问答系统,基于Llama-2-7B模型,数据集是medical_qa.jsonl。借助开源库,整个过程可以简化如下:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM, TrainingArguments

from peft import LoraConfig, get_peft_model, prepare_model_for_kbit_training

from trl import SFTTrainer

from datasets import Dataset

import json

# 1. 加载模型和分词器

model_name = "meta-llama/Llama-2-7b-hf"

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

# 设置pad token

if tokenizer.pad_token is None:

tokenizer.pad_token = tokenizer.eos_token

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=torch.float16,

device_map="auto",

trust_remote_code=True

)

# 2. 配置LoRA

peft_config = LoraConfig(

r=16, # LoRA秩

lora_alpha=32, # 缩放系数

target_modules=["q_proj", "k_proj", "v_proj", "o_proj"], # 目标模块

lora_dropout=0.1,

bias="none",

task_type="CAUSAL_LM",

)

model = get_peft_model(model, peft_config)

model.print_trainable_parameters() # 打印可训练参数量

# 3. 准备数据集 (JSONL格式 -> Dataset)

def load_jsonl_data(file_path):

data = []

with open(file_path, 'r', encoding='utf-8') as f:

for line in f:

data.append(json.loads(line))

return data

def formatting_prompts(example):

"""将instruction/input/output格式化成模型接受的prompt。"""

text = f"Instruction: {example['instruction']}\nInput: {example['input']}\nOutput: {example['output']}"

return {"text": text}

jsonl_data = load_jsonl_data("./medical_qa.jsonl")

dataset = Dataset.from_list(jsonl_data)

dataset = dataset.map(formatting_prompts)

# 4. 配置训练参数

training_args = TrainingArguments(

output_dir="./output_model",

num_train_epochs=3,

per_device_train_batch_size=4,

gradient_accumulation_steps=2,

warmup_steps=100,

logging_steps=50,

save_strategy="epoch",

evaluation_strategy="no",

learning_rate=2e-4,

fp16=True,

)

# 5. 初始化Trainer并进行训练

trainer = SFTTrainer(

model=model,

args=training_args,

train_dataset=dataset,

tokenizer=tokenizer,

max_seq_length=1024,

dataset_text_field="text",

)

trainer.train()

# 6. 保存适配器权重

model.save_pretrained("./output_model/lora_adapter")

print("LoRA微调完成,适配器权重已保存。")

在这段代码中,我们指定了基础模型、数据路径、LoRA参数(r=16, alpha=32),并选择了在Transformer结构里最关键的注意力模块(q, k, v, o投影层)上施加LoRA适配器。训练3个epoch后,你就能在./output_model目录下得到一个仅包含几十MB大小适配器权重的“专家模型”。部署时,随时可以无损地加载回原始的Llama-2-7B模型上,瞬间获得一个能理解医学术语、解析症状与药物关系的高效助手。

让大模型变得更聪明和更轻:领域专用化与模型瘦身实践指南

第三部分:模型压缩技术详解

当模型通过领域适配变得足够“聪明”后,真正的考验才开始——如何让这位“专家”快速、高效且低成本地在现实世界提供服务。模型压缩技术是关键工具,它通过剪枝和量化两大利器,为臃肿的模型精准“瘦身”。

剪枝:智能移除冗余参数

模型经过预训练和微调后,并非所有神经连接都同等重要。许多权重值趋近于零,它们对最终输出的贡献微乎其微,却一样消耗着计算和存储资源。剪枝技术的核心思想,就是系统性地识别并移除这些“冗余”神经元或连接,从而得到一个更稀疏、更高效的网络架构。

想象一下修剪一棵果树。剪枝不是随意砍掉枝条,而是基于算法判断哪些枝条结果能力最差。

- 结构化剪枝:倾向于整块移除注意力头或隐藏维度,就像砍掉一整根枯枝,能直接在硬件层面提升并行效率。

- 非结构化剪枝:粒度更精细,逐个剪除网络中接近于零的参数权重,能获得更高的理论压缩率。

关键在于,剪枝通常需要伴随一轮“稀疏训练”,好比果树修剪后进行养分重分配,让小规模的模型在剪枝后“复盘”学习,恢复甚至提升原有性能。

量化:精度与速度的平衡艺术

如果说剪枝是在减少连接数量,那么量化就是在降低每个连接(权重)的表达精度。原始模型训练通常使用32位浮点数(FP32)甚至16位(FP16),占据了大量内存带宽且计算耗时。量化技术将这高精度的浮点数转换成低精度的定点数——例如常见的INT8乃至INT4。

- 量化感知训练:会在训练过程中引入模拟量化的噪声,让模型提前适应低精度计算的环境。

- 训练后量化:则更为轻便,直接对训练好的模型进行校准和转换,几乎不增加额外训练成本。

从FP16到INT8,模型内存占用直接减半,推理速度通常提升1.5到2倍,而绝大部分任务的精度损失几乎可以忽略不计。更进一步,INT4量化甚至能将模型压缩至原大小的四分之一,这对于部署到移动端或边缘设备是革命性的,尽管可能牺牲更多精度或需要更精细的校准。

代码实现:剪枝与量化实践

import torch

import torch.nn.utils.prune as prune

from transformers import AutoModelForCausalLM, AutoTokenizer

# 1. 训练后剪枝示例(非结构化L1范数剪枝)

model = AutoModelForCausalLM.from_pretrained("./output_model/base")

parameters_to_prune = []

for name, module in model.named_modules():

if isinstance(module, torch.nn.Linear):

parameters_to_prune.append((module, 'weight'))

# 应用全局L1剪枝,稀疏度20%

prune.global_unstructured(

parameters_to_prune,

pruning_method=prune.L1Unstructured,

amount=0.2,

)

# 永久性移除剪枝掩码,实现结构稀疏化

for module, param_name in parameters_to_prune:

prune.remove(module, param_name)

# 保存剪枝后模型

model.save_pretrained("./output_model/pruned_model")

print("模型剪枝完成。")

# 2. INT8量化示例(使用torch.quantization)

quantized_model = AutoModelForCausalLM.from_pretrained("./output_model/pruned_model", torch_dtype=torch.float16)

quantized_model.eval()

# 配置量化

quantized_model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

torch.quantization.prepare(quantized_model, inplace=True)

# 校准(需要少量校准数据)

calibration_data = [...] # 准备一批代表性数据

with torch.no_grad():

for data in calibration_data:

quantized_model(data)

# 转换为INT8模型

torch.quantization.convert(quantized_model, inplace=True)

# 保存量化模型

quantized_model.save_pretrained("./output_model/quantized_int8_model")

print("INT8量化完成。")

# 3. 使用GPTQ进行4bit量化(需要gptq库)

# 命令行示例(更高效):

# python -m gptq.llama \

# --model ./output_model/base \

# --data ./calibration.jsonl \

# --bits 4 \

# --groupsize 128 \

# --output ./output_model/quantized_4bit

组合拳与性能蜕变

单独的剪枝或量化效果显著,但真正的生产力爆发往往来自于二者的协同。一种高效的流程是 “先剪后量”:先通过剪枝得到一个稀疏但高精度的模型,再对这个“苗条”的模型进行量化。这种组合能最大限度地压缩模型体积,同时对推理速度的提升是倍增的——稀疏计算减少了算术操作的数量,低精度计算又加速了每个操作本身。

性能测试对比(在一台标准GPU服务器上对一个经过领域微调的7B参数模型进行测试):

| 压缩方案 |

模型大小 |

推理时间 |

相对基准 |

| 原始FP16 |

14GB |

2000ms |

基准线 |

| INT8量化 |

8GB |

1200ms |

速度提升40% |

| 剪枝(稀疏度40%) |

5GB |

800ms |

速度提升60% |

| 剪枝 + INT8量化 |

3GB |

400ms |

速度提升80% |

这意味着,在不牺牲核心领域能力的前提下,我们得到了一个体积削减近80%、速度提升5倍的“冲刺专家”。这种从“悍马”到“超级跑车”的蜕变,正是模型压缩的魅力所在。

第四部分:落地部署与工程优化

一个高效聪慧的模型还只是半成品,如何平稳、可靠、高性能地接入生产环境,是变现其价值的最后一步。选择合适的推理引擎、精细的性能调优与部署架构,决定了终端用户体验的成败。

推理引擎选择:各显神通的竞技场

没有一种引擎能解决所有问题:

- vLLM:凭借其创新的PagedAttention机制,在服务高并发请求时表现出色,尤其擅长处理具有相似前缀的LLM提示词(如聊天场景),吞吐量极高,是生产级API服务的首选。

- TGI:提供了开箱即用的高级特性支持,例如原生适配多个LoRA适配器的热加载和安全防护,在需要同时服务多个微调模型的场景下非常方便。

- llama.cpp:以其极高的软件工程优化著称,专注极致单次推理速度与超低资源占用,能将几十亿参数的模型流畅运行在消费级CPU甚至移动设备上,是边缘计算和离线部署的理想选择。

代码实现:vLLM与llama.cpp快速部署示例

# 1. vLLM 部署示例

from vllm import LLM, SamplingParams

# 加载模型(支持LoRA)

llm = LLM(

model="meta-llama/Llama-2-7b-hf",

enable_lora=True,

lora_extra_weights=["./output_model/lora_adapter"],

tensor_parallel_size=1, # 单GPU

)

# 配置采样参数

sampling_params = SamplingParams(temperature=0.7, top_p=0.95, max_tokens=512)

# 批量推理

prompts = [

"Instruction: 解释一下糖尿病的病因。\nInput: 请用通俗语言说明。\nOutput:",

"Instruction: 列出三种降糖药物。\nInput: 需要通用名。\nOutput:",

]

outputs = llm.generate(prompts, sampling_params)

for out in outputs:

print(f"Prompt: {out.prompt}")

print(f"Generated: {out.outputs[0].text}\n")

# 2. 使用llama.cpp(通常通过命令行,这里是Python调用示例)

'''

# 首先将Hugging Face模型转换为GGUF格式:

# python convert.py ./output_model/quantized_4bit --outfile ./model_4bit.gguf --outtype q4_0

# 然后使用llama.cpp Python绑定:

from llama_cpp import Llama

llm_cpp = Llama(

model_path="./model_4bit.gguf",

n_ctx=2048, # 上下文长度

n_threads=8, # CPU线程数

)

response = llm_cpp(

"Instruction: 简要说明高血压的危害。\nOutput:",

max_tokens=256,

temperature=0.1,

)

print(response['choices'][0]['text'])

'''

性能调优:将延迟压至500ms以下

硬实力(压缩)配合软优化(调优),才能将性能榨取到极致。几个关键参数直接影响终端响应速度:

- max_new_tokens:严格限制模型生成的最大长度,防止“长篇大论”拖慢整体响应。

- top_p 与 temperature:调整这两个采样参数,在保证结果多样性与可控性的同时,能有效避免模型陷入低概率词组的低效循环采样。

- 批处理与K-V缓存:服务端部署务必开启批处理功能,将多个独立用户请求合并计算以大幅提升算力利用率。同时,确保K-V(键-值)缓存复用机制被正确启用,这是LLM推理加速最核心的技术之一,能避免每个新token生成时对历史上下文的重复计算。

通过综合调优,7B级别的模型在单颗高端消费级GPU上实现500ms以内的端到端响应已成为标准操作。

部署方案全适配

根据业务场景选择部署架构:

- 云端部署:最为常见,依托云厂商的弹性GPU实例和容器化服务,实现快速扩缩容。

- 私有化部署:需要考虑服务器配置与推理引擎的深度优化。

- 边缘部署:正成为焦点,将轻量化后的模型直接部署在工厂网关、车载设备或智能手机上,实现数据的本地化处理与实时响应,消除了网络延迟与数据隐私的顾虑,这完全依赖于剪枝与量化带来的极致“瘦身”。

监控与持续迭代

部署上线不是终点。建立完善的监控指标,包括请求延迟、吞吐量、GPU利用率以及模型输出的质量指标(如设置自动化评估集打分)。当发现性能劣化或回答质量漂移时,意味着可能需要更新RAG的知识库、加载新版本的微调适配器,甚至启动新一轮的压缩优化循环。模型的生命周期管理,让其在生产中保持“聪明”与“敏捷”。

结尾:总结与展望

至此,我们完成了一次从通用大模型到高效领域专家的完整雕琢之旅。让我们再明确这个核心流程:

- 始于高质量的领域数据,通过RAG、微调或预训练精准“喂养”知识;

- 利用LoRA等低资源技术低成本、高效率地完成领域适配;

- 接着运用剪枝、量化组合技,系统性地为模型“减肥瘦身”,提升速度、降低成本;

- 最后,根据场景匹配最佳的推理引擎与部署架构,并辅以持续的工程优化与监控,将其稳定交付到用户手中。

技术选型速查表

如果你仍在起点徘徊,不知道从何入手,这张技术选型速查表或许可以为你指路:

| 场景与目标 |

数据处理 |

适配技术 |

压缩方案 |

部署推荐 |

| 快速验证原型(知识Q&A,成本敏感) |

RAG |

可暂不微调 |

训练后INT8量化 |

llama.cpp(CPU) |

| 高精度专业任务(代码生成,报告撰写) |

指令微调 |

LoRA (r=16, a=32) |

量化感知训练 +(轻)剪枝 |

vLLM / TGI (GPU服务) |

| 移动/边缘端应用(实时翻译,隐私计算) |

指令微调 + RAG |

LoRA |

强力结构化剪枝 + INT4量化 |

引擎深度定制 (边缘端) |

| 多租户/多技能(SaaS平台) |

多种数据并行处理 |

多LoRA适配器 |

统一主干模型量化 |

TGI(支持适配器热插拔) |

展望未来

展望未来,大模型的专用化与轻量化趋势将愈发紧密地交织。一方面,模型架构将向着更适配于高效微调与压缩的方向演进,模块化、稀疏化的设计将成为主流。另一方面,软硬协同将进入深水区,专门针对稀疏化、低精度计算设计的AI芯片会层出不穷,将我们今日仍在软件层面探讨的优化,固化为物理层面的速度飞跃。

给开发者的最终建议

别等到万事俱备才开始。 从最关键的业务痛点出发,选取一个规模适中的开源模型(如7B或13B级别),利用现成的LoRA代码库和公有云算力,先基于手头数据跑通一个微调版本。哪怕它还不够强大、不够快,这个完整闭环的经验——从数据清洗、模型调试、效果评估再到性能衡量——才是最宝贵的开端。

行动起来,让你的第一个“小而美”的AI专家在今天诞生吧。 如果想了解更多关于大模型实践与开源项目的深度讨论,欢迎来云栈社区交流分享。