作为一名经历过双11大促保障的 Java 资深开发,在接到小红书电商流量控制岗位的面试邀请时,心情是既兴奋又感到压力。小红书独特的“内容社区+电商”模式,使得它的流量控制场景和传统电商很不一样。尤其是在直播带货时,流量的突发性、热点集中度以及业务复杂度,都对技术架构提出了前所未有的挑战。

这次复盘,我的核心目标就是深入拆解小红书电商系统在流量控制上面临的技术难题与应对之策。我会通过还原真实的面试对话,并结合多张架构图来直观展示业务逻辑与技术实现,希望能为后续的求职者提供一份系统性的备战参考。我会从战前准备、实战问答、战后总结三个维度,结合我自己的双11大促保障经验,构建一套完整的面试应对策略。

一、战前部署:精准定位与充分准备

战前准备的核心,在于摸清小红书电商的业务痛点,并将自身的技术经验与之匹配,构建完整的知识体系。这一节,我会通过架构图来展示小红书电商的整体架构以及流量控制的关键环节,并结合图文来讲解业务挑战与我的准备思路。

1.1 小红书电商系统流量控制业务挑战分析

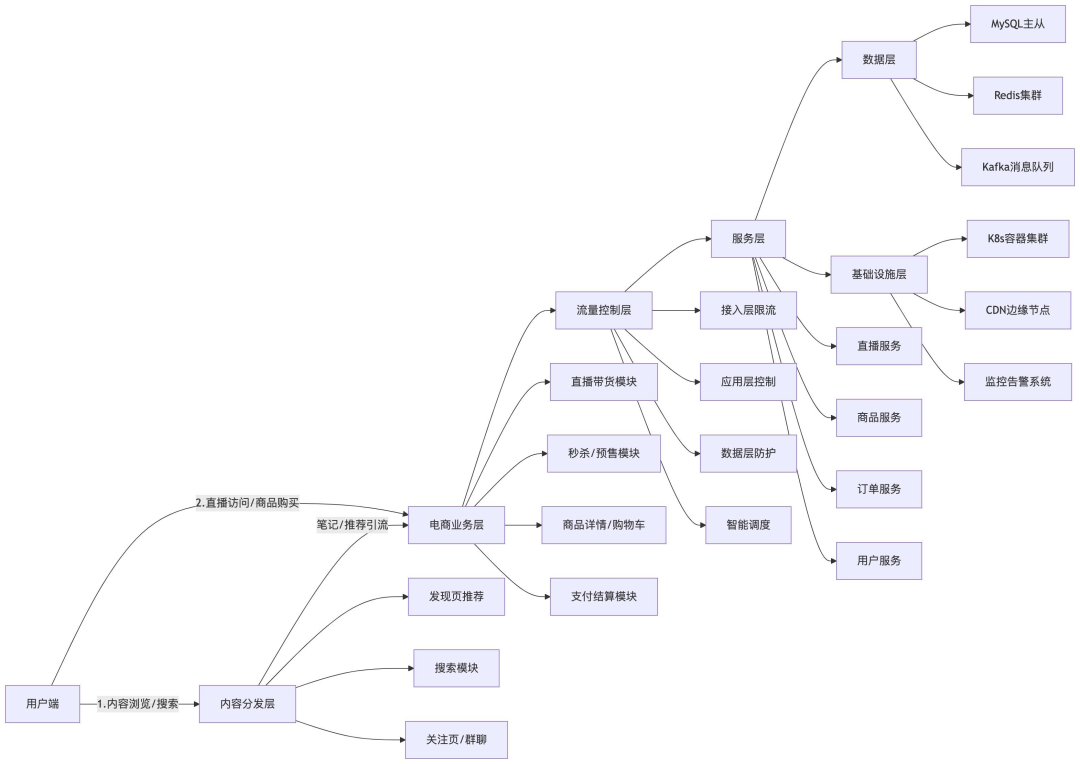

小红书电商的核心优势在于“内容种草+直播转化”,其流量路径和业务场景都具有独特性。我们首先通过一张整体架构图,来明确其业务链路与流量控制的核心节点。

1.1.1 小红书电商整体业务架构图

1.1.2 架构与业务场景讲解

从上面的架构图可以清晰地看到,小红书电商业务主要由四大核心链路构成,每条链路都涉及流量控制的需求。结合业务场景的特点,其流量控制的核心挑战集中在以下三点:

(1)直播带货场景的独特流量特征

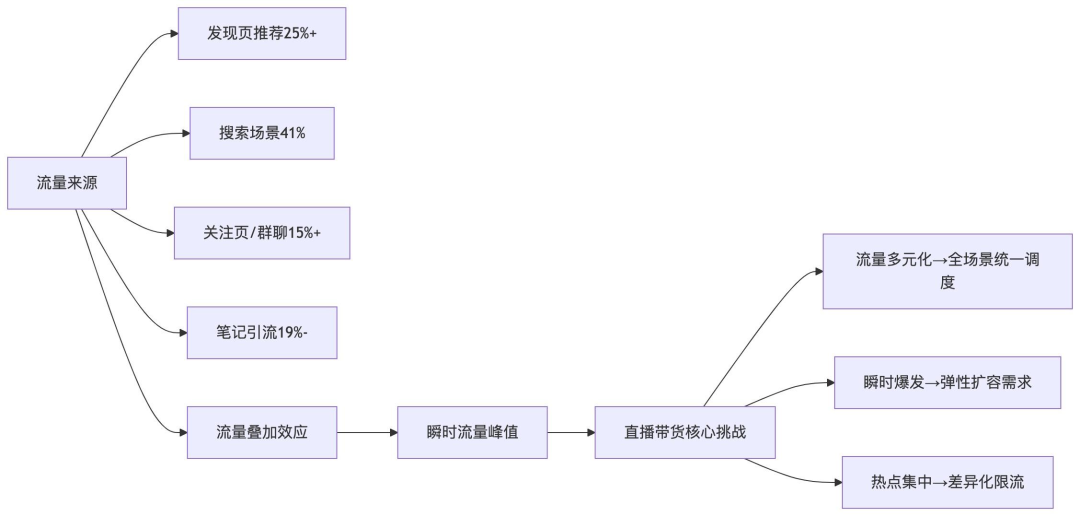

小红书直播间有41%的观看用户是通过搜索进入的(抖音这一比例约为33%)。这种“搜索驱动+内容引流”的模式,使得流量来源分散且容易形成瞬时叠加,对应架构图中「内容分发层→电商业务层」的链路流量波动极大。具体特征可以通过下面这张子架构图来呈现:

如图所示,多元化的流量来源会在“笔记推送高峰+商业投流”时形成叠加效应。一场爆品直播可能瞬间涌入上万观众,这对「流量控制层」的动态调度和「基础设施层」的弹性扩容能力提出了极高要求。同时,小红书内容分发的“头部效应”明显,热点直播间、爆款商品往往占据了80%以上的流量,这就需要「流量控制层」具备热点隔离与差异化策略的能力。

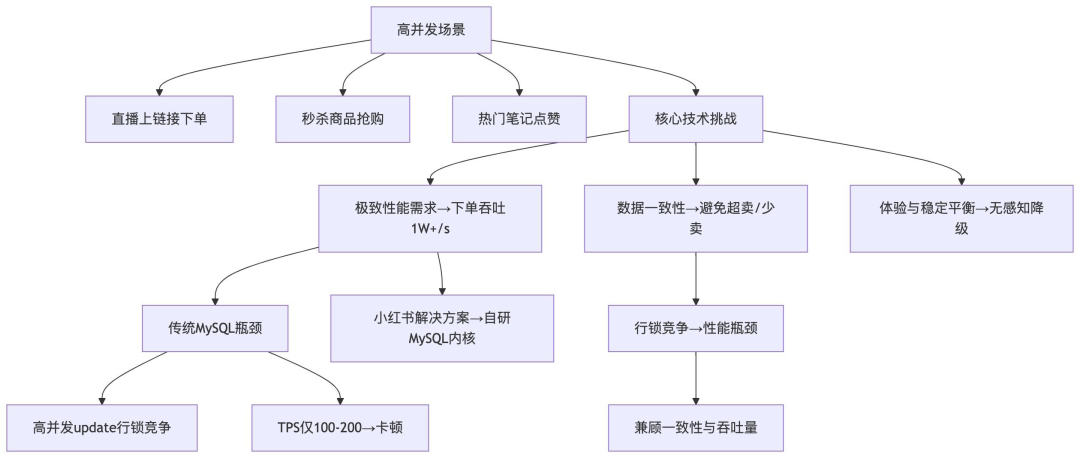

(2)电商业务的核心技术挑战

结合架构图中「电商业务层→数据层」的链路来看,小红书在秒杀、直播下单等场景中,面临着“高性能”与“数据一致性”的双重挑战,其核心痛点可以用下面这张架构图来概括:

从图中可以看到,传统的 MySQL 在高并发下单场景中,会因为行锁竞争导致性能急剧下降,根本无法满足小红书每秒1万以上的下单吞吐需求。但如果为了追求性能而放松一致性约束,又会出现超卖、少卖等严重的业务问题。这正是我面试中重点准备的核心痛点——如何在保证数据一致性的前提下,最大化系统吞吐量。

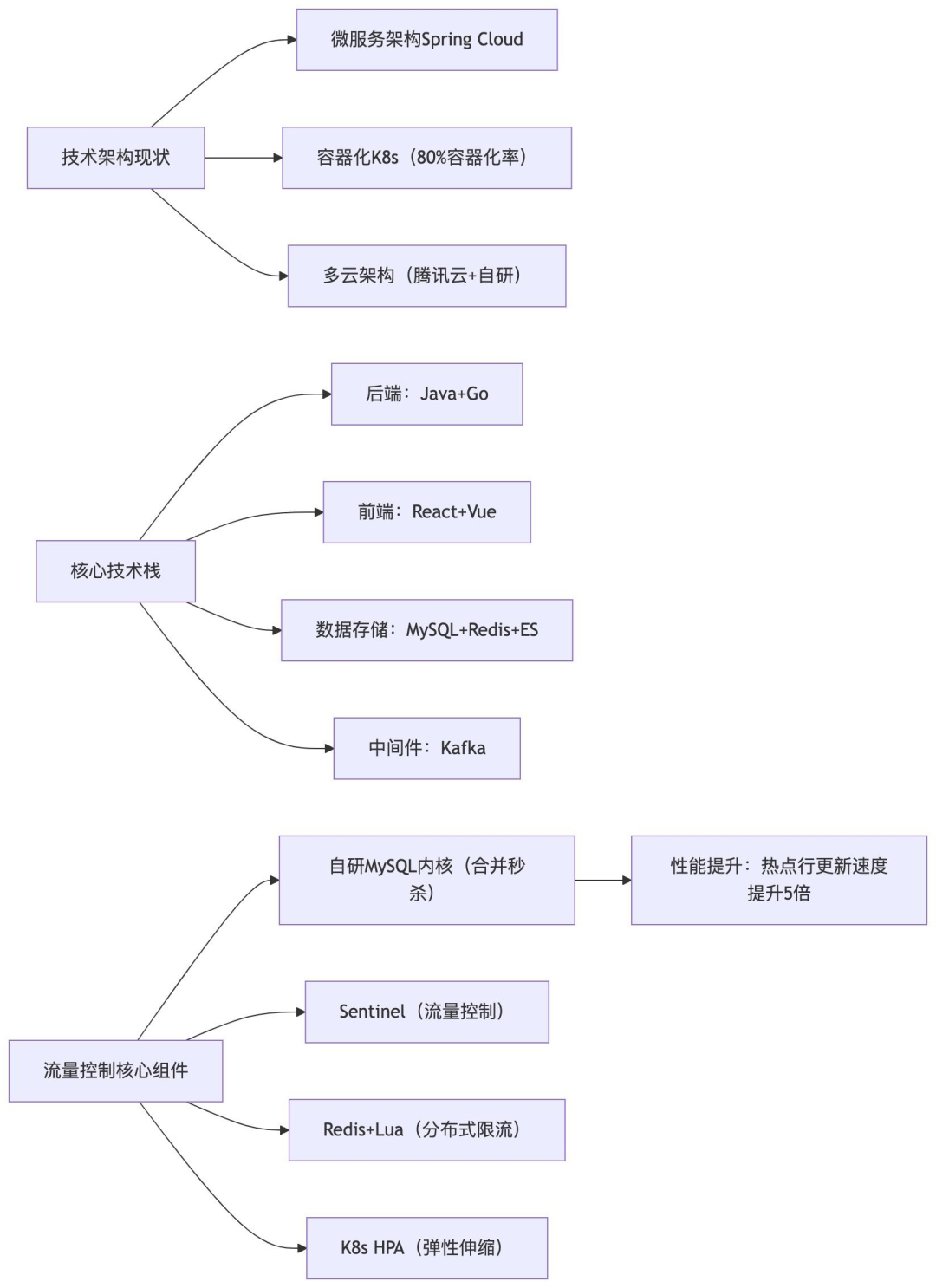

(3)技术架构的演进与现状

小红书已经完成了从单体架构到微服务架构的演进,目前采用的是“微服务+容器化”架构。其核心技术栈以及与流量控制相关的核心组件,可以参考下面这张架构图:

这里需要重点关注小红书自研的 MySQL 内核。它实现的“合并秒杀方案”,核心思想是对热点行的更新操作进行优化,相比社区版本有百倍的性能提升。这一技术创新为直播带货等高并发场景提供了核心支撑,也是我面试中重点准备并计划阐述的技术亮点之一。

1.2 基于双11经验的定制化知识储备

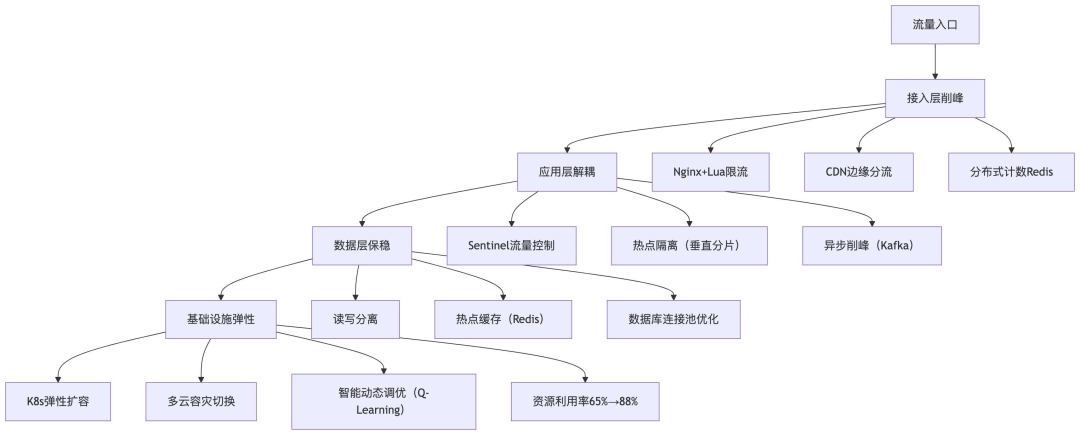

我参与过的双11大促保障项目,其流量控制经验可以直接迁移到小红书的场景中。核心思路就是将双11的“多级防护体系”与小红书的业务架构结合起来。我们先通过一张架构图来呈现双11的流量控制体系,再讲解我的迁移思路。

1.2.1 双11多级流量控制体系架构图

1.2.2 经验迁移与专项准备讲解

双11的四级防护体系,与小红书架构图中的「流量控制层+服务层+基础设施层」高度契合。具体的迁移应用如下:

- 接入层削峰:双11中通过Nginx+Lua实现的分布式限流,可以直接应用于小红书直播“上链接”瞬间的流量洪峰,配合CDN边缘分流,有效拦截无效请求。

- 热点隔离:双11中通过 Redis +Lua原子操作、热点商品垂直分片的经验,可以用来解决小红书爆款商品、热门直播间的单点过载问题。

- 智能调优:基于Q-Learning算法的动态调优策略,可以迁移到小红书的流量调度中,实现限流阈值的实时调整,从而提升资源利用率。

针对小红书的自研技术栈,我重点准备了三点:一是自研MySQL内核的合并秒杀实现原理;二是Sentinel在小红书场景下的高级应用(如热点参数限流、集群流量统计);三是Redis+Lua在分布式限流中的性能优化点。

1.3 面试心态建设与知识图谱构建

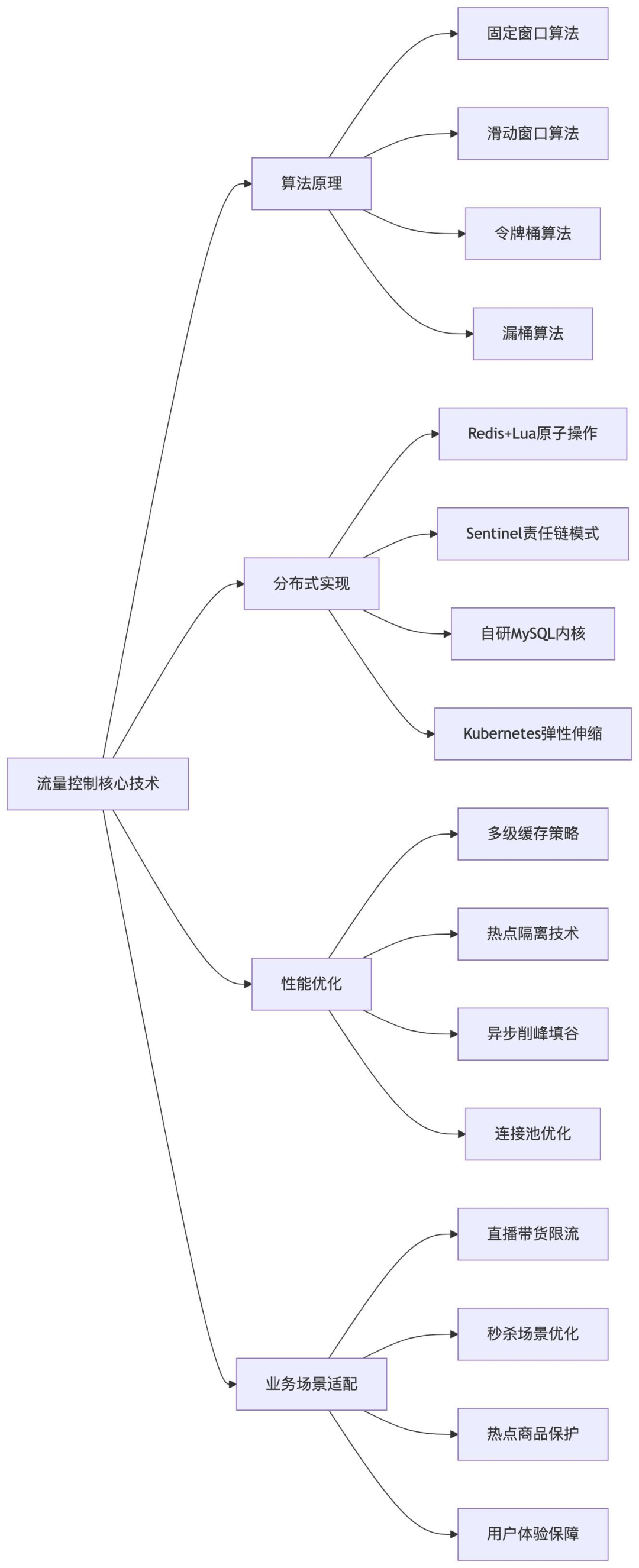

心态建设的核心是保持“学习型心态”,而知识图谱则是将零散的技术点与业务场景串联起来,形成系统化的备战体系。下面这张知识图谱架构图展示了流量控制的核心知识,有助于面试思路的梳理。

1.3.1 流量控制核心知识图谱架构图

1.3.2 业务痛点与技能映射

结合小红书的业务架构与上面的知识图谱,我整理了业务痛点、技术挑战与自身技能的映射关系,明确了备战重点,如下表所示(对应架构图中的各核心环节):

| 业务痛点(对应架构节点) |

技术挑战 |

所需技能 |

我的准备程度 |

| 直播带货流量瞬时爆发(流量控制层) |

支撑万级并发,毫秒级响应 |

分布式限流、弹性扩容 |

★★★★★ |

| 秒杀场景超卖问题(数据层) |

保证数据一致性,提升TPS |

分布式事务、锁优化 |

★★★★☆ |

| 热点商品流量集中(服务层) |

避免单点过载,实现负载均衡 |

热点分片、流量调度 |

★★★★★ |

| 用户体验与系统稳定平衡(用户端+流量控制层) |

智能降级,友好引导 |

熔断降级、降级策略 |

★★★☆☆ |

二、实战演练:面试真题深度复盘

实战演练是面试复盘的核心。这一节,我将还原4道核心的面试真题。每道题我都会结合「架构图+图文讲解」的方式,来呈现我的解题思路与方案,力求贴合面试现场的表达逻辑,并直观展现业务架构与技术实现的关联。

2.1 问题一:直播带货场景下的流量控制架构设计

面试官核心意图:考察对小红书直播带货业务场景的理解、分布式流量控制架构的设计能力、技术选型的合理性,以及性能优化思路。

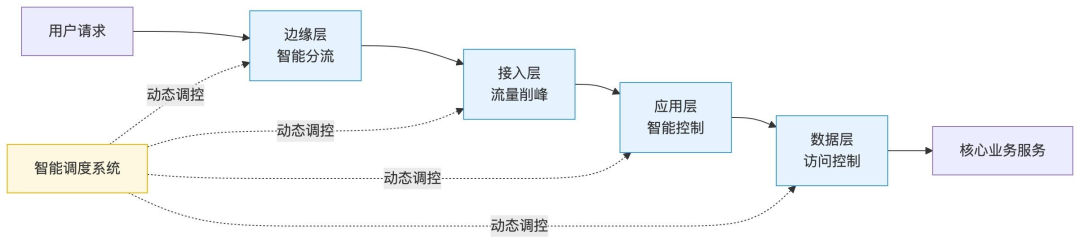

2.1.1 我的破局思路:四层漏斗+智能调度架构

结合小红书直播带货流量多元化、瞬时爆发、热点集中的特征,我提出了“四层漏斗+智能调度”的流量控制架构。这个架构既融合了双11的多级防护经验,又紧密贴合小红书的业务架构。具体架构图如下:

2.1.2 图文结合讲解架构设计

该架构与小红书电商整体架构深度契合,四层漏斗层层递进,智能调度系统贯穿始终。具体讲解如下(模拟面试现场的表达逻辑):

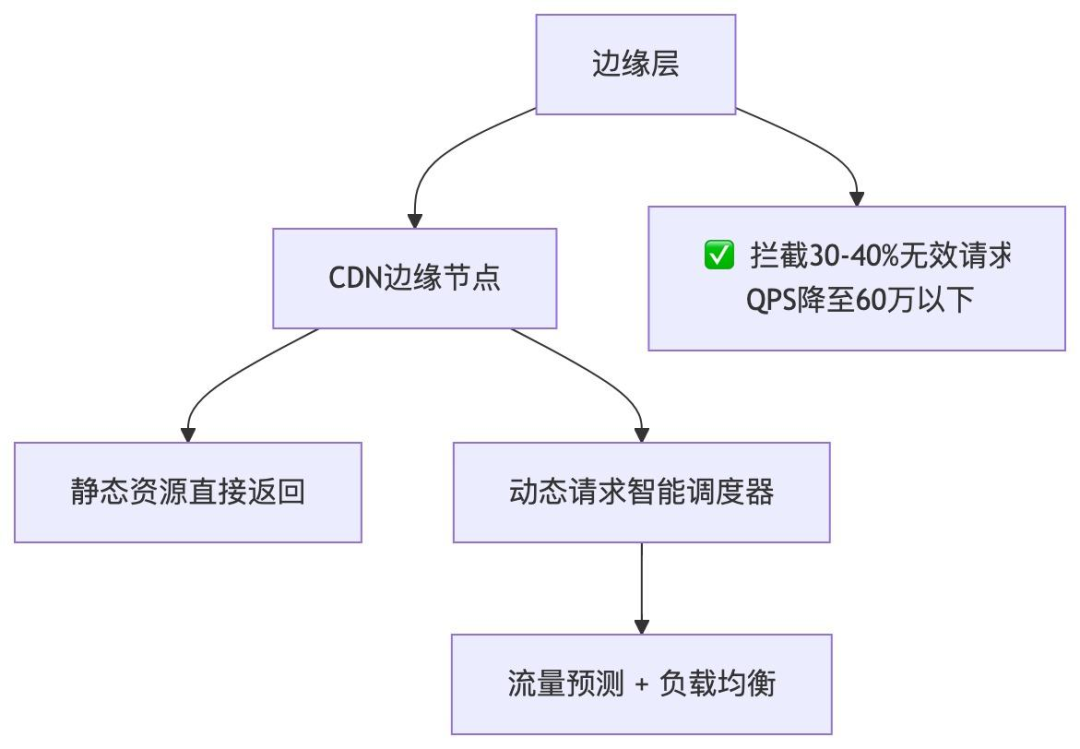

- 边缘层智能分流(对应架构图B环节):作为流量入口的第一道防线,利用小红书现有的CDN边缘节点,将静态资源(如图片、视频封面)直接在边缘返回。动态请求(如直播推流、下单)则通过智能调度器,基于用户地理位置、网络质量进行分流。这一步可以拦截30-40%的无效请求,大幅降低后端压力。

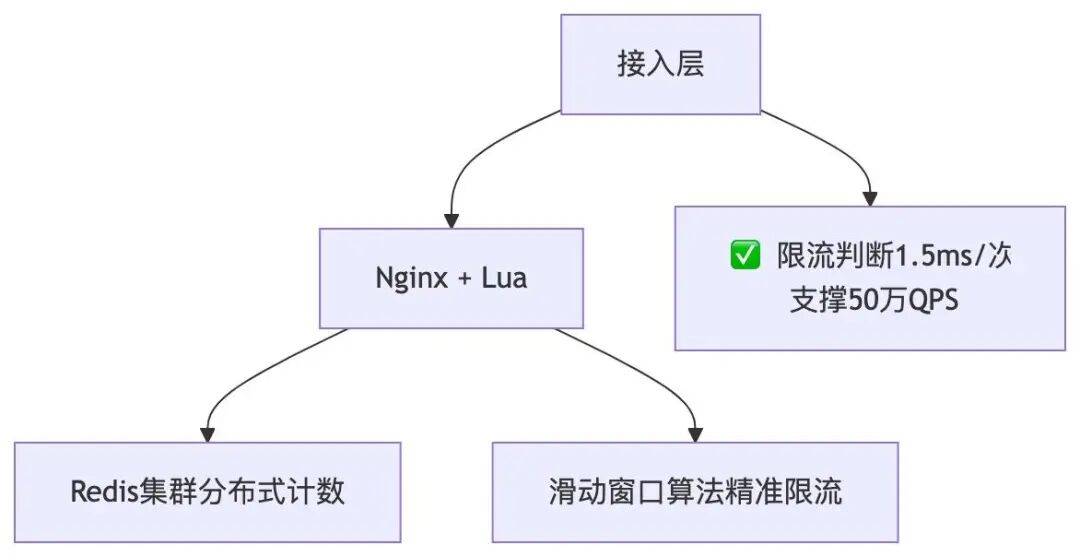

- 接入层流量削峰(对应架构图C环节):采用小红书常用的Nginx+Lua实现,配合 Redis 集群做分布式计数,通过滑动窗口算法进行精准限流(例如,单个IP每秒限制50次请求)。这样既能防止恶意攻击,又不影响正常用户体验。经过优化,单次限流判断仅需1.5毫秒,能支撑每秒50万次的限流判断。

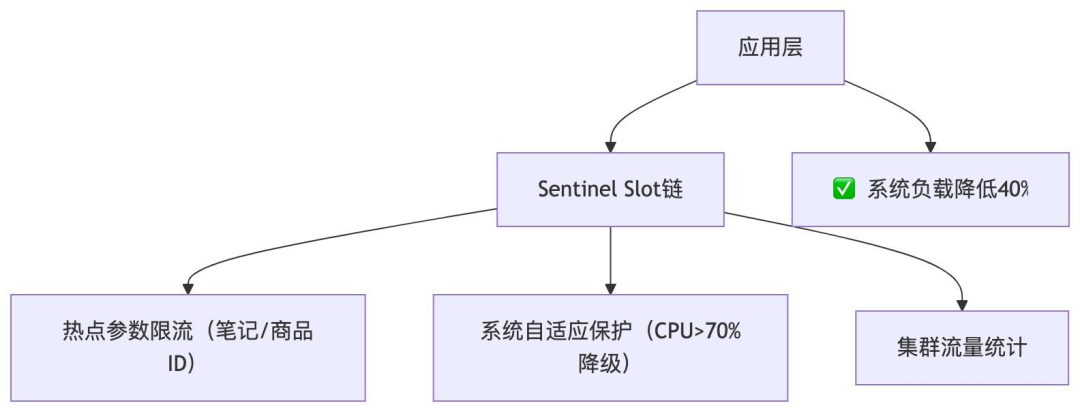

- 应用层智能控制(对应架构图D环节):基于小红书使用的Sentinel组件,构建完整的Slot责任链,并针对直播带货场景做定制化优化——对热点笔记ID、商品ID进行分级限流(例如,热门商品1000次/秒,普通商品100次/秒)。当CPU使用率超过70%时,自动降级非核心业务(如评论、分享),优先保证直播推流和下单流程的畅通。

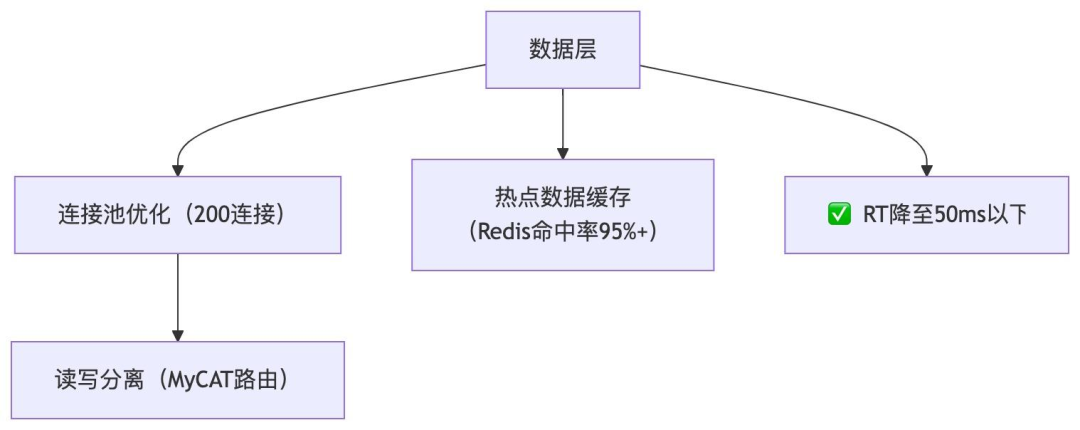

- 数据层访问控制(对应架构图E环节):针对MySQL性能瓶颈,优化连接池大小至200个,实现读写分离,并将热门商品信息缓存至Redis(目标命中率95%以上)。通过这些优化,可以将数据库连接建立时间从100ms降至5ms,最终将数据层响应时间(RT)控制在50ms以内。

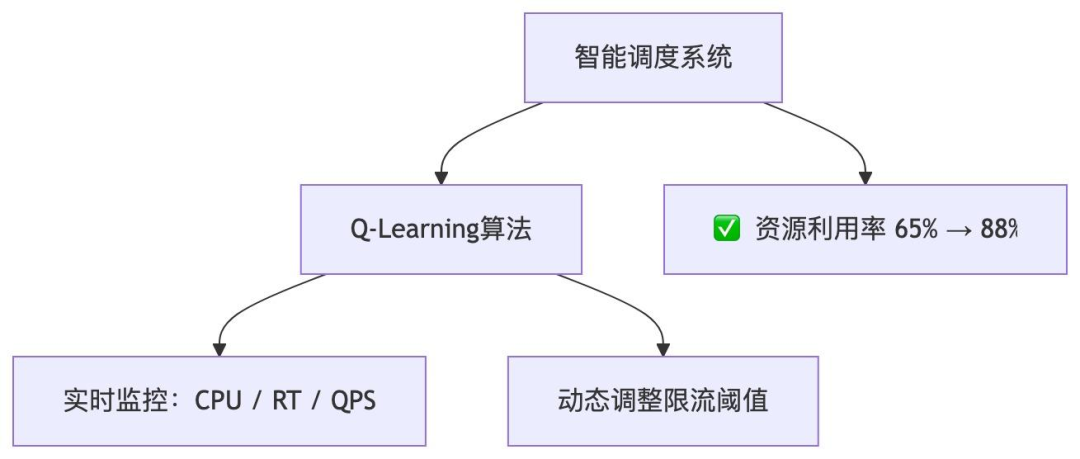

- 智能调度系统(对应架构图G环节):这是我结合双11经验提出的创新点。系统基于Q-Learning算法,实时监控系统负载(CPU、内存)和业务指标(QPS、RT),动态调整各层的限流阈值。目标是将系统资源利用率从65%提升至88%,实现“资源利用最大化”和“系统稳定”的双重目标。

2.2 问题二:秒杀场景下的分布式限流与数据一致性保障

面试官核心意图:考察对秒杀业务痛点的把握、分布式系统数据一致性的实现方案,以及对小红书自研技术(合并秒杀)的理解程度。

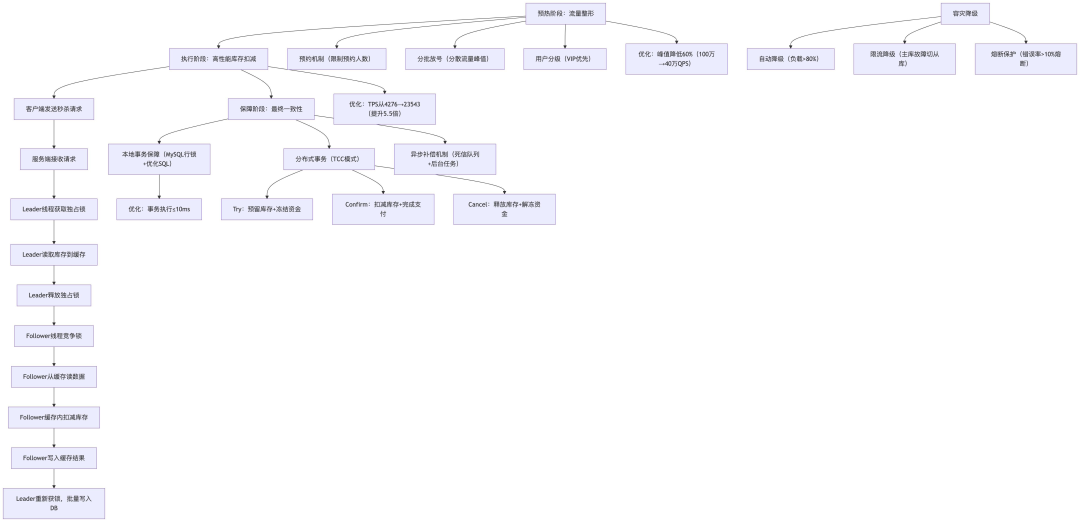

2.2.1 我的破局思路:三阶段优化+多级保障架构

结合小红书自研的合并秒杀技术以及双11的秒杀保障经验,我提出了“三阶段优化+多级保障”的解决方案。这个方案旨在同时解决高性能和数据一致性的问题。架构图及核心流程如下:

2.2.2 图文结合讲解解决方案

该方案的核心是:借助小红书自研的合并秒杀技术解决高性能问题,利用多级事务和补偿机制来保证数据一致性。 在面试中,我重点讲解了合并秒杀的实现逻辑(贴合小红书技术栈)和一致性保障方案:

- 预热阶段:在秒杀开始前,通过预约、分批放号等方式进行“流量削峰”,将瞬时流量峰值从100万QPS降至40万以下,避免流量直接冲击后端数据库。这是双11秒杀保障的成熟经验,可以直接迁移。

- 执行阶段(核心亮点):采用小红书自研的合并秒杀方案。具体流程是:一个Leader线程先获取独占锁,将库存数据读取到缓存中,然后释放锁;随后,多个Follower线程竞争锁,直接在缓存内完成库存扣减;最后,由Leader线程批量将缓存中的扣减结果写入数据库。这个设计避免了大量并发请求直接操作MySQL热点行,可以将TPS从4276提升至23543,热点行更新速度达到每秒1.5万次以上。

- 一致性保障:分为三层来实现——本地事务(依靠MySQL行锁和SQL优化,保证单库一致性)、分布式事务(采用TCC模式,应对跨库操作)、异步补偿(通过死信队列处理异常订单,避免超卖或漏单)。

- 容灾降级:贴合小红书的高可用需求,设计了自动降级、限流降级、熔断保护三级策略。确保在秒杀场景下,即使系统出现异常,也能优先保证核心的下单支付流程可用。

2.3 问题三:热点商品的流量隔离与负载均衡策略

面试官核心意图:考察对小红书热点数据访问模式的理解、热点隔离的技术方案、负载均衡算法的选择与优化能力,同时关注成本控制与系统可扩展性。

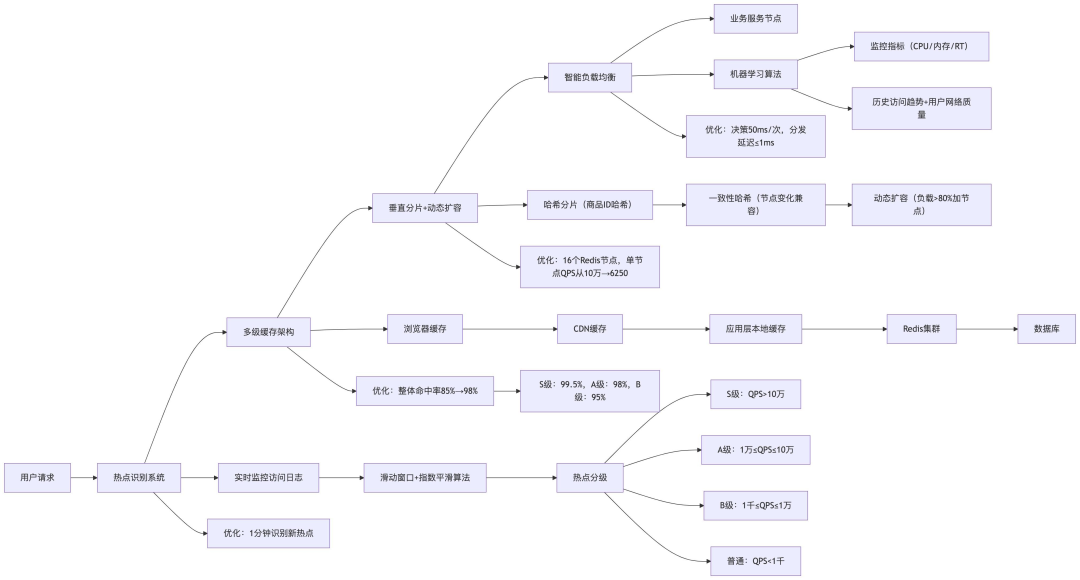

2.3.1 我的破局思路:智能识别+多级缓存+动态扩容架构

结合小红书“热点集中+长尾并存”的流量特征,我提出了“智能识别+多级缓存+动态扩容”的解决方案。通过热点分级、缓存分层、分片扩容,来实现热点隔离与负载均衡。架构图如下:

2.3.2 图文结合讲解策略实现

该方案的核心是“精准识别热点、差异化缓存、分散流量压力”,在保证高性能的同时控制成本,贴合小红书的业务场景。面试中我重点讲解了3个核心环节:

- 热点识别系统:实时监控用户访问日志,通过“滑动窗口+指数平滑”算法,能在1分钟内识别出新的热点商品,并将其分为S、A、B三个等级。这为后续的差异化缓存和限流提供了依据,解决了小红书热点突发、难以预判的问题。

- 多级缓存架构:针对不同级别的热点,设计差异化的缓存策略——S级热点(头部爆款)采用“浏览器+CDN+应用本地缓存+Redis”四级缓存,目标命中率达到99.5%;A级、B级热点则逐步简化缓存层级;普通商品直接走Redis+数据库。通过这套策略,可以将整体缓存命中率从85%提升至98%,大幅减少数据库的访问压力。

- 分片与负载均衡:对热点商品采用哈希分片策略,将商品ID哈希后分散到16个Redis节点中,使得单个节点的QPS从10万降至6250,避免了单点过载。同时采用一致性哈希算法,支持节点的动态扩容(当节点负载超过80%时自动添加新节点)。智能负载均衡算法会结合服务器实时负载、用户网络质量等指标,在50毫秒内完成一次分发决策,并将分发延迟控制在1毫秒以内,以保证用户体验。

2.4 问题四:用户体验与系统稳定的平衡策略

面试官核心意图:考察对小红书用户体验的重视程度、降级策略的设计能力、监控预警系统的设计思路,以及故障恢复与容灾切换方案。核心是考察“技术与业务平衡”的思维。

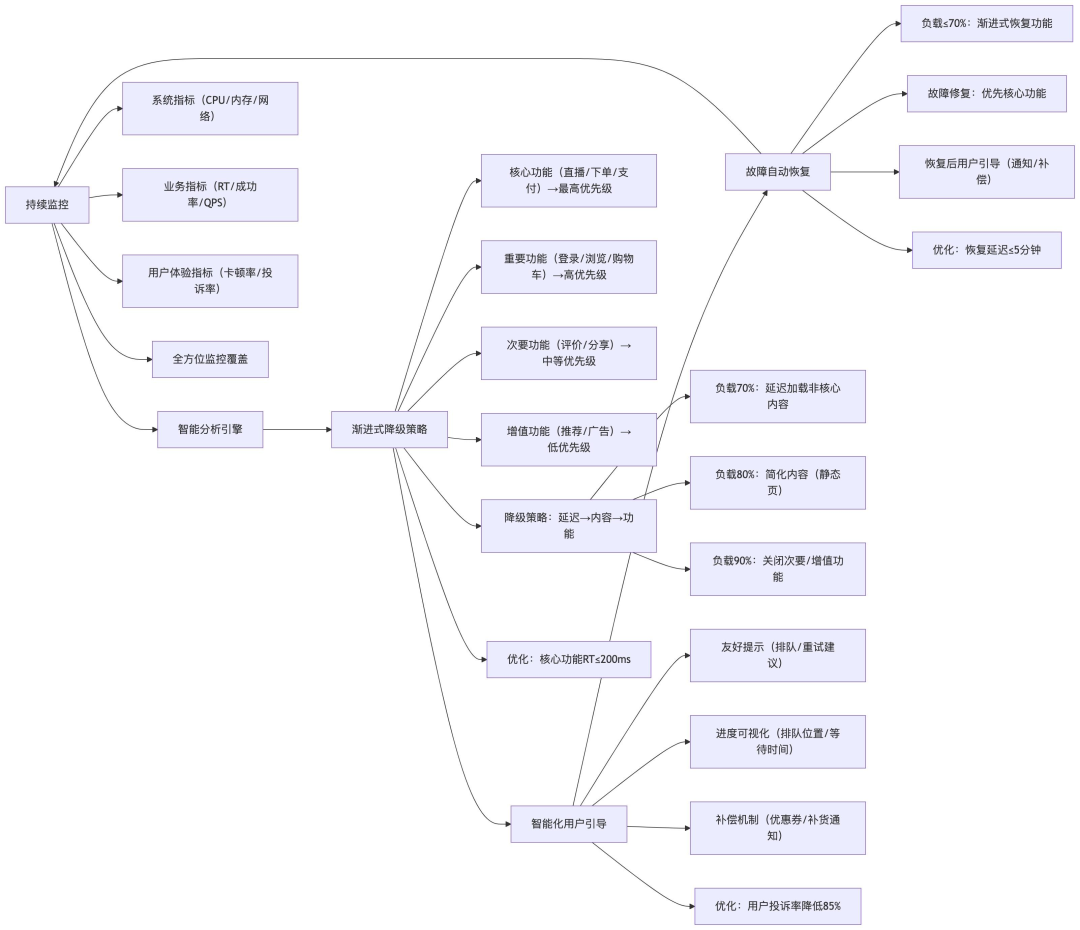

2.4.1 我的破局思路:渐进式保护+智能化引导架构

小红书作为内容社区,用户体验的优先级极高。因此,我提出了“渐进式保护+智能化引导”的平衡策略,在保证系统稳定的同时,最大限度降低对用户体验的影响。架构图如下(包含监控与引导机制):

2.4.2 图文结合讲解平衡策略

该策略的核心是“不粗暴拒绝,也不忽视稳定”,通过“监控→分析→降级→引导→恢复”的闭环,来实现用户体验与系统稳定的平衡。面试中我结合小红书的平台特性,重点讲解了四点:

- 功能分级保护:将业务功能分为四个等级(核心、重要、次要、增值)。当需要降级时,按照“增值→次要→重要→核心”的顺序依次关闭功能,优先保证直播推流、下单、支付等核心功能可用。这贴合小红书“内容+电商”的核心商业模式,避免因降级而影响核心的业务转化。

- 渐进式降级:不采用“一刀切”的拒绝方式,而是分三步走:负载70%时,延迟加载非核心内容(如评论);负载80%时,返回简化版的静态页面(隐藏复杂动画和非必要内容);负载90%时,关闭次要和增值功能。目标是确保核心功能的响应时间始终控制在200ms以内,让用户基本无感知。

- 智能化引导:在降级期间,通过友好的提示(如“当前访问人数较多,正在为您排队”)、进度可视化(显示排队位置)、以及补偿机制(如赠送小额优惠券),来缓解用户的焦虑情绪,从而降低投诉率。这非常符合小红书用户对体验的高要求。

- 闭环监控与恢复:构建一个覆盖系统、业务、用户体验三类指标的监控体系。当故障恢复时,按照“核心→重要→次要→增值”的顺序渐进式恢复功能,并通过系统通知、补偿等方式引导用户回归,确保整个恢复过程平滑顺畅。

三、战后复盘:经验总结与成长规划

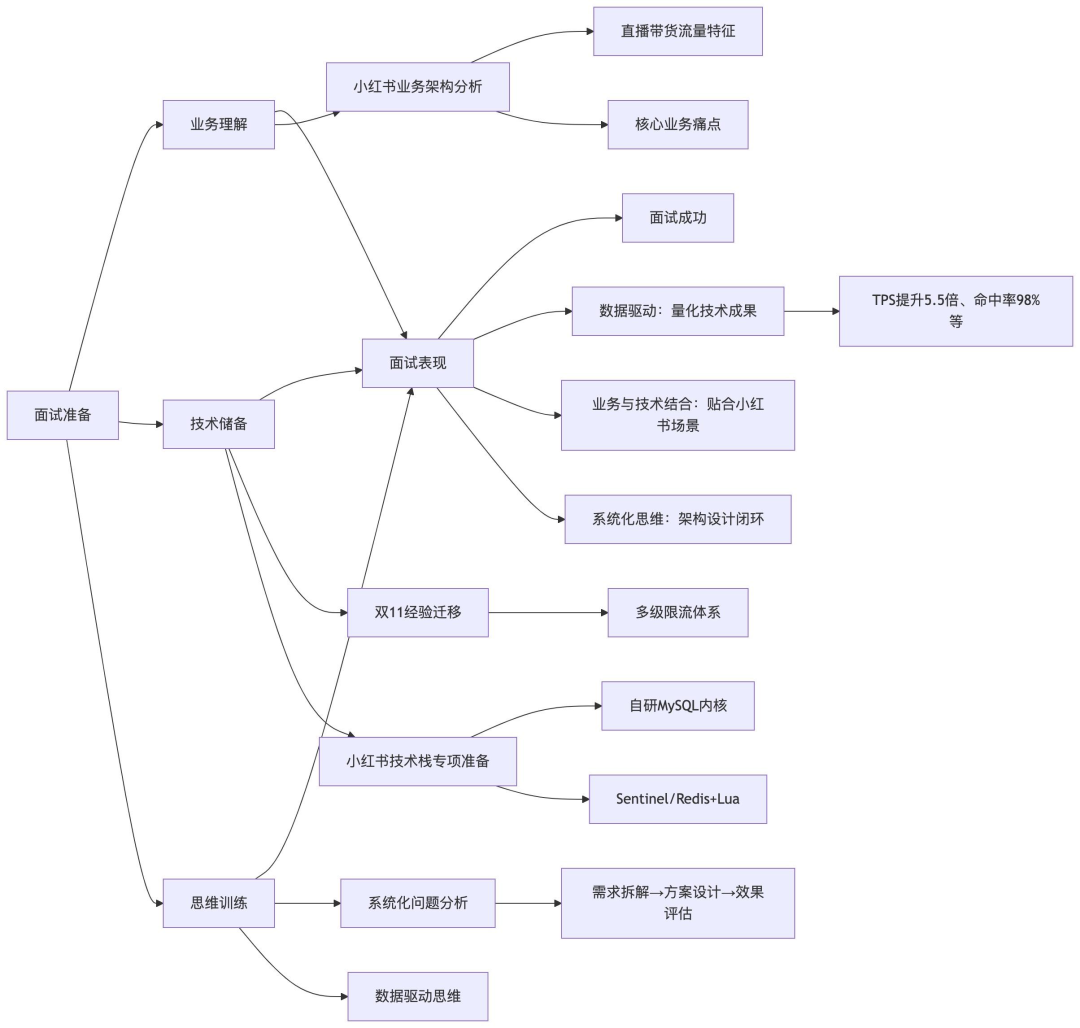

战后复盘的核心是总结面试中的亮点与不足,明确后续的成长方向,既为自身能力提升提供指引,也为后来的求职者提供参考。这一节通过架构图来呈现面试准备与表现的闭环,并结合图文讲解经验与建议。

3.1 面试亮点与成功经验

本次面试的成功,核心在于做到了“业务与技术结合、数据驱动、系统化思维”。下面这张架构图呈现了面试准备与表现的核心逻辑,结合图文我来总结亮点:

3.1.1 面试成功核心逻辑架构图

3.1.2 亮点总结(图文结合)

结合上面的架构图,本次面试有三大核心亮点:

- 数据驱动的技术方案展示:全程使用具体的数据来支撑技术方案,例如“多级缓存命中率从85%提升至98%”、“合并秒杀方案使TPS提升5.5倍”、“资源利用率从65%提升至88%”。这让面试官能直观地感受到我的实战能力和成果量化思维,正是架构图中“数据驱动思维”的体现。

- 业务与技术的深度结合:没有空谈技术理论,而是基于小红书的业务架构(从内容分发到电商转化)和直播带货的流量特征,来设计贴合其场景的解决方案。例如,针对“41%直播流量来自搜索”的特点,特别优化了边缘层的分流策略。这完美对应了架构图中“业务理解→面试表现”的核心逻辑。

- 系统化的问题分析方法:在回答每一道问题时,都遵循了“需求拆解→方案设计→实施路径→效果评估”的逻辑闭环。例如在设计流量控制架构时,先从流量特征拆解出挑战,再设计四层漏斗方案,最后给出优化成果的评估。这充分体现了我的系统化思维和结构化表达能力。

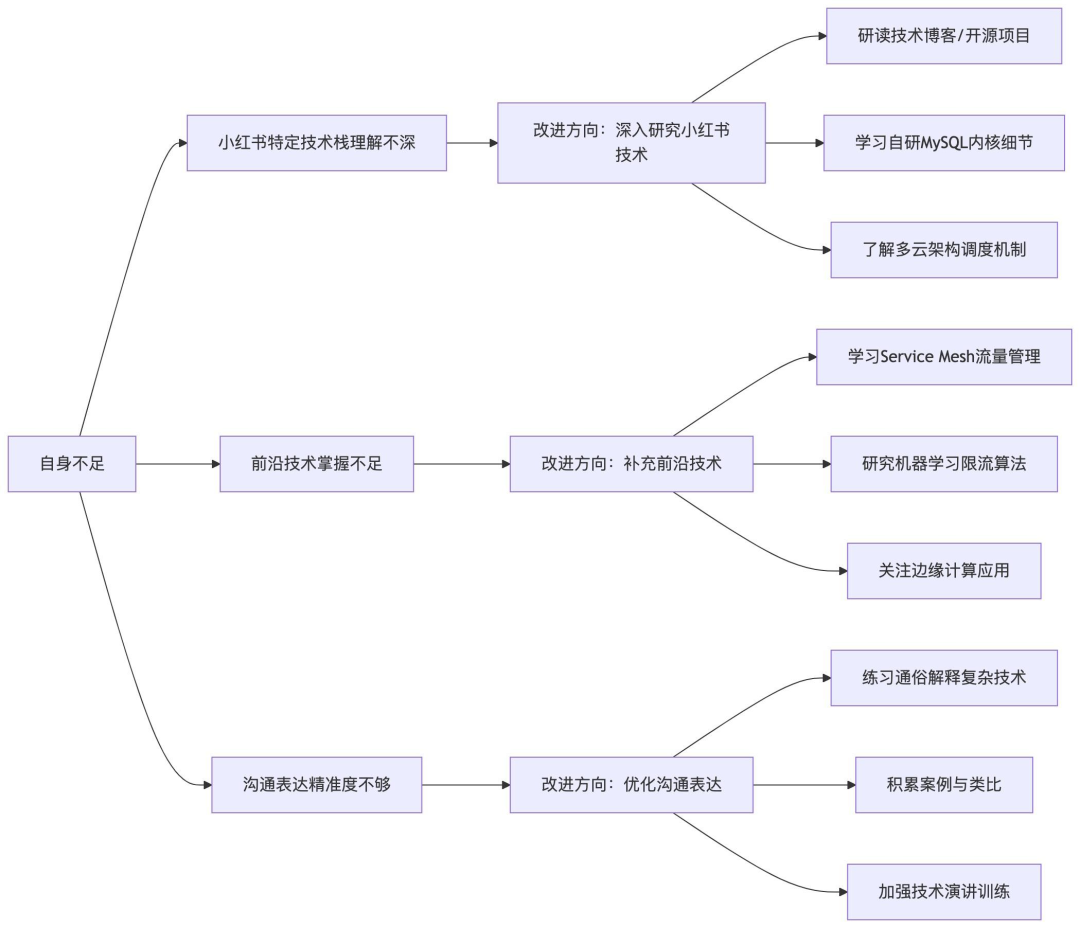

3.2 不足之处与改进空间

结合面试表现和小红书技术栈的要求,我也清醒地认识到了自身的不足。下面这张架构图清晰地呈现了“不足之处→改进方向”的对应关系,帮助我明确了后续的提升重点:

3.3 给后来者的实用建议

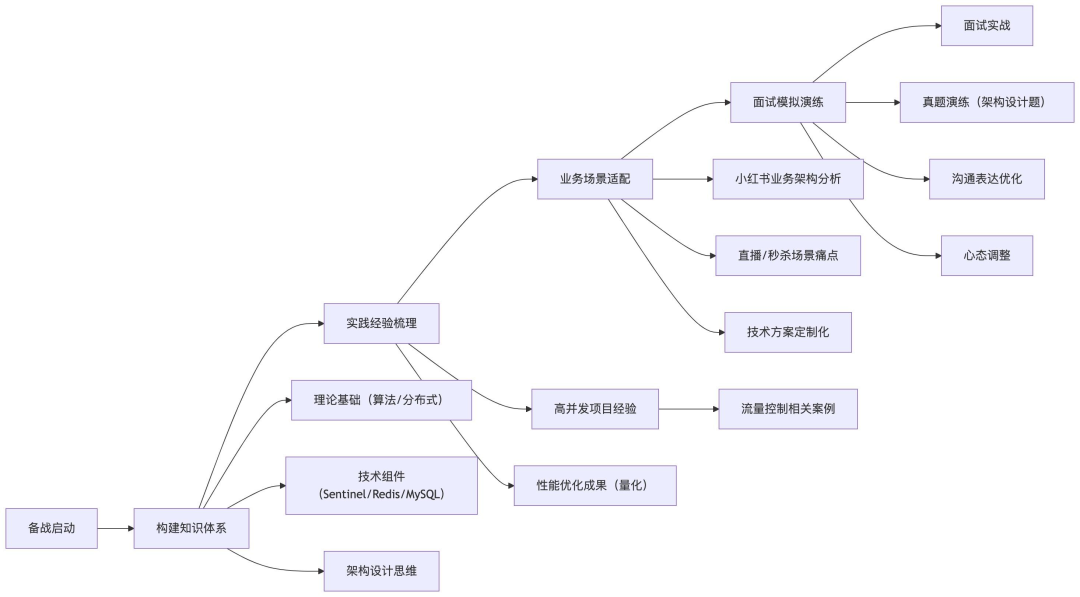

结合我自身的面试经验,为后续应聘小红书电商流量控制岗位的求职者,提供一套“三位一体”的备战建议。下面这张架构图呈现了备战的核心路径:

结合上面的备战路径,我的核心建议有以下三点,它们分别对应架构图中的关键环节:

- 构建“理论+实践+业务”三位一体的知识体系:在理论上,要扎实掌握流量控制的核心算法和分布式系统原理;在实践上,仔细梳理自身的高并发项目经验,并将优化成果量化;在业务上,必须深入分析小红书的业务架构和场景痛点,避免陷入“纯技术空谈”的陷阱。

- 采用“问题驱动”的学习方法:从小红书的核心业务问题(如直播流量爆发、秒杀场景的数据一致性)出发,拆解其中的技术难点,设计解决方案,并思考如何通过实践进行验证和优化。例如,可以专门去研究小红书自研的合并秒杀方案,理解它究竟解决了什么核心痛点。

- 打造差异化竞争优势:结合自身独特的经验(例如双11或618大促保障),突出这些经验与小红书业务场景的契合点。同时,要主动补充小红书技术栈的专项知识,比如其自研MySQL内核、多云架构调度机制等,避免与其他求职者陷入同质化竞争。

结语

这次小红书的面试经历,让我对高并发流量控制技术有了更深入的理解,也对自身的技术能力边界有了更清晰的认识。本次复盘通过多幅架构图,直观地呈现了小红书电商的业务架构与流量控制的核心方案,并结合图文同步讲解了面试思路、业务场景与技术实现,既还原了面试现场的表达逻辑,也希望能为后续的求职者提供一份有价值的备战指南。

我最大的收获是认识到,流量控制已经不再是一个纯粹的技术问题,它需要与业务进行深度融合——小红书的流量控制方案,必须紧密贴合其“内容+电商”的独特场景,在高性能、高可用与用户体验之间找到最佳平衡点。

未来,我将针对自身不足,持续学习,补齐技术短板,沿着既定的成长路径不断提升。也希望这次图文并茂的复盘,能够对更多正在备战 面试 的朋友有所帮助。技术成长之路道阻且长,我们可以在像 云栈社区 这样的开发者社区里交流分享,共同进步。