面试时被问到“如何设计排行榜系统”,如果只回答排序算法,可能就错过了面试官真正想考察的内容。当场景升级为亿级用户、每秒10万次查询、数据分钟级更新时,这道题背后其实是对分布式系统设计核心挑战的全面考察。

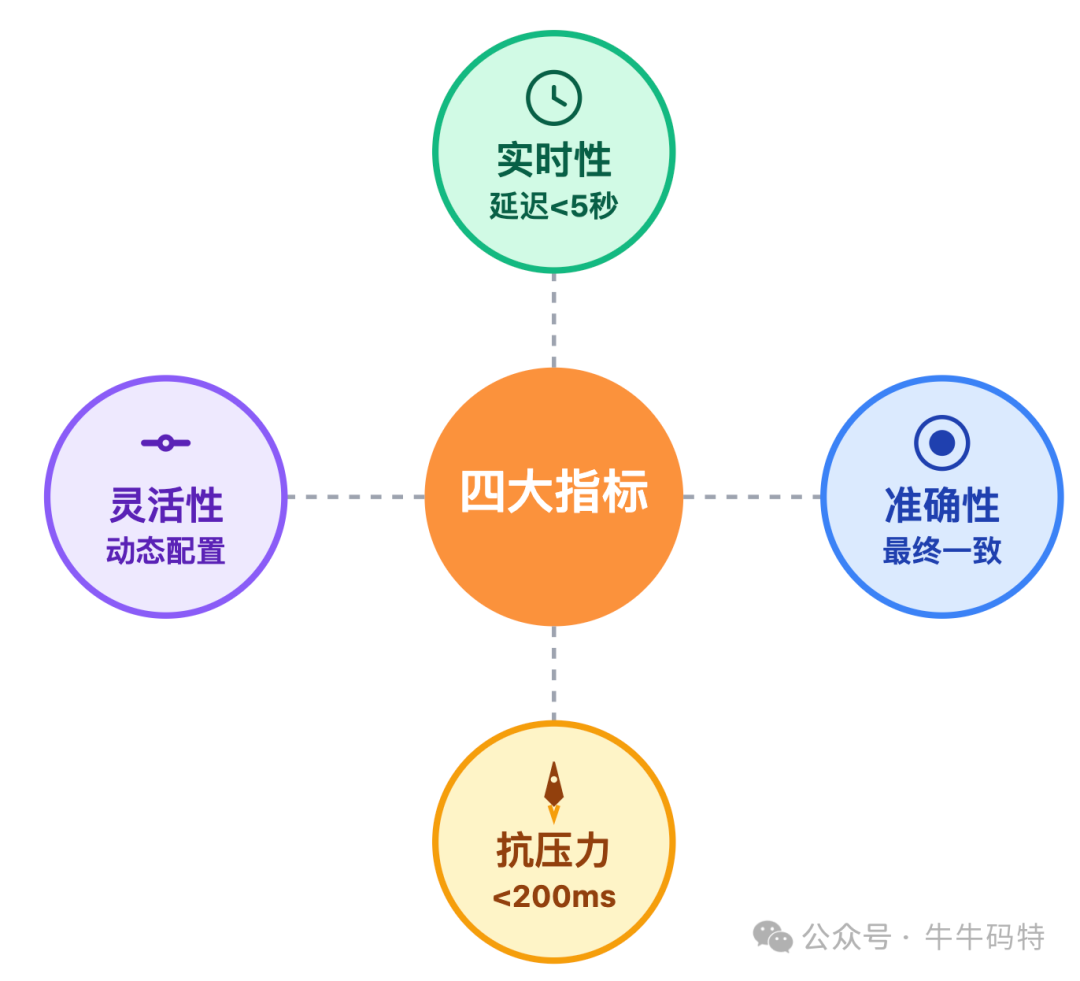

今天,我们就从需求拆解出发,一步步推导出能够支撑亿级用户体量的排行榜系统架构。设计前不明确核心需求,就像航海没有指南针。在亿级用户场景下,以下四个指标直接决定了系统的成败,每一个都需要给出明确的量化标准。

一、 明确需求:定义成功的标准

-

实时性是关键

如何定义合理的实时性?实测数据告诉我们,核心榜单(如游戏战力榜)的更新延迟一旦超过5秒,用户投诉率会显著上升。而非核心榜单(如周销量榜)可以放宽到分钟级,但必须在前端明确提示更新周期。这里的核心在于用户体验的实时感知,即使数据是异步更新的,也可以通过前端的动态效果让用户感觉变化是即时发生的。

-

准确性是底线

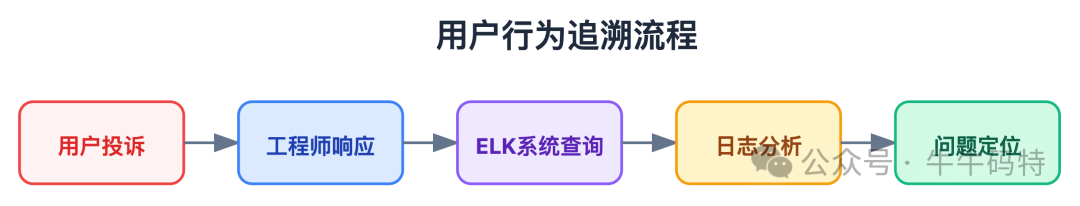

榜单的核心价值在于传递可信信息。要实现“最终一致 + 不丢数据”,必须满足几点:用户行为必须100%接入计算;分数更新需原子化处理,避免并发错误;系统故障恢复后,数据能准确追溯;对于亿级数据规模下分片间可能产生的短暂不一致,需要设计数据对账机制进行校验。

-

抗压力决定系统能否“活下来”

双十一零点的销量榜、游戏版本更新后的战力榜,其峰值QPS可能从日常的1万飙升到100万。此时系统不仅要扛住压力,还必须保证P99延迟低于200ms,超过这个阈值,用户会明显感到卡顿。

-

灵活性关系到业务迭代

业务需求是动态的:今天要日榜,明天加周榜,后天可能还需要支持按“销量+好评率”混合排序。如果每次调整都要改代码、重启服务,技术团队将疲于奔命。因此,系统设计必须预留“排序规则动态配置”的能力,例如使用JSON配置权重因子,实现无需发版即可生效。

{"like":2, "comment":3, "share":5}

二、 技术选型:“扛亿级”的工具组合

需求明确后,下一步是选对工具。很多同学的第一反应是“用Redis ZSet”,但在真实复杂的亿级场景下,技术选型需要更细致的考量。下面这组核心工具的组合,直接决定了系统的性能天花板。

1. Redis ZSet:为实时榜单而生

为什么 Redis ZSet 是实时排行榜的首选?看它的三个核心特性:

- O(logN)的分数更新:

ZINCRBY 命令能原子化更新分数,亿级数据量下依然高效。

- 内置排序能力:数据自动按score排序,无需额外计算。

- 丰富的范围查询:

ZREVRANGE(查TOP N)、ZCOUNT(查分数区间人数)等命令完美匹配榜单需求。

那么,为什么不直接用数据库或搜索引擎呢?对比一下实际表现就很清楚:MySQL的ORDER BY在百万级数据时就会出现性能瓶颈;Elasticsearch虽然支持排序,但其写入延迟和资源消耗远高于Redis。

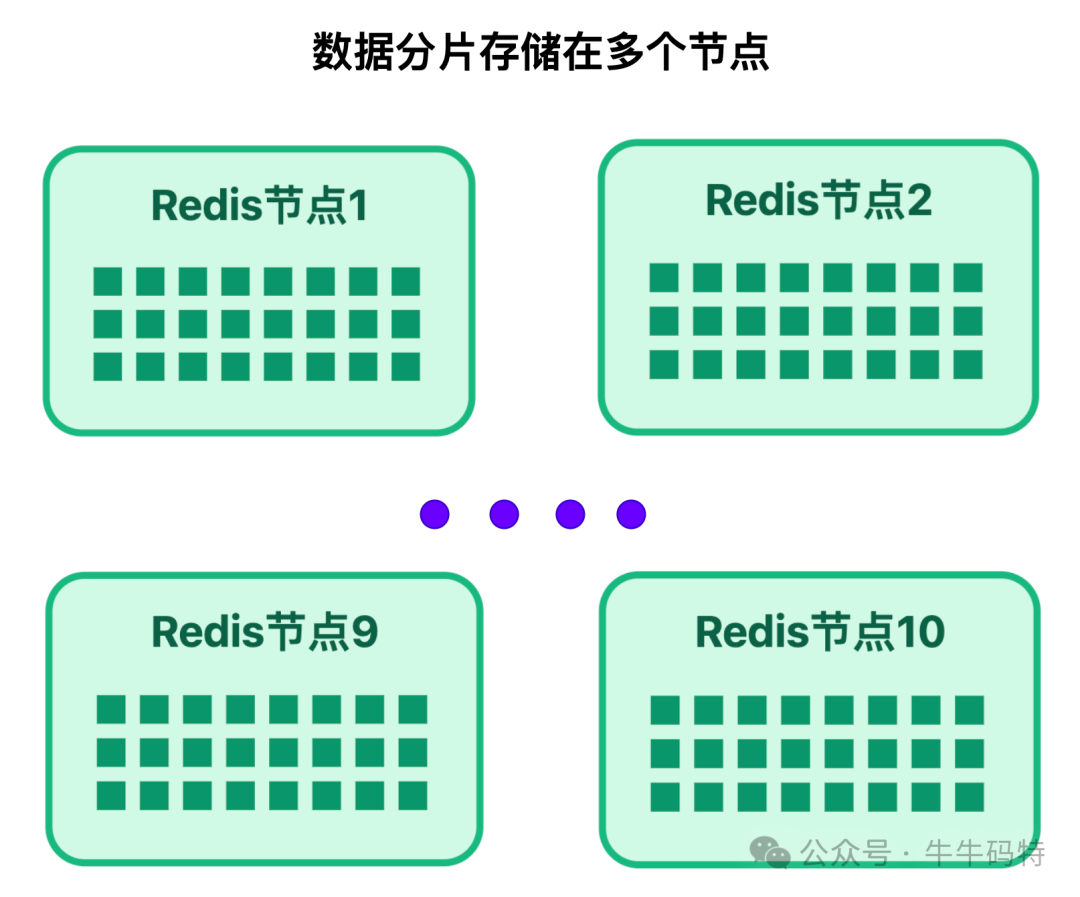

对于90%的实时榜单场景,ZSet的性价比确实很高。但它有一个致命缺点:单Key存储上限。Redis单Key的存储大小建议控制在100MB以内。假设每个用户榜单数据约为16字节,1亿用户的ZSet大小就达到约1.6GB,远超最佳实践,会导致持久化慢、主从同步延迟等问题。

因此,亿级场景必须配合 Redis Cluster 分片,将大Key拆分成多个小Key存储在不同节点。例如,每个分片只存储约100万用户数据(大小约16MB),这符合Redis的最佳实践。

2. 定时任务+分布式计算:非实时榜单的最优解

并非所有榜单都需要实时更新。日销量榜、周热门榜这类“周期结算型”榜单,采用定时任务预计算的方式比实时计算能节省90%的资源。但在亿级场景下,普通的定时任务框架可能力不从心,需要引入分布式计算引擎。

如何在 XXL-Job + 分片执行 与 Spark/Flink 批处理 之间选择?关键在于数据量和计算复杂度:

- XXL-Job + 分片执行:适合数据量中等(千万级)、计算逻辑简单的场景,例如全平台日销量榜。这种方案支持控制台暂停/恢复任务,失败重试策略也很完善。

- Spark/Flink 批处理:适合亿级数据规模、计算逻辑复杂的场景。例如内容热度周榜,需要关联用户画像和时间衰减因子,Spark的DataFrame API能够高效处理这类多表关联计算。

实际项目中建议采用分层计算策略:对实时性要求高的核心日榜使用XXL-Job,而对资源成本敏感的历史月榜则安排在凌晨时段使用Spark批处理。

3. 多存储体系:冷热数据的分层存储

Redis适合存储热数据(如实时榜、近7天榜单),但历史数据需要长期存储且成本更低。因此,需要构建多级存储体系。

| 数据类型 |

存储介质 |

存储周期 |

访问延迟 |

月成本(1亿条数据估算) |

| 热数据 |

Redis Cluster |

7天 |

<1ms |

约5万元(100GB内存) |

| 温数据 |

MySQL分表 |

3个月 |

<100ms |

约5000元(100GB SSD) |

| 冷数据 |

ClickHouse/Hive |

永久 |

<1s |

约500元(1TB HDD) |

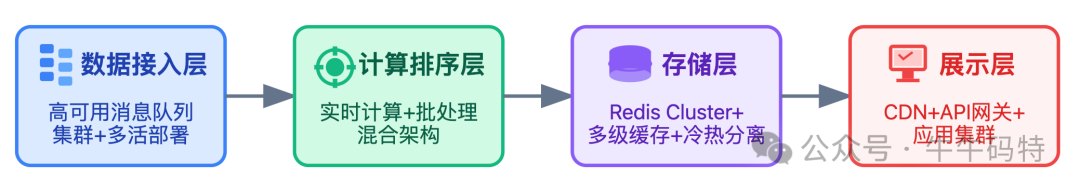

三、 架构拆解:四层核心逻辑

工具选好后,接下来是搭建架构。一个能扛住亿级用户的系统,必然是职责分明的。从用户行为产生到最终展示,整个排行榜系统可以拆分为“数据接入层 - 计算排序层 - 存储层 - 展示层”四层架构。

每层专注于解决一类问题,这样即使流量翻十倍,也能通过分层扩容来应对。

1. 数据接入层:消息队列 + 多活部署

用户的每次点击、购买、点赞都是榜单数据的源头。在亿级场景下,数据接入层的目标是“不丢数据、低延迟、高可用”。单一Kafka集群往往不够,需要采用多活部署 + 异地容灾的策略。

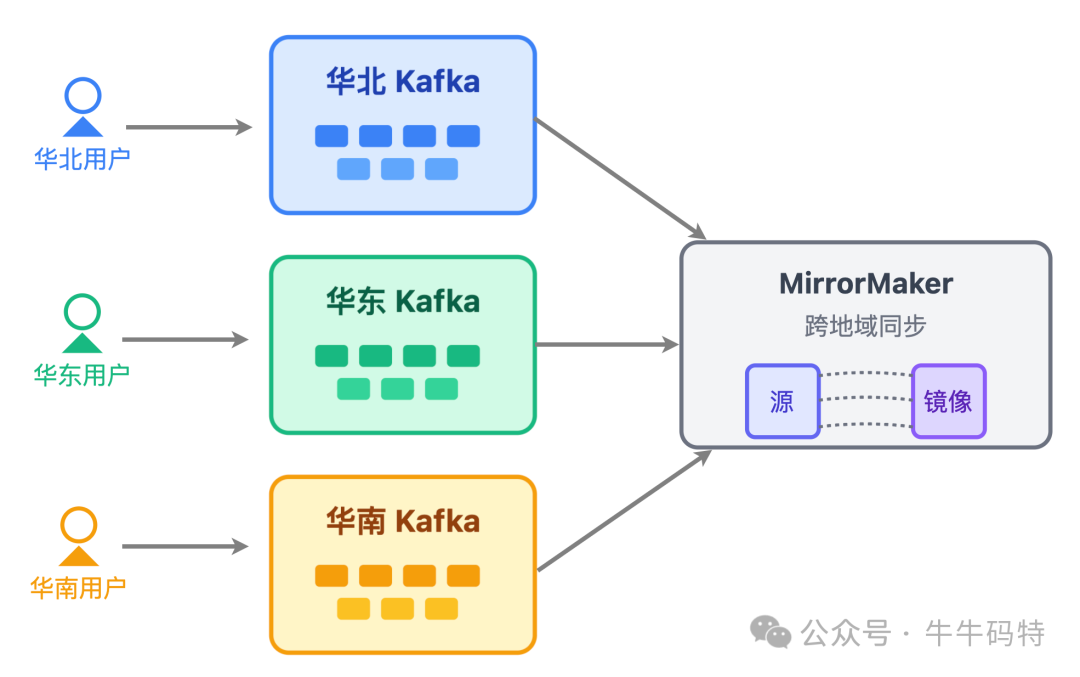

以电商平台的“全国商品销量榜”为例,用户广泛分布于华北、华东、华南三大区域。可以在这三个地域分别部署Kafka集群,用户行为数据直接写入本地集群,然后通过Kafka MirrorMaker工具进行跨地域数据同步。

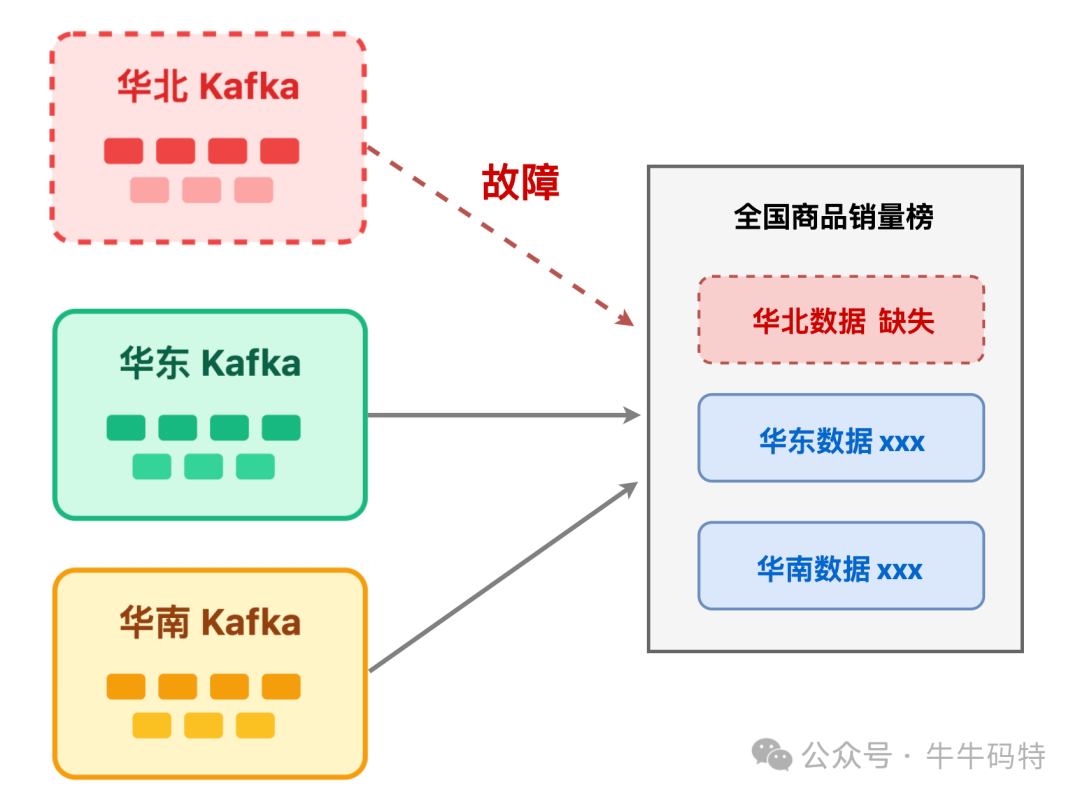

数据接入层消费Kafka中的行为消息后,按照规则计算出商品销量的实时变动,并调用榜单系统的分数更新接口。为什么必须多活?设想一下,如果仅依赖单一集群(如华北),一旦该集群故障,将直接导致全国榜单缺失整个华北区域的数据,严重影响榜单的准确性和公信力。

多活部署能确保任一地域集群出现问题时,其他地域集群仍可正常工作,将RTO(恢复时间目标)控制在可接受的范围内(如5分钟内)。此外,接入层还需做好流量控制(利用Kafka配额机制防范恶意刷量)和死信队列(DLQ)处理(存储处理失败的异常消息,便于后续排查)。

2. 计算排序层:按场景选择混合架构

计算层是排行榜的“大脑”,负责将原始分数转化为有序排名。在亿级场景下,没有万能方案,只有根据具体场景选择的混合架构。

- 实时计算:基于 Lua 脚本的即时计算

适用于游戏战力榜、直播人气榜等更新频率在秒级、数据量中等(千万级)的场景。当用户产生行为后,系统通过执行Lua脚本直接操作ZSet,完成原子化更新。

-- 原子化更新分数并返回最新排名(降序排名,战力高排第1)

local newScore = redis.call('ZINCRBY', 'game_power_ranking:server1', 50, 'user:10086')

local rank = redis.call('ZREVRANK', 'game_power_ranking:server1', 'user:10086')

return {newScore, rank}

// 使用Caffeine更新本地缓存(用户排名与分数)

caffeineCache.put("user:10086:rank", rank);

caffeineCache.put("user:10086:score", newScore);

这种方式既保证了Redis集群中分数更新的原子性,又通过本地缓存提升了后续查询效率。

- 批量处理:Spark + ClickHouse

适用于内容热度周榜、电商月销量榜等更新频率不高(小时级或天级)、但数据量达到亿级的场景。流程通常是:每天凌晨,Spark从Kafka消费全量行为数据,结合多维度算出最终分数,批量写入ClickHouse,再同步到Redis ZSet供查询。

- 混合计算:Flink 实时处理 + 批处理

适用于需要兼顾“实时+历史”双维度的榜单,例如综合热度榜。用户刚产生的行为由Flink实时计算为“实时分”;每天凌晨,Spark批处理任务核算“历史分”(如7天前的数据权重衰减);最后按预设权重(如实时分占70%,历史分占30%)算出综合分,写入Redis ZSet完成排序。权重比例可预先存在Redis的Hash结构中,方便灵活调整。

3. 存储层:Redis Cluster + 多级缓存 + 冷热分离

存储层是排行榜的“数据底座”,需要同时满足查询快和成本省的需求,核心依靠Redis Cluster分片、多级缓存、冷热分离三大策略。

- Redis Cluster分片:分而治之

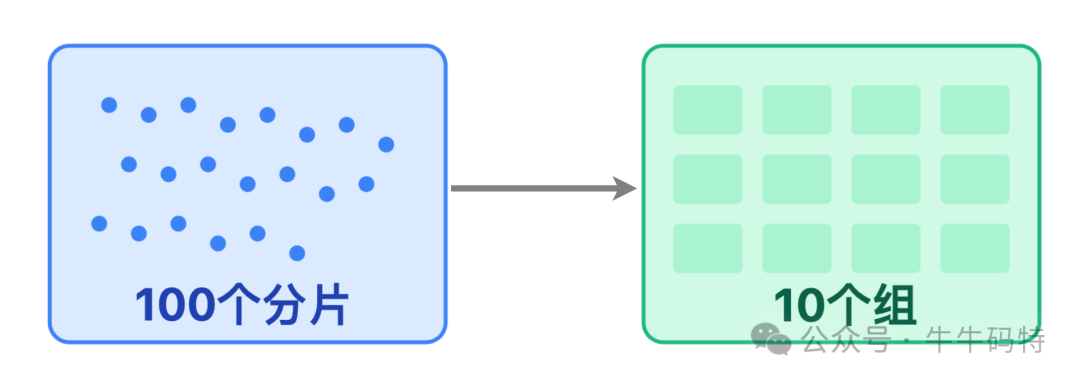

面对亿级数据,我们按用户ID哈希分片。例如,将数据均匀分成100个分片,每个分片存储约100万用户数据(约16MB)。再将这100个分片分散到10个Redis节点上,每个节点负责10个分片。未来数据增长时,只需增加节点即可实现横向扩容。

- 多级缓存:让查询层层加速

大多数用户只查看热门内容或自己的排名。我们可以用“三级缓存”分层承载查询:本地缓存(Caffeine)存储TOP20榜单,1分钟刷新,承载90%的首页查询;Redis Cluster存储TOP1000榜单及个人分数,5分钟刷新;ClickHouse/MySQL存储历史榜单和完整排名,按需查询。

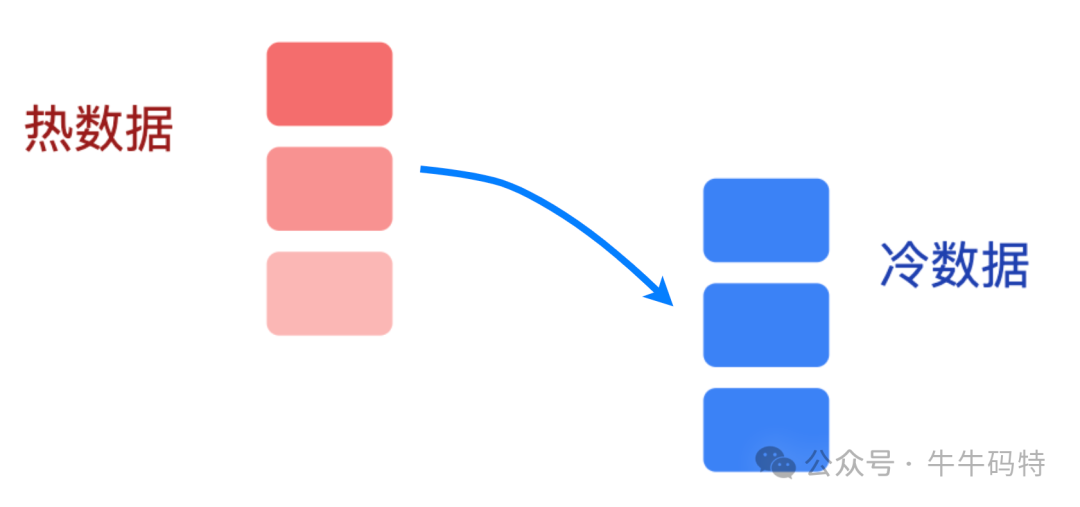

- 冷热分离:给 Redis 减负

Redis内存成本高,而超过7天的数据查询频率会大幅下降。因此,可以每周日凌晨执行一次“冷热数据迁移”:将超过7天的数据从Redis同步到ClickHouse,成功后删除Redis中的历史数据,仅保留索引。迁移过程需保证“双写一致性”:先写ClickHouse,成功后再删Redis,避免数据丢失。

4. 展示层:CDN + API 网关 + 应用集群

展示层直接面对用户请求,核心目标是实现“毫秒级响应、全球低延迟、扛住高并发”。亿级场景下,需要CDN、API网关、多地域应用集群三者配合。

- CDN 加速静态榜单

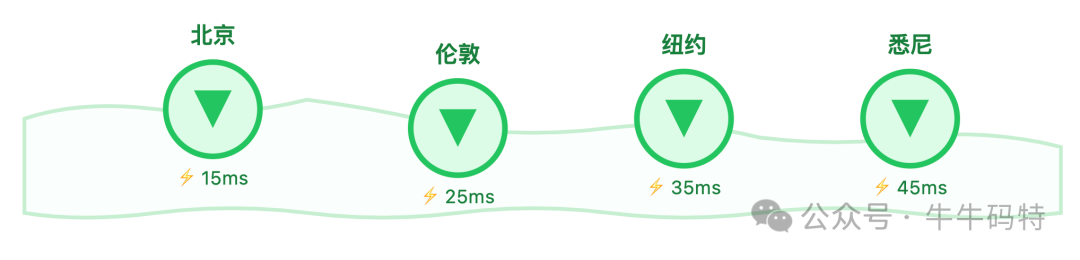

对于首页TOP20这类高频访问的榜单,可以预先生成静态JSON文件,通过CDN分发到全球节点。用户可以从最近的节点获取数据,延迟可控制在50毫秒以内。缓存有效期设为1分钟,并利用API网关的主动刷新机制,在数据更新时同步CDN缓存。

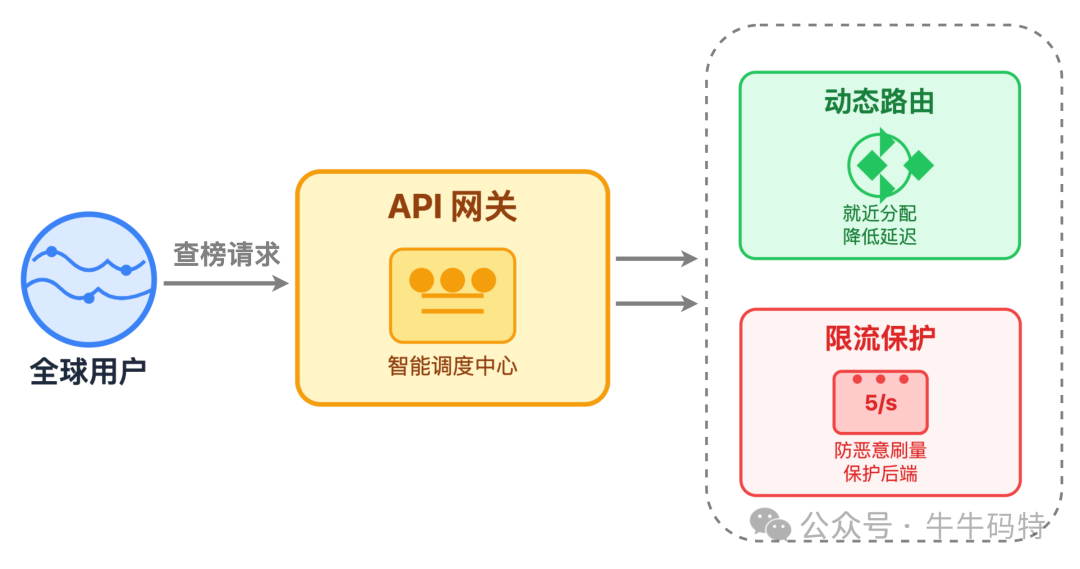

- API 网关动态路由与限流

全球用户的查榜请求先汇总到API网关。网关主要做两件事:一是动态路由,根据用户地理位置将请求转发到最近的应用集群;二是限流保护,为单个用户或IP设置访问速率上限(如5次/秒),防止恶意刷量冲垮后端服务。

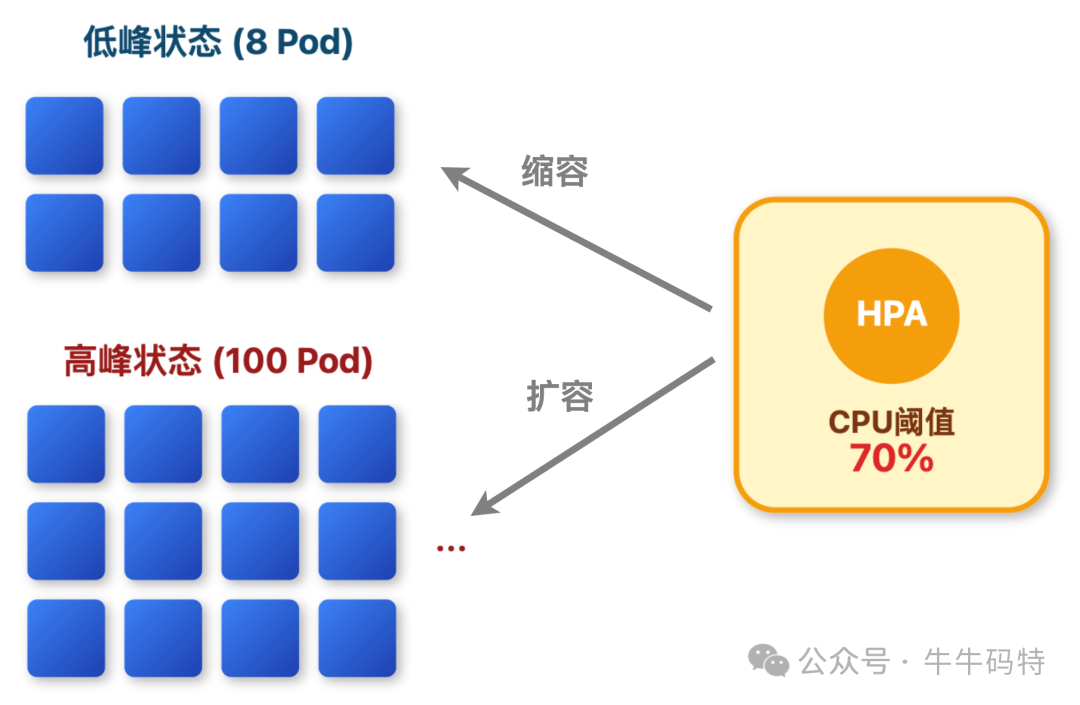

- 应用集群弹性扩容

应用集群基于Kubernetes部署,并配置HPA(水平Pod自动扩缩容)策略。例如,设定CPU利用率70%为阈值:当流量高峰CPU超标时,集群自动扩容Pod(例如最多到100个);流量低谷时,自动缩容(例如最低保留8个),在保障服务能力的同时避免资源浪费。

四、 关键实现:亿级场景的避坑指南

基础架构搭好后,系统或许能运行,但未必扛得住亿级流量。以下这些关键实现细节,决定了系统从“可用”到“优秀”的差距。

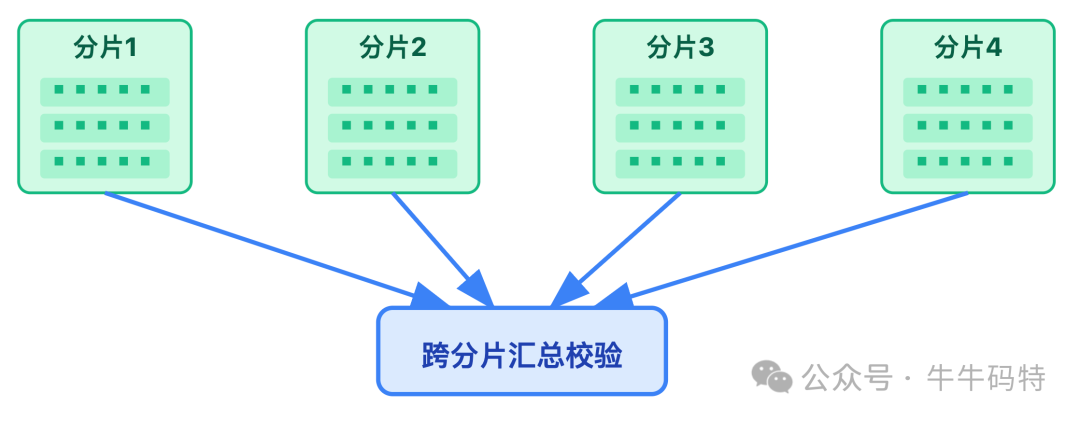

1. 跨分片查询:从慢合并到预计算加速

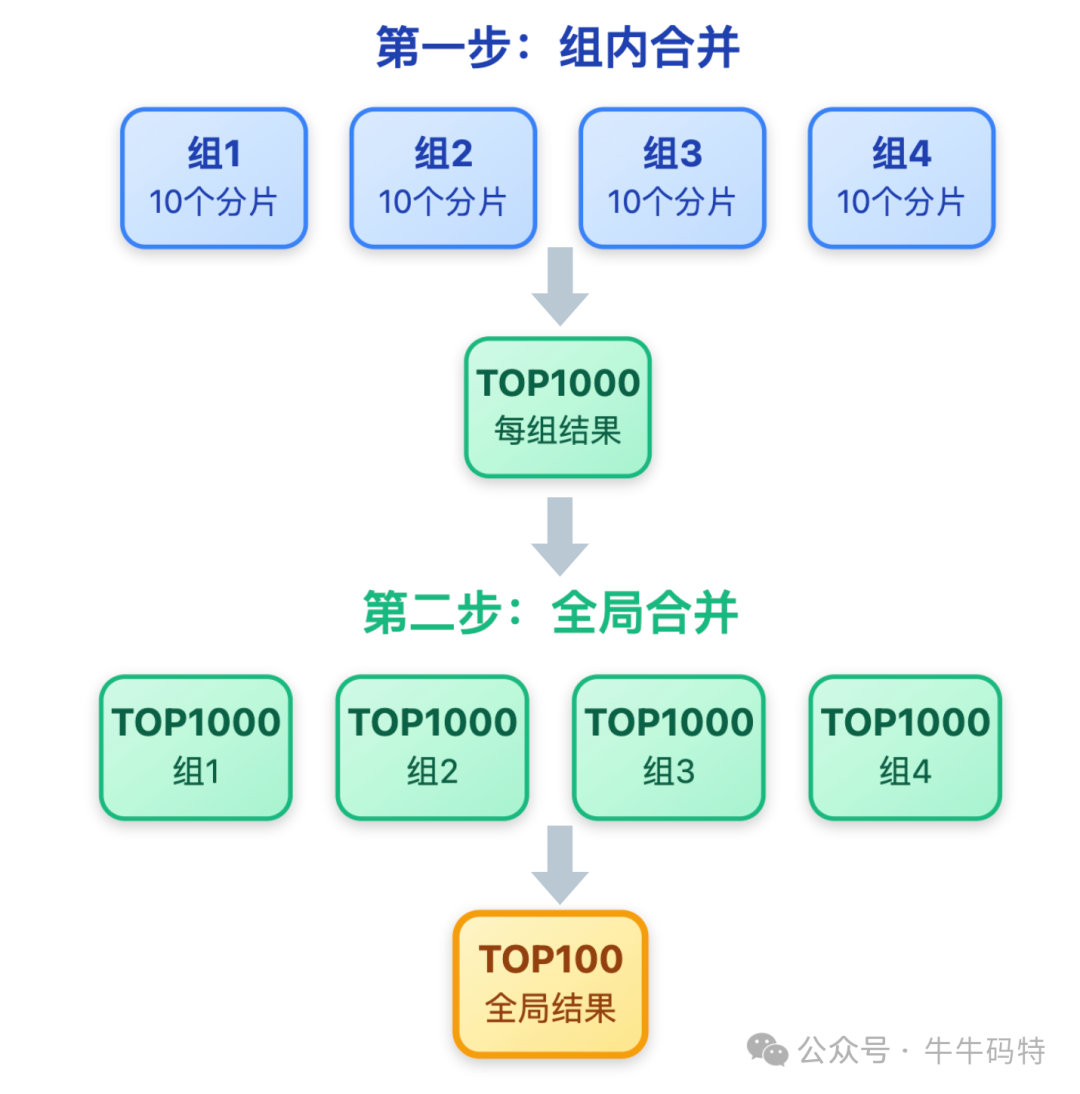

查询全服TOP100榜单时,最朴素的做法是从100个分片中各取TOP100,得到10000个候选结果后再合并排序。这在亿级场景下耗时巨大,无法满足“秒开”需求。优化方案如下:

- 预计算候选集:每个分片每5分钟预计算并缓存TOP1000数据。合并时从每个分片取TOP1000,得到10万个候选结果,这能有效避免“某个分片内排名101的用户,实际可能是全局TOP100”的情况。

-

分布式合并计算:在应用层使用小顶堆(PriorityQueue)合并候选结果。但10万条数据合并耗时约30ms,加上100次Redis查询(每次约5ms),总耗时可能超过500ms,依然不理想。

-

终极优化 — 分层合并:先将100个分片按逻辑分组(例如10个组,每组10个分片)。第一步在组内合并,算出每个组的TOP1000;第二步再合并10个组的TOP1000,得到全局TOP100。组内合并可在Redis Proxy层完成,这样应用层只需发起10次查询,总耗时能降至80ms以内,满足性能要求。

2. 数据一致性:从最终一致到可追溯

在亿级分布式场景下,追求绝对一致性成本过高,但必须保证“最终一致+可追溯”。具体通过三层策略实现:

- 实时数据一致性:

- 单分片内:使用Lua脚本保证“查询+修改”的原子性,防止高并发下的脏数据。

- 跨分片间:允许短暂不一致,但需启动定期对账任务(如每天凌晨),比对各分片总分并自动修复偏差。

3. 监控告警体系:亿级系统的可观测性

让亿级系统“黑盒运行”等同于裸奔。必须构建完善的监控告警体系,覆盖分片健康度、数据一致性和性能指标。

- 分片健康度监控:监控每个Redis分片的QPS、内存使用率、P99/P999响应时间。一旦任一指标触及阈值(如QPS>1万、内存>80%、P99>100ms),立即告警。同时监控分片迁移速度,防止迁移超时。

五、 总结:亿级排行榜的设计心法

设计亿级用户排行榜,本质上是对“实时性、准确性、成本、可用性”进行四重权衡。记住以下6个核心原则,无论在面试还是实战中都能游刃有余:

- 大 Key 必须分片,小 Key 优化存储:单ZSet存不下亿级数据,必须使用Redis Cluster按哈希分片;对非热门数据启用ziplist等紧凑编码。

- 实时用 Redis+Lua,批处理用 Spark/Flink:根据数据更新频率和计算复杂度,合理选择实时或批处理架构,甚至采用混合计算模式。

- 跨分片查询分层合并:通过预计算、分组、分层合并等策略,将耗时的全局查询优化到毫秒级响应。

- 多级存储控成本:构建热、温、冷数据分层存储体系,在保证性能的同时有效控制存储成本。

- 数据一致性可追溯:通过单分片原子操作、定期跨分片对账、完整的行为日志体系,保证数据的最终一致性与问题可追溯性。

- 监控容灾不可少:建立覆盖分片健康度、数据一致性、用户体验的全链路监控与告警体系,并设计多活容灾方案,确保系统的高可用性。

最后,当你在面试或实际工作中面对“如何设计排行榜系统”这个问题时,不要再简单地回答“用Redis ZSet”。首先,深入理解业务场景和核心指标;然后,给出一个包含数据接入、计算、存储、展示以及监控对账在内的完整分层架构方案。这才是体现你真正系统设计能力的关键。希望这篇来自云栈社区的深入解析,能为你构建高并发、高可用的分布式系统提供清晰的思路和实用的参考。