当模型性能提升遭遇瓶颈,或是研究工作的创新点不够突出时,引入一个设计精巧的「空间注意力模块(Spatial Attention Module, SAM)」往往会带来意想不到的效果。它不仅仅是一个性能提升的“工具”,更能为你的论文构建一个强有力的叙事核心。

在引言部分,你可以直指传统卷积神经网络(CNN)“平等对待”所有空间区域的痛点,提出“让模型学会聚焦关键特征区域”的优雅思路,这能立刻提升研究的立意和深度。

在实验部分,SAM本身就是绝佳的消融实验对象,可以用扎实的数据证明其贡献度。而其最直观的优势——可视化热力图,能够清晰揭示模型到底“在看哪里”,真正做到一图胜千言,为论文提供了极具说服力的可解释性证据。

这使得整个工作的叙事逻辑,从简单的“堆叠更多网络层数”转向了“构建更智能的模型结构”。SAM正是实现这一范式转变、让你的研究脱颖而出的关键所在。对于希望深入探索模型可解释性和性能优化的研究者,可以在云栈社区的智能计算与数据板块找到更多相关资料与讨论。

此外,我们也梳理了一份经典与前沿的空间注意力即插即用模块合集,涵盖了从基石性工作到轻量化优化的多种方案,供大家参考学习。

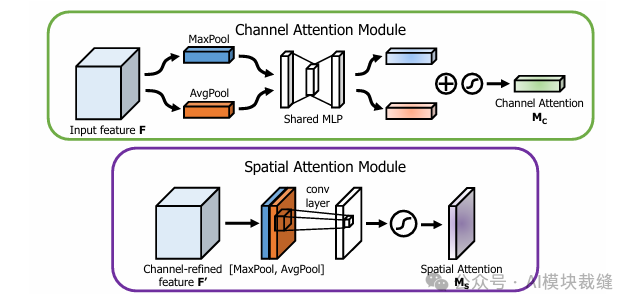

论文:CBAM: Convolutional Block Attention Module

内容:这篇论文提出了卷积块注意力模块(CBAM),它是一个轻量级且通用的注意力模块,可以无缝集成到任何CNN架构中。CBAM通过顺序应用通道(Channel)和空间(Spatial)两个子模块,来学习“看什么”和“看哪里”。其核心贡献在于,它将3D特征的注意力过程分解为两个独立的1D(通道)和2D(空间)注意力图生成过程,不仅大大减少了计算和参数开销,还通过实验证明了通道和空间注意力的互补性与有效性,使得注意力机制的集成变得异常简单高效。

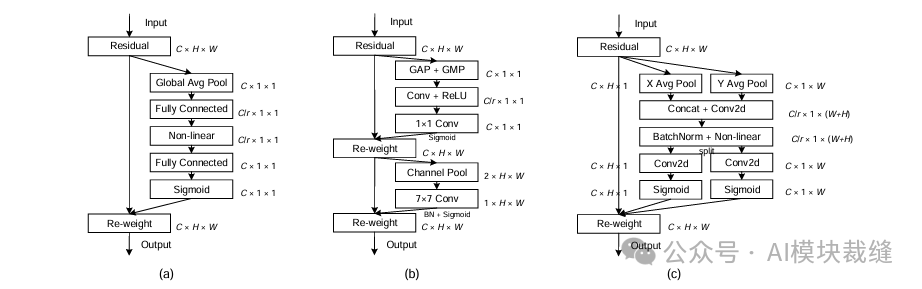

论文:Coordinate Attention for Efficient Mobile Network Design

内容:这篇论文提出了一个专为移动网络设计的坐标注意力(Coordinate Attention)模块,旨在高效地捕捉具有精确位置信息的长程依赖关系。与传统空间注意力通过2D全局池化压缩空间信息不同,该方法创新性地将通道注意力分解为两个并行的1D特征编码过程,分别沿着水平和垂直方向聚合特征。这一核心贡献使得模型能够在一个空间方向上捕获长程依赖,同时在另一个方向上保留精确的位置信息,生成一对方向感知和位置敏感的注意力图,极大地增强了轻量级网络对目标结构的感知能力。

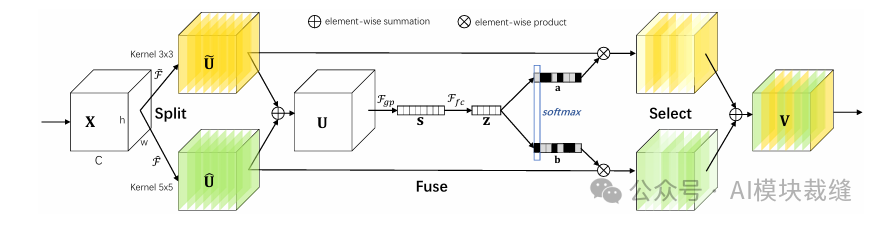

论文:Selective Kernel Networks

内容:这篇论文提出了选择性核(Selective Kernel, SK)单元,这是一种在CNN中实现动态感受野选择的全新机制。SK单元通过一个“分裂-融合-选择”(Split-Fuse-Select)策略,让每个神经元能根据输入信息自适应地调整其感受野大小。其核心贡献在于,它首次将“软注意力”机制引入到多分支卷积核的选择中,通过Softmax函数为不同尺寸的卷积核(对应不同感受野)分配权重,从而非线性地融合多尺度信息。这种动态调整机制,让网络能够更灵活地处理不同尺度的目标,显著提升了模型的性能,其思想也被后续许多人工智能领域的动态网络研究借鉴。

总而言之,空间注意力机制及其各类变体,如SAM、CBAM等,已经成为现代深度学习模型,尤其是计算机视觉和Transformer架构中提升性能与可解释性的重要组件。它们以微小的计算代价,为模型注入了“聚焦”与“思考”的能力。如果你对这类模块的具体实现、对比实验或在不同任务上的应用感兴趣,欢迎在云栈社区的技术论坛中继续深入交流。 |