简单来说,通义千问 Qwen 3.5 正式发布了一系列主打“低能耗、高性能”的小尺寸模型,从 0.8B 到 9B 不等,实现了在手机等设备上的离线流畅运行。

阿里通义千问团队近日推出了 Qwen 3.5 的“小模型全家桶”,包含 0.8B、2B、4B 和 9B 四个版本。官方用 “More intelligence, less compute” (更智能,更少算力)来概括这次发布的核心目标。

这不仅仅是将模型参数做小,而是针对不同应用场景进行了优化:

- 0.8B / 2B:强调响应速度,专为智能穿戴等对功耗和延迟极度敏感的设备设计。

- 4B:被定位为“多模态基础模型”,这意味着它具备较强的图文理解和复杂指令遵循能力,非常适合作为轻量级 Agent(智能体) 的核心。

- 9B:虽然只有90亿参数,但其性能在多项基准测试中已开始挑战参数规模大得多的模型。

这种小模型方案的优势在于,对于翻译、摘要等常见任务,开发者无需调用庞大的云端模型,从而节省电力、成本和响应时间。

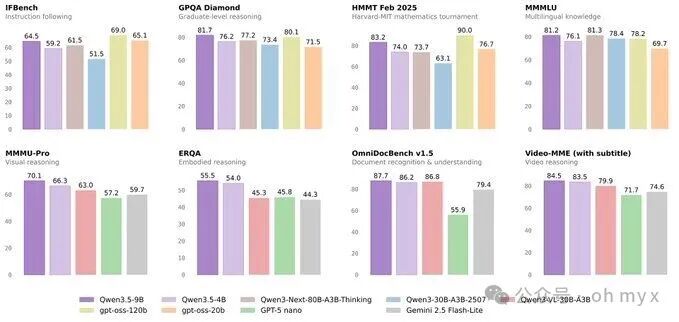

性能基准测试:小身材也有大能量

根据官方发布的基准测试数据,Qwen 3.5 系列小模型在多项评测中表现抢眼。下图展示了 Qwen 3.5-9B 等模型在 iFBench、MMLU、MMMU-Pro 等多个维度的性能对比。

真正的端侧运行:手机离线体验

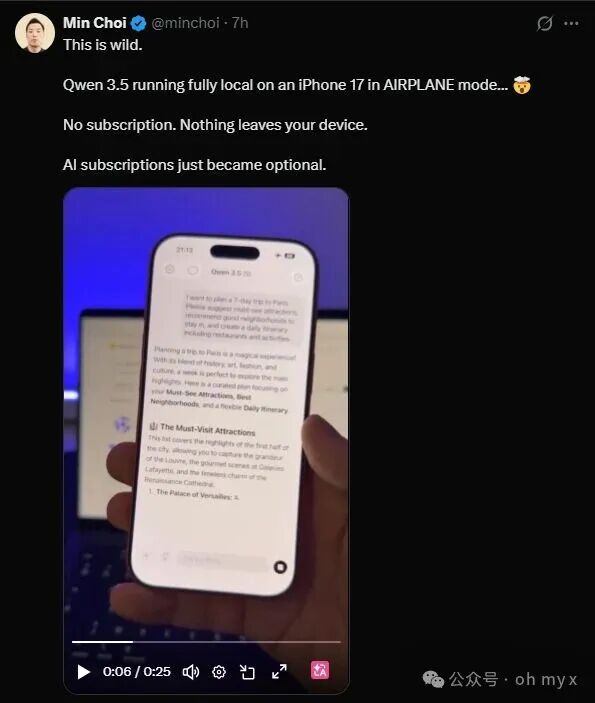

最令人印象深刻的是其实用性。用户 @Min Choi 在社交平台上分享了一段演示视频,在 iPhone 17 的飞行模式下,成功离线运行了 Qwen 3.5 模型,完成了复杂的旅行规划任务。

整个过程无需订阅、无需联网,所有数据都在设备本地处理。这标志着 人工智能 能力正以前所未有的方式走向个人设备端。

这一进展为开发者打开了新的想象空间。你可以将智能体部署在手机、平板甚至物联网设备上,在保护用户隐私(数据不离端)的同时,提供实时、低延迟的智能服务。对于关注前沿 开源项目 和实践的开发者来说,这无疑是一个值得深入探索的方向。如果想了解更多关于模型部署、性能优化或相关实战经验的讨论,可以到 云栈社区 与同行们一起交流。 |