用了OpenClaw一段时间后,我发现它已经悄然改变了我日常的消费决策逻辑。

最近想买运动手表,当我纠结于品牌时,脑子里闪过的第一个念头竟然是:它支持接入OpenClaw吗?如果不支持,那我就不买了。这个念头本身也源于OpenClaw——它帮我制定了健身计划并每日提醒,但每次锻炼后,我需要手动输入数据反馈给它,非常麻烦。如果能将手表数据直接同步,让它自行分析记录,指导将更精准全面。

这时我意识到,选购硬件的关键因素已变成:它是否“OpenClaw Ready”,其API能否被Agent轻松调用。

OpenClaw热潮持续数月,对硬件产品的影响正集中显现。从机器狗、机械臂到AI眼镜、耳机、手表,乃至开发者DIY的开源机器人,越来越多的设备开始主动拥抱OpenClaw。

在这一新架构下,OpenClaw的角色已超越软件工具,更像是一个AI的操作系统。它负责理解任务、规划行动、调用工具,而各类硬件设备则成为其感知与执行的物理器官。我们观察到,一个松散但快速爆发的“OpenClaw硬件”生态正在浮现。

OpenClaw改变智能硬件

可穿戴设备,变为Agent的移动入口

商业设备中,最先接入OpenClaw的是各类可穿戴产品。

以智能眼镜品牌Rokid为例,它上线了“自定义智能体”功能。开发者可通过SSE(Server-Sent Events)协议,将眼镜接入本地部署的OpenClaw。作为AI眼镜,它拥有摄像头、麦克风和显示系统,能持续采集第一视角信息。

理论上,当OpenClaw接入眼镜的智能体接口后,眼镜就变成了采集视觉和语音的接口,OpenClaw负责理解与决策,再将结果返回给用户或调用工具。这意味着OpenClaw能实时理解用户所见的世界。例如,站在陌生城市街头,眼镜捕捉街景,OpenClaw可识别环境、查询信息并规划路线。

类似的尝试也出现在李未可AI眼镜上。根据官方描述,用户可通过眼镜语音直接调用OpenClaw指挥AI操控电脑,远程处理邮件、撰写日报、调取文件等,让眼镜成为一个随身的智能指挥中心。

另一个案例是近期完成融资的光帆科技,其推出的AI耳机与手表也接入了OpenClaw。用户通过耳机说“帮我订明天去上海的机票”,设备将语音发送给OpenClaw,由Agent自动完成搜索、比价、下单等一系列操作,最终结果可展示在手表屏幕上。

在这个路径里,耳机和手表更像是AI Agent的输入入口和展示界面,共同扮演着AI在物理世界的移动数据入口角色。

OpenClaw上身机器人

将OpenClaw接入机器人、改变其操控方式的案例也在迅速增多。

例如,具身智能公司维他动力的Vbot机器狗。传统架构中,机器狗多依赖预设程序或简单遥控。但接入OpenClaw后,其能力发生质变:它能理解任务,而不仅仅是执行固定指令。

用户只需语音下达指令,如“去客厅巡逻一圈”、“帮我看看门口有没有人”,OpenClaw便会完成理解指令、规划任务、调用机器人控制接口,最终由机器狗执行。在此过程中,OpenClaw充当任务大脑,机器狗则成为执行身体。

类似的案例还出现在机械臂领域,如松灵机器人的七轴机械臂。开发者将其接入OpenClaw后,可直接用自然语言描述动作,例如“抓取左侧的杯子”,OpenClaw会自动生成可执行代码脚本,规划路径并控制机械臂完成动作。理论上,开发者可创建“焊接”、“搬运”等自定义Skill,让机械臂具备特定领域的专家能力。

借助AI,不仅是软件开发,硬件应用也正变得“动动嘴”就能实现。如果说过去的机器人是自动化设备,那么接入OpenClaw这类Agent后,它开始更像一个能理解任务的“助手”。这也是让许多开发者兴奋的一点:AI Agent正在首次拥有真正的物理执行能力。

真正的想象力来自开源生态

然而,真正推动OpenClaw生态迅速扩张的,并非商业公司,而是充满活力的开源开发者社区。

在GitHub上,已有大量开发者用OpenClaw控制各种开源硬件设备,如DIY机器狗、树莓派机器人、Jetson AI机器人、智能家居系统等,呈现出百花齐放的景象。

一系列小型开源项目的涌现,正在为“AI硬件”打开更大的想象力。

例如,有开发者将OpenClaw连接到成熟的开源机器人项目Reachy Mini上,实现在Telegram等软件上远程语音操控其执行复杂动作,甚至无需编写代码。OpenClaw可读取机器人传感器数据(如摄像头画面),并发送控制指令(如转头、识人)。

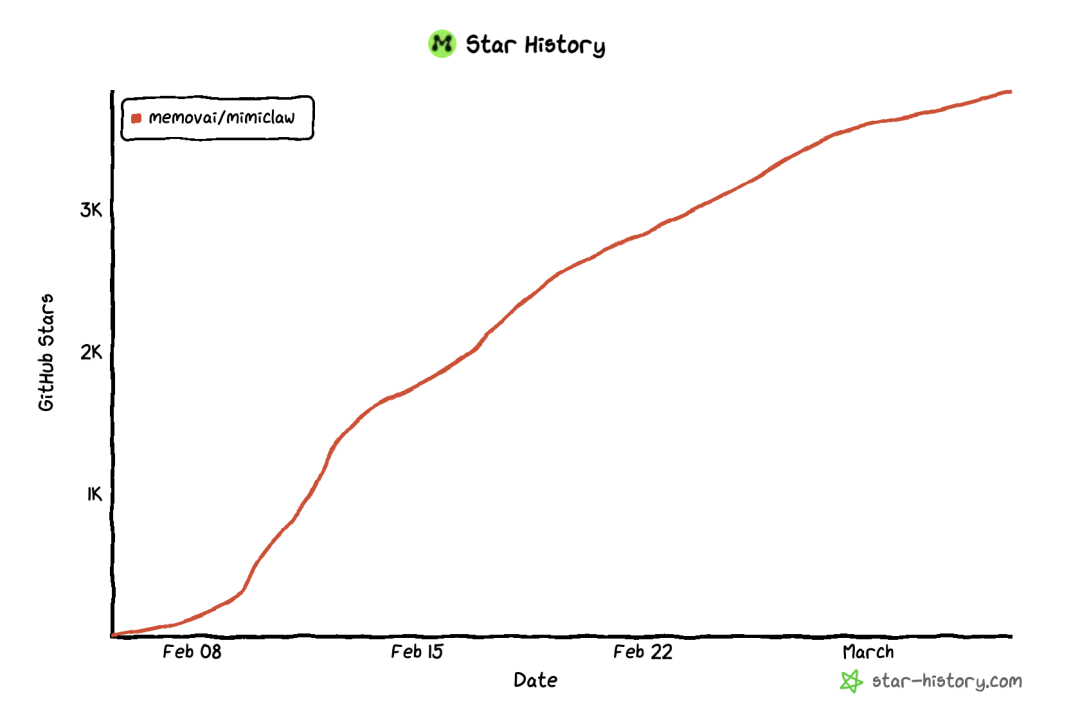

近期另一个亮眼项目是MimiClaw。这个由中国开发者创造的项目,能将OpenClaw塞进成本仅约10元的ESP32开发板上。它采用纯C语言开发,无需Linux操作系统或Node.js环境,可直接在单片机上运行。

用户可通过Telegram等通讯软件与之对话,调用云端大模型。MimiClaw具备本地记忆系统(Markdown文件存储)、工具调用和自主调度等能力。这使得用户无需昂贵设备也能体验到实体版OpenClaw。它实际上为大众消费品级别的智能硬件打开了全新可能性。

或许,一个更低成本、高自主、强隐私、且硬件Agent之间能够互联的智能硬件时代即将开启?这无疑是开源生态蓬勃生命力的最佳证明。

OpenClaw之后,「AI硬件」的5个趋势预测

OpenClaw的魅力在于它提供了一个开放的Agent框架,让各种硬件都能接入同一个“智能大脑”。于是,机器狗成为AI的腿,机械臂成为AI的手,眼镜成为AI的眼睛。

将最近这波硬件接入潮置于更长时间维度看,它带来的可能不仅是一个开源框架的流行,更可能引发智能硬件角色的深刻变革。从硬件形态、交互方式到产业分工,新趋势已隐约浮现:

-

智能硬件将变得更主动,效能空前提升

OpenClaw具有强主动性,当这种主动性连接物理世界,硬件效能也将空前提升。例如接入OpenClaw的Vbot机械狗,可设置命令让其主动与人打招呼,或定时提醒孩子喝水。硬件正从被动的“工具”转变为主动的“伙伴”。同理,未来的智能手表或许能从每日推送一次总结,变为每半小时同步一次数据,从信息提供者转型为用户的陪伴者或建议者。

-

硬件「去中心化」,被AI统一调度

像MimiClaw这样的项目,正让OpenClaw生态向极低成本硬件渗透。未来,更多普通设备可瞬间具备“OpenClaw Ready”能力。硬件主要负责执行,推理算力则调用云端“大脑”。一旦成熟,机器人、可穿戴设备都可能成为Agent的执行节点。例如,AI理解“准备看电影”的模糊指令后,能自动关灯、降帘、开投影。届时,不同硬件可能共享同一云端大脑,实现互联与协同配合。

-

手机可能沦为显示终端之一

过去十年,多数智能硬件依附于手机。但在Agent时代,这种结构可能被打破。当云端AI能借助各种“分布式硬件”直接理解语音、视觉信息时,交互将变得更直接。许多设备不再需要手机作为中介,如车载AI、家庭机器人、全天候可穿戴助手等,它们可直接连接云端Agent。手机可能从“控制中心”退化为众多终端之一。

-

完全独立的硬件品类可能爆发

按照前述推演,未来硬件可能不再是手机的附属品。围绕OpenClaw正涌现大量软硬件用例,甚至催生了如“AI Nas”等过去不存在的需求。当各种新需求被体系化集合,或许将支撑起全新的硬件品类。

-

硬件的核心能力将变为感知能力

在传统智能硬件时代,产品能力取决于设备本身的算力、算法和功能模块。但在OpenClaw架构下,硬件更多负责“感知世界”,而AI Agent负责“理解世界”。未来硬件的核心价值,可能不再是其计算能力,而是感知能力——包括更丰富、精准的传感器输入,以及更贴近真实世界的场景数据。传感器本身的重要性将愈发凸显。

如果说过去十年的核心问题是“如何做出更好的设备”,那么接下来的问题正在转变为:如何让设备接入更聪明的AI。

当Agent系统开始广泛连接传感器、机器人和可穿戴设备,智能硬件不再只是独立的终端产品,更是AI系统与现实世界交互的关键接口。无论是AI硬件的创业者还是开发者,都已身处这场全新的竞争格局之中。

你对OpenClaw硬件生态的发展有何看法?欢迎到云栈社区的开发者广场,与更多技术爱好者交流你的洞见与实践。