大语言模型(LLMs)的迅猛发展,正将多模态推理推向新的高度。不过,你是否注意到,当前大多数方法仍然依赖于预训练的视觉-语言模型(VLMs)来孤立地编码“图像-文本”对?它们往往忽略了现实世界中多模态数据之间天然存在的、丰富的关联结构。

这促使研究者们将目光投向了多模态图(Multimodal Graphs, MMGs) 推理。在这种图结构中,每个节点都兼具文本和视觉属性,而边则清晰地描绘了它们之间的结构化联系。

要在保留图拓扑的前提下,利用 大语言模型 实现对异构多模态信号的有效推理,我们主要面临两大核心挑战:

- 跨模态一致性薄弱:图像与文本特征难以有效对齐。

- 异构模态偏好:图中不同节点可能更依赖视觉或文本信息,如何让模型自适应地“看懂”这种偏好?

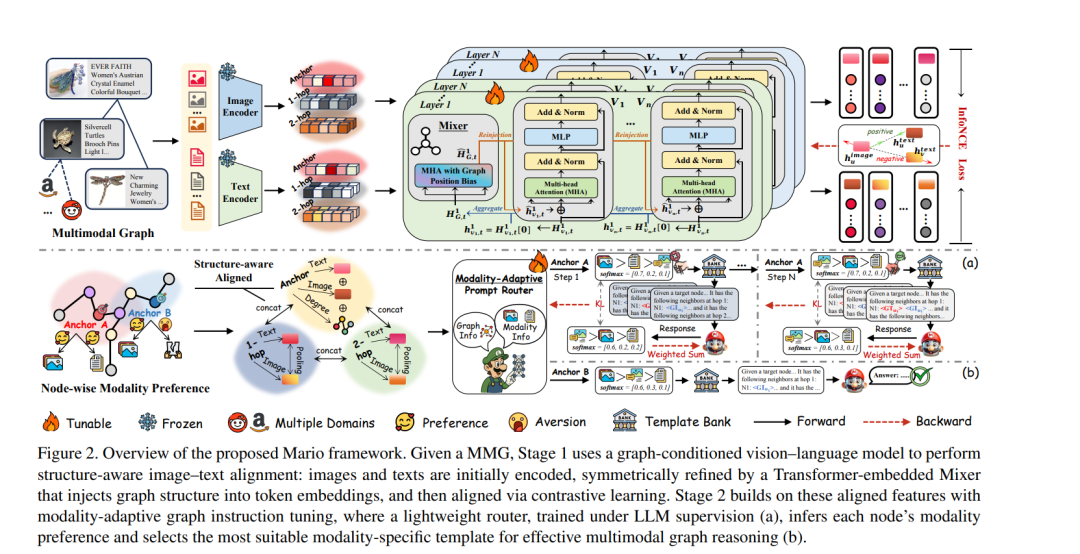

为同时解决这两大难题,研究团队提出了 Mario 框架。这是一个旨在实现高效多模态图推理的统一解决方案。Mario 的核心设计包含两个创新阶段:

- 图条件化 VLM 设计:这一阶段旨在解决跨模态一致性问题。它通过图拓扑结构来引导细粒度的跨模态对比学习,从而协同优化文本与视觉特征,让模型在理解内容的同时“感知”到图的结构关系。

- 模态自适应图指令微调机制:这一阶段则专注于处理模态偏好问题。首先,将对齐后的多模态特征组织成图感知指令视图(graph-aware instruction views);然后,利用一个可学习的轻量级路由器,为图中的每个节点及其邻域,智能筛选出对大语言模型最具信息量的模态配置模板。

研究团队在多个多模态图基准测试上进行了广泛实验。结果表明,无论是在节点分类还是链路预测任务中,也无论是监督学习还是零样本(zero-shot)场景下,Mario 的表现都持续优于现有的先进图模型。

这项研究展示了结合 图论 思想与大语言模型在多模态理解上的巨大潜力。据称,相关代码未来将在 开源实战 平台的项目地址公开,这对于希望深入该领域的研究者和开发者而言,无疑是个好消息。如果你想了解更多前沿的AI技术解析与实践,不妨关注 云栈社区 的后续更新。 |