一个改变语音合成的技术突破

你有没有想过,输入一段对话脚本,AI 就能生成两个人自然交谈 90 分钟的播客音频——不是机械的电子音,而是有停顿、有情感、能互动的真实对话。

微软刚开源的 VibeVoice 做到了。

它解决了什么实际问题

传统文本转语音工具存在三个明显短板:

长度受限

市面上的语音合成工具,生成超过 5 分钟就开始出现音质下降、韵律混乱的问题。

单人局限

想做多人对话场景?只能分段生成再拼接,效果往往不自然。

响应速度慢

等待几十秒才出第一个字,实时对话场景根本无法使用。

VibeVoice 针对这些痛点给出了系统性解决方案。

核心技术架构

微软研究院在语音合成领域做了一次技术创新。

超低帧率设计

传统语音模型使用 50Hz 帧率,VibeVoice 采用 7.5Hz——计算量直接降低 85%,但音质保持稳定。

实现方式是双 Tokenizer 架构:

文本输入 → 语义 Tokenizer(理解内容)

↓

声学 Tokenizer(控制音色)

↓

扩散解码(生成音频波形)

σ-VAE 压缩技术

声学 Tokenizer 采用变分自编码器,实现 3200 倍压缩率。90 分钟音频的特征表示,只需要传统方法 1/3200 的存储空间。

Next-Token Diffusion 机制

基于 Qwen2.5 大模型,用扩散模型逐 token 生成。这让长序列生成保持稳定,不会出现"跑偏"。

两个版本的差异化定位

| 模型版本 |

参数规模 |

核心能力 |

适用场景 |

| VibeVoice-1.5B |

15 亿 |

90 分钟长文本、4 人对话 |

播客制作、有声书、访谈节目 |

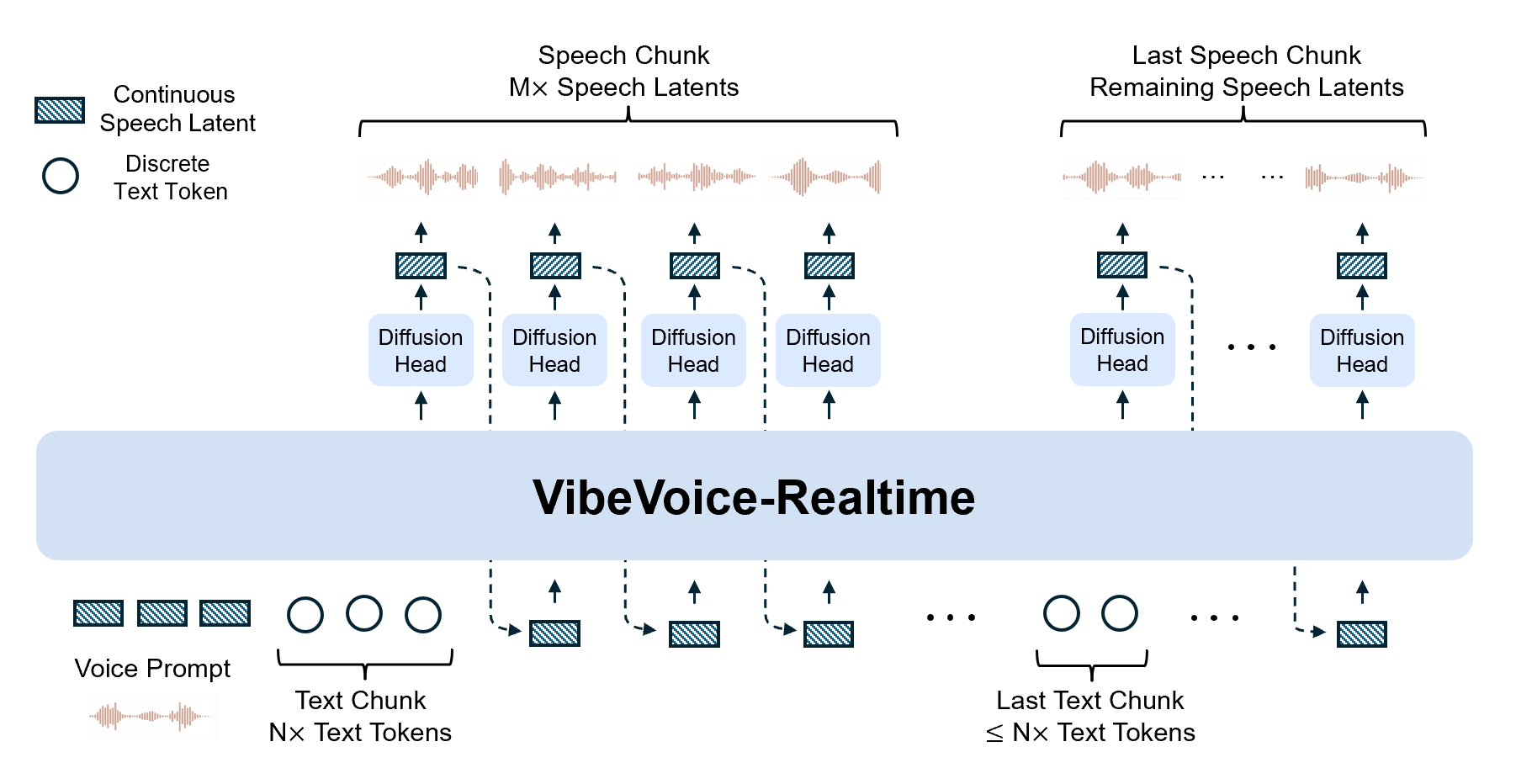

| VibeVoice-Realtime |

5 亿 |

300ms 首字延迟、流式输入 |

实时客服、语音助手 |

长文本版本适合内容创作场景,生成质量接近真人录制。

实时版本针对交互场景优化,300 毫秒首字延迟,普通笔记本电脑就能运行。

快速上手实践

从零到生成第一段音频,实测只需 5 分钟。

基础语音生成

from vibevoice import VibeVoiceRealtime

import soundfile as sf

# 加载模型

model = VibeVoiceRealtime.from_pretrained(

"microsoft/VibeVoice-Realtime-0.5B"

)

# 生成语音

text = "大家好,今天分享一个语音合成项目"

audio = model.generate(text)

# 保存音频文件

sf.write("output.wav", audio, 24000)

多人对话场景

conversation = [

{"speaker": "主持人", "text": "欢迎收听本期节目"},

{"speaker": "嘉宾", "text": "很高兴参加这次分享"}

]

for turn in conversation:

audio = model.generate(

text=turn["text"],

speaker=turn["speaker"]

)

代码逻辑清晰,上手门槛不高。

实际应用场景

内容创作方向

- 自媒体播客制作,降低录音成本

- 有声书批量生产,制作成本降低 90%

- 短视频配音,支持批量生成

企业服务领域

- 智能客服系统,提供 24 小时服务

- 语音通知播报,实现个性化定制

- 会议纪要转换,自动生成语音版本

教育培训场景

- 在线课程配音制作

- 语言学习材料生成

- 有声教材批量制作

云栈社区( https://yunpan.plus )实测发现,这些场景都能快速落地。

性能表现数据

在 RTX 4090 显卡上的实测结果:

- 生成速度:实时率 10 倍(生成 1 秒音频只需 0.1 秒)

- 音质评分:MOS 4.2/5.0(接近真人水平)

- 显存占用:6GB(消费级显卡可用)

- 支持语言:中文、英文

技术栈学习价值

对于求职者来说,这个项目覆盖多个技术方向:

算法层面

- Transformer 架构应用

- 变分自编码器(VAE)实现

- 扩散模型(Diffusion)原理

工程层面

- PyTorch 模型训练流程

- 实时推理性能优化

- 音频信号处理技术

应用层面

- 大模型微调方法

- API 服务设计思路

- 产品落地实践经验

简历上写"基于 VibeVoice 实现语音合成系统",面试时会是个加分项。

使用注意事项

研究用途定位

MIT 协议开源,官方强调研究用途,商业化使用需要谨慎评估。

伦理风险防范

高质量语音合成存在被滥用风险,使用时需遵守相关规范。

语言支持范围

目前支持中英文,其他语言还在开发中。

硬件配置要求

实时版本需要至少 8GB 显存,长文本版本建议 16GB 以上。

为什么值得关注

- 微软官方出品,技术可靠性有保障

- MIT 开源协议,可以自由研究改造

- 完整工程实现,不只是论文 Demo

- 社区活跃度高,1.6k Forks 证明实用性

- 持续更新迭代,团队在快速响应

对于想进入 AI 语音领域的开发者,这是一个不错的学习样本。

技术点评

VibeVoice 的出现,标志着语音合成进入长文本时代。

它不是简单的技术堆砌,而是在压缩率、音质、实时性之间找到了平衡点。双 Tokenizer 架构的设计思路,值得做生成式 AI 的团队参考。

微软选择开源,让更多开发者能站在这个基础上创新。

建议动手跑一遍代码,会对语音 AI 技术有更深入的理解。

关注《云栈开源日记》,每天 3 分钟,带你看最火开源项目

项目资源

GitHub 仓库: microsoft/VibeVoice

官方文档: microsoft.github.io/VibeVoice

技术论文: microsoft.com/en-us/research/articles/vibevoice

Python 学习资源: https://yunpan.plus/f/26

AI 学习资源: https://yunpan.plus/f/29

标签:#VibeVoice #GitHub #微软开源 #语音合成 #AI语音 #深度学习