自Meta发布SAM(Segment Anything Model)分割模型以来,其衍生应用层出不穷。今天为大家介绍一个基于提示词技术、能够生成并动态编辑3D模型状态的实用工具。

工具地址:adam.new/app

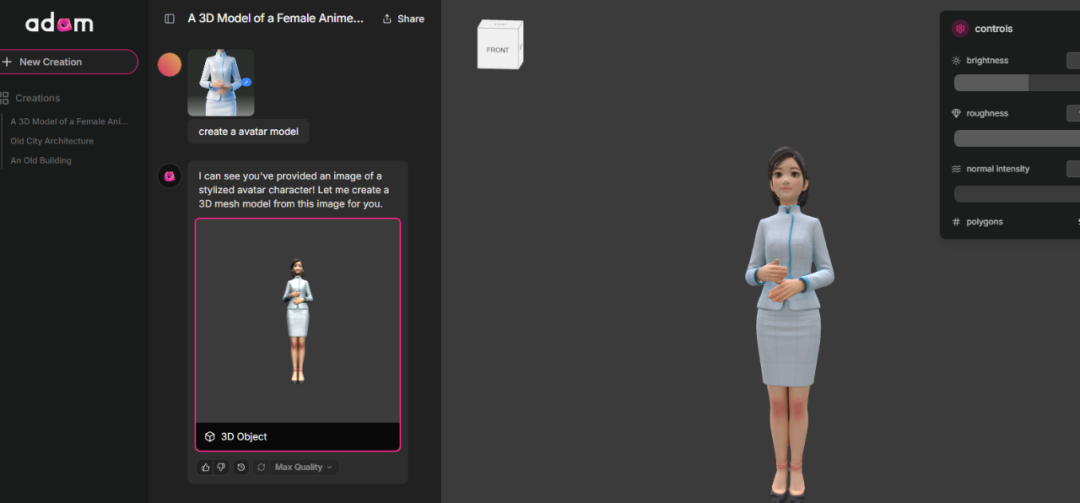

1. 上传图片即可生成3D模型

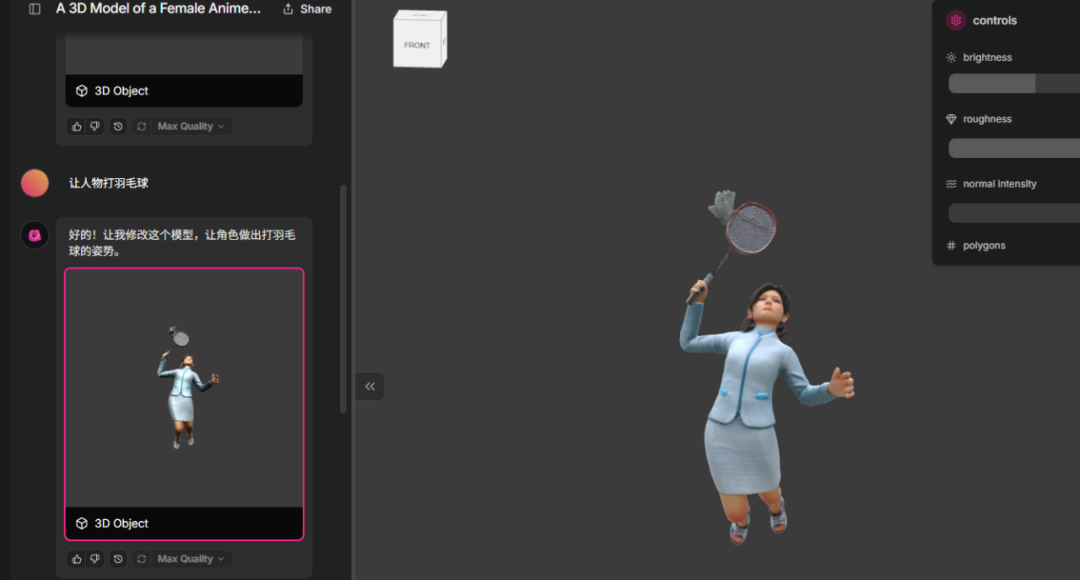

2. 通过提示词动态改变模型动作

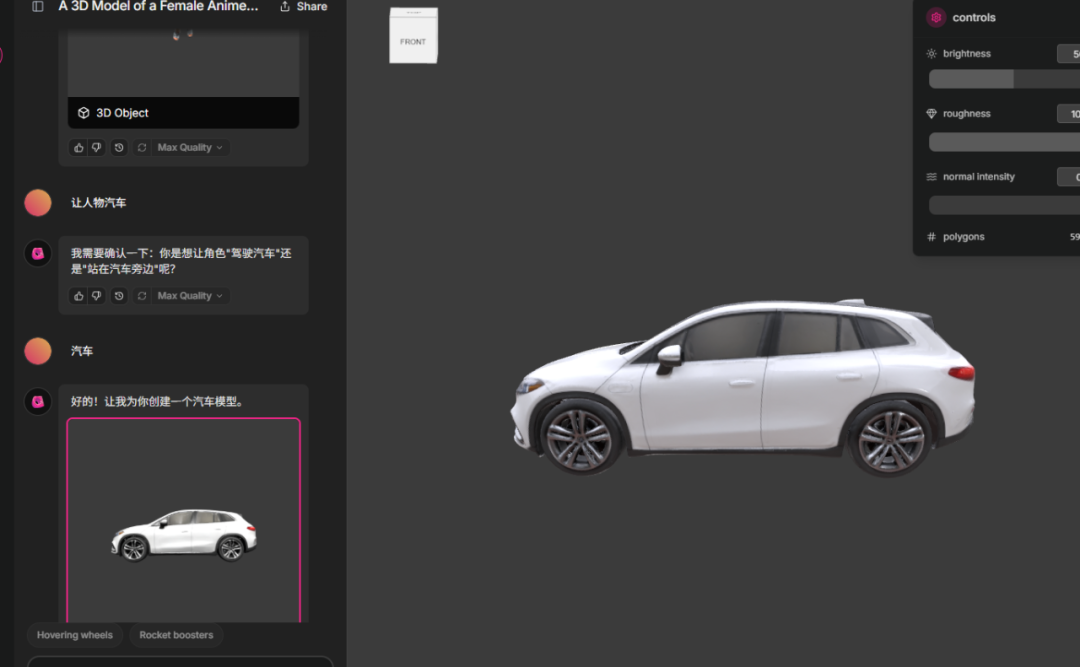

3. 驾驶交通工具等复杂交互

这个工具允许用户发挥无限想象,生成所需的各种3D模型状态,其交互性和可控性远超传统的单次“图生3D”模型。

SAM-3D最初发布时,其输出格式主要为.ply点云模型。如今,得益于社区开发者的贡献,已经出现了能够直接将其转换为完整3D网格(Mesh)模型的工具,例如 https://huggingface.co/spaces/pablovela5620/sam3d-body-rerun。

在需要从照片生成3D人体模型的实际工作中,传统方法要么依赖昂贵的专业设备,要么在生成的手部、脚部等细节上较为模糊,处理流程繁琐。现在,Meta开源的SAM3D Body项目为这一挑战提供了高效的解决方案。它能够从单张照片精准重建包含完整身体、手部和脚部细节的3D人体网格。

该技术基于Momentum Human Rig参数化表示,不仅能准确估计各种复杂的人体姿态,还支持通过2D关键点和遮罩提示进行交互式微调,即使在存在遮挡或多人的复杂场景下也表现稳定。项目提供了DINOv3和ViT-H两种高性能神经网络模型供选择,并且可以与SAM 3D Objects结合使用,构建包含人物与物体的完整3D场景。用户从Hugging Face下载模型后,仅需几行代码即可快速集成使用,非常适合于游戏开发、影视制作、AR/VR内容创作等需要快速、高质量人体3D重建的场景。

目前该工具仍在持续进化中,期待未来能将其应用于生成更复杂的3D人物连续动作。 |