2026年开年,AI行业的疯狂仍在延续。Anthropic凭借Claude Code单月狂揽60亿美元年化ARR,却因算力缺口眼睁睁看着更多收入溜走;即便是发布近2年、已迭代两代的H100,按需GPU租赁价格仍在逆势上涨;谷歌、亚马逊、Meta、微软四大云巨头,2026年资本开支预期集体暴涨,其中谷歌的预期值直接翻倍。

所有人都在疯狂砸钱搭建AI算力基建,但一个无法回避的现实已经摆在眼前:我们正进入ChatGPT诞生以来最严峻的AI硅片全面短缺时代。此前制约行业的CoWoS封装、数据中心电力瓶颈已退居次位,台积电先进制程的晶圆产能、以及HBM内存供应,成了锁死整个AI行业发展的核心生死线。

本文基于SemiAnalysis最新发布的《The Great AI Silicon Shortage》深度报告,拆解这场席卷全球的AI硅荒的底层逻辑,以及它将如何改写AI与半导体行业的未来格局。

一、失控的算力需求:AI正在“吞噬”全球半导体产能

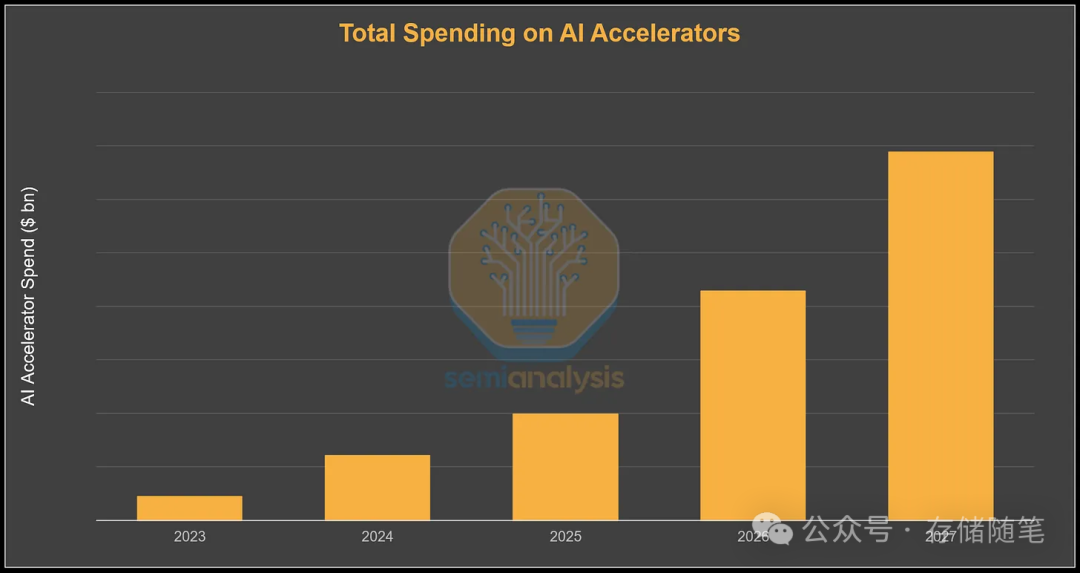

AI算力需求的爆发,已经远超全行业的预期上限。

大模型能力的持续迭代、Agent智能体工作流的规模化落地,直接带动了全网Token需求的指数级上涨。最直观的案例来自Anthropic:2026年2月单月就新增60亿美元年化ARR,核心驱动力是Agentic编码平台Claude Code的全面普及。而Anthropic明确表态:如果能获得更多算力,他们本可以实现更高的收入增长。

这种算力缺口并非个例。当前市场上几乎所有新兴云服务商的小型GPU集群,都已被提前长期锁死,没有任何闲置算力。即便过去几年全球已经完成了史上最大规模的AI基建投入,可用算力依然极度稀缺。

需求的疯狂,直接体现在云巨头的资本开支上。短短6个月,行业对四大超算巨头的2026年资本开支预期全面大幅上调:

- 谷歌:预期上调94%,几乎翻倍,核心投入全部指向数据中心与AI服务器

- 亚马逊:预期上调53%

- Meta:预期上调29%

- 微软:预期上调19%(不含资本租赁)

这些巨头不是不想投入更多资金,而是“有钱也花不出去”——核心制约就是硅片供应。先进逻辑芯片和内存的制造产能,已经完全跟不上AI算力的部署节奏。ChatGPT带火的AI时代,我们先后经历了CoWoS封装短缺、数据中心电力瓶颈,而现在,行业正式进入了核心硅片产能短缺的深水区。

二、核心风暴眼:台积电N3产能,成了AI行业的“生死闸”

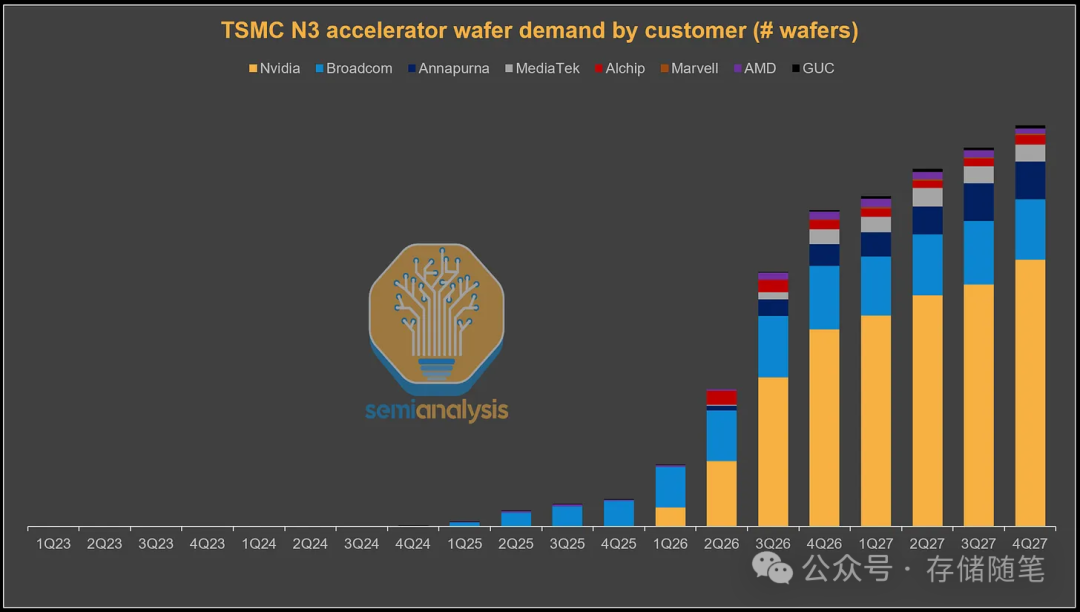

这场硅荒的绝对核心,就是台积电的N3(3nm)制程晶圆产能。

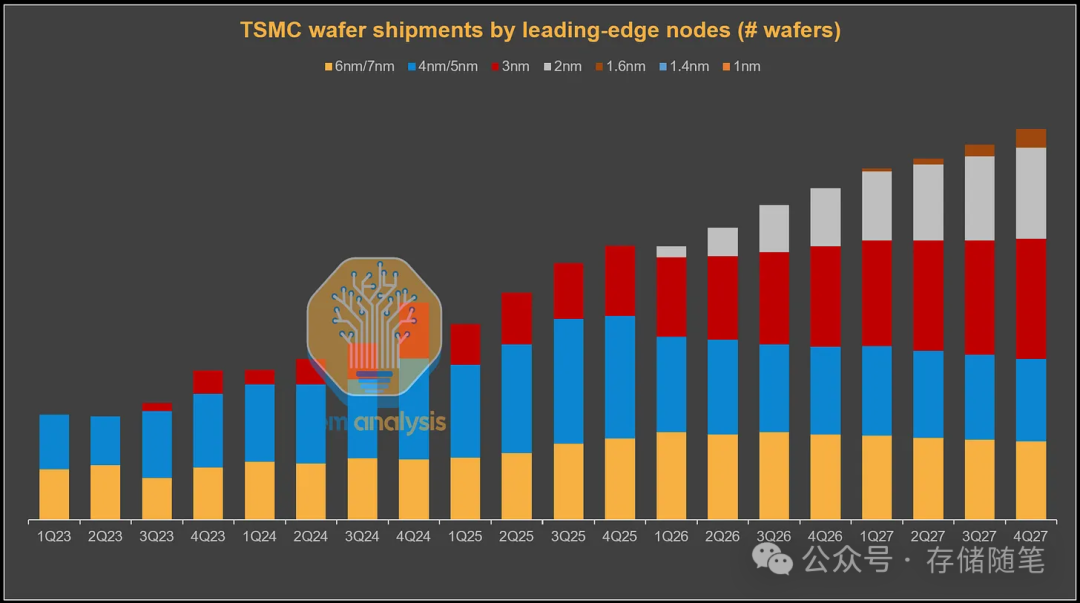

1. 需求结构剧变:AI从“配角”变成N3绝对主力

台积电N3制程家族2023年正式量产,最初的需求几乎全部来自消费电子:苹果M3-M5系列Mac芯片、A17-A19 iPhone处理器,高通骁龙8 Elite系列,联发科天玑手机SoC,以及英特尔Lunar Lake、Arrow Lake客户端处理器,几乎包揽了全部N3产能。

但2026年,行业迎来了决定性拐点:所有主流AI加速器家族,全部转向台积电N3制程,AI将在今年成为N3产能的最大需求方,未来还将持续挤压其他品类的生存空间。

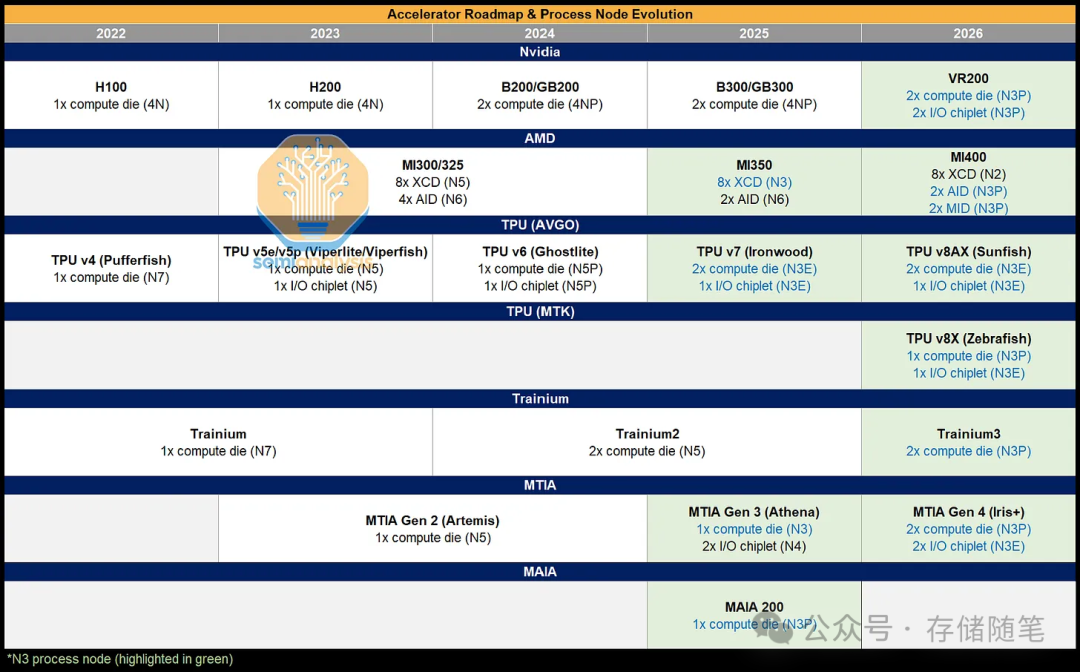

全球AI芯片巨头的技术路线图,已经全面向N3制程收敛:

- 英伟达:从Blackwell架构的4NP工艺,转向Rubin架构的3NP(N3P)工艺,VR200的计算芯粒与I/O芯粒全部采用N3P

- AMD:MI350X已率先采用N3,下一代MI400的AID、MID芯粒继续沿用N3P

- 谷歌:TPU v7起全面转向N3E,2026年TPU出货量将大幅上涨,同时启动下一代TPU v8AX迭代,依然锁定N3制程

- AWS:Trainium3全面转向N3P工艺

- Meta:MTIA Gen4也将采用N3P工艺

不止是AI加速芯片,整个AI算力体系的核心芯片都在涌向N3:VR机架所用的Vera CPU、NVLink 6交换芯片、Tomahawk 6与Spectrum 6等高端网络芯片,甚至Rubin架构带动的200G光DSP芯片,全部需要N3制程产能支撑。

全行业的集中转向,给台积电N3产能带来了前所未有的需求冲击。而台积电显然准备不足:晶圆产能的扩张速度,完全追不上AI需求的暴涨。即便2022年底就开启了史上最大规模的算力建设,台积电的资本开支直到2025年才超过此前的历史峰值,2026年才被迫大幅上调资本开支。而晶圆厂的产能建设周期,注定了远水救不了近火。

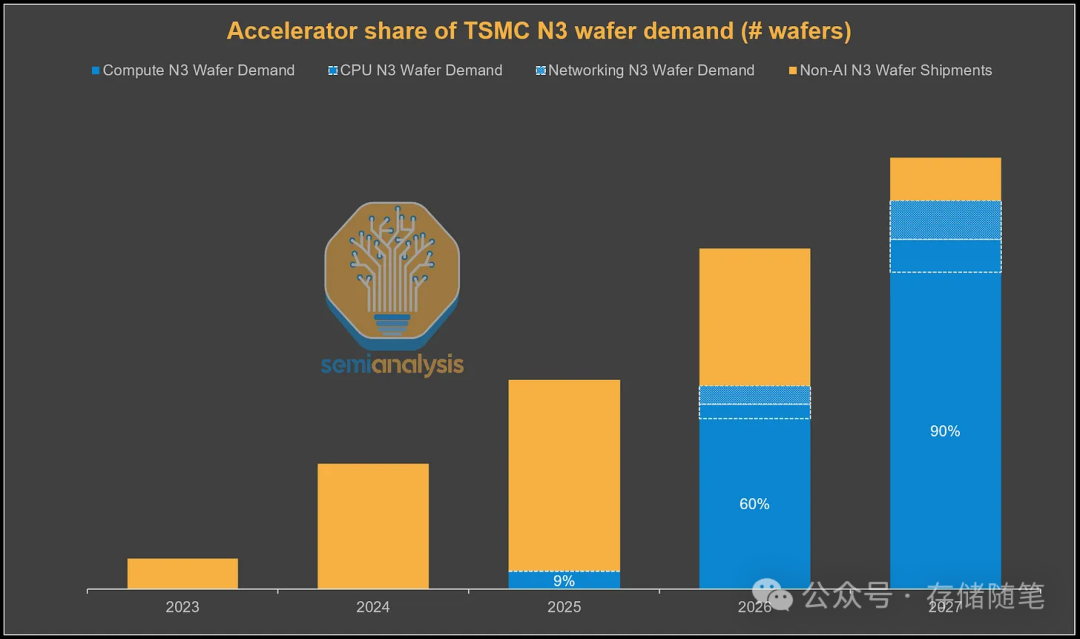

2. 产能挤兑有多残酷?AI今年吃掉60%N3产能,2027年将达86%

用数据可以清晰看到这场产能战争的残酷性:

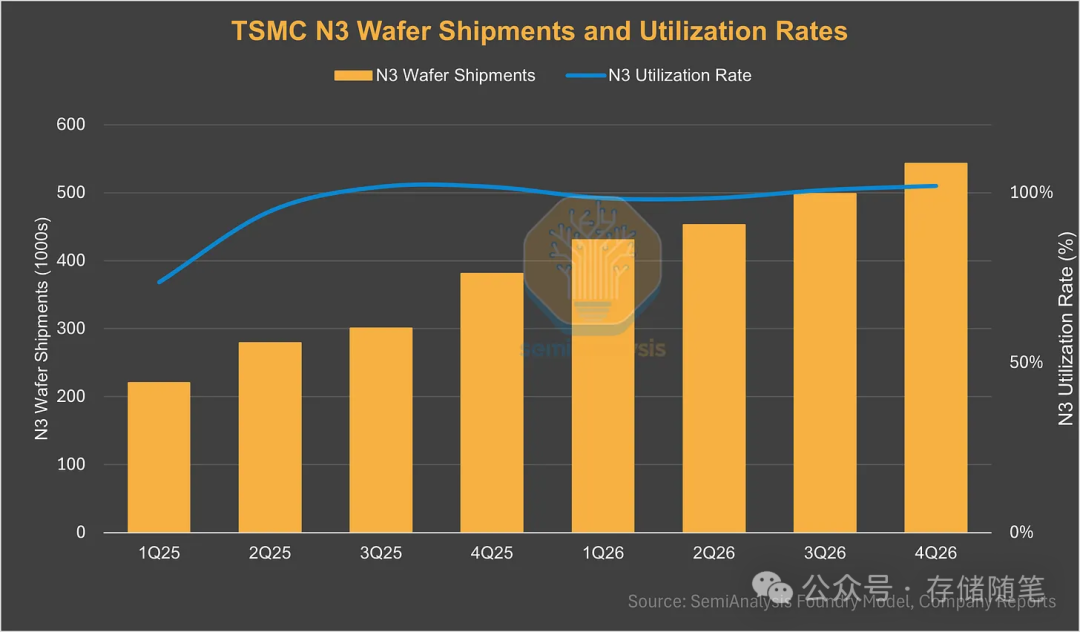

- 2026年,AI相关需求(加速器、主机CPU、网络芯片)将吃掉台积电近60%的N3产能,剩余40%才留给智能手机、PC处理器等消费电子品类,当前产能已被100%拉满,无任何冗余空间。

- 2027年,即便台积电持续扩充N3产能,AI需求占比也将飙升至86%,几乎将彻底挤出智能手机和CPU的N3晶圆需求。

更严峻的是,2026年下半年,台积电N3产能的实际利用率将超过100%——台积电已经把产线拉到物理极限,甚至将部分工艺层转移到其他晶圆厂,只为挤出更多N3产能。但即便如此,未来2年,台积电都无法新增足够产能满足全部需求。

在这场产能争夺战里,台积电手握绝对的“造王权”。2026年,AI基础设施客户将获得明确的产能优先级,全面碾压消费电子。原因很简单:AI加速器芯片的die尺寸更大、封装要求更复杂,带来了更高的ASP;更重要的是,AI需求是台积电当前增长的核心驱动力,AI厂商愿意为产能签下多年长单,不惜一切代价锁定算力。

而消费电子市场已高度饱和,增长空间有限,在产能争夺中完全处于下风。拿不到N3产能的消费电子厂商,要么被迫延长现有产品生命周期,要么只能直接跳过N3,转向下一代N2制程。

3. 唯一的“泄压阀”:智能手机市场的需求下滑

当前N3产能的第二大需求方是智能手机,这也是整个行业唯一能指望的产能释放来源。

目前苹果、高通、联发科等手机厂商的供应链订单,是基于2026年智能手机单位数低增长的预期下达的。但现实是,内存价格上涨已推高手机BOM成本和终端售价,大概率会抑制消费需求。目前已有明确信号显示,2026年智能手机出货量同比可能出现两位数下滑。

而智能手机需求的下滑,将直接释放出宝贵的N3晶圆产能,转向AI加速器。我们可以算一笔关键的账:

- 2026年智能手机N3晶圆开工量预计为43.7万片,若重新分配5%给AI加速器,可额外生产约10万片Rubin GPU,或30万片TPU v7;

- 若极端情况下25%的智能手机N3产能被重新分配,可额外生产约70万片Rubin GPU,或150万片TPU v7。

但这里有一个无法绕开的前提:逻辑晶圆只是AI芯片的一部分,就算有了产能,还需要配套的HBM内存和先进封装,三者缺一不可。

三、第二道枷锁:内存短缺,比产能荒更无解的连锁危机

如果说台积电N3产能是锁死AI算力的第一道闸门,那内存短缺,就是第二道几乎无解的枷锁,且短期内看不到缓解的可能。

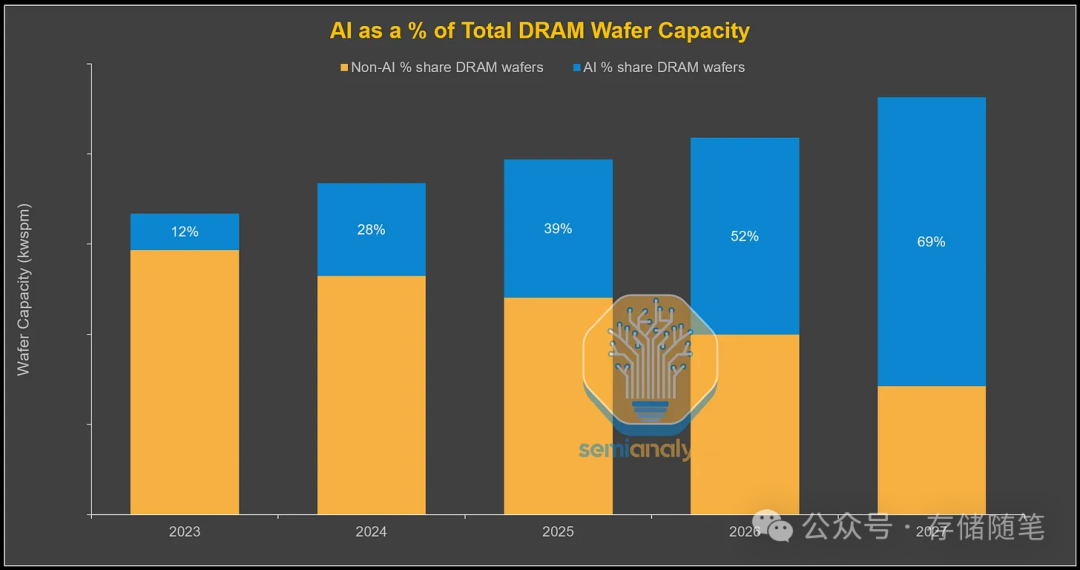

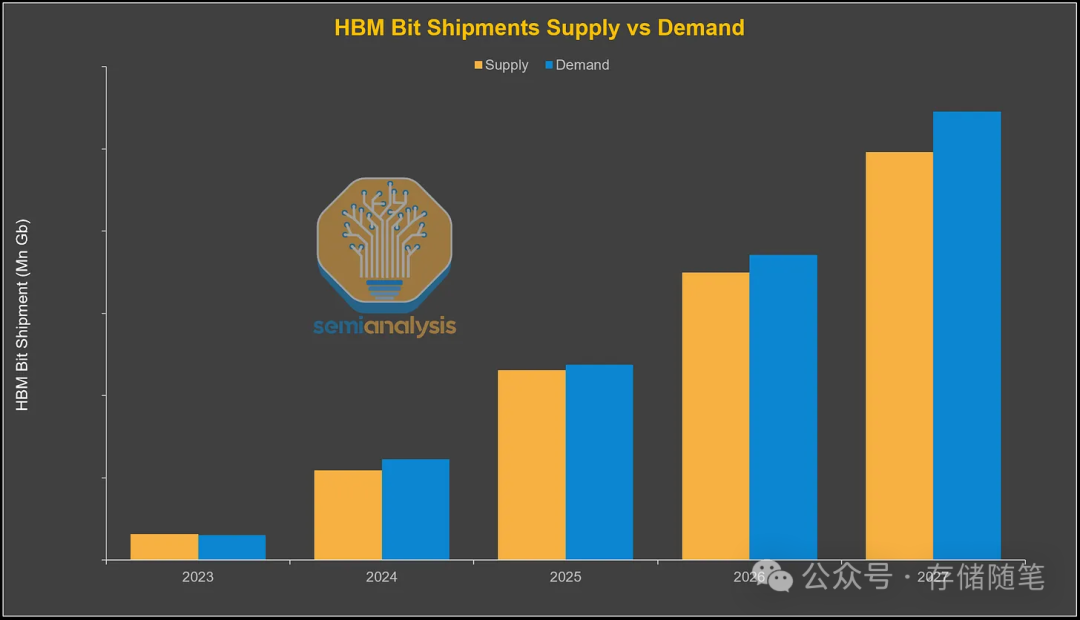

1. HBM正在“吸干”整个DRAM行业的产能

HBM高带宽内存已成为AI加速器的标配,而它对晶圆产能的消耗,是普通DRAM的3倍;2026年行业转向HBM4后,这个差距将扩大到近4倍,未来HBM4E还会进一步拉大。

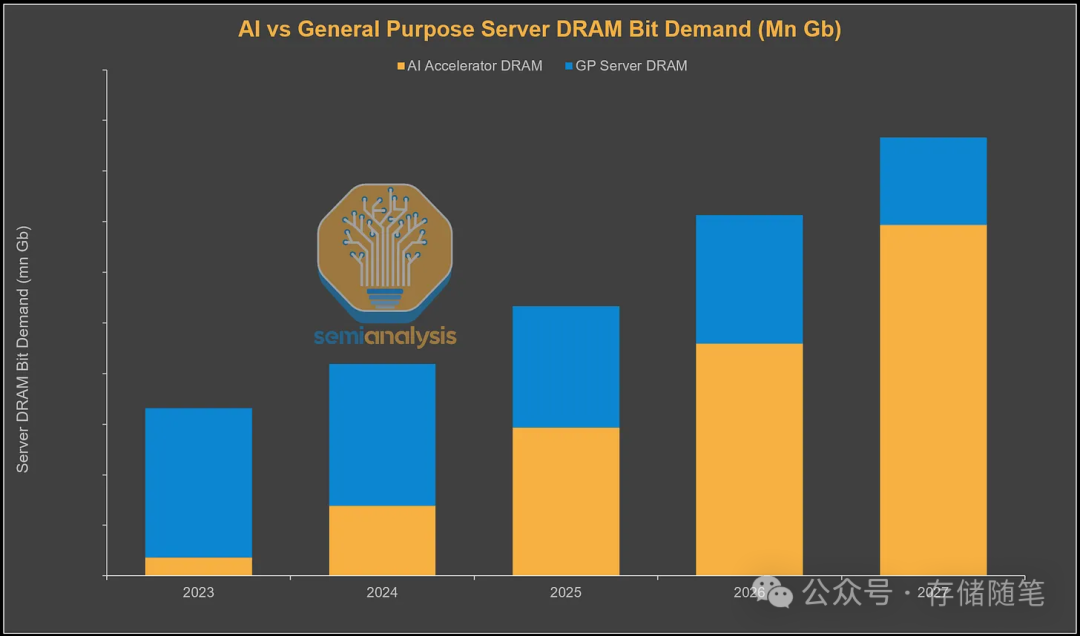

这意味着,HBM的增长,正在以不成比例的方式吞噬DRAM行业的增量晶圆产能,直接挤压普通消费级DRAM的空间。数据显示,AI相关需求占全球DRAM晶圆产能的比例正在飞速攀升:

- 2023年:12%

- 2024年:28%

- 2025年:39%

- 2026年:52%

- 2027年:69%

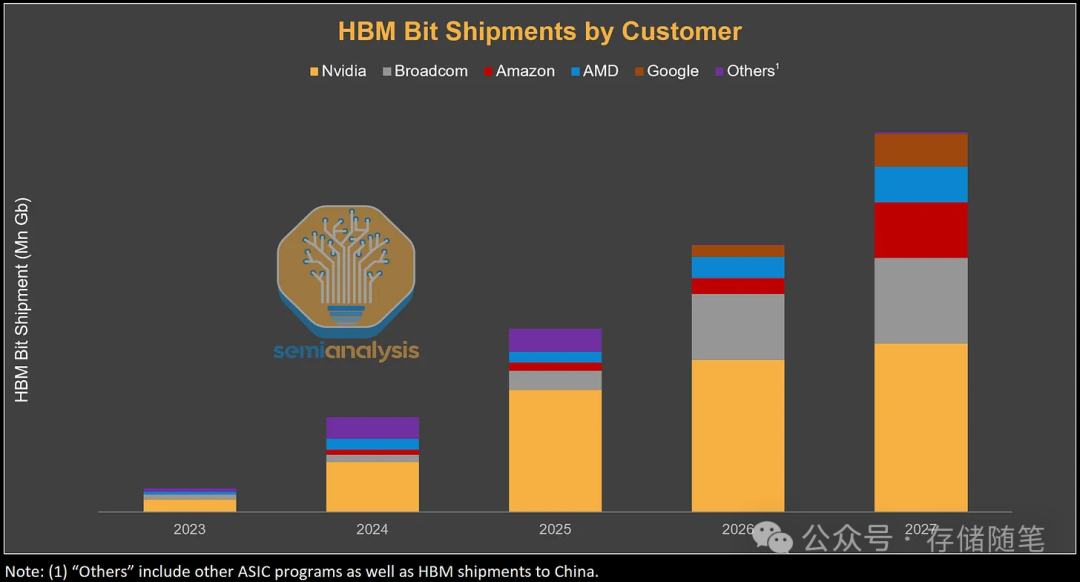

不止是占比提升,单颗AI芯片的HBM容量也在爆发式增长:

- 英伟达从Blackwell到Blackwell Ultra、Rubin,HBM容量提升50%,Rubin Ultra更是直接带来4倍的容量提升;

- 谷歌TPU v8AX、AWS Trainium3,全部从上代的8-Hi堆栈升级到12-Hi;

- AMD从MI350到MI400,内存容量也提升了50%。

HBM比特出货量的暴涨,核心驱动力已不是芯片数量的增长,而是单芯片内存容量的翻倍式提升,这让本就紧张的HBM供应雪上加霜。

2. 性能与良率的矛盾,进一步锁死HBM供应

需求暴涨的同时,HBM的技术门槛还在飞速提升,进一步限制了有效供应。

比如英伟达为HBM4定下了11Gb/s的引脚速率目标,这个规格对内存厂商来说,想要实现可量产的良率难度极大。目前SK海力士和三星在HBM4上的进展相对领先,而美光已经明显落后。

更关键的是,利润逻辑的反转,正在让内存厂商失去扩产HBM的动力。此前HBM的利润率远高于普通DDR DRAM,厂商愿意优先给HBM分配产能;但2026年DDR价格暴涨,其利润率已经接近甚至超过了已签约的HBM订单。

这意味着,AI厂商想要让内存厂商优先保障HBM产能、新增HBM晶圆开工量,就必须支付比当前合同价更高的价格。而这场价格博弈,大概率会在2027年的HBM定价谈判中集中爆发。如果内存厂商最终选择将更多产能转向HBM,那普通DDR DRAM的供应会更加紧张,价格还会继续上涨。

3. 服务器DRAM需求同步暴涨,消费端释放杯水车薪

不止是HBM,服务器级DDR内存的需求也在同步飙升。英伟达下一代VR NVL72机架,单颗Vera CPU的DDR容量达到1536GB,是上代Grace的3倍。同时,老旧的云服务器、企业级服务器进入了长达数年的更换周期,通用DRAM需求也将在2026年迎来拐点。

AI工作流,尤其是数据staging、编排、强化学习,还在持续推高CPU需求,逐步拉高CPU与GPU的配比,进一步放大了服务器DRAM的需求缺口。

唯一的缓解可能,依然来自消费端。测算显示:

- 若2026年消费电子出货量下滑25%,将释放约27690百万Gb的DRAM容量,相当于2026年全球DRAM总需求的7%,几乎等于今年全年80%的HBM需求;

- 但行业基准预期是,消费电子出货量仅会下滑10%-15%,对应的释放量仅占全球DRAM总需求的3%,完全不足以改变当前的供需格局。

而且三星等头部内存厂商,已经将10%-15%的消费端下滑预期纳入了产能分配计划,指望消费端泄压来解决HBM内存短缺,基本不现实。

四、CoWoS不再是核心瓶颈,供应链格局迎来大洗牌

很多人还在关注先进封装的短缺,但现实是:CoWoS封装虽然依然紧张,但已经大幅缓解,不再是制约AI算力的核心瓶颈。

原因很简单:前端晶圆产能才是根本。如果没有前端的逻辑晶圆供应,台积电就算建再多的CoWoS产线,也没有芯片可以封装。目前台积电的CoWoS产能规划,完全是跟着N3产能走的,不会做超额的投资。

同时,2.5D先进封装已经有了更多替代方案:CoWoS早就可以外包给ASE/SPIL、Amkor等OSAT厂商,此前英伟达就曾将面向中国市场的H200封装交给Amkor;英特尔的EMIB 2.5D封装方案也在快速崛起,已经被谷歌TPU、AWS Trainium等产品不同程度采用。

当封装不再是核心壁垒,整个半导体供应链的格局,正在这场硅荒中迎来彻底的重构。

1. 台积电的“王座”与隐忧

台积电依然是这场战争的绝对核心,手握先进制程产能分配权,直接决定了AI厂商的算力上限。但持续的产能短缺,也正在让它的客户开始寻找替代方案。

技术领先固然重要,但如果客户拿不到足够的产能来支撑业务,再领先的技术也没有意义。产能约束,正在推动头部客户开启晶圆厂多元化布局。

2. 英特尔、三星迎来破局机会

英特尔拿到了美国政府的全力支持,客户将订单转向英特尔晶圆厂,能获得美国政府的政策倾斜,这是巨大的加分项。

三星晶圆厂也迎来了关键突破:不仅拿下了特斯拉AI5、AI6芯片项目(与台积电双轨并行),还成功进入了英伟达的数据中心供应链。在台积电产能全面锁死的当下,三星和英特尔,成了AI厂商们为数不多的第二选择。

3. AI行业的马太效应将进一步加剧

这场硅荒,最终会传导到整个AI行业。有能力签下多年长单、锁定台积电N3产能和HBM供应的巨头,比如英伟达、谷歌、微软、亚马逊,将在算力军备竞赛中占据绝对优势。

而中小AI厂商、创业公司,不仅拿不到稳定的先进制程产能,还要面对持续上涨的算力成本,与巨头的算力差距会越拉越大。AI行业的马太效应,将在这场供应链战争中被放大到极致。

五、终局:AI的战争,本质是供应链的战争

2026年的这场AI硅荒,给整个行业敲响了警钟:AI的竞争,早已不是单纯的算法、模型、应用的竞争,而是底层供应链的竞争。

谁能锁定稳定的先进制程晶圆产能,谁能拿到充足的HBM内存供应,谁才能在下一代AI模型的迭代中站稳脚跟。Anthropic的案例已经证明,哪怕你的产品再受欢迎,没有算力支撑,也只能眼睁睁看着收入机会溜走。

未来2年,这场硅荒都很难得到根本性的缓解。台积电的产能扩张需要时间,HBM的技术爬坡需要时间,而AI算力的需求,还在以远超行业预期的速度暴涨。

对于整个行业来说,这既是危机,也是机遇。能突破供应链枷锁的玩家,将在AI的下一个时代,拿到真正的入场券。而那些无法掌控供应链的玩家,终将在这场军备竞赛中,被时代淘汰。对此类供应链技术话题的进一步探讨,欢迎在云栈社区的相关板块进行深入交流。

原文链接:The Great AI Silicon Shortage