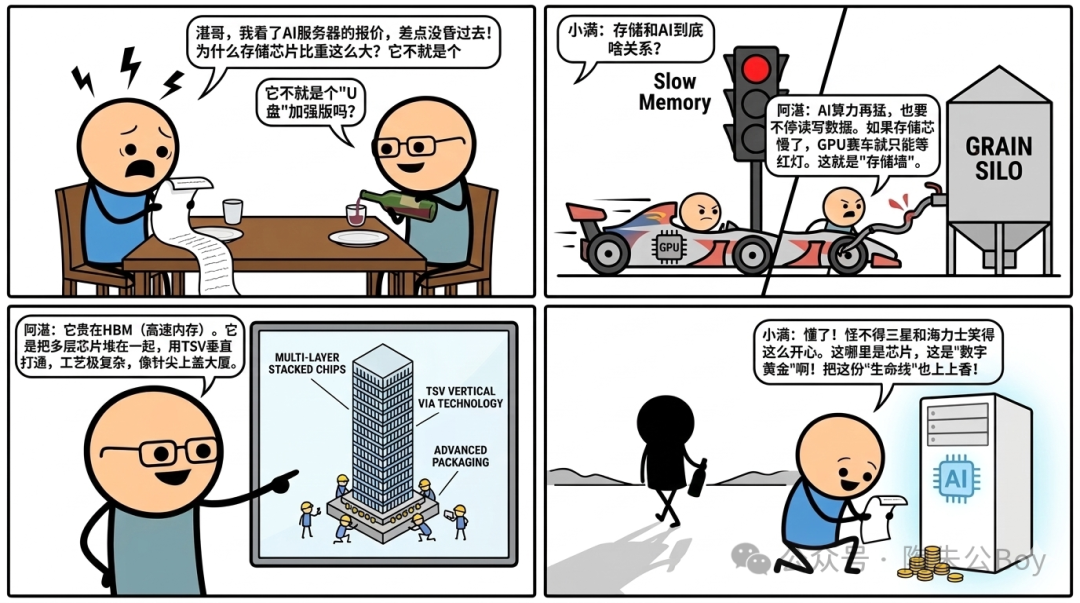

你是否也曾对AI服务器的天价账单感到困惑?尤其是看到里面一颗小小的“存储芯片”成本占比巨大时,心里难免会嘀咕:这不就是个“U盘”加强版吗,凭什么卖这么贵?

最近,关于HBM(High Bandwidth Memory,高带宽内存)价格的讨论,在智能 & 数据 & 云技术圈里持续升温。这背后其实是一个关键技术瓶颈的体现。

第一格:价格的震撼

“港哥,我看了AI服务器的报价,差点没昏过去!为什么存储芯片比重这么大?它不就是个‘U盘’加强版吗?”

这可能是很多人的第一反应。在传统的认知里,内存(RAM)和存储(硬盘/U盘)是分开的,价格也相对透明。但当它们以HBM这种形态出现在AI服务器里时,身价就截然不同了。

第二格:算力与存储的赛车比喻

“AI算力再猛,也要不停读写数据。如果存储芯慢了,GPU赛车就只能等红灯。这就是‘存储墙’。”

这个比喻非常形象。现代AI模型,尤其是大语言模型,训练时需要海量参数在GPU的显存和计算单元之间高速流动。如果内存的带宽跟不上GPU的计算速度,就像给F1赛车配上了一条拥堵的市内道路,引擎再强也无用武之地。这个瓶颈就是著名的“内存墙”或“存储墙”(Memory Wall)。

第三格:HBM的复杂工艺

“它贵在HBM(高速内存)。它是把多层芯片堆在一起,用TSV(硅通孔)垂直打通,工艺极其复杂,像针尖上盖大厦。”

这里点出了HBA贵的核心原因。它不同于我们电脑里插着的条状内存(DRAM)。HBM采用先进的2.5D/3D封装技术,将多个内存芯片像盖楼一样垂直堆叠在一起,并通过数以千计的、极其微小的硅通孔(TSV)进行垂直互联。

这样做的好处是极大地缩短了数据传输路径,从而获得了远超传统内存的带宽。但代价就是设计复杂、制造难度极高、良品率挑战大,成本自然水涨船高。目前全球能稳定供应HBM的厂商屈指可数,市场处于供不应求的状态。

第四格:数字时代的黄金

“懂了!怪不得三星和海力士笑得这么开心。这哪里是芯片,这是‘数字黄金’啊!把这份‘生命线’也上上香!”

漫画的结尾道破了本质。在AI算力竞赛白热化的今天,HBM已经不再是简单的内存组件,而是决定AI服务器整体性能的“生命线”。谁能掌握先进、稳定的HBM供应,谁就在这场竞赛中占据了关键优势。它的价值,已经与其在AI产业链中的战略地位牢牢绑定。

所以,当你再看到AI服务器报价单上那项昂贵的“内存”时,应该明白,你支付的不仅是芯片本身的物料成本,更是攻克“存储墙”、释放GPU极限算力所必须支付的“技术通行费”。

理解HBM,是理解当代人工智能硬件基础的重要一环。更多关于高性能计算与前沿技术的深度讨论,欢迎来到云栈社区与我们交流。 |