北京时间 3月18日,月之暗面创始人杨植麟在英伟达 GTC 2026 现场发表了主题演讲。他首次系统性披露了 Kimi K2.5 模型背后的技术路线图,并提出了一个核心观点:AI 研究的范式正在发生变化。

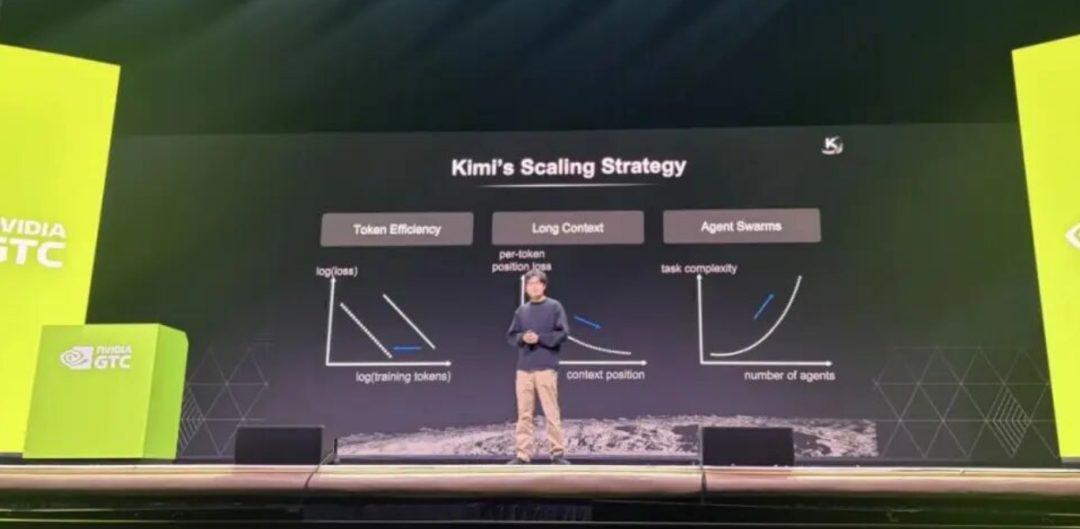

在演讲中,他展示了一张关于 Kimi Scaling 的路线图,将模型的进化逻辑归纳为三个维度的协同共振:Token效率、长上下文以及智能体集群(Agent Swarms)。

重构底层基石:超越算力堆砌

当前,许多团队依然遵循“堆算力”的 scaling 路径,但杨植麟在演讲开篇便指出,要持续推动大模型智能上限的突破,必须对优化器、注意力机制及残差连接等底层基石进行重构。

杨植麟认为,要推动大模型智能上限的持续突破,必须对优化器、注意力机制及残差连接等底层基石进行重构。

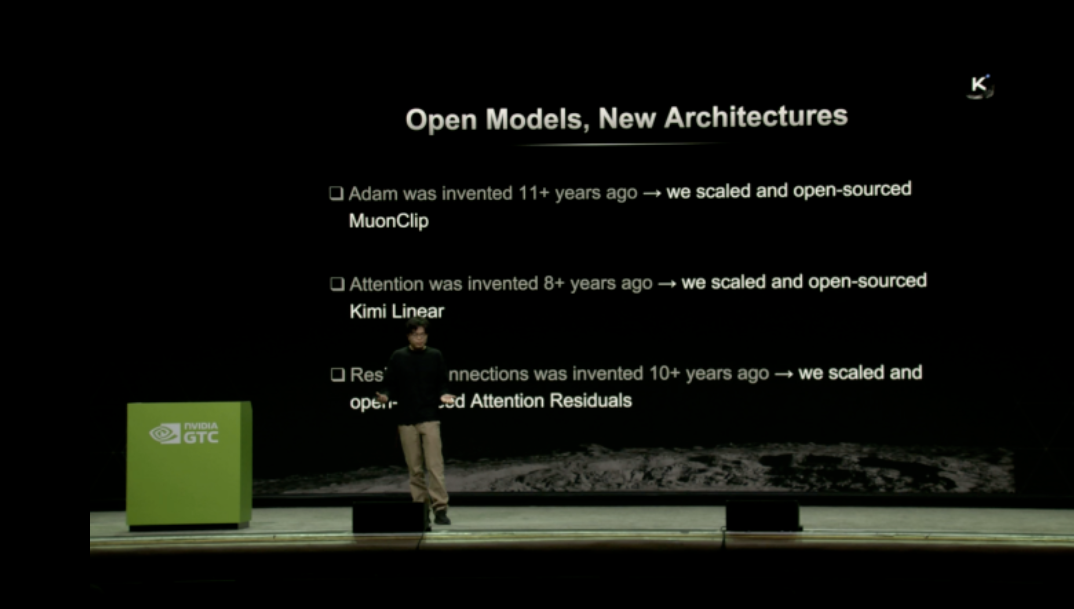

他直言,当前 AI 领域依赖的许多技术标准(如 Adam 优化器、注意力机制、残差连接)都是多年前的发明,在超大规模模型训练的时代,它们可能已经成为进一步进化的阻碍。

对此,Kimi 团队拿出了具体的手术方案,直接对统治 AI 界近十年的 Transformer 架构动刀:

- 挑战全注意力机制:推出基于 KDA 架构的 Kimi Linear,打破了“所有层必须使用全注意力”的教条。

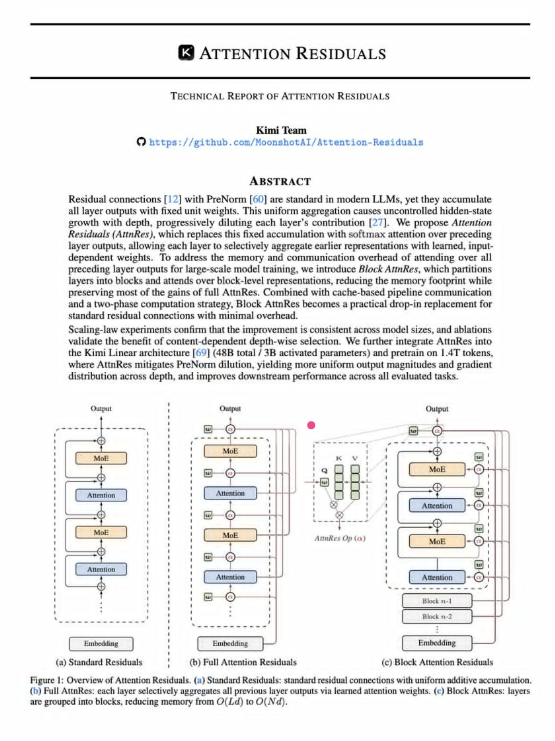

- 重塑残差连接:引入 Attention Residuals 方案,以动态、内容感知的聚合方式替代传统的固定权重累加。

这项名为 Attention Residuals 的工作在不久前以论文形式发布,引起了广泛关注。它不仅从理论上分析了标准残差连接导致“表征稀释”的问题,还提出了完整的解决方案和工程优化(如 Block AttnRes),使其能够适用于大规模训练。

这种对 注意力机制 等核心组件的深度重构,展示了在现有 Transformer 框架内仍有巨大的创新空间,这或许正是实现下一代 AI 模型突破的关键。这一思路也值得广大研究者在 人工智能 领域深入探讨。

三维进化:从单兵作战到“智能体集群”

杨植麟详细阐述了 Kimi 的技术进化逻辑。他认为,未来的 Scaling 不再是单纯的资源堆砌,而是要在计算效率(Token效率)、长程记忆(长上下文)和自动化协作(智能体集群)这三个维度上同时寻找规模效应。

在杨植麟看来,当前的Scaling不再是单纯的资源堆砌,而是要在计算效率、长程记忆和自动化协作上同时寻找规模效应。如果能将这三个维度的技术增益相乘,模型将表现出远超现状的智能水平。

这预示着未来的 AI 应用形态将发生根本性变化——从处理单一任务的“孤胆英雄”,演变为能够自主协同完成复杂任务的“集团军”。通过全新的 Orchestrator 机制,Kimi K2.5 可以将复杂任务拆解给几十个子 Agent 并行处理,并通过新的并行 RL 奖励函数,旨在解决多智能体协作中的效率瓶颈问题。

范式转移:在“缩放阶梯”上严谨求真

演讲的最后,杨植麟分享了一个关于研究范式变化的深刻洞察。

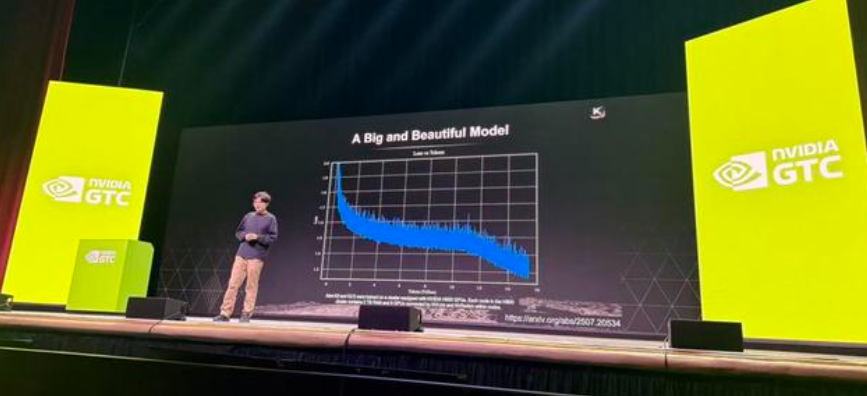

他提到,十年前的研究往往更看重新想法的发表,但受限于算力资源,很难通过不同规模的实验来验证这些想法。

而现在由于拥有了足够的资源和“缩放阶梯(Scaling Ladder)”,研究者可以进行严谨的规模化实验,从而得出更自信、更可靠的结论。

这意味着,顶级 AI 研究正在从“提出猜想”进入“系统验证与工程实现”的新阶段。拥有强大算力基础和工程能力的团队,可以沿着“缩放阶梯”进行扎实的实验,将一个个突破性的理论构想转化为实际可用的模型能力。

坚持自研与开源并进

在快速实现技术突破和商业价值的同时,Kimi 也明确了其开源开放的路径。杨植麟表示,团队将继续坚持将 MuonClip、Kimi Linear 等底层创新贡献给社区。这种“自研+开源”的模式,不仅加速了自身技术的迭代,也为整个 AI 开源生态注入了新的活力,是典型的 开源实战 精神体现。

据悉,月之暗面目前正以约180亿美元的投前估值进行新一轮融资,估值在不到半年的时间里实现了数倍增长。这背后,是其硬核技术实力和清晰技术路线图获得市场认可的直接体现。

真正的智能突破,往往始于对那些被视为“常识”的底层架构的重新审视与革新。杨植麟在 GTC 2026 的这场演讲,无疑为行业指出了下一个值得深入挖掘的技术方向。关于 Transformer 架构的更多可能性,以及如何平衡算力、算法与工程创新,也欢迎大家在 云栈社区 继续讨论。