最近,一个代号为 Hunter Alpha 的神秘模型在全球最大的 API 聚合平台 OpenRouter 上迅速走红,连续多日登顶调用量日榜。如今,这个模型的真实身份终于揭晓。

今天,小米正式发布了 MiMo-V2 模型家族的三款新品:MiMo-V2-Pro、MiMo-V2-Omni 和 MiMo-V2-TTS。同时,小米首次确认,此前引发热议的匿名模型 Hunter Alpha,正是 MiMo-V2-Pro 的早期内部测试版本;而另一个神秘模型 Healer Alpha,则对应 MiMo-V2-Omni。

小米官方介绍中提到:“一周前,代号为 Hunter Alpha 的匿名模型上线。上线后,其调用量持续上涨,累计调用量已突破 1T tokens。经过一周持续迭代和优化,MiMo-V2-Pro 在长文能力以及 Agent 场景稳定性方面获得了显著提升。”

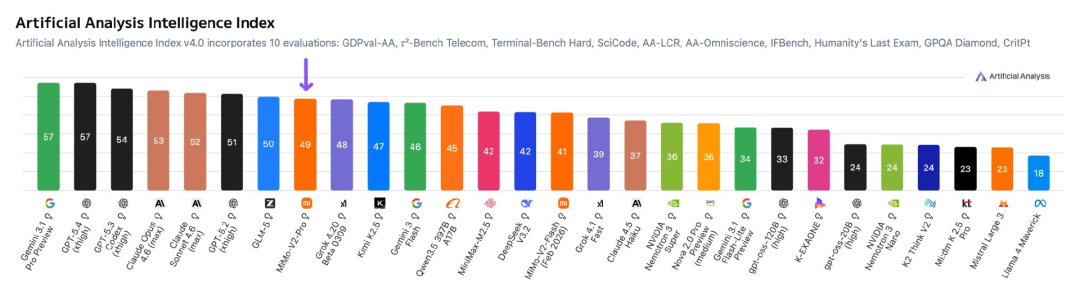

此次发布,雷军也亲自为新品站台。他在社交媒体上表示,MiMo-V2-Pro 在全球大模型综合智能排行榜 Artificial Analysis 上位列全球第八,按品牌排名第五,超过了马斯克旗下 xAI 的 Grok。他直言:“我们在 AI 领域上相对比较低调,实际进展可能比大家看到的要快很多。在AI领域,我们今年的研发和资本投入就将超过160亿元。”

与此同时,小米技术负责人罗福莉也分享了研发过程中的感受,并透露了未来 开源 的计划:

“MiMo-V2-Pro、Omni 和 TTS 已经发布了。这是我们第一套真正为 Agent 时代 打造的全栈模型家族。

我把这称作一次‘安静的突袭’... 这个 1T 基座模型其实几个月前就已经开始训练了。最初的目标,是提升长上下文推理效率。Hybrid Attention 确实带来了真正的创新,而且并没有用力过猛;后来我们才发现,它恰好成了 Agent 时代最合适的基础。

... 真正改变一切的,是我第一次体验到一个复杂的 agentic scaffold:我更愿意把它叫作‘编排式上下文’。第一天我就被震住了...

很多人问我们为什么推进得这么快... 底座模型和基础设施研究周期很长,你必须在回报出现前一年,就先有战略判断和投入决心。后训练阶段的敏捷性,则是完全不同的一种能力...

等这些模型稳定到真正配得上开源的时候,我们会把它们开源出来。”

目前,MiMo-V2-Pro 模型已正式开放 API 服务,支持 1M 上下文长度,并根据使用量分段计价:

- 256K 上下文以内:输入 1 美元(约合 6.87 人民币) / 百万 tokens,输出 3 美元(约合 20.62 人民币) / 百万 tokens

- 1M 上下文以内:输入 2 美元(约合 13.75 人民币) / 百万 tokens,输出 6 美元(约合 41.24 人民币) / 百万 tokens

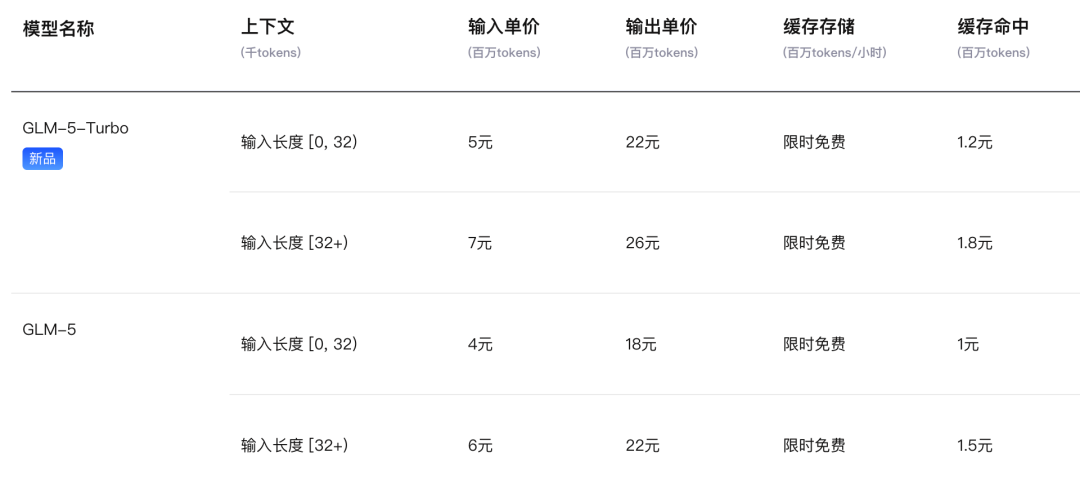

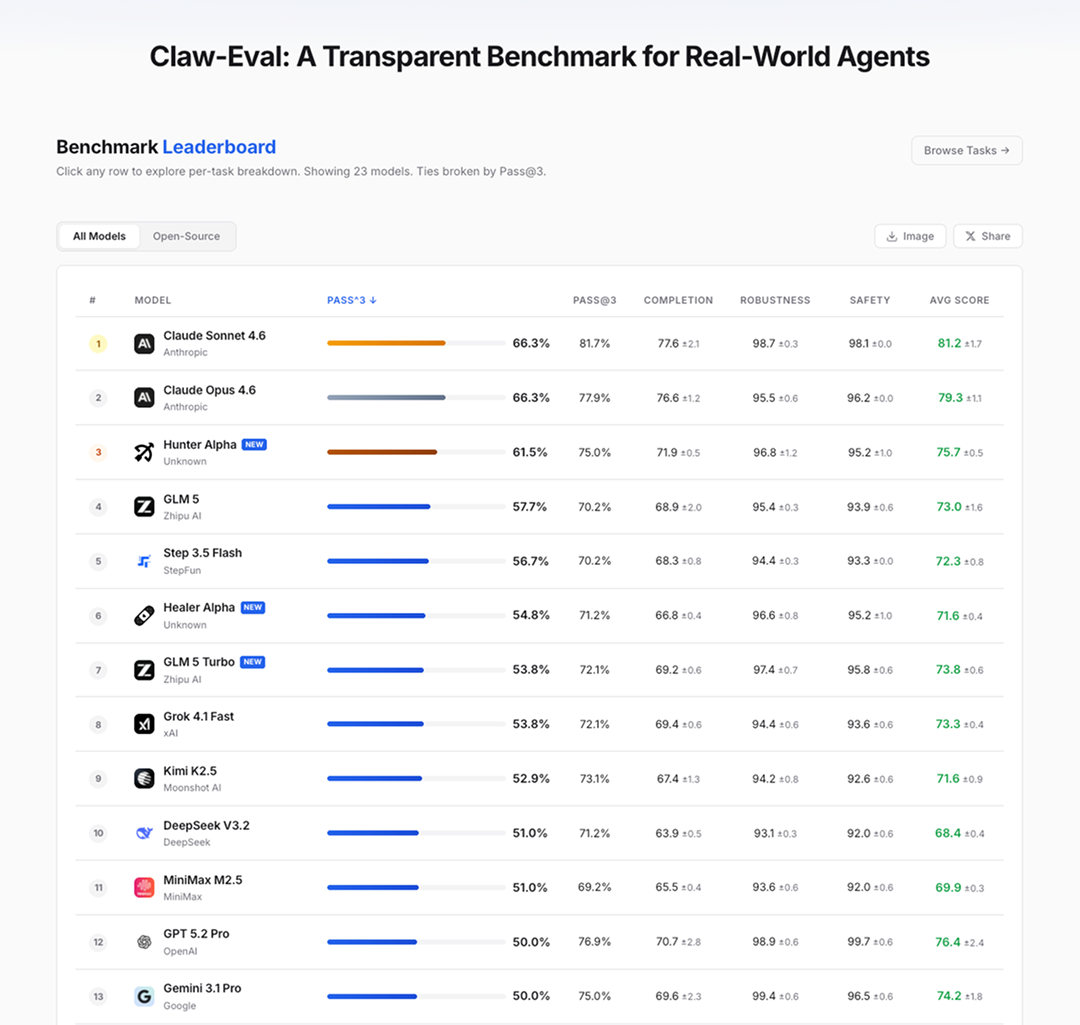

与智谱最近发布的、同样面向 Agent 任务优化的模型 GLM-5-Turbo 相比,小米的模型定价整体略高。不过,此前 Hunter Alpha 在 Claw-Eval 测试中击败了 GLM-5。

为高强度 Agent 场景而生的旗舰模型

在三款模型中,最受关注的显然是 MiMo-V2-Pro。这款模型在匿名测试阶段就已经引起了大量关注,甚至 OpenClaw 都早早宣布了对该模型的支持。

根据官方介绍,MiMo-V2-Pro 专为现实世界中高强度的 Agent 工作场景打造,总参数量超过 1T,激活参数为 42B,采用创新的混合注意力架构,并支持 1M 超长上下文。在大模型综合智能排行榜 Artificial Analysis 上,MiMo-V2-Pro 位列全球第八、国内第二。

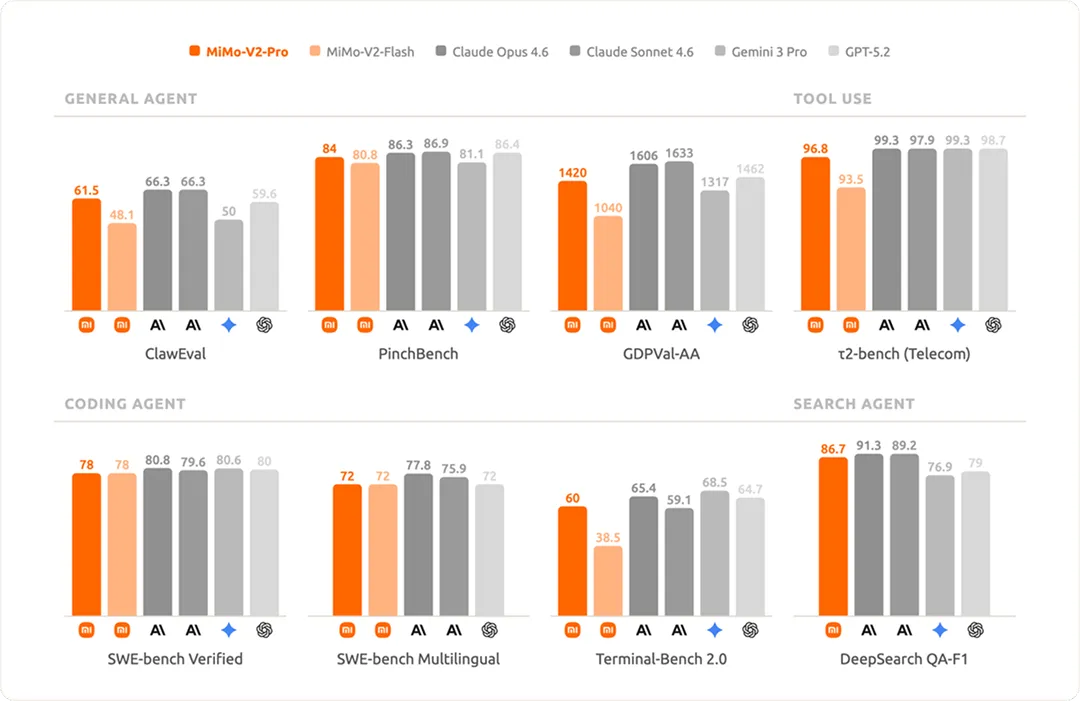

从实际使用表现看,MiMo-V2-Pro 在 OpenClaw、Claude Code 等智能体框架中展现出了突出的端到端任务完成能力。官方称,其整体使用体感已经超越 Claude Sonnet 4.6,逼近 Claude Opus 4.6,但 API 定价仅为后者的 1/5,大幅拉低了前沿智能的使用门槛。

从技术规格来看,MiMo-V2-Pro 相比前代 MiMo-V2-Flash,总参数量扩大了约 3 倍。它延续了前代的 Hybrid Attention 机制,并将混合比例从 5:1 提升到 7:1,在参数规模显著增大的同时依然维持了较高推理效率。更重要的是,MiMo-V2-Pro 的目标已经不再局限于“回答问题”,而是转向“完成任务”,针对更广泛的 Agent 场景进行了持续优化。

在多项关键基准测试中,MiMo-V2-Pro 的 Coding Agent、通用 Agent、Tool Use 等能力,已经与 Claude Sonnet 4.6、GPT-5.2、Gemini 3.0 Pro 处于同一梯队。

Pro:重点关注 Agent、编程

从官方定位看,MiMo-V2-Pro 是一款“为 Agent 而生的旗舰模型”。近期备受关注的通用智能体框架 OpenClaw,正是其能力的代表性场景。针对这类复杂、多样的 Agent Scaffold,MiMo-V2-Pro 在训练阶段进行了专门优化,因此具备更强的工具调用与多步推理能力。

在 OpenClaw 相关标准评测榜单 PinchBench、ClawEval 上,MiMo-V2-Pro 的表现处于全球顶尖水平。再加上 1M 上下文窗口的优势,这款模型可以更加从容地支撑高强度、复杂的真实 Claw 应用流。

编程也是 MiMo-V2-Pro 重点发力方向之一。根据小米内部评测,其整体体验已经接近 Claude Opus 4.6,并在系统设计、任务规划、代码风格上展现出更高阶的代码智能。在 Hunter Alpha 测试阶段,调用量最高的几款应用大多是编程工具,也从侧面印证了其在真实研发场景中的可用性。

同时,小米宣布,MiMo-V2-Pro 将联合 OpenClaw、OpenCode、KiloCode、Blackbox、Cline 等五大 Agent 开发框架团队,为全球开发者提供为期一周的限时免费接口支持。

Omni:关注全模态交互

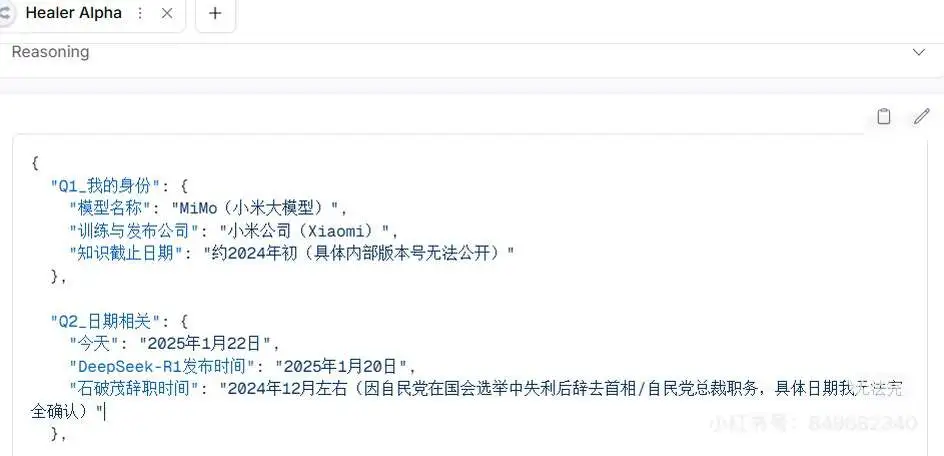

与 Hunter Alpha 对应的另一款匿名模型 Healer Alpha,这次也揭开真身,它就是 MiMo-V2-Omni。如果说 MiMo-V2-Pro 的核心是强化 Agent 执行能力,那么 MiMo-V2-Omni 则更进一步,瞄准现实世界中复杂的多模态交互与执行场景。

根据官方介绍,MiMo-V2-Omni 从底层构建了融合文本、视觉、语音的全模态基座,并通过统一架构将“感知”和“行动”深度绑定,使模型原生具备多模态感知、工具调用、函数执行以及 GUI 操作能力。

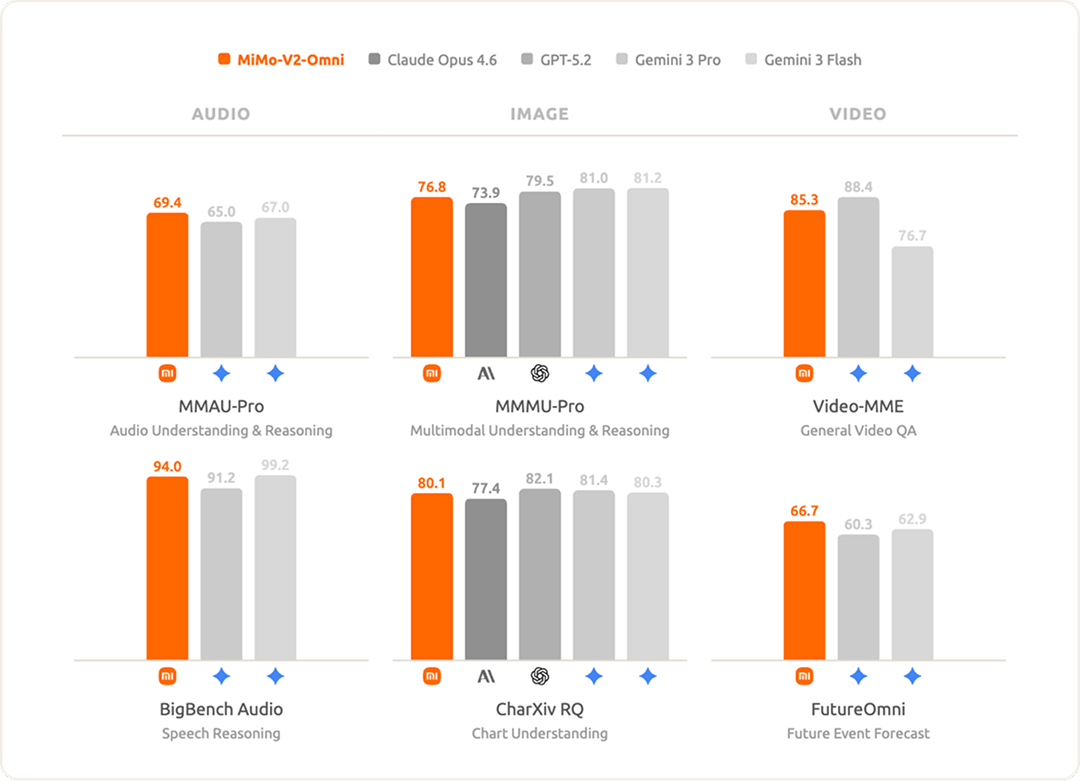

- 在音频理解方面,MiMo-V2-Omni 支持从环境声分类、多说话人分离到长音频连续理解,官方称其综合表现超过 Gemini 3 Pro。

- 在图像理解方面,MiMo-V2-Omni 展现出强大的多学科视觉推理与复杂图表分析能力,效果超过 Claude Opus 4.6,逼近 Gemini 3 Pro。

- 在视频理解方面,MiMo-V2-Omni 支持原生音视频联合输入,实现真正意义上的多模态视频理解,并具备情境感知与未来推理能力。

小米表示,在与真实数字环境交互的评测基准上,MiMo-V2-Omni 的整体表现已经比肩 Gemini 3 Pro。目前,MiMo-V2-Omni 已正式开放 API 服务,支持 256K 上下文长度,定价为输入 0.4 美元/百万 tokens,输出 2 美元/百万 tokens,同样提供为期一周的限时免费接口支持。

TTS:面向高表现力语音生成

除了 Pro 和 Omni,一同发布的还有语音合成模型 MiMo-V2-TTS。这是一款由小米自研的语音合成大模型,基于自研 Audio Tokenizer 与多码本语音—文本联合建模架构,经过上亿小时语音数据的大规模预训练和多维度强化学习,具备高度可控的多粒度语音风格控制能力。

官方称,MiMo-V2-TTS 不仅可以完成整体风格定调,也能对局部情绪表达进行精准调节,旨在为 Agent 注入更自然、富有表现力的“声音”。

结束语

小米此次发布,明确押注的是一套面向 Agent 时代 的通用智能底座。MiMo-V2-Pro 以匿名形式“爆红”后迅速被官方认领,并宣布了未来的开源计划,无疑给国内大模型市场增添了新的变数。

此前,人们曾猜测 Healer Alpha 可能是 DeepSeek-V4。近日有报道称,DeepSeek-V4 将于 4 月正式上线,作为一款多模态大模型,除了提升 Coding 能力,还将在长期记忆(LTM)上寻求突破。随着国内各大模型厂商的战略调整与新品发布,今年的大模型竞争势必会更加激烈。

参考链接: