近日,阿里云事件总线 EventBridge 推出全新能力——事件仓 EventHouse,现已正式上线并开启公测。

这不仅是新增了一个查询入口,更是对事件数据价值的重新定义。EventHouse 正将原本“传完即走”的事件数据,升级为 可沉淀、可治理、可分析、可被 AI Agent 直接使用的数据资产。

关键能力:无感集成、透视治理、对话分析

在企业数字化经营中,用户行为、系统状态、交易流转等事件数据持续产生。这类数据贴近业务、时效性强、价值高,但传统事件总线(EventBus)主要解决事件的路由与分发。事件被消费后,往往缺少统一沉淀、治理和分析,最终变成分散各处、难以复用的“暗数据”。

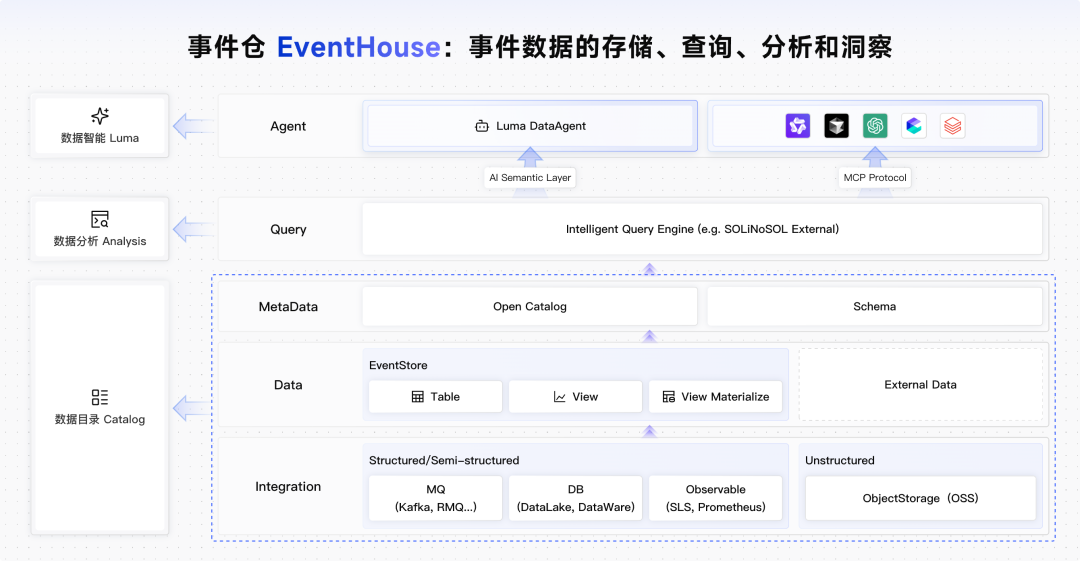

EventHouse 作为企业数据与 AI Agent 之间的桥梁,融合数据湖的开放灵活与数据仓库的高性能治理能力,提供三类关键能力:

- 无感集成:支持 Kafka、RocketMQ、MySQL、OSS 等多源异构数据接入,免去复杂 ETL 开发。未来还将支持 Zero-ETL 跨源联查。

- 透视治理:建立统一数据目录,集中管理元数据、Schema、权限和数据血缘,让数据从“不可见、不可控”走向“可管理、可追溯、可复用”。

- 对话分析:通过自然语言提问,内置 AI 能力自动完成查询和分析,业务人员无需编写 SQL,即可实现“对话即分析”。

同时,阿里云 RocketMQ、Kafka 等消息产品也提供了 EventHouse 一键分析 入口,企业可直接从消息流视角开展实时洞察,从“消息传输”进一步走向“消息分析”。

三大组件:构建企业数据与 AI Agent 的桥梁

数据目录(Catalog):统一元数据中心

很多企业并不缺数据,缺的是统一管理数据的能力。当数据分散在多个系统中,字段口径不一致、权限边界不清、协作效率低是常态。

Catalog 作为 EventHouse 的元数据管理中心,统一管理接入数据源的元数据、Schema、访问权限和数据血缘,对分散数据统一接入、存储和治理,缩短数据可用周期。

- 统一接入:支持 Kafka、RocketMQ、MySQL、OSS 等多种数据源。

- 持久存储:由 EventStore 存储事件数据,针对 JSON 等事件格式进行列式压缩,降低存储成本。

- 统一治理:通过 Open Catalog 连接异构数据源并统一管理元数据,支持自动发现和注册多源元数据,自动推断并管理 Schema 版本,兼容 Hive Metastore Thrift API 以及 Iceberg、Hudi、Delta Lake 等开放表格式,提供库、表、列三级细粒度访问控制。

数据分析(Analysis):高性能流批一体引擎

数据接入后,能否快速形成洞察,决定了数据是否真正产生业务价值。但对于实时分析来说,传统数仓难以应对高吞吐、低延迟的实时事件流,而消息系统又缺乏复杂关联、聚合与多表连接分析能力。

Analysis 作为 EventHouse 的计算引擎层,提供高性能 SQL 查询和流式处理能力,对事件数据进行实时查询、聚合分析和可视化展示,帮助业务更快发现异常、分析原因并及时响应。

- 多模态查询:支持 SQL/NoSQL/External 三种模式。

- 流批一体:同一套 SQL 可同时查询历史数据和实时事件流。

- 实时异常检测:可实时计算交易成功率、延迟分布等指标,触发阈值自动告警。

- Zero-ETL 联邦查询(规划中):无需数据迁移,统一分析实时事件、历史数据和外部数据。

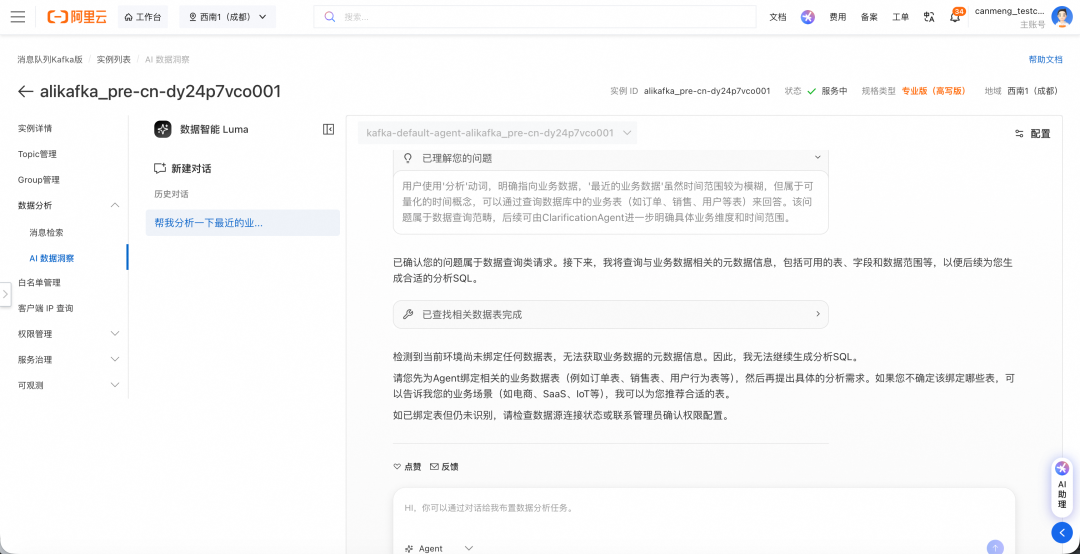

数据智能 (Luma):AI 原生对话式分析

很多业务问题的门槛,不在于数据本身,而在于“不会写 SQL”。通用大模型虽能生成 SQL,但通常不了解企业内部字段含义、状态码定义和统计口径,容易出现理解偏差,影响分析结果的准确性。

Luma 是 EventHouse 的 AI 原生分析能力,也是用户与数据交互的入口。它通过 AI 语义层和内置 DataAgent,将自然语言转化为 SQL 并执行,让业务人员无需写 SQL 也能获得可靠的分析结果。

- AI 语义层:为字段添加描述、业务别名与计算逻辑,让 AI 更懂业务,提升 Text-to-SQL 准确率。

- DataAgent 自主分析:自动完成“问题理解-元数据探测-SQL 生成-校验修复-查询执行”全流程,输出根因分析与行动建议报告。

- MCP 协议集成(规划中):将数据查询与操作封装为智能体可调用工具,支持 LangChain、Dify 或自定义 Agent 接入。

- 实时 Context(规划中):为 AI Agent 提供秒级实时更新的数据 Context,支持 Agentic RAG。

典型场景:EventHouse 赋能真实业务决策

跨源数据统一治理与查询

数据分散在 MySQL、Kafka、RocketMQ、OSS 等系统,口径不一、权限割裂。分析师需跨系统查询、导出,再手工关联,效率低且容易出错。

在 EventHouse 中,新数据源接入后,Open Catalog 自动捕获 Schema、分区信息和数据类型,并注册为可直接查询的逻辑表。分析师直接通过统一视图查询,无需关心底层存储。

例如:订单支付结果通过 RocketMQ 实时发送,用户资料存储在 MySQL。通过 Catalog 创建虚拟视图 Order_View,关联两者后,基于统一视图查询即可。

从消息流直接开启实时分析

RocketMQ、Kafka 等消息是最贴近业务变化的一手数据,但传统方式搭建分析链路复杂。借助 EventHouse 一键分析入口,企业可直接从消息视角开展实时分析,适用于交易监控、链路排障、运营分析、IoT 实时洞察等场景。

例如:

- 从支付结果 Topic 中分析过去 10 分钟失败消息是否异常突增,并结合历史日志判断是否出现过同类报错。

- 从订单状态流中识别“已支付未发货”等关键环节堆积,定位“下单成功但库存不足”的风险订单。

- 从设备告警消息中按型号、区域、批次聚合异常,构建设备健康画像,快速识别集中性故障。

AI 驱动的自然语言交互分析

业务人员不熟悉 SQL,通用 Text-to-SQL 容易因字段含义不清、状态码定义复杂而生成错误查询。EventHouse 让业务人员从“会不会写 SQL”切换到“会不会提业务问题”,真正实现零代码分析。

例如:当用户提问“上小时支付失败主要来自哪些渠道?”时,Luma 可通过语义标注理解“支付失败”对应的字段和状态码,生成准确 SQL,返回可靠结果。

完善事件数据体系,释放实时数据价值

阿里云事件总线 EventBridge 凭借成熟、领先的产品能力,已经过全球众多企业生产环境验证,服务互联网、金融、汽车、教育等行业上万家企业。

随着 EventHouse 的推出,EventBridge 已形成完整的全托管 Serverless 事件数据服务体系:

- 事件总线 EventBus:负责接收事件并路由分发

- 事件流 EventStreaming:负责提供高吞吐事件通道

- 事件仓 EventHouse:负责数据存储、查询与分析

这一体系帮助企业将事件数据能力从“传输”进一步扩展到“沉淀、治理、分析与智能应用”,为实时业务洞察和 AI 驱动决策提供更坚实的数据底座。

未来,阿里云将持续增强 EventHouse 的 AI 原生能力,让更多角色用自然语言就能用数据,让更多分析从“人工排查”走向“智能体主动发现与建议”,把实时数据的价值释放变得更简单、更智能、更规模化。

对云原生、大数据与人工智能技术栈的融合应用感兴趣?欢迎前往云栈社区与更多开发者交流探讨。