历经一年半的研发,自动化AI研究迎来了历史性时刻。Sakana AI联合不列颠哥伦比亚大学、向量研究所和牛津大学打造的AI科学家系统,正式登上了Nature杂志。论文详细剖析了系统架构,公布了全新的缩放定律结果,并深入探讨了AI生成科学的未来与挑战。目前,该系统的初代和第二代代码及生成的论文,均已在GitHub上开源。

Nature:

https://www.nature.com/articles/s41586-026-10265-5

GitHub:

https://github.com/SakanaAI/AI-Scientist

https://github.com/SakanaAI/AI-Scientist-v2

回顾这一年半的历程,这个自动化研究系统的发展经历了两个关键阶段。

第一个阶段是证明可行性。研发团队最初只给了系统一段像简单nanoGPT训练这样的基础代码模板,系统就成功实现了自主生成新想法、设计并运行实验测试,最后独立写出了一篇完整的论文。为了给这些论文评估质量,团队还专门开发了一个自动审稿人系统。这在历史上首次证明了,端到端自动化完成整个机器学习研究流程是完全可行的。

第二个阶段则是挑战科学领域的图灵测试。在系统的第二次更新中,它获得了极大的自由度,可以探索AI研究中任何宽泛定义的主题。团队把完全由AI生成、未经任何人类编辑的论文,直接提交给了ICLR 2025的一个研讨会,接受严苛的人类双盲同行评审。

结果令人印象深刻。其中一份手稿拿到了6、7、6的单项分,平均分高达6.33,直接越过了人类设定的接收门槛,其得分更是超过了55%的人类作者论文。整个提交流程都提前征得了研讨会主办方的同意,并在论文确认被接收后按原定计划进行了撤稿。

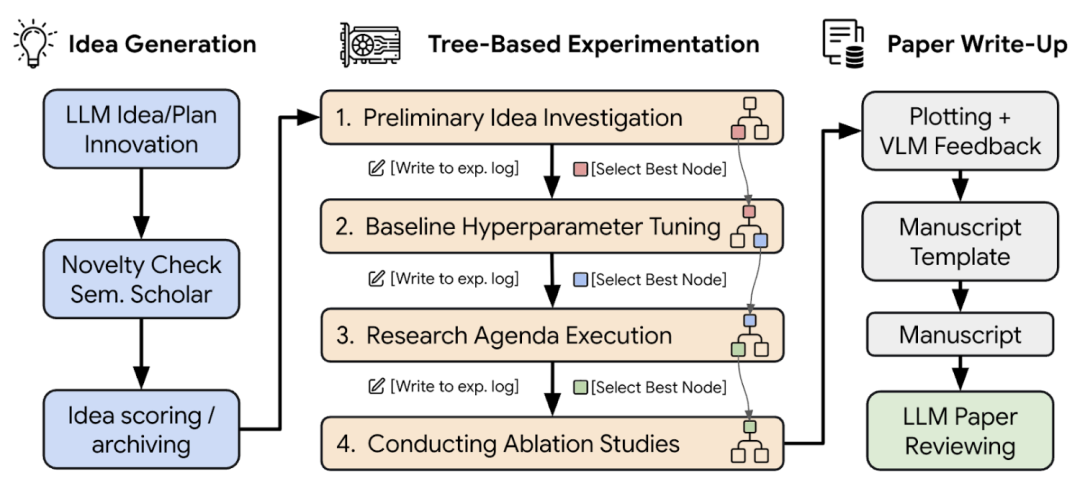

这篇全新的Nature论文不仅汇总了上述突破,还揭秘了使其成为可能的底层大模型优化机制。在实际运行中,只要给系统指定一个大致的研究方向,它就能自主生成创新的研究思路,检索并阅读相关文献,通过并行的智能体树搜索来设计、编程并执行实验。最后,它会用LaTeX语言撰写整篇论文,期间还会调用具备视觉能力的基础大模型来为论文配图提供反馈。

新发现:自动审稿人与科学界的缩放定律

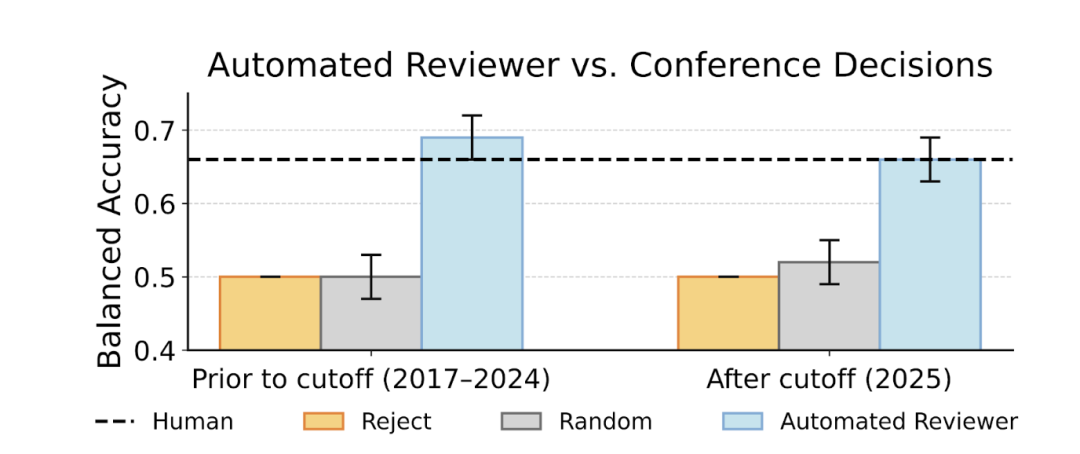

为了能够大规模评估AI生成的科研成果,同时避免让人类审稿人劳累过度,团队打造了自动审稿人系统。

系统被设定为扮演领域主席的角色,综合五份独立的评审意见,并严格按照NeurIPS的官方指南做出最终裁决。研发团队用OpenReview数据集里成千上万条真实人类审稿决定对它进行了基准测试。结果显示,自动审稿人的表现与人类相当,平衡准确率达到了69%,其F1分数甚至超越了著名NeurIPS 2021一致性实验中测出的人类审稿人之间的一致性。

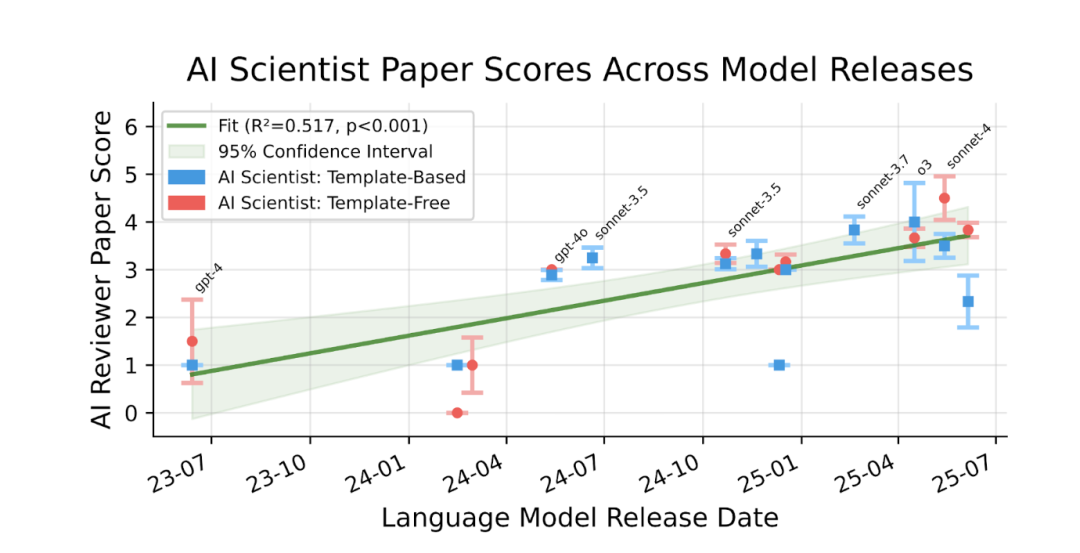

更重要的是,通过用这个审稿系统来评估不同基础大模型生成的论文,团队发现了一个清晰的缩放定律:底层大模型的能力越强,系统生成的论文质量就越高。这强烈预示着,随着计算成本的下降和模型能力的指数级攀升,未来版本的AI科学家将会爆发出更加惊人的实力。

局限与未来:机器换人的前夜

尽管通过人类同行评审是一个巨大突破,但AI科学家系统目前仍处于早期阶段,Nature论文中也坦诚了它的几项局限性。

比如,它偶尔会提出一些幼稚或者不够成熟的想法;在处理极具深度的严密方法论和复杂的代码实现时会感到吃力;系统也容易产生幻觉或犯明显的低级错误,例如生成不存在的参考文献,或者在论文附录里重复放置同一张图表。

然而机器学习领域有着明显的趋势:一项新能力一旦开始奏效,即便存在明显缺陷,在规模扩张和核心模型升级的推动下,它也会在极短的时间内超越人类水平。目前AI科学家还仅限于计算类实验,但团队预计这套模式将被适配到其他领域,通过开放式的探索发现来催化整个科学界的进步。

科学发现范式的彻底转变

自动生成论文的能力不可避免地引发了深刻的伦理和社会探讨。这包括同行评审系统可能面临崩溃,以及学术背景被虚假抬高等风险。

研发团队强调必须负责任地开发这项技术,这包含了让公众知情:AI生成论文不仅已经成为现实,而且在某些情况下完全可以媲美人类水平。团队主动撤回了被接收的AI论文,所有实验均获得了伦理审查委员会的批准。同时,团队在所有AI生成的论文上都打上了水印以明示身份,并呼吁整个学术界都采纳这种做法,尽快建立起对待AI生成研究的清晰规范。

对于这一颠覆性的科研进展,云栈社区将持续关注,并为开发者们提供讨论与交流的平台。

source:

https://sakana.ai/ai-scientist-nature/