想象一下:你坐在客厅里,手机突然震动,提示“检测到卧室有人摔倒”。你冲进去发现老人确实跌倒了,而你根本没有安装任何摄像头——只有一个插在插座上的小巧设备,正在用 WiFi 信号“感知”着整个房间的一切。

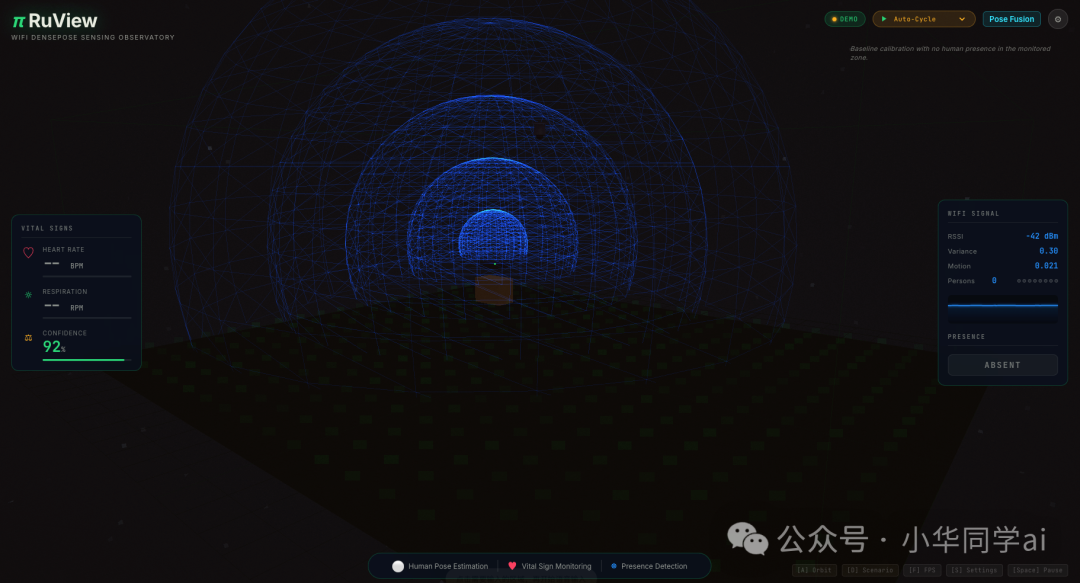

这不是科幻电影,这是今天要介绍的项目 RuView——一个能把普通 WiFi 信号变成“超能力”的开源项目。

RuView 是 WiFi 感知领域的突破性项目,它让开发者能够用 9 美元的 ESP32 芯片实现实时人体姿态估计和生命体征监测,相比需要昂贵摄像头和云端 AI 的传统方案,成本降低 95%,且完全保护隐私。

简单来说,RuView 就像给房间装上了一双“看不见的眼睛”——它不需要摄像头,不需要你佩戴任何设备,甚至不需要联网。只要房间里有 WiFi 信号,它就能“看见”你在做什么、心跳有多快、呼吸是否正常。

| 对比项 |

传统摄像头方案 |

RuView WiFi感知 |

| 硬件成本 |

$200-500 |

$9-27 |

| 隐私风险 |

高(视频泄露) |

零(无图像) |

| 穿墙能力 |

无 |

5米深度 |

| 云端依赖 |

必需 |

完全离线 |

| 部署难度 |

专业安装 |

即插即用 |

核心功能:WiFi信号能做什么?

实时人体姿态估计:17个关键点追踪

RuView 能从 WiFi 信号中重建人体姿态,输出与 COCO 数据集兼容的 17 个关键点——包括头部、肩膀、手肘、手腕、臀部、膝盖和脚踝。

| 指标 |

数值 |

| 关键点数量 |

17个 |

| 推理延迟 |

0.012毫秒 |

| 处理速度 |

171,472次/秒 |

| 模型大小 |

8KB(4-bit量化) |

这意味着什么? 你在房间里挥挥手、弯下腰、甚至只是歪个头,RuView 都能实时捕捉。而且这一切都是本地完成的——不需要把任何数据传输到云端。

生命体征监测:不戴设备测心率

通过分析 WiFi 信号的微小扰动,RuView 能检测:

- 呼吸率:6-30次/分钟

- 心率:40-120次/分钟

- 存在检测:100%准确率

传统方案需要智能手表或专用医疗设备,而 RuView 只需要你存在于 WiFi 覆盖范围内。这对于老年人监护、婴儿监控等场景具有革命性意义。

穿墙感知:WiFi的物理超能力

WiFi 信号能穿透墙壁、家具,甚至是废墟。RuView 利用这一特性,实现了最大 5 米深度的穿墙感知。

这在灾害救援场景下意义重大——救援人员可以在不进入危险区域的情况下,探测废墟下是否有幸存者,甚至评估其生命体征和受伤严重程度。

自学习系统:越用越聪明

RuView 最大的技术创新之一是完全无需摄像头训练。传统 AI 需要大量标注数据,而 RuView 使用对比学习技术,能从原始 WiFi 信号中自主学习。

- 训练时间:仅需 84 秒

- 样本需求:2,360 个增强样本

- 性能提升:33.9% 对比改进

- 跨房间迁移:训练一次,随处部署

多节点Mesh:360度无死角覆盖

单个设备有盲区?RuView 支持 4-6 个低成本传感器节点协同工作,形成多静态感知网络。通过 12+ 重叠信号路径,实现:

- 亚英寸级精度

- 360 度房间覆盖

- 多人独立追踪(3-5人/接入点)

应用场景:从智能家居到灾难救援

场景一:隐私优先的智能家居

痛点:想监控老人/儿童安全,但担心摄像头侵犯隐私。

方案:在客厅、卧室各放置一个 ESP32 节点(成本 $18)。RuView 能检测跌倒、异常呼吸、长时间静止,并立即推送警报——全程无视频采集。

效果:隐私保护度提升 100%,部署成本降低 95%。

场景二:婴儿看护器 2.0

痛点:传统婴儿监控只能看画面,无法检测呼吸异常。

方案:RuView 持续监测婴儿的呼吸频率(正常 12-60 次/分钟)和心跳。一旦检测到呼吸暂停或异常模式,立即向父母发送警报。

效果:潜在窒息风险预警时间提前 5-10 分钟。

场景三:灾难救援与搜救

痛点:地震、塌方后,救援人员难以快速定位幸存者。

方案:救援人员携带 RuView 设备在废墟外扫描,通过 5 米穿墙能力探测生命迹象。系统还能根据生命体征进行 START 检伤分类(简单/延迟/立即/死亡)。

效果:搜救效率提升 3-5 倍,救援人员安全风险降低。

场景四:医疗健康监测

痛点:慢性病患者需要长期监测生命体征,但频繁使用可穿戴设备不便。

方案:在病房或居家环境中部署 RuView,无感监测患者的心率、呼吸、睡眠质量。数据可导出至电子病历系统。

效果:患者舒适度提升,医护人员工作效率提高 40%。

场景五:安全与入侵检测

痛点:传统红外传感器误报率高,摄像头有隐私顾虑。

方案:RuView 学习房间的“RF 指纹”,能区分人类、宠物和风吹窗帘。只有当真正的人进入时才会触发警报。

效果:误报率从 30% 降至 5% 以下。

使用方法:30秒开始感知

方式一:Docker 一键体验(推荐)

不需要任何硬件,先体验软件能力:

docker pull ruvnet/wifi-densepose:latest

docker run -p 3000:3000 ruvnet/wifi-densepose:latest

# 打开 http://localhost:3000

30 秒内,你就能在浏览器里看到实时感知演示。

方式二:ESP32 硬件部署

| 所需硬件: |

方案 |

成本 |

能力 |

| ESP32-S3 + Cognitum Seed |

$27 |

完整功能(推荐) |

| ESP32 Mesh(3-6节点) |

$54 |

多人追踪 |

| 研究级网卡 |

$50-100 |

完整CSI+MIMO |

部署步骤:

- 刷写固件:将 RuView 固件刷入 ESP32-S3

- 启动感知服务器:

docker run -p 3000:3000 ruvnet/wifi-densepose:latest

- 连接节点:ESP32 自动连接到服务器

- 打开可视化界面:访问 Observatory Dashboard 查看实时数据

方式三:训练自己的模型(高级)

RuView 提供了完整的训练 pipeline,无需 PyTorch:

# 1. 收集数据(2分钟)

python scripts/collect-training-data.py --port 5006 --duration 120

# 2. 训练模型

node scripts/train-ruvllm.js --data data/recordings/pretrain-*.csi.jsonl

# 3. 运行基准测试

node scripts/benchmark-ruvllm.js --model models/csi-ruvllm

训练完成后,你会得到一个 .rvf 模型文件,可以在任何支持的环境中运行——边缘设备、云端服务器,甚至是浏览器(WASM)。

项目资源

主仓库地址为:https://github.com/ruvnet/RuView。这个GitHub项目汇集了硬件设计、固件、训练代码和完整文档,展示了如何将廉价的 ESP32 芯片转变为强大的感知节点,是探索无线传感与人工智能边缘应用的绝佳起点。对于热衷于动手实现和创新的开发者来说,这类项目正是技术社区价值的体现。如果你对类似的低功耗物联网和智能感知技术感兴趣,欢迎来 云栈社区 交流分享。