在半导体工艺不断微缩的背景下,套刻误差(Overlay) 已成为影响芯片良率与性能的关键因素。作为连接不同光刻层的“桥梁”,套刻精度的测量技术也经历了从人工目视到光学自动化的演进。目前,基于图像(IBO)和基于衍射(DBO)的两种套刻量测技术是业界主流,它们究竟有何不同,又该如何选择?本文将从技术原理、发展历程、优缺点和市场趋势等维度进行深入剖析。

IBO与DBO的基本原理

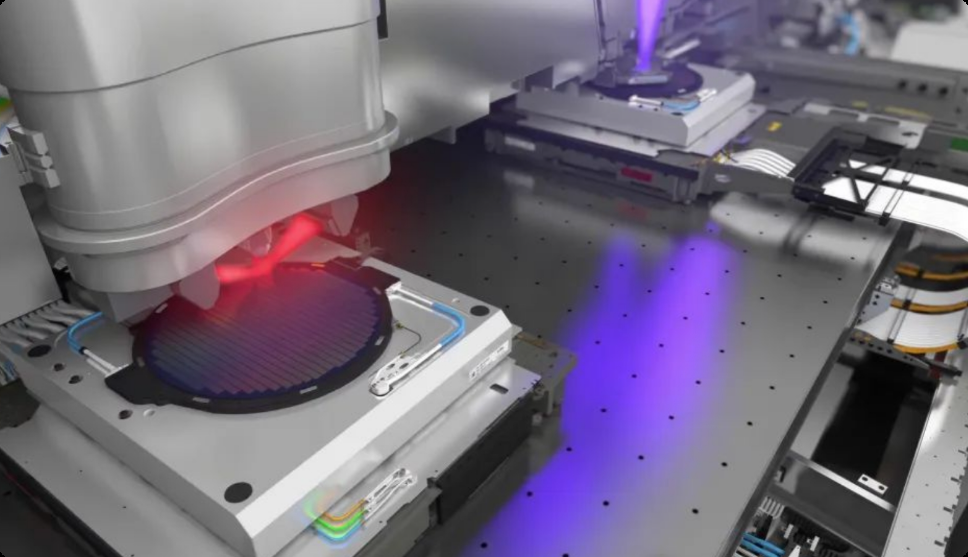

IBO(Image-Based Overlay,基于图像的套刻精度测量) 的工作原理相对直观。它通过高倍光学成像系统捕捉晶圆上预先设计的套刻标记,然后利用图像处理算法识别出前后层标记的中心或边缘坐标,最终通过像素级差值计算出套刻误差。我们常见的“Box in Box”(方框套方框)嵌套结构就是其典型标记,算法通过测量内部框与外部框的重心偏移量来确定套刻偏移量。

DBO(Diffraction-Based Overlay,基于衍射的套刻精度测量) 则采用了完全不同的物理原理。设备发射可见光波段的激光,光线穿透当前层的光刻胶,照射到前一层制作的周期性光栅标记上。当套刻误差为零时,探测器接收到的+1阶和-1阶反射光的光强信号相等。一旦出现套刻误差,由于光学衍射效应,这两个衍射级次的光强便会发生相对变化。通过定量分析这种光强的变化量,就可以精确地换算出实际的套刻误差。这种方法能够绕开光学衍射极限,实现亚纳米级的测量精度。

标记设计与技术演进差异

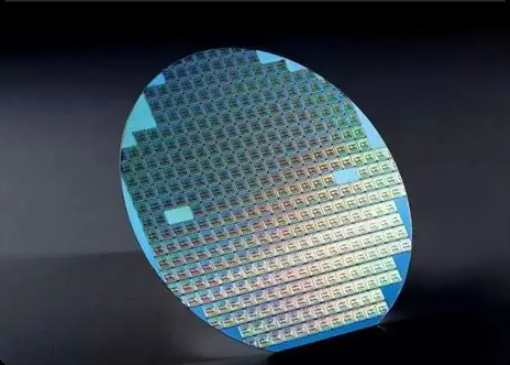

IBO与DBO在套刻标记的设计上就存在显著区别。IBO所使用的标记尺寸较大,通常为几十微米见方,会占用较多的晶圆空间,且标记本身的形貌(如光刻胶变形、边缘粗糙度)很容易引入测量误差。相比之下,DBO采用微型化的光栅标记,尺寸可以小到几微米,甚至可以嵌入到芯片内部的器件区域,因而能更真实地反映实际工艺状态,对薄膜堆栈波动等工艺变化的适应性也更强。

从技术发展历程来看,上世纪80年代以前,套刻检测主要依赖工程师的目视检查;90年代,随着KLA等公司推出首台自动光学检测系统,IBO技术开始成熟并主导产线标准化流程。然而进入纳米时代后,IBO技术受制于光学衍射极限,在28nm节点之后精度提升变得异常困难。正是为了突破这一瓶颈,DBO技术应运而生,并随着FinFET、3D NAND等复杂立体结构的兴起,逐渐成为先进制程的标配选择。

优缺点与适用场景

IBO的主要优势在于技术成熟度高,设备与算法经过产线长期验证,稳定性强;测量结果直观,图像数据可以用于后续的工艺异常分析与溯源;同时,设备购置与维护成本相对较低。它的局限也很明显:精度受限于光学衍射极限,难以满足7nm以下节点的严苛需求;而且标记尺寸大,挤占了宝贵的晶圆有效面积。

DBO的核心优势在于其极高的测量灵敏度和精度,足以支撑3nm及以下的先进制程;其标记微型化,抗工艺干扰能力强,且不依赖清晰的成像。但它的缺点也很突出:设备成本高昂,通常是IBO设备的2至3倍;对衍射物理模型的校准要求极其严格,维护复杂,光源的稳定性、光学元件的清洁度都会直接影响测量精度。

那么在实际应用中该如何选择?一个基本的原则是:对于28nm及以上的成熟制程(如大部分存储芯片、成熟逻辑芯片),优先选用IBO方案,以其成熟可靠和低成本保障产线的高效运行。而对于7nm以下的先进逻辑制程(如5nm/3nm的EUV工艺)以及3D NAND这类多层堆叠制程,则必须依赖DBO的亚纳米级精度来突破工艺瓶颈,确保产品良率。

市场格局与发展趋势

从全球市场格局看,套刻精度测量设备领域由美国KLA(其Archer系列)和荷兰ASML(其YieldStar系列)占据绝对领先地位。国内厂商如新凯来推出的“天门山”系列,虽然并非国内首创,但有效弥补了其他国产厂商在技术和产能上的不足,对于提升国内半导体供应链的自主可控能力和议价空间具有重要意义。

展望未来,技术的发展呈现出融合与智能化的趋势。融合了IBO直观性与DBO高精度的混合测量方案正成为主流,例如KLA的ATL™技术就能根据不同的工艺环节自动切换测量模式。同时,人工智能算法正被嵌入量测的全流程,用于优化图像识别与复杂的衍射信号拟合过程,从而提升整体测量效率。此外,将光学技术边界向EUV、X射线等更短波段拓展,以支撑未来1nm以下节点的计量需求,也是业界重要的探索方向。

技术的深入理解离不开扎实的基础。无论是IBO依赖的图像处理算法,还是DBO背后的衍射物理模型,其核心都建立在严密的计算机基础和数理逻辑之上。对底层原理的探究,往往能帮助我们更好地把握技术演进的方向。如果你对这类硬核技术解析感兴趣,欢迎在云栈社区与其他开发者交流探讨。 |