最近,DeepSeek-TUI 在开发者圈子里着实掀起了一阵波澜。

但它走红的原因,并非开发者们突然迷上了命令行界面,也不是因为市场缺少一个终端里的聊天工具。

更直接地说,是 Claude Code 已经完成了 AI Coding Agent 的市场教育:它确实强大,能读懂项目、修改文件、执行命令、修复 Bug。然而,当开发者开始每天使用、团队多人协作、并将其接入真实项目流水线时,一个尖锐的问题也随之浮出水面——成本和额度焦虑。

所以,DeepSeek-TUI 真正引人关注的,并不是“终端里也能用 DeepSeek”,而是:

它能否成为一个更便宜、更开放的 Claude Code 平替?

DeepSeek-TUI 火的核心:Claude Code 平替

Claude Code 凭什么能成为 AI Coding 工具里的标杆?

因为它头一回让开发者清晰地感受到:你可以把一个开发任务直接丢给它,让它自行阅读项目、理解上下文、修改文件、执行命令、查看报错,并持续修复。这是一种远比简单问答更接近真实开发流程的体验。

DeepSeek-TUI 的功能其实不难理解。

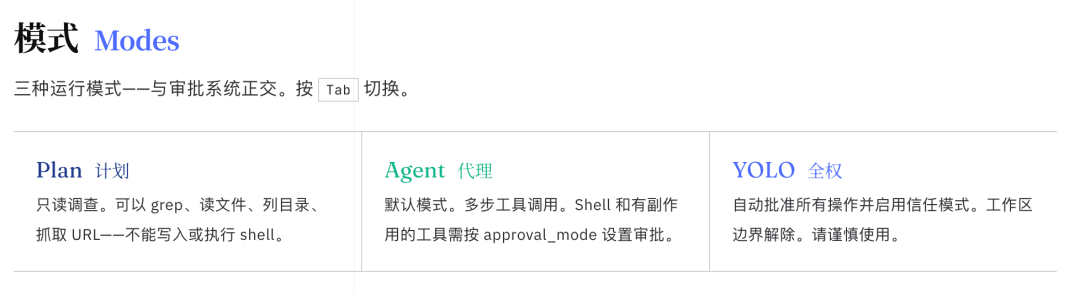

它是一个跑在终端里的 AI Coding Agent,具备读写文件、执行 Shell、管理 Git、调用 MCP 等能力,并支持 Plan、Agent、YOLO 等多种模式。项目文档里也列出了 Shell、Git、diagnostics、run_tests、Sub-agents、MCP 等一系列工具清单。

但对专业开发者而言,功能列表从来不是重点。

重点是它复刻了 Claude Code 这类工具最关键的体验:AI 能真正进入项目上下文,能理解代码结构,能动手修改文件,能执行命令,能多轮推进任务,还能让用户看到背后的 Token 消耗。

这正是 DeepSeek-TUI 的传播爆点。

开发者真正想要的不是在终端里多开一个聊天窗口,而是:能不能用更低的成本,获得类似 Claude Code 的 AI Coding Agent 体验?

为什么成本会成为 AI Coding 的核心问题?

Claude Code 类工具最容易被低估的一点是:它改变的不是单次问答的成本,而是整个开发流程的成本结构。

这其中最大的原因在于,在 Agent 任务启动前,你很难预判这条调用链会有多长。

一个简单的问题,可能两轮就结束了。

但一个复杂的问题,可能读了十几个文件、跑了几次测试、改了三四轮,最后还要再总结一遍 diff。这便是 AI Coding Agent 与普通聊天的本质区别:

普通聊天是按问题消耗,Coding Agent 是按任务过程消耗。

而开发任务的过程,天然就是不确定的。

所以,这类工具越好用,开发者反而越容易滋生一种新的焦虑:

- 我当然想让它多读一点上下文。

- 我当然想让它多跑几轮测试。

- 我当然想在开源实战中多尝试几个方案。

- 但我不知道这次任务最终会烧掉多少 Token。

这说明成本问题不是边缘问题,而是 AI Coding Agent 的核心体验问题。因为一旦成本不可控,开发者的使用方式就会被反向限制:

- 不敢让它读完整项目;

- 不敢让它处理大模块;

- 不敢让它连续跑调试;

- 不敢让它多尝试几种实现;

- 不敢把它真正接进日常开发流程。

最终就会出现一个很矛盾的状态:不是不知道 Claude Code 好用,而是不敢毫无顾虑地放开用。

Claude Code 证明了 AI Coding Agent 的体验上限;而 DeepSeek-TUI 则让开发者开始探寻这种体验的成本下限。

这才是 DeepSeek-TUI 被广泛关注的根本原因。

低成本平替,只是第一步

如果只是个人尝鲜,DeepSeek-TUI 的使用路径非常简单:装好工具,填上 API Key,开跑。

但一旦进入高频使用,问题就会变得复杂。

你可能不只用 DeepSeek-TUI,还会结合 Claude Code、OpenClaw、Hermes、Cline、Cursor,甚至自己动手写一些脚本和 Agent。你可能不只用到 DeepSeek,也会在不同任务里调用 Kimi、GLM、MiniMax 或其他模型。

一个人玩的时候,自己配置一个 Key 就够了。

一旦团队多人常态化使用 AI Coding Agent,各自独立配置 API Key、单独充值记账,就容易出现额度分散、账单不统一、模型管理混乱等问题。这时候,真正的问题不再是:有没有一个平替版的 Claude Code?

而是:

这套低成本的 AI Coding 方案,到底能不能长期、稳定、可控地跑下去?

高频 AI Coding 用户、小团队、一人公司和 AI 应用开发者,普遍有着统一模型调度、额度管控、团队账单的需求。在这个环节,第三方企业级 Token 聚合服务恰好能形成有力的价值补充。

七牛云 Token Plan:把平替方案变成长期方案

如果说 DeepSeek-TUI 解决的是有没有低成本 Claude Code 平替的问题,那么七牛云企业级 Token Plan 解决的则是:这套平替方案能不能长期、稳定、团队化地持续运转。

如果你只是周末装一下 DeepSeek-TUI 体验一把,直接用个人版就行。

但如果你已经开始高频使用 AI Coding Agent,或者团队里多人都在用 DeepSeek-TUI、Claude Code、OpenClaw、Hermes、Cline 这类工具,问题就不再只是哪个模型更便宜,而是:

- 多个工具怎么统一接入?

- 多个模型怎么灵活切换?

- 多个人怎么共用额度?

- 账单和消耗怎么统一管理?

- 如何避免为每个工具、每个平台都单独配 Key、单独充值?

七牛云企业级 Token Plan 覆盖了通用对话、代码生成、推理增强、多模态等模型能力,支持 DeepSeek、Kimi、GLM、MiniMax 等多家模型灵活选择与切换。订阅权益包含多模型自由切换、统一 API Key、按积分计算消耗、额度每自然周刷新等,其中也包括 deepseek/deepseek-v4-pro 和 deepseek/deepseek-v4-flash 等模型。

它同时兼容 OpenAI API 和 Anthropic API 接口格式。对于 DeepSeek-TUI 这类支持 OpenAI-compatible provider / base_url 配置的工具,可以按兼容接口方式直接接入测试。

配置思路大致如下:

-

打开配置文件

nano ~/.deepseek/config.toml

-

写入配置

在 ~/.deepseek/config.toml 中修改为:

provider = "openai"

model = "deepseek/deepseek-v4-flash"

[providers.openai]

api_key = "QINIU_API_KEY"

base_url = "https://api.qnaigc.com/v1"

-

保存退出

Ctrl+O → 回车 → Ctrl+X

-

验证

deepseek

你可以用 DeepSeek-TUI 承担代码理解、Bug 修复、脚本生成等 Coding Agent 任务;也可以在不同场景里切换 Kimi、GLM、MiniMax 等模型;而背后的模型调用、额度和成本,则可以统一放在七牛云 Token Plan 里进行管理。

这比每个工具单独配一个 Key、每个平台单独充值、每个人各自盯着自己的账单要更适合长期使用。

如果你已经在高频使用 AI Coding Agent,或者团队正在评估 DeepSeek-TUI 等工具,不妨尝试用七牛云企业级 Token Plan 作为统一的模型资源层:

- 支持 DeepSeek V4 Pro / Flash;

- 一个 API Key 接入多模型;

- 兼容 OpenAI / Anthropic 接口;

- 适合高频、长期、团队化调用。

让 AI Coding 不止跑起来,也能持续跑下去。

在这股技术浪潮中,云栈社区 也见证着许多开发者从单打独斗的尝鲜,转向组队探索更稳定、更低成本的人工智能开发工作流。这种从“能用”到“用好”的转变,正是技术社区最迷人的地方。