就在前几天,我在 X 上看到一条推文引起了我的注意:

“Chain of Thought 已死。我刚测试了 Atom of Thought 提示法,它让 AI 模型在复杂推理任务上的准确率提高了 30-40%。”

说这话的可不是随便哪个网友,而是基于 2025 年最新 NeurIPS 论文《Atom of Thoughts for Markov LLM Test-Time Scaling》的研究成果。

作为一直关注 AI 应用开发的从业者,我立刻去扒了这篇论文和相关资料。在技术社区 云栈社区 的讨论中,这种能显著提升模型表现的新方法往往备受关注。今天就来跟大家好好聊聊这个可能颠覆你使用 AI 方式的新技术。

01 Chain of Thought 怎么了?

如果你经常用 AI,一定听说过 Chain of Thought (CoT),也就是“思维链”提示法。

简单说,就是让 AI“一步步思考”。比如你问一个数学题,加上“请逐步解答”这个指令,AI 就会展示完整的推理过程,答案往往更准确。

这招过去两年特别火,甚至成了很多 AI 模型的默认功能。

但 CoT 有个致命问题:历史信息累积太多。

想象一下,AI 每走一步都要背着之前所有步骤的“包袱”。问题越复杂,包袱越重,不仅浪费计算资源,还可能干扰推理。

就像你解题时,如果每一步都要重新默写前面所有步骤,是不是很容易出错?

02 Atom of Thought:化繁为简的艺术

Atom of Thought (AoT) 的核心思想就四个字:分而治之。

它不是让 AI 沿着一条链走到底,而是把复杂问题拆解成一个个独立的原子问题,每个问题自包含、可验证,解决后再整合答案。

这就像:

- CoT 是接力赛:一棒传一棒,前面掉链子后面全完

- AoT 是团队短跑:大家各自跑完,最后汇总成绩

工作原理

AoT 的推理过程分为两个阶段:

1. 分解 (Decomposition)

把当前问题拆成依赖关系的有向无环图 (DAG),识别出哪些子问题可以独立解决,哪些需要依赖其他子问题的结果。

2. 收缩 (Contraction)

把已解决的独立子问题变成“已知条件”,重新表述成一个更简化的新问题,然后继续迭代。

这个过程会一直重复,直到问题简化到可以直接求解。

一个直观例子

假设你要解二次方程 3x² - 5x + 2 = 0

用 CoT: AI 会一步步写:首先识别方程类型 → 然后套用求根公式 → 计算判别式 → 代入公式 → 得出结果 x=1 和 x=2/3

用 AoT: AI 会独立处理:

- 原子 1:计算判别式 Δ = b² - 4ac

- 原子 2:代入求根公式 x₁ = (-b + √Δ) / 2a

- 原子 3:代入求根公式 x₂ = (-b - √Δ) / 2a

- 整合:得出最终答案

这些原子步骤可以并行执行,效率更高。

03 实测数据:效果有多猛?

论文团队在 6 个基准测试上验证了 AoT 的效果,结果相当惊人:

| 任务类型 |

CoT 准确率 |

AoT 准确率 |

提升 |

| 数学推理 (MATH) |

78.3% |

83.6% |

+5.3% |

| 数学推理 (GSM8K) |

90.9% |

95.0% |

+4.1% |

| 逻辑推理 (BBH) |

78.3% |

86.0% |

+7.7% |

| 多跳问答 (HotpotQA) |

67.2% |

80.6% |

+13.4% |

| 长文本理解 (LongBench) |

57.6% |

68.5% |

+10.9% |

最夸张的是,当用 AoT 框架配合 gpt-4o-mini 时,在多跳问答任务上超越了 o3-mini 和 DeepSeek-R1 等顶级推理模型。

这意味着什么?

你用普通模型 + 好方法,可以打败顶级模型 + 普通方法。

04 什么时候该用 AoT?

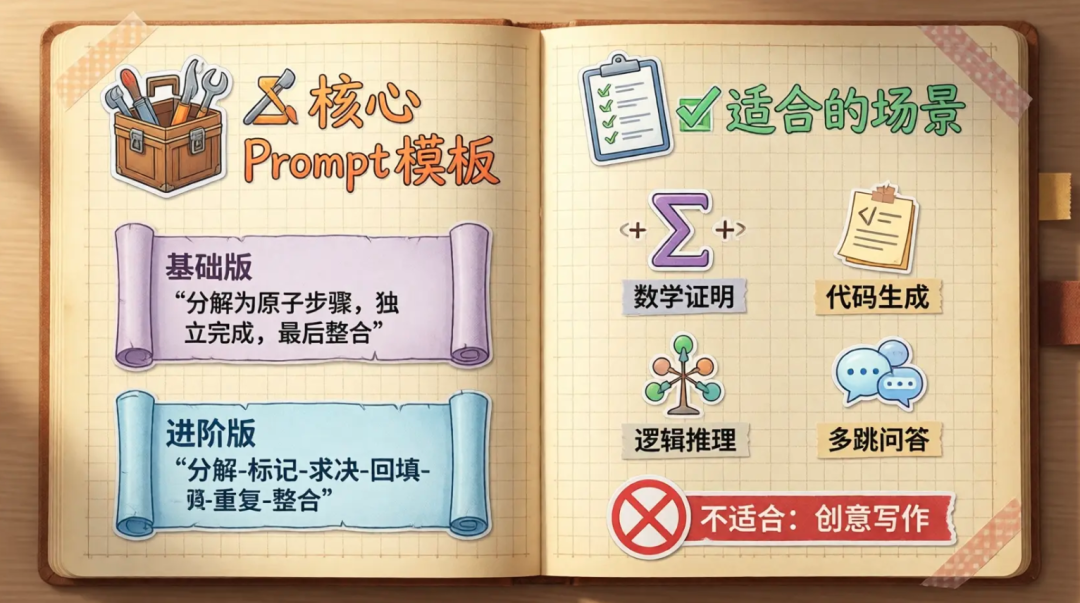

AoT 虽强,但不是万能钥匙。根据论文和实测经验,我总结了适用场景:

✅ 适合用 AoT 的场景

- 数学证明和计算:步骤清晰,可独立验证

- 代码生成:函数、模块可以分开处理

- 逻辑推理题:前提和结论可以拆解分析

- 多跳问答:需要跨多个信息源整合答案

- 复杂数据分析:各维度指标可以独立计算

❌ 不适合用 AoT 的场景

- 创意写作:故事、诗歌需要连贯性

- 开放对话:上下文依赖强

- 简单问题:杀鸡用牛刀,没必要

- 需要情感理解的任务:原子化会丢失语境

判断原则: 如果问题能自然拆成独立子问题,AoT 就派得上用场。

05 实战:如何用 AoT 提示 AI?

目前不是所有 AI 都原生支持 AoT,但你可以用提示词来模拟。关于这类 AI 的提示工程技术,可以参考一些专门的技术文档教程来深化理解。

基础版提示词

请将我提出的问题分解为最原子的、自包含的步骤。

每个步骤应尽可能独立,不依赖其他步骤的结果。

如果可以并行执行,请相应组织。

分别完成每个步骤后,再整合所有结果给出最终答案。

进阶版提示词

使用 Atom of Thought (AoT) 方法解决这个问题:

1. 首先将问题分解为多个独立的原子子问题

2. 识别哪些子问题可以并行解决

3. 分别求解每个子问题

4. 将已解决的子问题作为已知条件,简化原问题

5. 重复上述过程直到问题可直接求解

6. 整合所有结果给出最终答案

请展示你的分解过程和推理步骤。

实际案例

问题: “所有猫都是哺乳动物,有些哺乳动物不是猫;因此,有些猫不是哺乳动物。这个推理是否有效?”

AoT 提示后 AI 的回答:

步骤 1:独立解释前提 1“所有猫都是哺乳动物”

→ 这是一个全称肯定命题,表示猫集合是哺乳动物集合的子集

步骤 2:独立解释前提 2“有些哺乳动物不是猫”

→ 这是一个特称否定命题,表示哺乳动物集合中存在不属于猫集合的元素

步骤 3:独立解释结论“有些猫不是哺乳动物”

→ 这是一个特称否定命题,声称猫集合中存在不属于哺乳动物集合的元素

步骤 4:整合分析

前提 1 已确立“猫⊆哺乳动物”,因此不可能存在“不是哺乳动物的猫”

结论与前提 1 直接矛盾

步骤 5:判断

这是一个逻辑谬误——错误地逆转了前提 2 中的逻辑关系

推理无效

看到没?每个步骤独立清晰,最后整合时逻辑链条也很明确。

06 为什么 AoT 能减少 AI 幻觉?

AI 幻觉(胡说八道)一直是老大难问题。AoT 在这方面也有奇效。

原因有三:

1. 独立验证

每个原子步骤可以单独检查,错了容易发现,不会像 CoT 那样“一步错步步错”。

2. 减少信息干扰

历史信息累积少了,AI 专注于当前状态,不容易被无关信息带偏。

3. 并行执行

多个子问题同时处理,可以交叉验证结果的一致性。

论文作者提到,虽然还需要更多实证研究,但从理论上讲,AoT 确实有降低幻觉风险的潜力。

07 给开发者的启示

作为 AI 应用开发者,AoT 给我几个重要启发:

1. 方法比模型更重要

同样的模型,用不同的提示方法,效果可以天差地别。与其盲目追求更大更强的模型,不如先优化你的提示工程。

2. 结构化思维是关键

AoT 的本质是结构化分解问题。这种能力不仅适用于 AI,也是人类解决复杂问题的核心技能。

3. 并行化是趋势

AoT 支持并行执行,这符合 AI 硬件发展的方向。未来的 AI 应用设计,应该更多考虑如何利用并行计算优势。

4. 可解释性很重要

AoT 的每一步都清晰可见,方便调试和优化。在构建生产级 AI 应用时,可解释性往往比单纯的准确率更重要。

08 写在最后

AI 提示工程正在快速演进。从最早的零样本提示,到 CoT,再到现在的 AoT,我们看到了一个清晰的趋势:

让 AI 更像人类一样思考——不是模仿思考的过程,而是模仿思考的结构。

AoT 不是银弹,但它确实是工具箱里的一件利器。关键是知道什么时候用、怎么用。

最后分享论文里的一句话:

“重要的是不要停止提问。”

不仅要问 AI 问题,也要问自己:我是不是在用对方法?如果你想了解更多前沿的技术实践和深度解析,不妨多逛逛像 云栈社区 这样的开发者聚集地,总能发现新思路。