就在最近,大模型圈迎来了一颗重磅炸弹:阿里巴巴正式开源了全新一代大模型——Qwen3.5-397B-A17B,并一举登顶全球最强开源模型的宝座。

面对如此强悍的模型,许多开发者的第一反应可能是兴奋,紧接着就是担忧:“这么庞大的模型,部署起来岂不是一场噩梦?” 确实,传统的部署方式往往伴随着复杂的GPU环境配置、繁琐的运维监控以及难以实现的弹性伸缩。

今天,我们要介绍一个彻底改变游戏规则的解决方案——通过阿里云函数计算 FC,实现一键部署 Qwen3.5-397B-A17B,让顶级模型的计算力变得前所未有的简单和触手可及。

为何选择 Qwen3.5-397B-A17B?

本次开源的 Qwen3.5-397B-A17B 绝非一次简单的版本迭代,它在架构和性能上实现了质的飞跃:

- 性能卓越:其整体性能已超越万亿参数的 Qwen3-Max 模型,总参数量高达3970亿,但激活参数仅为170亿。它采用了创新的混合架构(线性注意力 Gated Delta Networks + 稀疏混合专家 MoE),在保持强大能力的同时,显著优化了推理速度与成本。

- 成本大降:部署显存占用降低高达 60%,推理效率大幅提升,最大推理吞吐量甚至可提升至 19倍。

- 全能多面手:作为原生视觉-语言模型,在推理、编程、智能体能力与多模态理解上均表现优异。语言支持从119种大幅扩展至 201种,真正实现全球通用。

函数计算:大模型部署的新范式

传统部署的痛点,在函数计算FC的Serverless架构面前迎刃而解。函数计算已同步接入Qwen3.5系列模型,提供开箱即用的企业级部署方案。基于 Serverless GPU,开发者无需关心底层基础设施的运维、扩缩容和监控,可以完全专注于模型本身的应用与业务创新。

实战:三步完成一键部署

下面,我们将通过三个核心步骤,演示如何利用函数计算平台快速部署 Qwen3.5-397B-A17B。

步骤一:准备模型文件(下载至OSS)

首先,我们需要将模型文件下载到阿里云对象存储 OSS 中。我们可以使用一个官方提供的白屏化工具来完成这个任务。

-

部署下载工具:

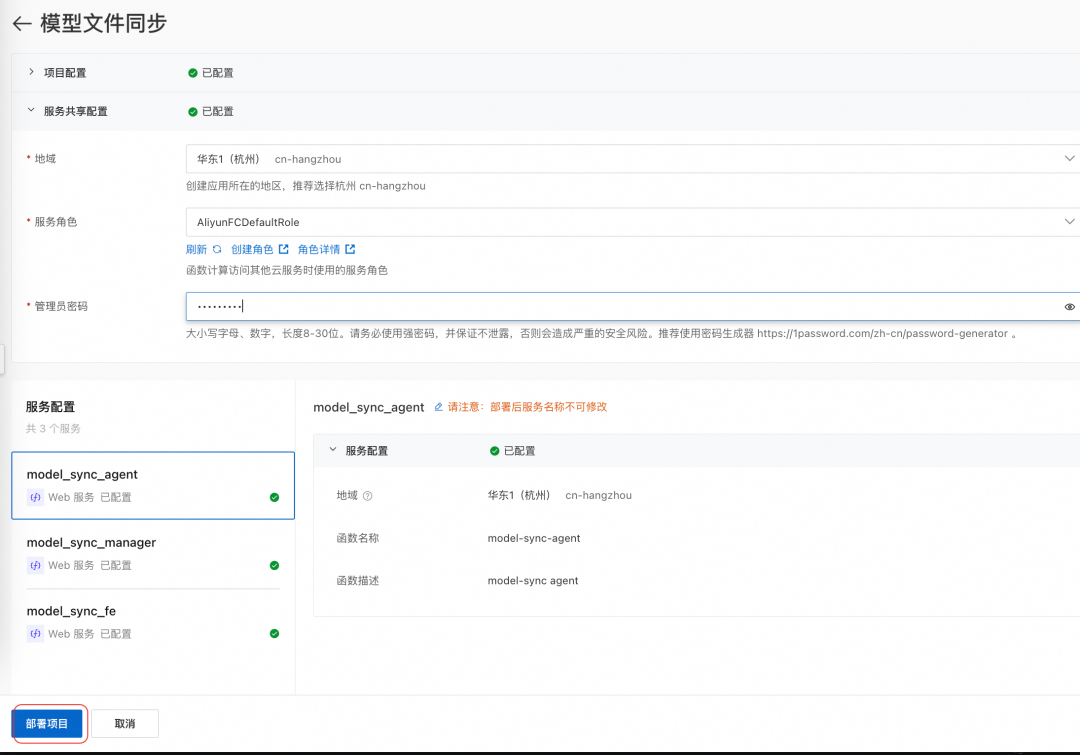

访问工具部署页面:https://functionai.console.aliyun.com/old/template-detail?template=283,按照指引完成部署。部署成功后,界面如下图所示:

-

访问工具并创建下载任务:

部署成功后,通过访问地址进入工具管理界面。点击“创建第一个任务”。

-

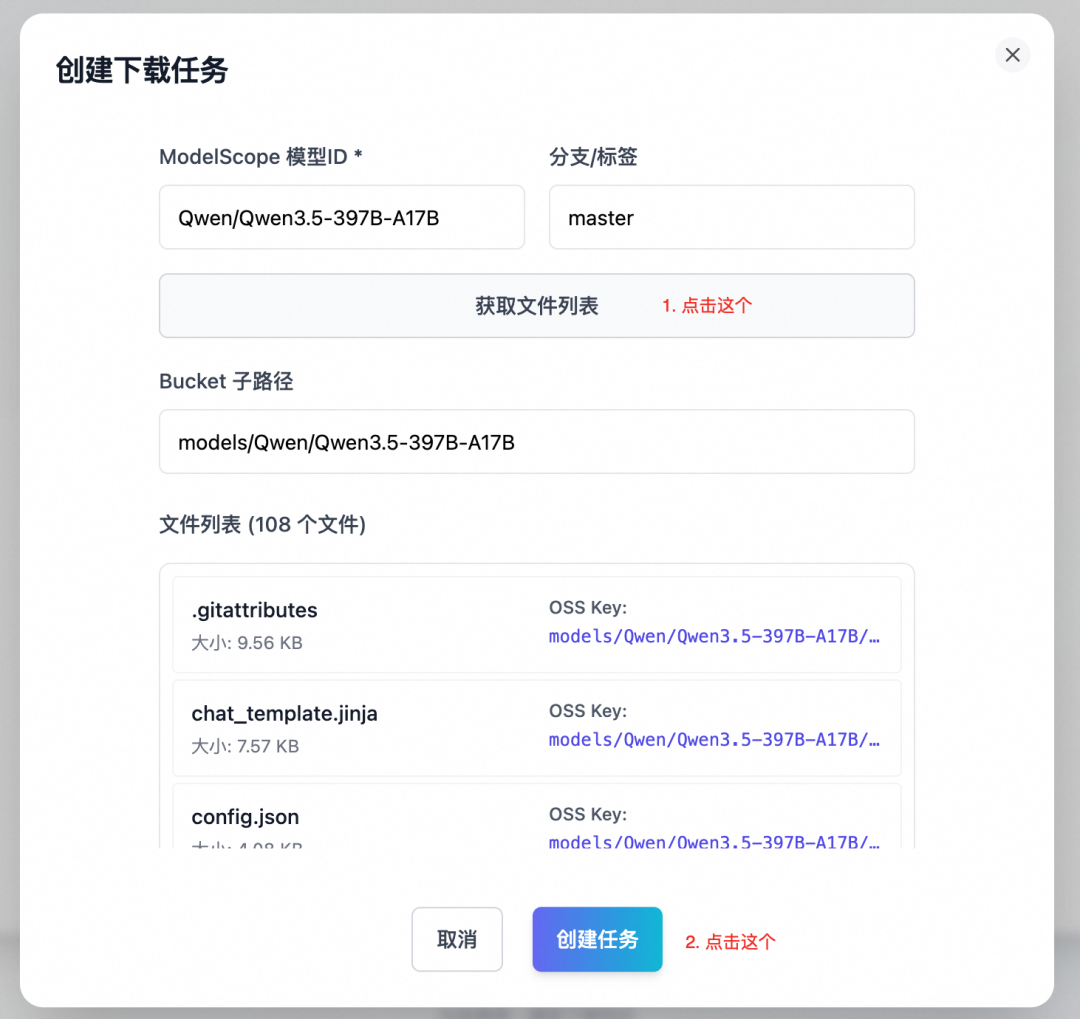

配置并启动下载:

在创建任务页面,填写 ModelScope 模型ID为 Qwen/Qwen3.5-397B-A17B,并设置好Bucket中的存储路径(例如 /models/Qwen/Qwen3.5-397B-A17B)。点击“获取文件列表”确认后,创建任务即可开始下载。

注意:该模型体积非常庞大,下载过程需要一定时间,请耐心等待。

步骤二:配置并部署模型服务

模型文件准备好后,我们就可以在函数计算的模型平台(FunModel)上进行一键部署。

-

进入自定义部署页面:

访问 https://functionai.console.aliyun.com/fun-model/cn-hangzhou/custom-model-create。

-

选择模型环境与来源:

- 模型环境:选择

vLLM(高效LLM推理)。

- 模型来源:选择“对象存储OSS”,并配置好上一步中模型文件所在的Bucket和路径。

-

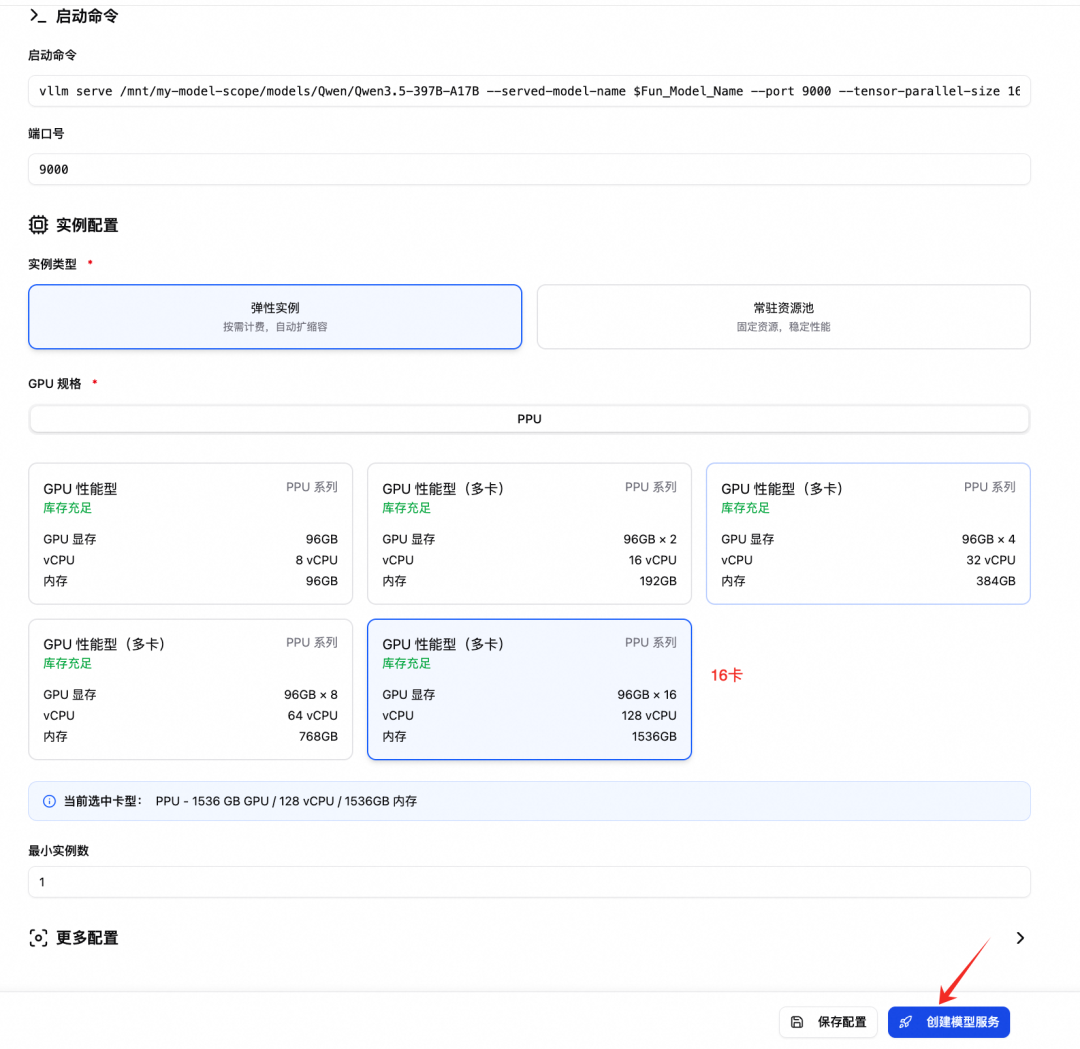

配置计算资源与启动命令:

- GPU规格:根据 Qwen3.5-397B-A17B 的需求,选择足够的GPU资源(例如PPU系列多卡规格)。

- 启动命令:这是关键步骤,需要填写正确的vLLM启动命令。一个针对此模型的参考命令如下:

vllm serve /mnt/my-model-scope/models/Qwen/Qwen3.5-397B-A17B --served-model-name $Fun_Model_Name --port 9000 --trust-remote-code --gpu-memory-utilization 0.9 --max-model-len 262144 --tensor-parallel-size 16 --enable-auto-tool-choice --tool-call-parser qwen3_coder --reasoning-parser qwen3

-

创建模型服务:

检查所有配置无误后,点击“创建模型服务”,系统将自动完成资源的分配、镜像的拉取和服务的启动。

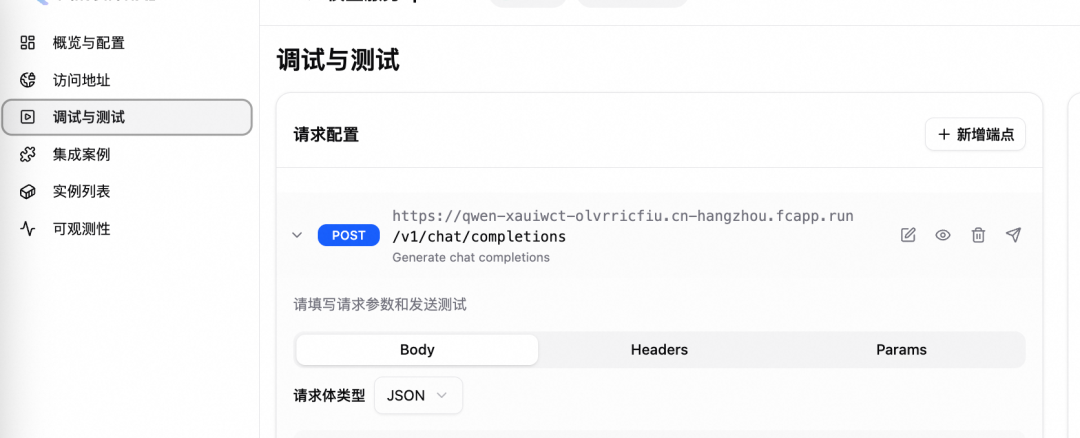

步骤三:测试与验证

部署成功后,服务状态将变为“运行中”。此时,你可以直接在控制台的“调试与测试”页面,使用内置的测试工具向模型发送请求,验证服务是否正常工作。

至此,全球顶尖的开源大模型 Qwen3.5-397B-A17B 就已经通过函数计算成功部署,并提供了标准的 OpenAI API 兼容接口,可供你的应用程序直接调用。

不止于此:丰富的模型生态

除了Qwen3.5-397B-A17B,函数计算模型市场还提供了众多其他版本的Qwen3.5模型,甚至涵盖其他主流开源模型,均可实现类似的一键部署,极大地丰富了开发者的选择。

方案对比与总结

让我们通过一个简单的表格,直观感受函数计算方案带来的变革:

| 维度 |

传统自建GPU方案 |

函数计算 FunModel |

| 部署时间 |

以天甚至周计 |

5分钟左右 |

| 技术门槛 |

高(需精通CUDA、Docker、K8s等) |

低(白屏化操作) |

| 运维与迭代成本 |

高(需专职团队维护) |

低(全托管,自动扩缩容) |

依托 Serverless + GPU 的黄金组合,函数计算为大模型部署提供了简单、轻量、近乎零门槛的集成方案。这不仅给了个人开发者轻松“玩转”顶级模型的体验,也让企业级开发者能够快速、高效、经济地完成模型的部署、运维和迭代。

在AI浪潮下,模型迭代速度日新月异,部署需求与日俱增。函数计算FC正在为模型部署树立新范式,让开发者能够更自由地探索人工智能的无限可能。如果你对更多云原生和AI实践感兴趣,欢迎来到云栈社区交流探讨。

扩展阅读

- [1] FunModel 快速入门:

https://fun-model-docs.devsapp.net/getting-started/

- [2] FunModel 自定义部署指南:

https://fun-model-docs.devsapp.net/user-guide/custom-model-deployment/

|