刚刚,开源 AI 代理框架 OpenClaw 发布了 2026.3.7 版本测试版。本次更新不仅第一时间接入了 OpenAI 的 GPT-5.4 和 Google 的 Gemini 3.1 Flash-Lite 等前沿大模型,更引入了一项可能改变游戏规则的功能:可插拔的上下文引擎。

此次更新的详细内容列表包括:

- ACP 绑定在重启后依然可保留

- 精简版 Docker 多阶段构建

- 用于网关认证的 SecretRef

- 可插拔的上下文引擎

- 支持 HEIF 图像格式

- 修复 Zalo 渠道问题

其中,“可插拔的上下文引擎(pluggable context engine)” 成为了社区讨论的焦点。有开发者指出,上下文管理才是当前 AI 应用,特别是智能体(Agent)范式的真正瓶颈,而非模型本身。

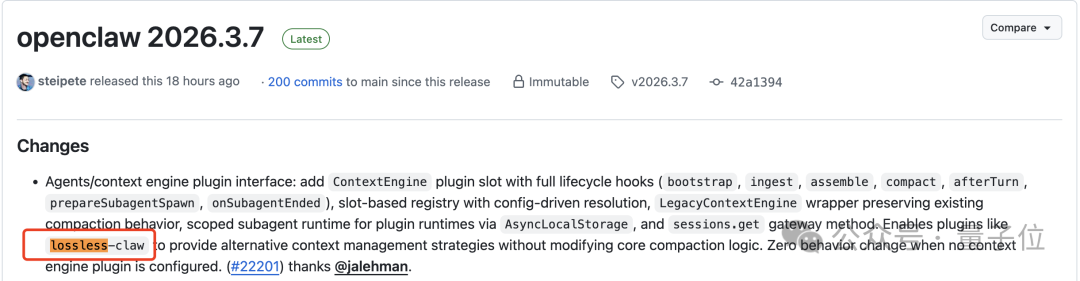

更值得注意的是,在官方的更新日志中,直接点名了一个名为 lossless-claw 的插件作为示例。这引发了大家的好奇:这个上下文插件究竟是什么?它能解决什么问题?

上下文管理插件化:从“写死”到“可编程”

总体来看,OpenClaw 2026.3.7 的更新可以归纳为三个方向:上下文管理插件化、Agent 路由能力升级以及部署与工程化优化。而最核心的变革,无疑是上下文管理的插件化。

根据官方日志,本次更新新增了 ContextEngine 插件插槽。该接口提供了一套完整的生命周期钩子,例如 bootstrap(初始化)、ingest(摄取)、assemble(组装)、compact(压缩)等。这意味着,第三方插件现在能够深度介入上下文生成、压缩、拼接乃至子 Agent 生命周期的各个阶段,从而实现完全定制化的上下文管理策略。

用本次更新主要贡献者 Josh Lehman 的话来总结:

你其实不需要一个 Agent 记忆系统,你需要的是不会被重置的上下文。

在过去的版本中,OpenClaw 的上下文管理逻辑是“写死”在核心代码里的。例如,当对话历史过长时,系统如何压缩、如何丢弃旧信息,都是由固定算法决定,开发者难以干预。这直接导致了一些常见的用户体验问题:

- 长对话后期,Agent 开始“偷懒”,只列要点而不按要求详细输出。

- Agent 逐渐忘记早先制定的计划或修改过的文件。

- 任务执行到后半段,模型的响应质量明显下降,显得“变笨”了。

新的插件化机制,正是为了根治这些“健忘症”。简单来说,它带来了以下改变:

- 策略多样化:不同插件可以实现截然不同的上下文管理策略。

- 核心解耦:系统核心不再包含写死的压缩逻辑,变得更加灵活和可扩展。

- 精细控制:插件可以控制上下文压缩、组装,以及子 Agent 的整个生命周期。

其最直观的收益就是,在与 OpenClaw Agent 进行长时间、多轮复杂对话时,它的“记忆力”和任务一致性将得到显著提升。这无疑是人工智能 Agent 在实际应用中迈出的关键一步。

lossless-claw 插件:实现“无损”上下文管理

官方推荐的 lossless-claw 插件,就很好地诠释了这种新思路的力量。它提出并实现了一种名为“无损上下文管理(LCM)”的策略。

在传统系统中,面对冗长的对话历史,常见的做法是直接丢弃超出窗口的旧消息。而 lossless-claw 采用了截然不同的方法:

- 持久化存储:将所有历史消息完整地保存到 SQLite 数据库中,并按对话会话进行组织。

- 智能摘要:对较早的消息块,使用配置好的大模型生成摘要。

- 构建记忆图:将这些摘要压缩为更高层级的节点,形成一个有向无环图(DAG)结构,用以表示对话的脉络和关联。

- 动态组合上下文:在每一轮对话时,将高层级的摘要与最近期的原始消息组合起来,形成提交给模型的上下文。

- 提供回溯工具:为 Agent 提供如

lcm_grep、lcm_describe 等工具,使其能够主动搜索、描述和展开任何历史摘要,回溯到原始对话。

这意味着,在多轮交互中,原始消息被完整保留,系统通过摘要层维持对历史的理解和关联,而 Agent 在需要时可以随时“追溯”到任何细节。理论上,上下文实现了“永不丢失”。

(值得一提的是,该插件的设计思路源于论文《LCM: Lossless Context Management》,为感兴趣的研究者和开发者提供了理论参考。)

根据 OOLONG benchmark 的测试结果,使用相同模型时,搭载 lossless-claw 的 OpenClaw 得分为 74.8,超过了 Claude Code 的 70.3。更重要的是,测试显示的规律是上下文越长,性能优势越明显。Josh Lehman 表示,他已在实际场景中运行该插件一周,并评价其表现“远超预期”。

其他重要更新

除了革命性的上下文插件系统,本次更新还包括另外两大改进:

1. 强化的 Agent 路由系统

针对 Discord、Telegram 等协作平台,引入了持久化的线程绑定机制。即使 OpenClaw 服务重启,Agent 与特定频道或话题的绑定关系也不会丢失。同时,新增了按主题路由 Agent 的能力。例如,在 Telegram 的一个群组中,不同的讨论主题可以各自运行一个独立的 Agent,从而实现多任务并行处理。

2. 部署与工程化优化

为更好地支持生产环境部署,官方推出了基于 bookworm-slim 的 Docker 镜像。通过多阶段构建和移除非必要依赖,显著减少了容器体积,提升了启动速度,更适合服务器端大规模部署。此外,版本也开始为未来登陆 iOS App Store 和发布移动端应用进行前期准备。

对于关注 AI 智能体开发和前沿实践的开发者而言,OpenClaw 此次更新将上下文管理的控制权交给了社区,开启了新一轮开源实战与创新的可能性。更多技术细节和完整更新日志,可以参考以下链接:

本文由云栈社区整理发布,聚焦于前沿技术解读与开发者实践分享。