就在昨天,美光、三星、西数这些平时表现稳健的存储巨头们,股价意外地集体出现大幅下跌。一不是供应链断裂,二不是财报暴雷,这突如其来的市场反应让不少人感到困惑。

经过一番梳理,业界发现这波震荡的源头,很可能指向了谷歌研究院近期展示的一篇重量级论文(该论文将于下个月的 ICLR 2026 正式发表)。

这篇论文的核心内容是什么?简而言之,谷歌的研究团队提出了一种名为 TurboQuant 的全新压缩算法。它的目标非常明确:将 AI 大模型进行推理时最消耗内存的 “KV Cache”(键值缓存) 部分,压缩至少 6 倍,并且声称可以实现 “精度零损失”。

消息一出,市场迅速将其解读为“未来运行 AI 对物理内存的需求将大幅降低”,于是存储厂商的股价率先做出了反应。那么,这项技术究竟是怎么回事?它是否真的如此神奇?我们来深入了解一下。

首先,我们需要理解 KV Cache 是什么。你可以把它想象成 AI 在与你对话时的 “短期记忆草稿本”。如今的大模型普遍支持数十万甚至上百万字符的长上下文,为了让 AI 能记住之前的对话内容、保持逻辑连贯,就必须将生成过程中产生的大量中间数据临时存储起来。

然而,随着上下文长度不断增加,这本“草稿本”所需的物理内存空间会呈 平方级甚至更高复杂度 增长。

这就导致了一个非常现实的问题:在当前的大模型推理中,计算能力(算力)往往不是最大的瓶颈,内存容量和带宽反而成为了主要的性能制约因素。好比你的大脑思维速度极快,但手边用于记录要点的草稿纸却很快用完,直接限制了你的发挥。

为了节省内存,业界此前普遍采用“量化”技术。简单说,就是把高精度(如FP16)的数据用更低精度(如INT8、INT4)来表示,从而减少存储空间。但这是一种有损压缩,通常会带来模型精度的下降(俗称“掉智商”)。更麻烦的是,一些量化方法还需要额外存储一堆“量化常数”,一来二去,节省下来的空间又被额外开销吃掉一部分,效率提升有限。

而谷歌这次提出的 TurboQuant 思路非常巧妙,它通过两招组合拳,几乎将额外开销降到了零。

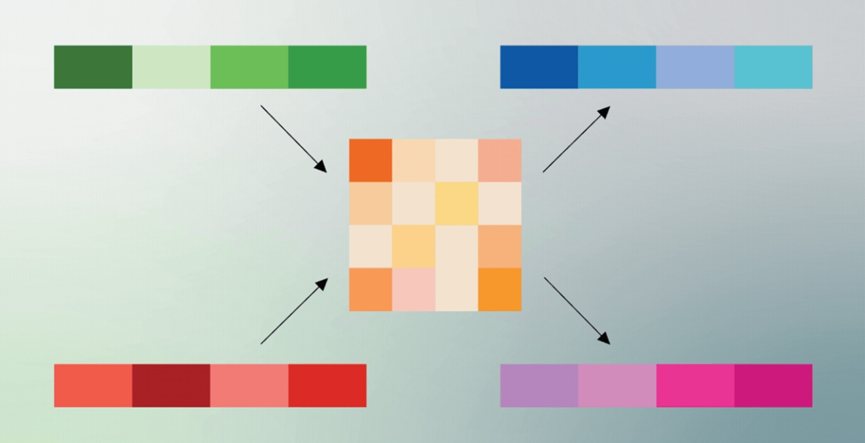

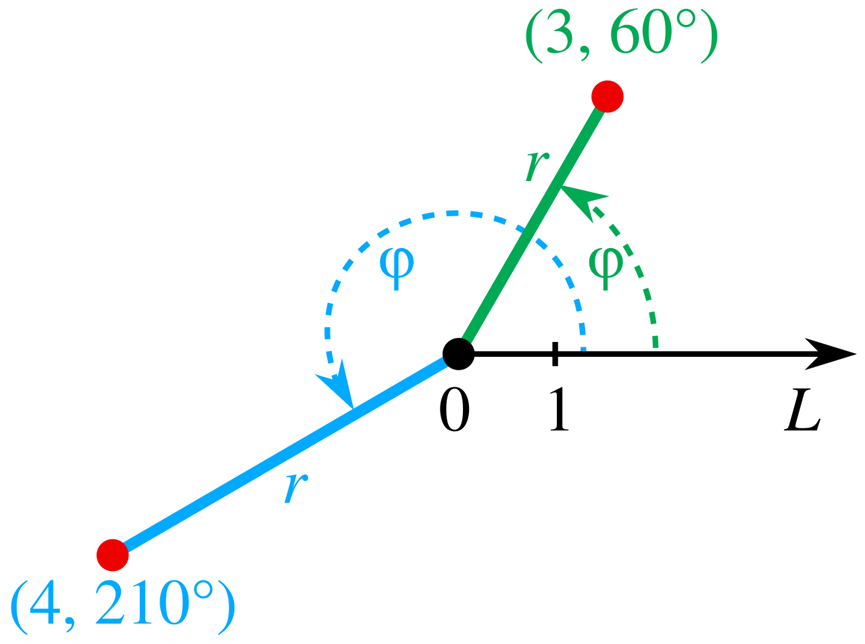

第一招:PolarQuant(极坐标量化)

我们用个简单的比喻来理解。传统上,AI记录一个数据点就像在三维直角坐标系里描述一个位置:需要明确它在X、Y、Z三个方向上的坐标值。

谷歌团队发现,这种方式效率不够高。于是,他们转而采用 “极坐标” 体系来描述数据。这就好比把“向东走100米,再向北走100米”的描述,改为“向东北45度方向走约141米”。后者只用了一个角度和一个距离,信息量丝毫未减,但描述方式却更加紧凑,直接省去了维护多个正交坐标轴所带来的大量元数据开销。

第二招:QJL(量化JL变换)

使用极坐标量化后,数据表示虽然紧凑,但在计算和还原时可能引入微小的误差。这时,TurboQuant 会祭出一个仅占用 1 bit 的微型“补丁包”。这个补丁包专门用于进行误差矫正,能够将那些因压缩而偏离轨道的数值,高效地“拉回”到接近原始值的位置,从而保证了最终结果的准确性。

这一套组合拳下来的效果堪称惊艳。根据论文数据,无需对模型进行任何额外的微调或训练,TurboQuant 就能将庞大的键值缓存量化到平均仅需 3 bit 表示,内存占用直接下降 6 倍。

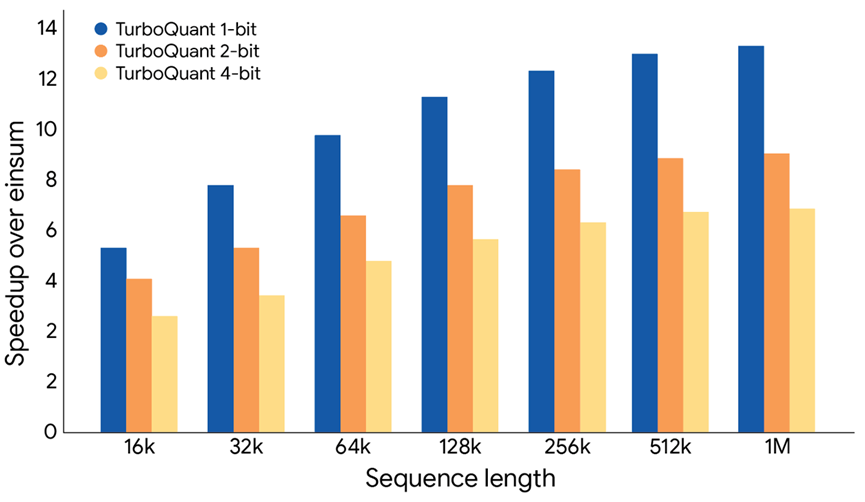

不仅仅是省内存,处理速度也得到大幅提升。例如,在英伟达 H100 GPU 上,其处理速度相比传统方法提升了最高 8 倍。

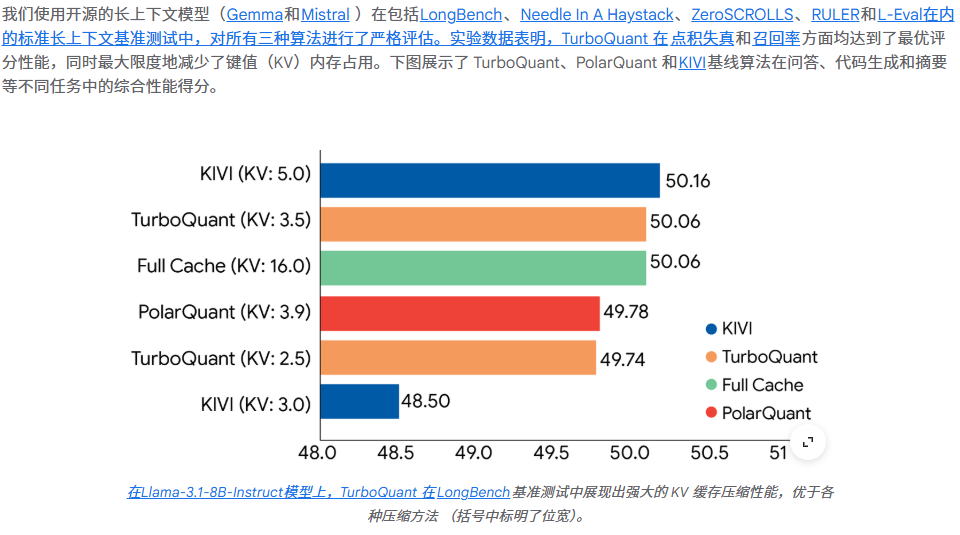

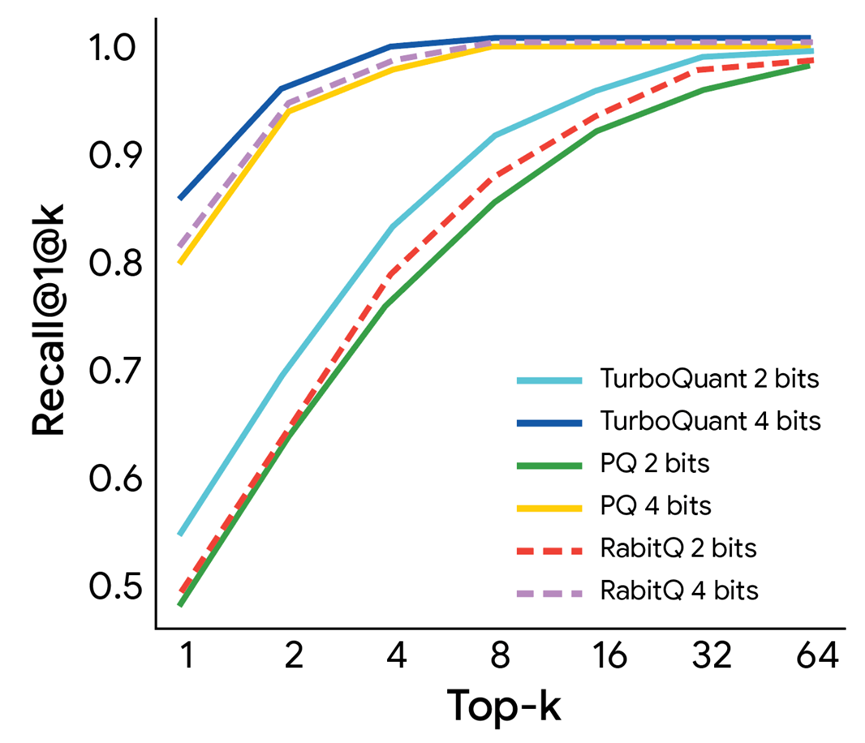

最令人惊讶的是精度表现。在多项长上下文基准测试(如LongBench)中,经过 TurboQuant 压缩后的模型,在回答准确率、代码生成等任务上,取得了与未压缩原模型 完全一致 的成绩,真正做到了宣传中的“精度零损失”。

注意,这不是“接近”或“几乎”,而是统计意义上的结果完全一致。这意味着压缩过程没有造成有效信息的丢失。

有评论认为,这可能是AI领域的又一个“DeepSeek时刻”——它从另一个维度(内存效率)打破了常规认知。过去,为了部署和运行大模型,尤其是长上下文模型,业界不得不投入巨资购买高显存GPU和海量内存。

如今,TurboQuant 展示了一条不同的路径:通过极致的算法优化,用原先1/6的内存资源干同样的活。这对于整个AI行业,尤其对 长上下文AI推理 而言,无疑是一枚深水炸弹,预示着相关应用的成本门槛和硬件需求可能会迎来断崖式下降。

这也是为什么存储巨头们感到压力——一旦AI服务器对内存的需求增长放缓,其增长故事的核心动力就会受到影响。

抛开资本市场波动,这项技术对开发者和普通用户来说也预示着利好。对于个人开发者或小型团队,以前想在本地运行一个百亿参数级别的模型,动辄需要64GB甚至128GB的内存,硬件成本高昂。

如果类似 TurboQuant 的技术得以普及,未来或许用 16GB 或 32GB 的内存就能在本地无损地运行更强大的模型,极大降低了个人研究和实验的门槛。这对于推动 深度学习 技术的普及和创新有积极意义。同时,在自动驾驶、移动设备等对内存和功耗极其敏感的领域,此类高效压缩技术的价值将更加凸显。

目前,TurboQuant 的相关论文和思想已经在开发者社区中引发了热烈讨论。尽管要将这项技术完美集成到现有的大模型基础设施(如PyTorch、TensorFlow)中可能还需要一些时间和工程优化,但它明确指出了一个重要方向:未来的AI竞赛,不能仅仅依靠无脑堆砌硬件算力和内存,极致的算法与系统优化 同样拥有颠覆格局的潜力。

谷歌的这项研究再次证明,在 计算机架构 与算法的交叉点上,依然存在着巨大的创新空间。它提醒我们,在追求更大模型的同时,让现有模型跑得更快、更省,同样是一条至关重要的技术路径。

我们不妨静候这项技术从论文走向实际应用。或许在不久的将来,无论是企业部署AI服务,还是个人购买电脑硬件,都能实实在在地享受到算法进步带来的成本红利。对于关注技术前沿的开发者而言,理解这类底层优化原理,对于把握 模型推理 的未来趋势至关重要。你可以在 云栈社区 的 人工智能 板块找到更多相关的深度讨论和技术资源。

*资料、图片来源:Google Research、网络。