想象一下,你带着3D相机潜入水下或驶入雾中,拍下的立体画面却一片模糊、颜色怪异、细节全无。此时,你希望AI能帮你修复这组照片,恢复其清晰亮丽的原貌——这正是立体图像恢复(Stereo Image Restoration)技术所要解决的问题。

然而,要让AI学好这门“手艺”,离不开高质量的“教材”——即数据集。当前该领域的研究正面临一个核心痛点:缺乏既真实又可控的立体基准数据。深圳大学与重庆师范大学的团队近期发布的工作M3D-Stereo,正是为了破解这一难题而生。他们甚至在实验室里用牛奶、雾化机和调光器,构建了首个覆盖多介质、多退化场景的高质量立体图像数据集。

对这类推动领域基础设施进步的工作感兴趣?欢迎在 云栈社区 与更多同行交流探讨。

立体图像恢复的瓶颈:真实、可控与立体的矛盾

回顾已有的“教材”(数据集),它们往往存在以下“偏科”问题:

- 偏科1:单目 vs 立体:许多修复数据集只提供单张照片(单目),缺乏成对的立体图像。这使得AI无法学习利用左右视图间的几何关系来提升修复效果。

- 偏科2:合成 vs 真实:部分数据集使用计算机合成(Synthetic)退化效果。虽然数据量大且控制精准,但与真实物理退化(如水下散射、设备噪声)存在差距,导致AI在真实场景中表现不佳。

- 偏科3:单一 vs 混合:大多数数据集仅针对单一退化类型,如仅有雾或仅有水下模糊。现实中,恶劣条件常是“组合拳”,例如雾霾天的低光照(耦合退化)。缺乏此类数据,AI的抗压能力难以得到全面锻炼。

- 偏科4:粗糙 vs 精细:许多从真实世界采集的数据集,其退化程度不可控,无法量化区分“轻度”、“中度”、“重度”等级别。这限制了对AI算法在不同难度下性能的精细评估。

简而言之,现有数据集要么不真实,要么不可控,要么不是立体,要么场景太单一,严重制约了立体图像恢复技术的发展。

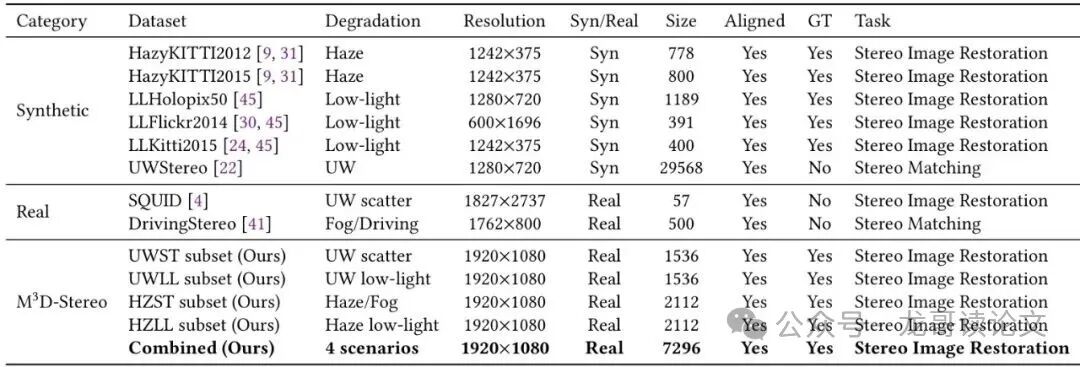

表1:成像退化数据集的对比 (UW:水下;GT:真值)。M³D-Stereo在“真实性”、“立体性”、“可控性”和“多场景”上做到了兼顾。

M³D-Stereo数据集:四大场景与六级可控退化

为了系统性地解决上述问题,研究团队决定“另起炉灶”,构建了M³D-Stereo数据集。其名称含义为:Multiple Medium, Multiple Degradation Stereo,即多介质、多退化的立体数据集。

该数据集的核心设计可通过下图一览无余:

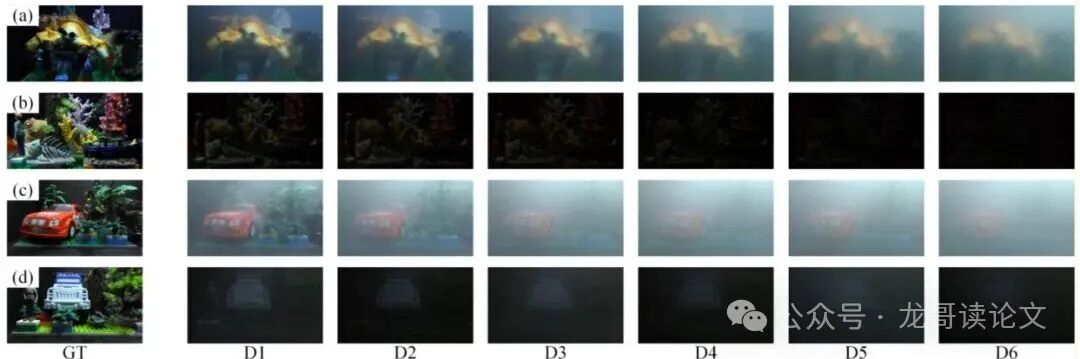

图3:M³D-Stereo数据集在退化等级D1–D6下的样本图像。最左列为清晰的真值(GT)。所有显示样本仅对应左视图。(a) 水下散射(UWST)。 (b) 水下低光(UWLL)。 (c) 雾霾散射(HZST)。 (d) 雾霾低光(HZLL)。退化严重程度从D1到D6递增。

四大核心场景:

- UWST:模拟水下悬浮颗粒造成的散射模糊。

- UWLL:模拟深海或昏暗水域的弱光环境。

- HZST:模拟空气中的雾霾、水汽造成的散射。

- HZLL:耦合退化场景,同时存在雾霾与光照不足。

六级渐进退化:

每个场景均设置了从D1(最轻微)到D6(最严重)的6个精确退化等级。这使得研究者能够量化分析算法性能随退化程度加深的变化趋势。

像素级对齐的真值:

对于每一对退化的立体图像,作者都在完全相同的相机位姿与场景布局下,拍摄了清晰无退化的“标准答案”(Ground Truth, GT)。这不仅为图像恢复提供了精准的评估基准,其清晰的立体对也能生成精确的深度(视差)真值,一举两得。

最终,M³D-Stereo包含了7904对高分辨率(1920x1080)立体图像,在物理真实性与实验室级可控性之间取得了良好平衡。

揭秘构建过程:高精度采集与可控退化模拟

光有巧思不够,如何将构想落地为高质量数据?M³D-Stereo的构建流程堪称实验室精密工程的典范。

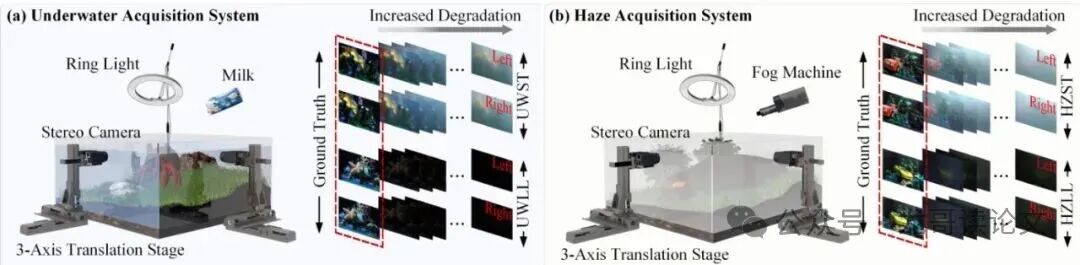

1. 搭建双系统采集平台

作者搭建了两个核心系统:一个盛满水的玻璃缸用于水下拍摄,一个密闭空间用于雾霾拍摄。场景中布置了丰富的物体以模拟复杂的几何结构与遮挡关系。

图1:M³D-Stereo数据采集平台。(a) 水下立体采集系统:添加牛奶模拟水下散射。(b) 雾霾立体采集系统:使用雾化机生成雾霾。退化严重程度沿箭头方向增加。

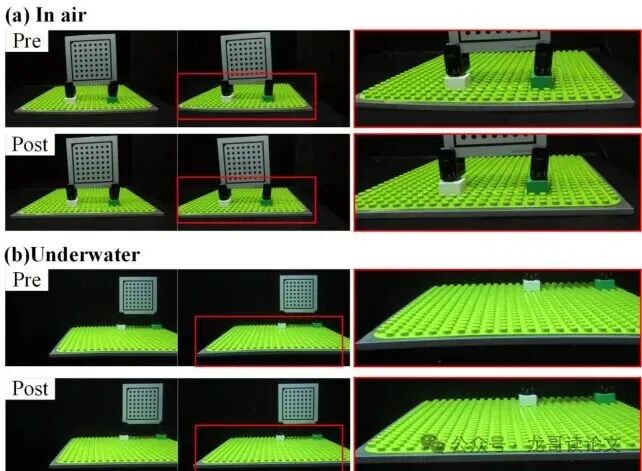

2. 立体相机与介质特定标定

使用两台ZED立体相机进行拍摄。一个关键挑战是:从空气到水下,光线折射率剧变,在空气中标定好的相机参数在水下会失效。因此,研究团队分别在水下和空气中进行了高精度重新标定,确保立体几何关系的绝对准确。

图2:立体校准精度可视化。(a) 在空气中;(b) 在清水中。Pre和Post分别表示校准前后的左右图像对。

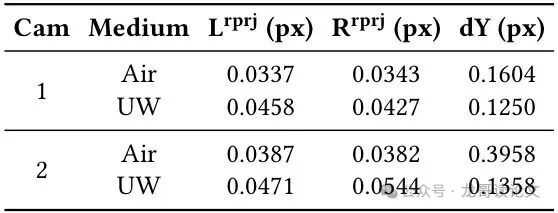

表2:立体相机标定精度。重投影误差极小,标定质量高。

3. “静态锁定”采集协议

这是保证GT与退化图像素级对齐的核心。拍摄时,相机与所有场景物体均被刚性固定。先拍摄清晰的GT,随后在不移动任何物体的前提下,逐步引入退化(如加牛奶、喷雾、调光),并逐级拍摄。从而确保每一张退化图都与GT在物理上严格对齐。

退化模拟“配方”:简单、廉价且科学

如何精确可控地制造从D1到D6的退化?研究团队给出了如下“配方”:

- 水下散射:使用脱脂奶粉配置浊液,分批次定量注入玻璃缸。从D1级的250毫升开始,每级增加100毫升,至D6级累计750毫升,精确模拟六级散射浓度。

- 水下低光:使用支持PWM调光的环形灯,固定六个亮度等级,并用照度计测量对应的光照度(Lux)值,实现光照强度的量化控制。

- 雾霾散射:在密闭空间内使用便携式雾化机。从D1级喷雾10秒开始,每级增加5秒喷雾时间,至D6级累计35秒,控制雾霾密度。

- 雾霾低光:采用组合设计,将特定的雾霾等级(如D2, D4, D6)与特定的低光等级(如D1, D3)进行配对,形成6个耦合退化等级,更贴近现实中的复杂交互。

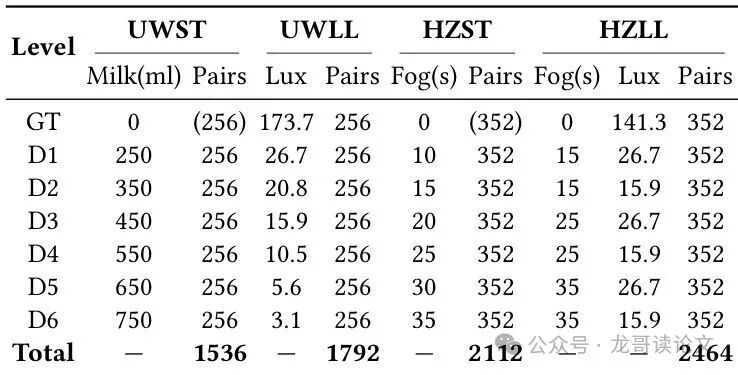

表3:M³D-Stereo 参数总结。每个等级都指定了物理控制参数和立体图像对数量。

基准测试:验证数据集实用性与算法性能

数据集的价值需要通过实验来证明。作者选用两个代表性的立体图像恢复方法——EPRRNet和PSIDNet,在M³D-Stereo上进行了全面测试。

1. 单级别退化测试

让模型分别针对D2、D4、D6等级进行训练和测试,评估其“单科成绩”。

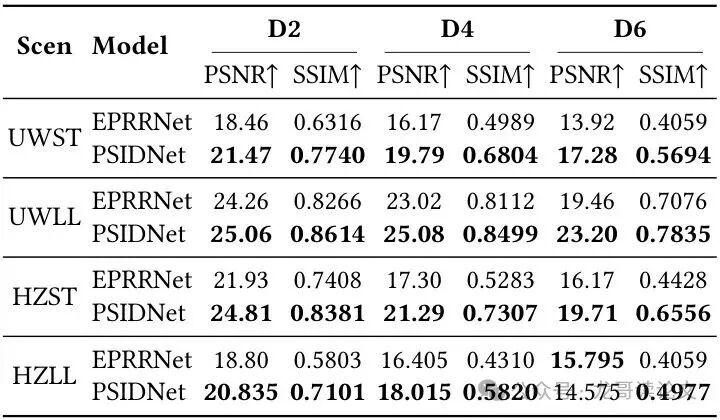

表4:单级别退化恢复结果(PSNR↑, SSIM↑)。

关键结论:

- 趋势合理:所有场景下,从D2到D6,PSNR和SSIM均显著下降,验证了数据集退化设置的合理性。

- PSIDNet更优:在几乎所有设置下,PSIDNet均优于EPRRNet,尤其在严重散射下结构保持能力更强。

- 耦合退化最难:HZLL场景的指标值普遍更低,证实了雾霾与低光耦合退化的超高难度。

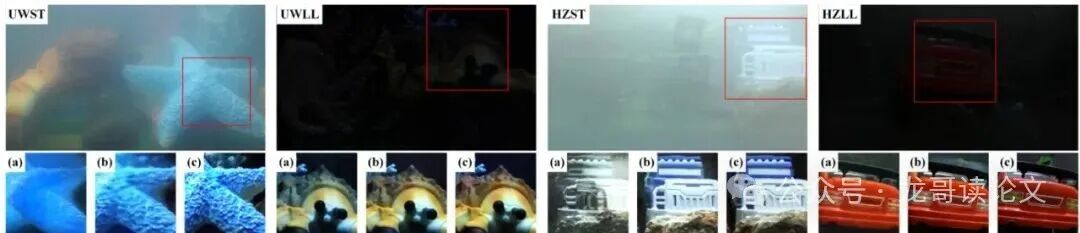

图4:在M³D-Stereo上的恢复示例。顶行为退化输入,底行为红色框区域的放大比较:(a) EPRRNet结果;(b) PSIDNet结果;(c) 清晰GT。视觉上PSIDNet结果更接近GT。

2. 混合级别退化测试

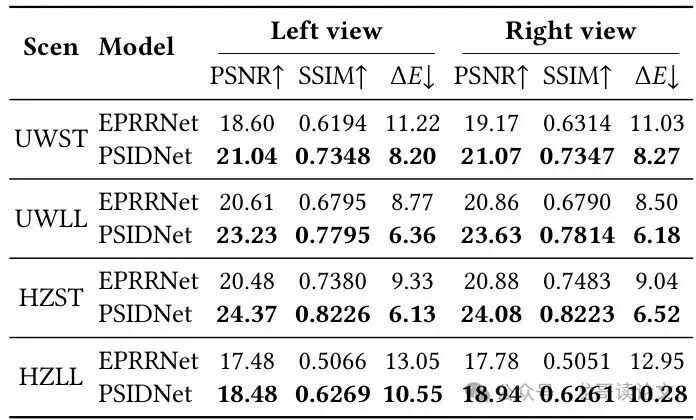

将所有D1-D6数据混合训练一个模型,测试其“综合能力”。结果显示PSIDNet依然普遍更优,并且引入了ΔE(色差)指标评估颜色保真度。

表5:混合级别退化下的图像恢复结果。

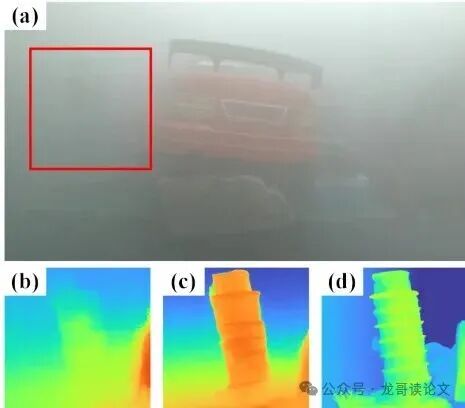

3. 立体匹配下游任务验证

修复图像不仅为了观感,更是为了提升如立体匹配等下游任务的可靠性。使用预训练的FoundationStereo模型进行实验:

图5:图像恢复对立体匹配(深度估计)的影响。(a) 退化输入。(b) 退化图像生成的深度图。(c) PSIDNet恢复后图像生成的深度图。(d) GT图像生成的深度图。

结果清晰表明:直接对退化图像进行立体匹配(b),得到的深度图混乱无序;而使用PSIDNet修复后的图像(c),物体轮廓变得清晰,深度层次得到部分恢复,显著更接近清晰GT产生的深度图(d)。这强有力地证明了立体图像恢复对于提升后续视觉感知任务的实用价值。

未来展望与领域启示

尽管M³D-Stereo意义重大,作者也指出了其局限性,例如场景尺度与真实世界相比仍显迷你,耦合退化的组合方式还可进一步丰富。这也为未来研究指明了方向:

- 扩展退化类型:加入雨、雪、沙尘、动态波浪等更复杂的物理退化。

- 发展几何感知恢复模型:利用该数据集提供的精确立体对应与深度真值,设计能同时利用图像内容与几何约束进行修复的新模型。

- 服务实际应用:为自动驾驶、水下机器人等领域的恶劣环境立体视觉(匹配、SLAM)提供宝贵的训练与评测基准。

这项工作的核心启示在于:当算法研究遭遇数据瓶颈时,采用严谨、可复现的工程方法构建高质量基准,其对于推动整个领域发展的价值,丝毫不亚于提出一个新颖的模型架构。它解决的是基础设施问题。

关键问题释疑

- 核心贡献是什么? 解决了立体视觉在恶劣环境下缺乏高质量基准数据集的痛点,首次提供了真实、立体、退化精细可控的多场景数据集。

- PSNR和SSIM是什么? 衡量图像修复质量的客观指标。PSNR(峰值信噪比)越高,像素误差越小;SSIM(结构相似性)越接近1,图像在亮度、对比度、结构上越相似。ΔE(色差)则衡量颜色准确性,越低越好。

- 立体恢复与单目增强的区别? 立体图像恢复处理成对的左右视图,不仅能利用单张图像的内容信息,还能利用视图间的几何对应关系和视差信息,通过信息互补获得更优的修复效果。

工作简评

- 创新性:系统性解决了领域基础设施问题,整合多介质、多退化、立体、可控、真实五大要素,设计思路具有很高的系统创新价值。

- 实验与价值:实验设计清晰合理,紧扣数据集用途。其学术价值巨大,为几何感知的图像恢复、恶劣环境立体视觉等研究提供了不可或缺的“标尺”,预计将被广泛引用。

- 复现与泛化:数据集已在Hugging Face开源,复现门槛极低。但由于在受控实验室环境构建,模型向真实极端场景的泛化能力仍需进一步验证。

这项融合了深度学习与精密工程的工作,为计算机视觉在复杂环境下的应用铺平了道路。无论是从事图像增强、立体匹配,还是关注自动驾驶、水下机器人感知的研究者与工程师,M³D-Stereo数据集都是一个值得深入了解和使用的宝贵资源。

主要参考文献

[1] M3D-Stereo: A Multiple-Medium and Multiple-Degradation Dataset for Stereo Image Restoration. arXiv preprint arXiv:2604.12917 (2026).

[2] 官方数据集地址: https://huggingface.co/datasets/M3D-Stereo/M3D-Stereo