在安徽具身智能领域,创下最高单笔融资纪录。

机器人前瞻4月30日报道,专注工业具身智能的聆动通用今日宣布完成数亿元Pre-A轮融资,投资方包括华义创投、讯飞创投、泰达科投、博众精工产投等。这笔资金也刷新了安徽省内该领域的单笔融资峰值。

此前,聆动通用已完成3轮融资:2024至2025年间,完成两轮数千万元天使轮,科大讯飞、合肥高投等纷纷入局;2025年8月,又获元禾璞华、讯飞创投等加持,完成新一轮数亿元天使轮融资。

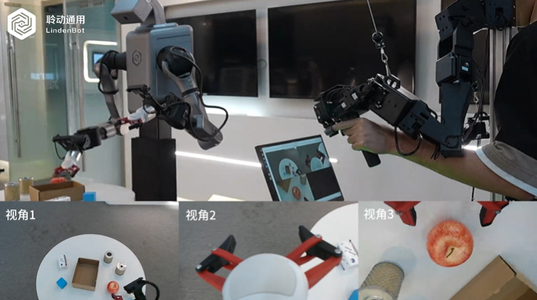

成立于2024年12月的聆动通用,已快速推出LDT系列通用机器人与LDB产品系列通用机器人。其中,LDT系列具身智能采训推一体机可覆盖机器人数据采集(需二次开发适配)与模型训练后的推理工作等场景,并被多个公共具身智能数据采集训练场、企业私有化训练场及高校科研机构所采用。

▲LDT系列具身智能采训推一体机执行数据采集工作

其新品LDB01则显得更为硬核。它搭载了聆动通用全栈自研的具身智能大模型iFlyBot-VLM、技能操作模型iFlyBot-VLA、多模态感知系统及算力平台,专为严苛工业环境打造,能够满足MTBF工业级平均无故障时长要求(连续工作1万小时起步)。这意味着,它被期望成为一条产线上不知疲倦的“老员工”。

▲新品LDB01机器人

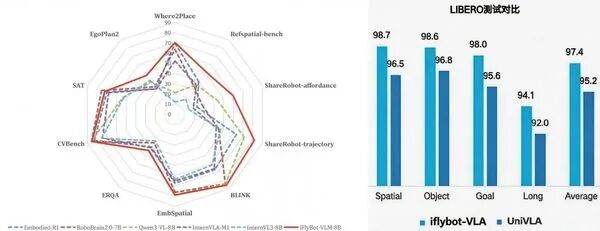

在“大脑”层面,聆动通用表示其iFlyBot-VLM大模型已在国内主流开源具身基础模型测评中达到SOTA水平,擅长将复杂的视觉与空间信息转化为机器人的操作指令。

在“小脑”操作层,基于VLM研发的iFlyBot-VLA具身操作大模型采用了显隐双路径动作规划框架。就像学徒通过观察师傅的动作来悟出门道,该模型会先从海量人机操作数据中学习隐性的动作逻辑,再生成明确、独立的动作指令指导机器人行动。在抓取、折叠、分拣等任务中,其VLA模型同样达到了顶尖水平。

聆动通用的核心技术班底是一支典型的学霸军团,成员来自中科大、哈工大、港中文、中科院、马普所、卡尔斯鲁厄等海内外顶尖高校与科研院所。创始人兼CEO季超,这位中国科学技术大学机器人方向的博士,曾任职于科大讯飞,长期深耕AI智能硬件与具身智能的产业化落地,在职期间曾积累数亿元营收的实战经验。

▲聆动通用创始人兼CEO季超演示具身智能采训推一体机

那么,这数亿元会花在刀刃上的哪些地方?聆动通用透露,本轮融资将用于新一代多模态具身智能数据采集管线及具身世界模型研发,以及量产交付体系的构建。 |