这无疑是开源机器翻译领域的一个标志性事件。

Google 翻译,其服务早已渗透至互联网的各个角落。而这一次,Google 采取了一项对开发者社区更具深远影响的举措:将自身数十年积累的翻译能力与经验,注入到一个全新的开源大语言模型中。

它的名字是 TranslateGemma。

这是一个基于 Gemma 3 架构、专门为翻译任务进行深度优化设计的 开放式翻译模型。其目标并非通用模型附带翻译功能,而是从模型架构到训练目标都紧紧围绕翻译这一核心任务构建。

模型提供三个参数规模的版本:4B、12B 和 27B。其中,4B 和 12B 版本尤其引人注目,因为它们能够在消费级显卡甚至更轻量的设备上本地运行。

TranslateGemma 覆盖了 55 种语言,并具备直接理解与翻译图像内文字的多模态能力。这意味着开发者完全可以在本地环境(包括移动设备)部署一个“私有化的高质量翻译引擎”,在精度与效率方面均达到了新的高度。

主要亮点

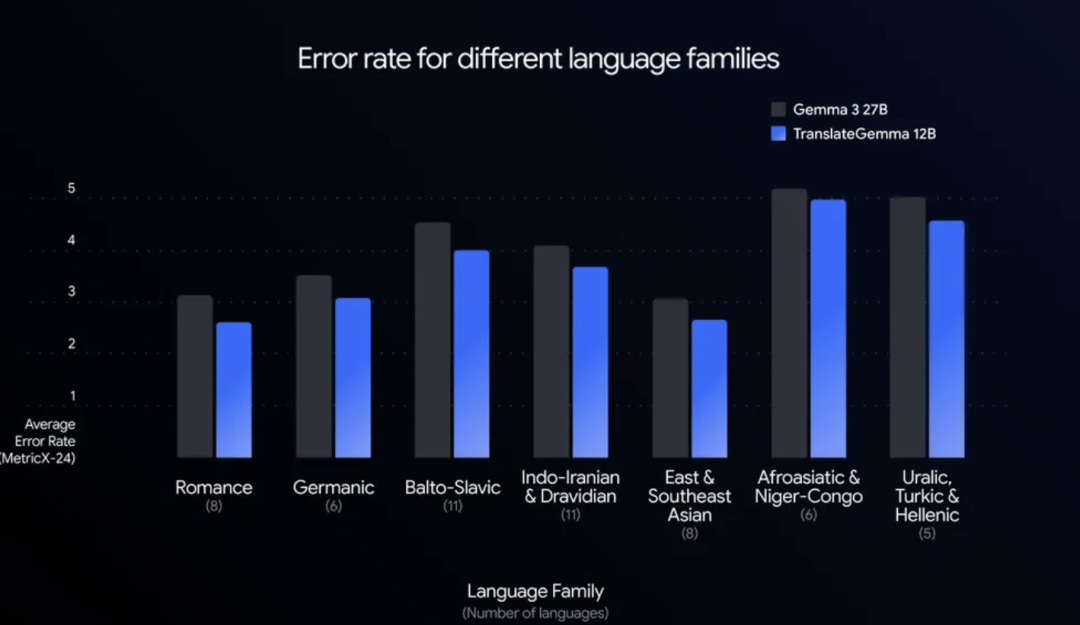

- 轻量高效:12B 参数模型在多项翻译评测中,其性能超越了更大的 27B 版本,实现了更快的推理速度与更低的能耗。

- 55种语言广泛覆盖:从英语、中文等高资源语言到多种低资源语言,均进行了针对性优化。

- 智能蒸馏与强化学习:融合了来自更强大模型(如 Gemini)的知识,通过两阶段训练使翻译结果更加自然、准确。

- 多模态能力:可直接接受图像输入,翻译图片中的文本内容。

- 多平台适配:模型经过优化,可运行在手机、笔记本电脑甚至单张GPU上,极大拓宽了应用场景。

技术原理浅析

TranslateGemma 的卓越性能源于其坚实的技术基础:

- 强大的基座模型:基于 Gemma 3,该模型本身已具备出色的推理与多模态理解能力。

- 高质量训练数据:利用了 Google 数十年来积累的海量翻译数据,包括从互联网挖掘的平行语料,这构成了其他开源项目难以复制的数据护城河。

- 两阶段精调策略:

- 监督微调 (SFT):首先使用由先进模型生成的高质量合成数据对模型进行训练,确保其对多种语言具有广泛的覆盖能力和高保真度的翻译基础。

- 强化学习 (RL):随后,通过专门的奖励模型,针对翻译的准确性和流畅度进行强化学习训练。这一阶段旨在让模型学会生成更符合上下文、读起来更自然的译文,从而拔高模型性能的上限。

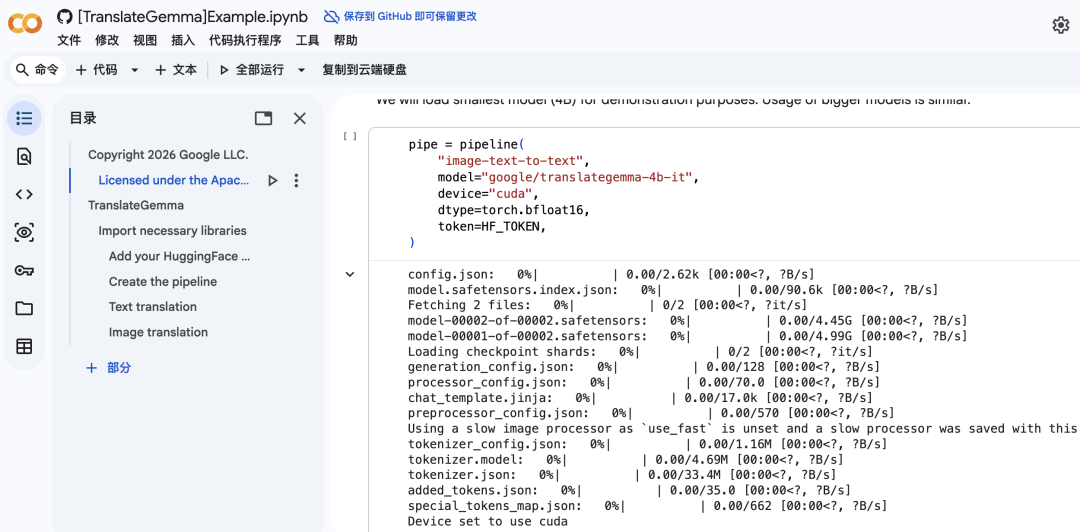

官方提供了可直接在线体验的 Colab Notebook:

https://colab.research.google.com/github/google-gemini/gemma-cookbook/blob/main/Research/[TranslateGemma]Example.ipynb#scrollTo=s8d-hVlVn_8H

有兴趣的开发者可以按照示例在本地部署,亲自测试其实际效果。模型已在 Hugging Face 上开源,可供下载使用。

写在最后

TranslateGemma 的出现,并非意在取代 Google 翻译这一成熟服务。它的更大意义在于,为开源机器翻译树立了一个新的标杆,有望加速高质量、多模态翻译能力向设备侧的普及,让这项技术从云端真正“下沉”到每一个终端。

这是 Google 罕见地将一项“核心能力”以如此开放的方式赋予开发者社区。对于广大用户和开发者而言,这意味着获得高质量翻译服务的门槛被显著降低。如果你的设备拥有显卡资源,或者正在寻找高性价比的本地翻译解决方案,那么 TranslateGemma 12B 无疑是当前最值得尝试的选择之一。

参考资料:

官方介绍:https://blog.google/innovation-and-ai/technology/developers-tools/translategemma/

模型仓库:https://huggingface.co/collections/google/translategemma

想了解更多前沿AI技术和开源项目动态,欢迎访问云栈社区进行交流与探讨。 |