本文将介绍如何基于 RTC Pilot 这一 WebRTC SFU 开源解决方案,构建一个用于视频会议的实时翻译系统。

RTC Pilot 是一个基于 C++17 开发的 WebRTC SFU(选择性转发单元),它支持跨平台部署(包括 Windows、Linux 和 macOS),二次开发效率较高。此外,它也是开源方案中为数不多全面支持 WebRTC 级联的服务。

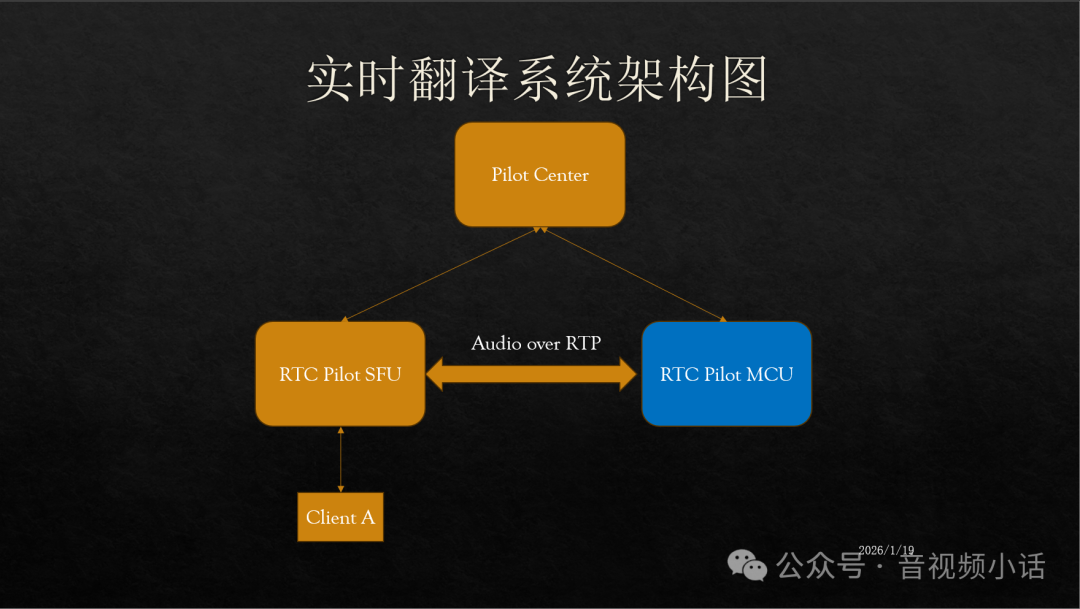

在 RTC Pilot 提供的完整 SFU 集群方案基础上,我们可以相对轻松地架构出一套实时翻译系统。下图展示了该系统的核心架构:

如图所示,系统主要包含以下几个角色:

- Pilot Center:作为会议系统的调度中心,它负责接收多个 SFU 节点的注册信息,并转发房间、用户以及 RTP 媒体流的相关信息。

- RTC Pilot SFU:这是核心的媒体转发节点,用于接入客户端,处理信令并转发媒体数据。这种集群化的 SFU 架构 是实现高并发、高可用实时通信的基础。

- 客户端:标准的 WebRTC 客户端,用于参与视频会议。

- RTC Pilot MCU:这是一个新增的 RTC Pilot 服务模块,专门用于在后台对媒体流进行特殊处理。在本系统中,它的核心任务是将音频流转换为文字,并进行英文到中文的翻译。

WebRTC 中的 MCU(多点控制单元)业务逻辑通常较为复杂。准确地说,它是一个标准的后台服务,一般不直接面向终端用户。MCU 属于 CPU 密集型服务,主要消耗计算资源,而非网络带宽资源。

一个典型的 MCU 主要具备以下几类功能:

- 传输业务:负责媒体的转发与转封装,支持包括 WebRTC、RTMP、SRT、HLS 在内的多种协议,从而实现丰富的网络接入与输出能力。

- 音视频处理:对输入的音视频流进行各种处理,例如音视频转码、视频画面合成、音频重采样、音频混合合成等。

- 与AI结合的处理:集成人工智能能力,如 ASR(自动语音识别)、TTS(文本转语音),并能接入大语言模型或虚拟人技术,实现更高级的 NLP 与语音交互 功能。

由于 MCU 服务涉及的模块较多,且高度业务化和定制化,因此它不像 SFU 那样有非常统一的标准。目前业界知名的开源 MCU 方案 OWT Server 就是一个典型案例。至于 RTC Pilot MCU 是否会开源,目前仍在评估中。

希望本次关于利用 RTC Pilot 构建实时翻译系统的分享对你有所启发。如果你想了解更多前沿的实时音视频架构与人工智能应用实践,欢迎访问 云栈社区 进行深入交流与探索。 |