由阿里通义团队发布的通用 GUI Agent 基础模型 MAI-UI-8B,现已正式上线模力方舟平台,支持 API 调用体验!

这是一款专为在真实 App 环境中执行操作任务而设计的智能体模型,具备强大的多任务决策能力、端云协同执行架构,以及前沿的 GUI Grounding(界面理解与定位)能力。无论是淘宝购物、飞猪订票、12306 查班次,还是在钉钉群里发信息,它都能跨应用自动完成复杂任务。

立即体验:https://moark.com/serverless-api?model=MAI-UI-8B

能真正操作手机的智能体

MAI-UI 是一组具备实际执行能力的多模态大模型,支持通过自然语言指令驱动手机 App 操作。它不仅能够理解复杂的用户意图,还能调用设备上的 MCP 工具链完成任务,并具备独特的端云协同能力:当本地模型能力不足时,可自动无缝切换至云端更强大的模型继续执行。

模型覆盖 2B、8B、32B 和云端大模型 235B-A22B 全系列规格,可根据实际部署场景灵活选择。本次模力方舟上线的是其 8B 版本,在保障高效推理性能的同时,也具备了较强的任务泛化能力。

多任务场景演示

办公事务:查 12306 班次 + 改会议 + 群里同步信息

我需要紧急出差上海,帮我去12306查询现在最早从杭州西站去上海虹桥、有二等座票的班次,在钉钉前沿技术研讨群里把到达时间同步给大家,再把我和水番的会议日程改到明天同一时间,在群里发消息@他,礼貌解释因为临时出差调整会议时间,询问他明天是否有空。

(此处原为演示视频,视频内容展示了 MAI-UI 依次操作 12306、钉钉、日历等应用,完成查询、修改、通知等一系列连贯操作。)

生活场景:盒马买菜前,顺手查下老婆的待办

盒马买菜,买一份雪花牛肉卷、一份娃娃菜、一份金针菇,再随便买一个豆制品。对了,去日历中待办里检查下我老婆有什么要在盒马买的,我确认下要不要一起买。

(此处原为演示视频,视频内容展示了 MAI-UI 在盒马应用内搜索添加商品,并切换到日历应用查看待办事项。)

出行导航:帮我规划两段行程、记好笔记

我现在在阿里巴巴云谷园区,我要先去 招商银行取钱,再去城西银泰城。帮我规划公交地铁出行的路线,选一家在4公里以内的、用时最短的招商银行,两段行程总时间不要超过2小时,把规划行程记在笔记中我一会看,标题为下午行程,内容为两段行程细节。

(此处原为演示视频,视频内容展示了 MAI-UI 调用地图工具规划路线、计算时间,并将最终方案记录到笔记应用中。)

四大核心能力升级

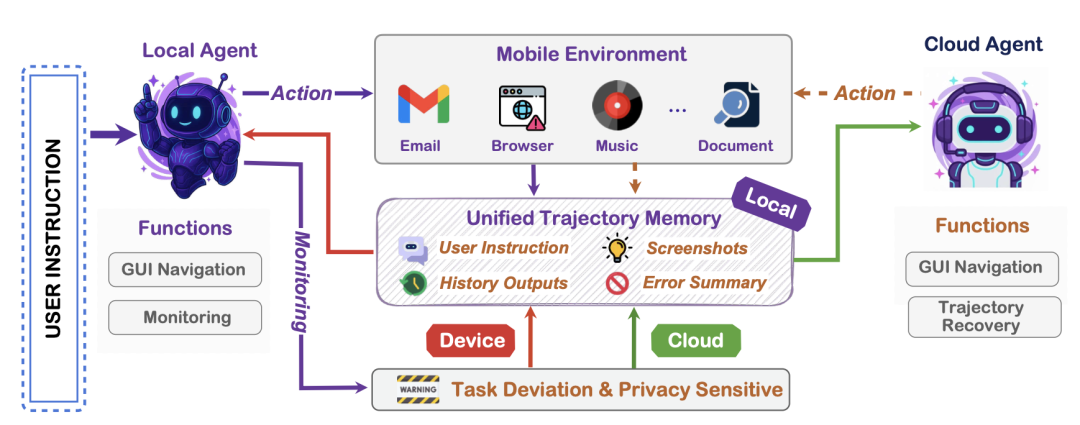

原生支持端云协同执行

传统的 GUI Agent 要么只能部署在云端,受限于网络和隐私,要么必须轻量化部署在本地设备,能力有限。MAI-UI 引入了原生的端云协同机制:

- 本地模型作为主执行体,具备基础的 GUI 操作能力;

- 若执行过程中发现任务失败、指令偏离或本地能力不足,且任务不涉及敏感数据,则会自动切换至云端更强大的模型继续执行;

- 整个切换过程由统一的「轨迹记忆模块」串联,确保任务上下文不中断。

根据技术报告,这套协同系统在实测中将纯本地执行的成功率提升了 33%,同时云端调用减少了超过 40%,在隐私保护与计算成本之间取得了良好平衡。

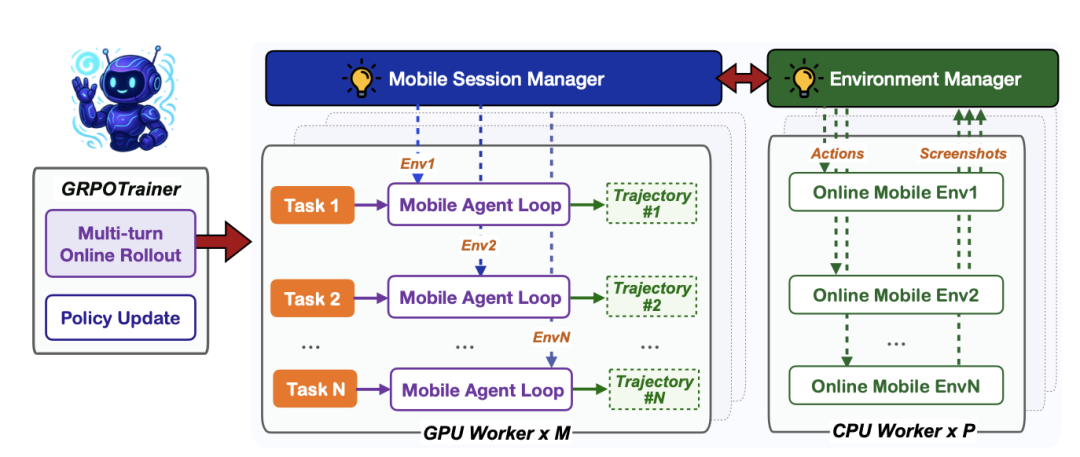

多模态强化学习训练,稳定应对真实环境

为了提升模型在复杂、动态的真实 App 环境中的执行稳定性,MAI-UI 构建了一套高性能的在线深度强化学习训练框架:

- 训练过程中支持高达 512 并发的移动设备模拟环境,最高可支持 50 步的长链条任务;

- 采用异步策略采样 (rollout)、混合并行等优化策略,显著降低了训练的资源瓶颈;

- 能够根据任务成功率动态调整任务难度(自动课程学习),有效避免了训练过程中的崩溃;

- 引入「行为判定器 + 大模型裁判系统」双轨评估体系,大幅提升了任务完成与否评判的准确性。

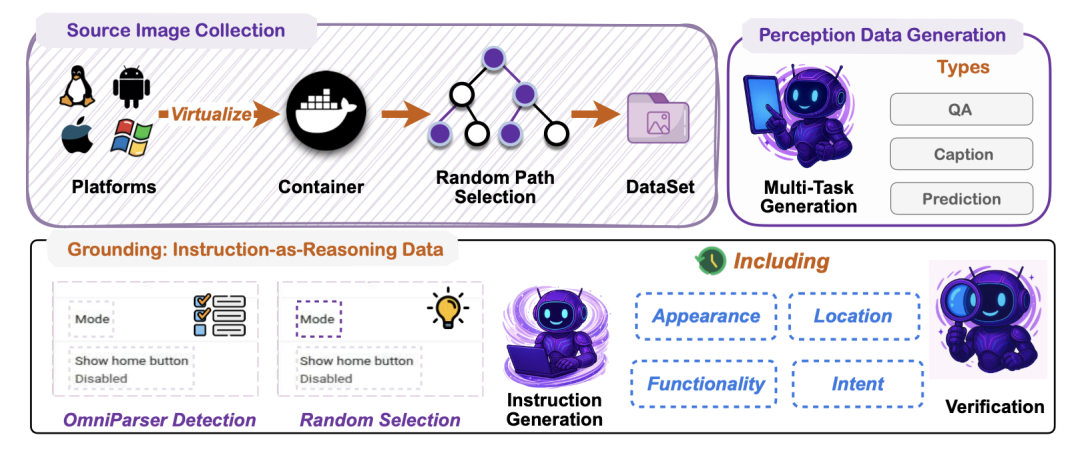

看懂界面的新一代 GUI Grounding 能力

MAI-UI 不止于简单的“点点屏幕”,它是一款能真正看懂复杂 App 界面元素的 Grounding 大模型:

- 使用「多视角指令生成」策略,从外观、功能、位置、意图等多个维度引导模型深入理解界面;

- 引入 zoom-in 推理机制,在初步预测出关键操作位置后,会自动放大该区域界面进行更细致的判断;

- 在训练过程中加入了结构化的 Reasoning 过程,显著提升了模型对界面元素的定位准确率。

在多项权威基准测试中,MAI-UI 均取得了 SOTA(当前最优)成绩:

- ScreenSpot-Pro: 73.5%

- UI-Vision: 49.2%

- MMBench GUI L2: 91.3%

这些成绩均领先于同期的 Seed1.8、Gemini-3-Pro、GUI-Owl 等代表性模型。

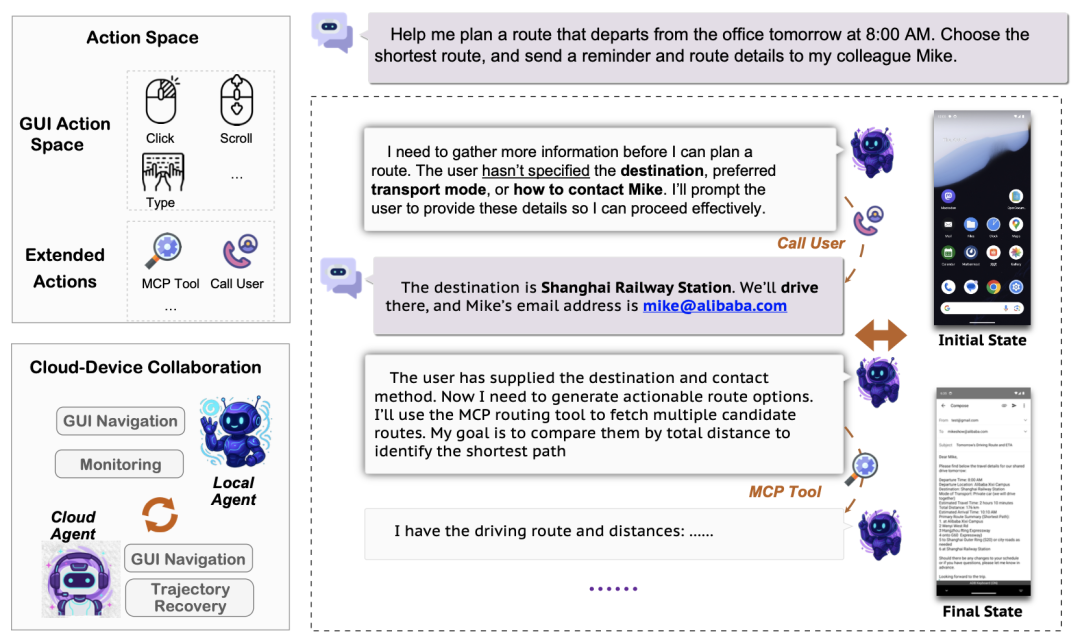

支持 ask_user 与 mcp_call 两种扩展操作

MAI-UI 的动作空间并不局限于基础的 UI 操作(点击、滑动、输入等),更支持两类关键的扩展操作,这使其更加智能:

- ask_user:当用户指令缺失关键信息(如目的地、联系方式)时,模型会主动向用户提问以获取补充,而非盲目执行导致失败。

- mcp_call:能够调用如高德地图、天气查询等外部 API 工具,以更稳定、高效的方式获取信息或完成任务,弥补了纯界面操作的局限性。

这意味着,MAI-UI 不再只是一个机械执行预定义指令的工具,而是具备了初步的自主判断、信息补充和计划执行能力。

结语

MAI-UI 代表了一类正在探索人机交互新范式的模型,它打破了传统语音助手、脚本自动化工具的碎片化限制,让“一句话完成复杂任务”逐渐成为现实。对于正在探索 App Agent、GUI 多模态交互、RPA 自动化以及人工智能 Agent 化体验的开发者与企业用户而言,MAI-UI 无疑是一款极具研究与应用价值的模型。

现在即可访问模力方舟平台,亲自体验这个能用一句话操作手机 App 的智能体,探索下一代自动化交互的可能。欢迎在 云栈社区 分享你的使用心得与技术见解。

体验地址:https://moark.com/serverless-api?model=MAI-UI-8B